\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 22/03/2026

Di Alex (pubblicato @ 17:00:00 in Amici animali, letto 253 volte)

Un lupo e un cavallo addestrati per il cinema nelle strutture dello Zoo delle Star vicino Roma

Nelle campagne intorno a Roma, lontano dai riflettori ma vicini agli studios di Cinecittà, esistono strutture specializzate nell'addestramento di animali per il cinema. Lo Zoo delle Star è una di queste realtà uniche, dove lupi, orsi, cavalli e rapaci imparano a recitare sotto la guida di addestratori professionisti.LEGGI TUTTO L'ARTICOLO

Roma e il cinema: un matrimonio lungo un secolo

Roma ha un rapporto privilegiato con il cinema fin dalle origini dell'industria cinematografica italiana. Cinecittà, fondata nel 1937 su impulso del regime fascista e presto diventata la "Hollywood sul Tevere" grazie a produzioni monumentali come Ben-Hur, Cleopatra e i film di Federico Fellini, ha attratto per decenni produzioni internazionali che richiedevano non solo set scenografici ma anche figure professionali rare e specializzate: stuntman, artigiani di costumi storici, tecnici di effetti speciali e, inevitabilmente, addestratori di animali.

Le produzioni storiche, western all'italiana, avventuriere e naturalistiche che hanno costellato la storia del cinema romano dagli anni Cinquanta agli anni Ottanta richiedevano disponibilità di animali addestrati a recitare davanti alla macchina da presa: cavalli capaci di cadere in modo controllato durante le scene di battaglia, lupi che rispondessero ai comandi in campo aperto, orsi addestrati a interagire con gli attori senza pericolo, rapaci da falconeria pronti a volare su precise traiettorie di fronte alla macchina da presa. Intorno a questa domanda stabile si sviluppò nel Lazio un piccolo ecosistema di professionisti specializzati nell'addestramento cinematografico degli animali.

Lo Zoo delle Star: una struttura unica nel panorama europeo

Nelle campagne tra Roma, Bracciano e la Tuscia viterbese si trovano alcune delle strutture di addestramento cinematografico di animali più rinomate d'Europa, tra cui quella che il mondo del cinema italiano conosce come lo Zoo delle Star — un nome informale che indica non un singolo luogo ma una rete di aziende agricole specializzate e di famiglie di addestratori che si tramandano la professione di generazione in generazione. Queste strutture ospitano spesso decine di animali di specie diverse: cavalli di razze antiche e moderne addestrati a scene di combattimento, animali selvatici come lupi, volpi e cinghiali in programmi di addestramento graduale, rapaci di varie specie per le sequenze di falconeria, oltre a animali esotici occasionalmente richiesti dalle produzioni internazionali.

L'addestramento cinematografico degli animali è una disciplina che richiede anni di lavoro e un approccio basato esclusivamente sul rinforzo positivo — premi alimentari, stimoli sonori, comandi gestuali — senza ricorrere a coercizioni fisiche, pratiche oggi vietate dai protocolli internazionali di tutela del benessere animale sui set cinematografici. Un cavallo addestrato per una scena di battaglia deve imparare a "cadere" su richiesta in modo sicuro per sé e per il cavaliere, a restare immobile di fronte a esplosioni controllate e a interagire con attori sconosciuti in ambienti altamente stimolanti senza manifestare aggressività o panico.

Il metodo: anni di lavoro, rinforzo positivo e fiducia

Il processo di addestramento cinematografico di un animale inizia molto prima che inizi la produzione del film. Per un cavallo destinato a scene storiche complesse, il programma tipico richiede dai due ai quattro anni di lavoro progressivo, partendo dalla gestione di base — abituazione al contatto umano, al trasporto, ai rumori improvvisi — per arrivare gradualmente alle scene specifiche. L'addestratore costruisce con l'animale un rapporto di fiducia profondo che è la base di tutto: un animale che non si fida del proprio addestratore non risponde ai comandi in situazioni di stress, vanificando anni di lavoro.

Per i predatori selvatici come lupi e volpi, il processo è ancora più delicato. Gli animali vengono socializzati dall'infanzia con gli esseri umani attraverso un protocollo rigoroso che non mira a renderli "domestici" — il che sarebbe pericoloso — ma ad abituarli a operare in vicinanza degli esseri umani senza manifestare comportamenti aggressivi o di fuga. I lupi addestrati per il cinema rimangono animali selvatici in tutto e per tutto: è la gestione ambientale e comportamentale dell'addestratore a rendere possibile la loro presenza sicura sul set.

Le produzioni e i film: un palmares romano

Le strutture di addestramento del Lazio hanno contribuito a produzioni cinematografiche e televisive di primo piano. La serie televisiva internazionale di maggior successo prodotta a Cinecittà negli ultimi anni ha utilizzato cavalli romani addestrati localmente per le scene di battaglia. Produzioni naturalistiche e documentari hanno attinto alle strutture laziali per sequenze con lupi e rapaci. Alcune delle grandi produzioni hollywoodiane ambientate in epoche storiche o in ambienti naturali che hanno scelto Roma come base logistica hanno integrato nelle proprie riprese animali addestrati dalle famiglie laziali di addestratori.

Il benessere degli animali sul set è oggi monitorato da rappresentanti delle associazioni animaliste internazionali e dalle figure dell'American Humane Association nei set con co-produzioni americane. Il marchio "No animals were harmed" — nessun animale è stato maltrattato — che appare nei titoli di coda dei film americani è il risultato di un sistema di supervisione che coinvolge anche i set europei con coproduzioni transatlantiche. Le strutture laziali più professionali hanno adottato volontariamente standard equivalenti anche per le produzioni italiane pure.

Come visitare e il futuro del settore

Alcune delle strutture di addestramento cinematografico nelle campagne romane sono aperte a visite guidate in giornate specifiche, offrendo al pubblico — e soprattutto alle scolaresche — la possibilità di vedere da vicino gli animali e di assistere a dimostrazioni di addestramento con rapaci e cavalli. Le visite sono limitate per garantire il benessere degli animali e richiedono prenotazione.

Il futuro del settore è in evoluzione: l'uso sempre più sofisticato della computer grafica nelle produzioni cinematografiche ha ridotto la domanda di animali in carne e ossa per molte tipologie di scene, mentre rimane stabile per le scene in cui la presenza fisica dell'animale con gli attori umani è necessaria per ragioni di autenticità emotiva. Le strutture si stanno adattando diversificando le attività verso l'agriturismo, l'equiterapia e la didattica naturalistica, costruendo una sostenibilità economica che non dipenda esclusivamente dal calendario delle produzioni cinematografiche.

Dietro ogni cavallo che si inchina davanti alla macchina da presa, ogni lupo che avanza su comando, ogni falco che atterra sulla mano dell'attore, ci sono anni di pazienza, migliaia di ore di lavoro e una relazione tra essere umano e animale che non assomiglia a nessun'altra. Un cinema senza queste relazioni sarebbe possibile, ma sarebbe più povero.

Di Alex (pubblicato @ 16:00:00 in Intelligenza Artificiale, letto 265 volte)

Andrej Karpathy e il paradigma del vibe coding: quando l'intenzione batte la sintassi

Nel 2025 Andrej Karpathy coniò "vibe coding" per descrivere un fenomeno già in atto: comunicare all'IA una visione, non istruzioni. I programmatori più efficaci non erano quelli con più sintassi, ma quelli con più chiarezza semantica. Un cambio di paradigma con tre implicazioni profonde: democratizzazione, velocità, nuovo ruolo umano.LEGGI TUTTO L'ARTICOLO

Karpathy: il ricercatore che ha dato un nome a una rivoluzione

Andrej Karpathy è uno dei nomi più rispettati nell'universo della ricerca sull'intelligenza artificiale. Ex direttore dell'intelligenza artificiale di Tesla, dove ha guidato lo sviluppo dei sistemi di visione per la guida autonoma, e membro fondatore di OpenAI, Karpathy ha una rara capacità di vedere i cambiamenti strutturali nel modo in cui l'IA viene usata prima che diventino evidenti alla massa. Nel 2025 ha coniato il termine "vibe coding" in una serie di post pubblici che descrivevano il suo approccio personale allo sviluppo di software con i Large Language Model — e il termine ha fatto il giro del mondo tecnologico con una velocità che poche espressioni del lessico informatico avevano mai raggiunto.

La sua intuizione fu semplice ma rivoluzionaria nella sua semplicità: se l'IA è in grado di scrivere codice di qualità professionale, il ruolo dell'essere umano nella catena di sviluppo non è più quello di scrivere istruzioni dettagliate riga per riga. Il suo ruolo diventa quello di comunicare una visione, un'atmosfera, una "vibe" — una direzione funzionale ed emozionale abbastanza chiara da permettere al modello di linguaggio di ricavarne la struttura tecnica corretta senza ulteriori specificazioni. La precisione sintattica viene sostituita dalla precisione semantica.

L'osservazione chiave: i migliori con l'IA non sono i migliori programmatori

Ciò che Karpathy osservò nella pratica della Silicon Valley — e in prima persona nella propria — fu una correlazione controintuitiva: i programmatori più efficaci nel lavoro con i modelli di linguaggio non erano necessariamente quelli con la conoscenza tecnica più approfondita. Erano quelli che sapevano descrivere con chiarezza il risultato desiderato, che avevano una visione del prodotto abbastanza nitida da tradurla in linguaggio naturale preciso, e che sapevano distinguere rapidamente tra un output che rispettava l'intenzione originaria e uno che la tradiva.

Questo capovolgimento della gerarchia delle competenze ha implicazioni enormi per il mondo dell'istruzione tecnologica e del mercato del lavoro. Un designer con vent'anni di esperienza utente che sa descrivere con precisione cosa deve sentire un utente interagendo con un'interfaccia può ottenere risultati migliori di un programmatore junior che sa scrivere React ma non riesce a formulare in modo chiaro l'obiettivo funzionale del componente. Il valore si sposta dalla padronanza dello strumento alla chiarezza dell'intenzione.

Le tre implicazioni profonde del paradigma Karpathy

Il cambio di paradigma descripto da Karpathy ha tre implicazioni strutturali che si stanno dispiegando nel 2026. La prima è la democratizzazione: chiunque abbia un'idea buona e sappia descriverla con precisione può realizzarla in forma di software, indipendentemente dalla propria formazione tecnica. Questo abbatte la barriera d'ingresso all'entrepreneurship tecnologica in modo radicale e crea una nuova classe di "costruttori naturali" che non si sarebbero mai chiamati programmatori ma che oggi producono applicazioni funzionanti.

La seconda implicazione è la velocità. I cicli di sviluppo si riducono da mesi a giorni, a volte a ore. Un prodotto che avrebbe richiesto un team di cinque sviluppatori per tre mesi può ora essere prototipato da una singola persona in un fine settimana. Questo non significa che la qualità sia la stessa — ci sono aspetti della robustezza, della sicurezza e della scalabilità che il vibe coding da solo non garantisce — ma significa che la distanza tra l'idea e il prototipo verificabile si è ridotta a una frazione di quanto era in precedenza. La terza implicazione riguarda il ruolo umano: ci si sposta dalla scrittura del codice alla supervisione, alla validazione e alla curatela dell'output dell'IA. Il programmatore diventa un revisore critico di un collaboratore instancabile e velocissimo.

La qualità dei prompt come nuova competenza chiave

Uno degli aspetti più pratici dell'eredità intellettuale di Karpathy riguarda l'importanza della qualità dei prompt nella determinazione della qualità del risultato. L'efficacia del vibe coding non è uniforme: descrizioni generiche e vaghe — "fai un'app per gestire le mie attività" — producono risultati mediocri, implementazioni banali che non colgono la specificità dei bisogni reali dell'utente. Al contrario, l'uso di dettagli specifici su layout, flussi di dati, stati di errore, casi limite e comportamenti attesi permette di ottenere applicazioni di livello professionale che rispecchiano fedelmente l'intenzione originaria.

Questa correlazione tra qualità del prompt e qualità del codice ha generato una nuova disciplina: il "prompt engineering" applicato allo sviluppo software, distinto dal prompt engineering generico per chatbot o generatori di immagini. I migliori vibe coders sviluppano un vocabolario tecnico proprio per comunicare con i modelli: sanno quando specificare il framework, quando lasciare all'IA la scelta, quando descrivere il comportamento desiderato in termini di esperienza utente piuttosto che di implementazione tecnica. È una competenza ibrida, a cavallo tra design, product management e ingegneria del software.

Il vibe coding non è per tutti: i limiti strutturali del paradigma

Onestà intellettuale impone di riconoscere, insieme all'entusiasmo di Karpathy, anche i limiti strutturali del paradigma che lui stesso ha contribuito a definire. Il vibe coding funziona eccellentemente per la prototipazione rapida, per le applicazioni di complessità media, per i casi d'uso ben definiti e per i contesti in cui l'utente è in grado di valutare correttamente il risultato. Funziona meno bene — o non funziona — per sistemi ad alta criticità dove la correttezza è assoluta (sistemi medici, aeronautici, finanziari), per architetture di grande complessità dove le decisioni di design hanno conseguenze a lungo termine difficili da invertire, e per contesti dove i requisiti di sicurezza richiedono una verifica formale che i sistemi di IA non possono garantire.

Karpathy stesso ha sempre insistito su questo punto: il vibe coding è un acceleratore straordinario, non una panacea. Il programmatore esperto che integra il vibe coding nel proprio flusso di lavoro ottiene risultati superiori sia al programmatore tradizionale puro sia al vibe coder inesperto. La chiave è sapere quando affidarsi all'IA e quando riprendere il controllo diretto, una competenza che si costruisce solo con l'esperienza e che richiede una comprensione profonda — non necessariamente sintattica, ma concettuale — di come funziona il software.

Karpathy non ha inventato il vibe coding: ha visto quello che stava già accadendo nella Silicon Valley e gli ha dato un nome abbastanza preciso da permettere a migliaia di persone di riconoscere la propria esperienza in una parola sola. E quando una parola riesce a fare questo, il paradigma esiste già. Il prossimo capitolo esplorerà gli strumenti specifici che rendono il vibe coding possibile nel 2026.

Di Alex (pubblicato @ 15:00:00 in Geopolitica e tecnologia, letto 811 volte)

Il referendum costituzionale sulla giustizia del 22-23 marzo 2026: il fronte del NO

Il 22 e 23 marzo 2026 gli italiani votano sul referendum costituzionale per la separazione delle carriere tra giudici e PM, due CSM separati e una nuova Alta Corte disciplinare. PD, M5S e AVS dicono NO. Cinque voci autorevoli della sinistra spiegano perché questa riforma è sbagliata.LEGGI TUTTO L'ARTICOLO

Cos'è in gioco: la riforma costituzionale della magistratura

Il referendum del 22 e 23 marzo 2026 non è un referendum abrogativo ordinario: è un referendum costituzionale confermativo, indetto perché la legge di riforma non ha raggiunto in Parlamento la maggioranza qualificata dei due terzi. Gli italiani sono chiamati a dire Sì o No alla legge costituzionale pubblicata in Gazzetta Ufficiale il 30 ottobre 2025, che modifica sette articoli della Costituzione — gli articoli 87, 102, 104, 105, 106, 107 e 110 — intervenendo sull'organizzazione interna della magistratura italiana. Non è previsto alcun quorum: vincerà chi prenderà un voto in più.

I punti centrali della riforma sono quattro: la separazione definitiva delle carriere tra magistrati giudicanti e requirenti, l'istituzione di due distinti Consigli Superiori della Magistratura — uno per i giudici e uno per i pubblici ministeri — la selezione dei componenti laici degli organi di autogoverno attraverso un sistema di sorteggio, e la creazione di una nuova Alta Corte Disciplinare con competenza esclusiva sui procedimenti disciplinari a carico dei magistrati. PD, Movimento 5 Stelle e Alleanza Verdi e Sinistra sono compattamente schierati per il No. Ecco le loro ragioni principali, espresse dalle voci più autorevoli del fronte progressista.

Nicola Gratteri: "Non si cambia la Costituzione per quaranta magistrati"

Il procuratore capo di Napoli Nicola Gratteri è tra le figure più rispettate e indipendenti della magistratura italiana. Il suo No al referendum è netto e motivato con argomenti tecnici che tagliano corto con le narrazioni di entrambi gli schieramenti. "Non si modificano sette articoli della Costituzione perché quaranta magistrati mediamente ogni anno passano dalla funzione requirente a quella giudicante, e devono anche cambiare Regione", ha dichiarato. La separazione delle carriere è nei fatti già molto avanzata: i passaggi di funzione sono rarissimi, soggetti a vincoli geografici e valutativi stringenti, e non rappresentano un problema sistemico che giustifichi una riforma costituzionale di questa portata.

Gratteri ha chiarito con forza la sua posizione anche sul piano del potere: "Io non voglio un pubblico ministero più forte. Il pubblico ministero non deve fare sollevamento pesi." Il punto non è rafforzare la procura, ma garantire che l'autonomia complessiva della magistratura non venga erosa da una riforma che nasce — secondo Gratteri — da un impulso politico e non da un'esigenza funzionale reale del sistema giudiziario italiano. "Questa è una riforma imposta", ha concluso, usando una parola precisa che rimanda alla sua natura di atto politico piuttosto che di risposta a un bisogno organizzativo reale della giustizia.

Giuseppe Conte: "È una riforma truffa che vuole la politica libera dal controllo"

Il presidente del Movimento 5 Stelle e già presidente del Consiglio Giuseppe Conte ha guidato il fronte del No con un'analisi centrata sul rapporto tra politica e magistratura. Dal palco di piazza del Popolo a Roma, nella chiusura della campagna referendaria del 18 marzo, Conte ha detto: "Al governo ci andremo, ma a questa riforma diciamo No." La frase è più politicamente significativa di quanto sembri: Conte riconosce che il suo partito potrebbe ritrovarsi a governare sotto una magistratura separata e indebolita, eppure sceglie ugualmente di votare No. "Vinceremo le prossime elezioni, ma vogliamo essere controllati da una magistratura indipendente", ha aggiunto Schlein raccogliendo il testimone.

La tesi di Conte è che la riforma non sia nata da un'esigenza tecnica ma da "un'onda lunga: il primato della politica che deve controllare la magistratura". Definendo il progetto "una riforma truffa", l'ex premier ha evocato il rischio che la separazione delle carriere trasformi il pubblico ministero in una figura strutturalmente più vicina all'esecutivo. "La separazione delle carriere è già nei fatti", ha osservato, ricordando che i passaggi tra le funzioni sono già limitatissimi nella realtà attuale. La vera posta in gioco, per Conte, è molto più ampia: "Ci vogliono far tornare indietro, all'Ancien Régime, quando c'era un monarca sovraordinato a tutti i cittadini e non sottoposto alla legge."

Elly Schlein: "Non migliora la giustizia mettendo i giudici sotto il governo"

La segretaria del Partito Democratico Elly Schlein ha costruito la sua campagna per il No su una doppia critica: questa riforma non risolve i veri problemi della giustizia italiana, e al tempo stesso indebolisce l'indipendenza della magistratura. "L'obiettivo del governo è spaccare il CSM in tre per indebolire l'indipendenza della magistratura", ha detto Schlein, che ha poi sottolineato come la separazione delle carriere avrebbe potuto essere realizzata, se davvero era l'obiettivo, con una semplice legge ordinaria e non con una modifica costituzionale.

Schlein ha anche attaccato la logica con cui il governo ha gestito la campagna referendaria, definendo inaccettabile che la presidente del Consiglio abbia evocato lo spettro di "stupratori liberi per strada" in caso di vittoria del No. "La giustizia non migliora assumendo l'organico che manca, non accelerando i processi, non stabilizzando i precari?" ha chiesto dal palco di Milano, dove ha chiuso la campagna il 20 marzo. La sua posizione è che questa riforma non risponda ai bisogni reali dei cittadini italiani che aspettano anni per una sentenza, e che concentri invece l'attenzione politica su un tema che interessa principalmente la politica stessa e non i cittadini.

Nicola Fratoianni: "Quando vuoi colpire l'indipendenza dei magistrati, non lo scrivi: lo fai"

Il leader di Sinistra Italiana e co-portavoce di Alleanza Verdi e Sinistra Nicola Fratoianni ha portato al dibattito una prospettiva costituzionale e storica. "Dicono che da nessuna parte è scritto che la magistratura non sarà più indipendente", ha osservato dal palco di piazza del Popolo. "Ma l'esempio dei regimi dimostra che quando vuoi colpire l'indipendenza della magistratura non lo scrivi, lo fai." È un argomento di metodo prima ancora che di merito: la forma tecnica di una riforma non ne garantisce le conseguenze politiche reali.

Fratoianni ha anche inquadrato il referendum in una cornice più ampia di attacchi istituzionali: "Questa vicenda è interamente politica. Questa controriforma rivela la natura politica dell'assalto alla Costituzione e alla magistratura da parte della destra. Anche se hai vinto le elezioni, anche se governi, devi avere qualche limite: ma a loro non va giù." Per Fratoianni, la posta in gioco non è la separazione tecnica delle carriere ma il tipo di democrazia che si vuole costruire: "Se ci fosse buona fede, il governo potrebbe intervenire subito su ciò che serve davvero: risorse, personale, digitalizzazione dei fascicoli, tempi più rapidi. I problemi della giustizia si risolvono così."

Angelo Bonelli: "Difendiamo la magistratura, presidio di democrazia contro mafia e corruzione"

Il co-portavoce di Europa Verde e deputato di Alleanza Verdi e Sinistra Angelo Bonelli ha collegato il No al referendum con la difesa più ampia dei valori costituzionali. "C'è un'inarrestabile avanzata dei No di fronte alle menzogne della destra, in primis della presidente Meloni. Gli italiani non sono stupidi", ha dichiarato a margine del comizio finale. La magistratura, per Bonelli, "è un presidio di democrazia", perché sono i giudici che hanno "lottato contro la mafia e contro la corruzione", spesso in solitudine e contro poteri fortissimi.

Bonelli ha poi parafrasato con ironia la famosa frase di Matteo Salvini ai tempi del Papeete: "Questa riforma concentra troppo potere e mette a rischio gli equilibri costituzionali. Il 22 e 23 marzo è fondamentale andare a votare No ai pieni poteri." Il riferimento ai "pieni poteri" è deliberato: Bonelli vede nel disegno riformatore un filo rosso che collega separazione delle carriere, premierato e altre riforme istituzionali in un progetto complessivo di concentrazione del potere nell'esecutivo. "Non dobbiamo consentire che la nostra Costituzione sia assoggettata a questa destra", ha concluso. Per Bonelli, il No al referendum è anche un No culturale e politico a una visione del potere che considera la separazione dei poteri un ostacolo piuttosto che una garanzia.

Il referendum del 22 e 23 marzo 2026 è l'appuntamento con una scelta che avrà conseguenze durature sull'architettura istituzionale della Repubblica. Cinque voci di sinistra, cinque ragioni distinte e complementari per il No: tecniche, costituzionali, storiche e politiche. La democrazia si difende prima di tutto nelle urne.

Di Alex (pubblicato @ 14:00:00 in Geopolitica e tecnologia, letto 337 volte)

Palantir Technologies e la rete di sorveglianza algoritmica globale: infrastruttura del potere invisibile

Palantir Technologies, fondata nel 2003 e finanziata dalla CIA, è al centro di un sistema di sorveglianza algoritmica globale. Dal contratto secretato con il Ministero della Difesa italiano alle kill chain a Gaza, dall'accordo con ICE-USA alla visita segreta di Peter Thiel a Roma nel marzo 2026: un'analisi approfondita.LEGGI TUTTO L'ARTICOLO

Chi è Palantir e le sue origini nell'intelligence americana

Palantir Technologies è una società statunitense specializzata nell'analisi predittiva e nell'integrazione di big data, fondata nel 2003 da Peter Thiel, Alex Karp, Stephen Cohen, Joe Lonsdale e Nathan Gettings. Fin dalla sua nascita è stata finanziata da In-Q-Tel, il braccio di venture capital della Central Intelligence Agency. Non si tratta di una semplice azienda di software: Palantir è il fornitore tecnologico privilegiato dell'intelligence americana, con contratti storici con CIA, FBI, NSA e le forze armate statunitensi per sistemi di antiterrorismo, analisi geospaziale e gestione operativa in Iraq e Afghanistan.

I due prodotti principali dell'azienda sono Gotham, dedicato alla difesa e all'intelligence governativa, e Foundry, orientato alle aziende private e alle pubbliche amministrazioni civili. Entrambi si basano sullo stesso principio: ingerire enormi quantità di dati destrutturati provenienti da fonti eterogenee — tabulati telefonici, transazioni bancarie, intercettazioni, post sui social media, dati biometrici, filmati di droni — e strutturarli in grafi relazionali che permettono di individuare pattern nascosti e costruire modelli predittivi.

L'ideologia di Peter Thiel: il "momento straussiano" contro la democrazia liberale

Per comprendere Palantir è necessario comprendere il suo principale artefice, Peter Thiel, fondatore di PayPal e primo grande investitore in Facebook. Thiel è il vertice di un pensiero politico neo-reazionario che coniuga libertarismo economico radicale con una marcata propensione all'autoritarismo tecnocratico. Nei suoi scritti, attinge al filosofo politico Leo Strauss per teorizzare che le democrazie liberali occidentali siano intrinsecamente deboli e incapaci di sopravvivere alle sfide del ventunesimo secolo, e che per garantire la sopravvivenza della civiltà occidentale sia necessario ricorrere a un potere occulto, a una "nobile menzogna" di matrice platonica.

Questo iper-individualismo elitario ha condotto Thiel a finanziare figure politiche e tecnologie che mirano a decostruire l'apparato statale convenzionale per sostituirlo con una tecnocrazia opaca guidata da logiche ingegneristiche. Il suo ruolo come "kingmaker" politico — evidenziato dal massiccio sostegno finanziario e intellettuale a Donald Trump e al vicepresidente JD Vance — dimostra l'esistenza di una strategia deliberata volta a piegare le istituzioni pubbliche alle logiche del tecno-capitalismo di sorveglianza. Come ha dichiarato il CEO di Palantir, Alex Karp, che pur definendosi "neo-marxista" condivide con Thiel l'ossessione per la supremazia occidentale, l'obiettivo è fornire alle potenze occidentali strumenti equivalenti a "armi di distruzione di massa digitali".

Il vertice romano del marzo 2026: conferenze segrete sull'Anticristo

La natura opaca dell'influenza di Peter Thiel ha trovato un'esplicita manifestazione in Italia nel marzo 2026. Tra il 15 e il 18 marzo, l'imprenditore si è recato a Roma per presiedere a quattro conferenze a porte chiuse focalizzate sull'"Anticristo biblico", organizzate dall'Associazione culturale Vincenzo Gioberti e riservate a opinion leader, prelati e figure del mondo cattolico e conservatore italiano. Tutti i presenti erano obbligati a sottoscrivere rigidi accordi di non divulgazione con sanzioni fino a 10.000 euro, a lasciare i dispositivi elettronici fuori dalla sala e a non fotografare né registrare. La location è rimasta segreta fino all'ultimo momento.

Discutere dell'Anticristo — come metafora del caos globale e della corruzione delle democrazie liberali — davanti a élite selezionate del paese ospitante serve a consolidare una narrazione di crisi imminente in cui la tecnologia di sorveglianza totale di Palantir viene presentata non come uno strumento di oppressione ma come l'unico scudo salvifico. La profonda segretezza dell'incontro ha innescato interrogazioni parlamentari da parte del PD (Peppe Provenzano e Andrea Casu) e del M5S (Antonio Caso), che hanno chiesto al governo Meloni di chiarire se vi fossero stati incontri istituzionali paralleli e nuovi accordi sui dati pubblici italiani.

Il contratto secretato con il Ministero della Difesa italiano

Un'inchiesta del quotidiano Domani ha svelato che la Direzione informatica, telematica e tecnologie avanzate del Ministero della Difesa italiano (Teledife), sotto la guida del ministro Guido Crosetto, ha indetto una "procedura negoziata" ed esplicitamente "secretata" per la "fornitura licenza Palantir Gotham", del valore iniziale di un milione di euro, inserita in un solco di procedure precedenti per "programmi Palantir" dal valore complessivo di svariati milioni. A operare sul territorio è la filiale nazionale Palantir Italia S.r.l., fondata nel 2012 come testa di ponte per i contratti con la pubblica amministrazione e il MEF.

Il fatto che un contratto di tale portata sia stato "secretato" e condotto tramite "procedura negoziata" — che spesso elude la pubblicazione di un bando di gara europeo — sottrae uno strumento che altera la natura stessa della sicurezza nazionale al controllo del Parlamento. L'installazione di Palantir Gotham nei server del Ministero della Difesa crea un inestricabile "vendor lock-in" tecnologico: una volta che il patrimonio informativo militare italiano viene mappato secondo l'ontologia proprietaria di Palantir, estrarne i dati o migrarli verso sistemi europei diventa un'impresa tecnicamente titanica ed economicamente proibitiva. Questo governo che ha fatto della "sovranità nazionale" il proprio vessillo finisce per affidare il cuore analitico della propria intelligence a una corporazione privata straniera con legami organici con l'intelligence di Washington.

La penetrazione economica: Bending Spoons, Serenis e il capital di rischio

L'infiltrazione del capitale vicino all'ecosistema di Thiel in Italia non si limita alle forniture militari. Essa opera attraverso fondi di venture capital internazionali, in primis Valar Ventures (di cui Thiel è il principale promotore), che finanziano l'innovazione tecnologica italiana. Bending Spoons, la startup milanese diventata uno dei maggiori sviluppatori di app al mondo, ha acquisito piattaforme di valore strategico per la raccolta dati: Evernote (appunti e strategie aziendali riservate di milioni di utenti), Meetup (mappatura delle reti di aggregazione civile), WeTransfer e Remini. L'acquisizione di Evernote in particolare rappresenta un trasferimento critico di sovranità sui dati personali: decenni di testi privati, documenti confidenziali e archivi di ricerca consegnati a un ecosistema finanziario contiguo a figure che teorizzano la sorveglianza di massa.

Parallelamente, investimenti incrociati con fondi vicini all'orbita Thiel si concentrano sul digital health: Serenis (psicoterapia online, ricavi a 25 milioni di euro) e Unobravo ottengono capitali da attori come Lumen Ventures e Bending Spoons. Queste piattaforme trattano i dati più sensibili in assoluto — profili psicologici, diagnosi psichiatriche, traumi, vulnerabilità emotive. La convergenza tra dati di produttività, geolocalizzazione e dati sanitari crea un "gemello digitale" del cittadino italiano che può essere analizzato, previsto e potenzialmente manipolato. L'accerchiamento è bidirezionale: Palantir opera nel B2G (dati statali), i fondi collegati nel B2C (dati dei consumatori), chiudendo in una morsa la profilazione olistica dell'individuo.

Il laboratorio americano: ICE, deportazioni e dati Medicaid

Per anticipare le conseguenze dell'adozione di Palantir in Italia è necessario analizzare il laboratorio americano. L'azienda ha costruito per l'Immigration and Customs Enforcement (ICE) interfacce software — tra cui "ELITE" — che si nutrono di dati provenienti da molteplici agenzie governative. L'indagine dell'Electronic Frontier Foundation ha dimostrato che l'ICE usa gli strumenti di Palantir per fare data mining sui registri del Department of Health and Human Services e sui dati Medicaid — il programma sanitario per i più poveri — per rintracciare, localizzare e deportare immigrati irregolari, compresi i minori non accompagnati e le loro famiglie ospitanti.

Questa architettura capovolge il patto tra individuo e istituzioni: chi si affida allo Stato per cure mediche viene trasformato in un target sul radar della polizia di frontiera. Nonostante le smentite dell'azienda — che si presenta come un "neutrale fornitore di software" — la realtà documentata dimostra che l'infrastruttura Palantir è il motore logistico delle politiche di deportazione di massa che hanno portato all'arresto di studenti stranieri senza prove e alla deportazione di migranti venezuelani verso mega-prigioni in El Salvador senza giusto processo. Più di 60 dipendenti stessi di Palantir hanno firmato petizioni interne chiedendo la fine dei contratti con l'ICE, mentre organizzazioni LGBTQ e conferenze universitarie di Berkeley hanno espulso l'azienda dalle proprie iniziative.

Il fronte di Gaza: le kill chain algoritmiche e la guerra industrializzata

Il culmine dell'opacità etica di Palantir si manifesta nell'arena militare. Inchieste della rivista The Nation e di altre testate internazionali hanno rivelato il ruolo chiave di Palantir nel fornire alle Forze di Difesa Israeliane sistemi di puntamento militare guidati da algoritmi di intelligenza artificiale. Il CEO Alex Karp si è dichiarato "estremamente orgoglioso" di questo lavoro "operativamente cruciale", e di fronte alle accuse di complicità nelle uccisioni di civili palestinesi ha risposto che le vittime sono "per lo più terroristi".

I sistemi ISTAR forniti — Intelligence, Surveillance, Target Acquisition, Reconnaissance — non si limitano a mappe per i generali: automatizzano la generazione di liste di bersagli umani ingerendo messaggi intercettati, tracce GPS, reti familiari, riprese di droni e metriche dei social network. L'implementazione in scenari di guerra urbana ad alta densità abitativa solleva tre problemi fondamentali: il problema della "scatola nera" (i bias algoritmici nascosti che portano all'identificazione errata di civili), l'abolizione della responsabilità umana nella catena di comando, e la scala industriale della distruzione che, come ha ammesso Karp, rende questi sistemi equivalenti a "armi nucleari tattiche contro un avversario convenzionale". Il fondo patrimoniale norvegese Storebrand ha disinvestito 24 milioni di dollari di azioni Palantir nell'ottobre 2024, citando il rischio di essere complice di crimini di guerra.

Il fallimento delle infrastrutture pubbliche come cavallo di Troia

La narrativa tecno-capitalista secondo cui Palantir è indispensabile trova terreno fertile nelle disfunzioni documentate dello Stato italiano. Le inchieste data-driven di Milena Gabanelli su Dataroom del Corriere della Sera rivelano un sistema pubblico che collassa: attese fino a 490 giorni per interventi ortopedici in Lombardia, con i cittadini costretti a migrare verso il privato mentre fondi pubblici finanziano ospedali accreditati che spostano i medici verso l'intramoenia. Sul fronte della giustizia, il processo penale telematico introdotto in 87 procure dal gennaio 2024 senza completare le fasi di sperimentazione ha prodotto un collasso tecnico che obbliga cancellieri e magistrati al "doppio binario" carta-digitale, raddoppiando i tempi burocratici invece di dimezzarli.

Questo scenario di devastazione amministrativa giustifica politicamente e mediaticamente l'introduzione di "soluzioni magiche" basate sull'IA. Palantir si propone sistematicamente ai governi in crisi come "salvatore" tecnologico, l'unico capace di far dialogare banche dati incompatibili — come nel contratto da 240 milioni di sterline senza gara pubblica ottenuto dal Ministero della Difesa britannico, in coincidenza con l'assunzione di quattro ex alti funzionari del ministero stesso tramite il meccanismo delle "porte girevoli". Il prezzo è la cessione del controllo sui codici sorgente algoritmici e, di fatto, la custodia dei dati investigativi e processuali più delicati all'estero.

La sfida posta dal complesso Palantir è la sfida definitiva per la libertà umana nel ventunesimo secolo: non è combattuta con le armi ma con i dati, non è dichiarata ma silenziosa, non ha un volto ma un algoritmo. E quando un algoritmo decide chi curare, chi sorvegliare, chi deportare, chi eliminare, il passo dalla democrazia alla necropolitica automatizzata è drammaticamente, spaventosamente breve.

La giornalista Milena Gabanelli parla di Palantir!

Di Alex (pubblicato @ 13:00:00 in Storia Grecia Antica, letto 281 volte)

Le colonne del Tempio di Zeus ad Olimpia nel sito panellenico del Peloponneso

Olimpia, nella pianura dell'Elide nel Peloponneso occidentale, è la culla dei Giochi Olimpici fondati nel 776 avanti Cristo. Il suo complesso sacro ospitava il Tempio di Zeus con la colossale statua crisoelefantina, lo stadio, il ginnasio e l'altis, bosco sacro al padre degli dei.LEGGI TUTTO L'ARTICOLO

Olimpia: geografia e storia del sito sacro

Olimpia sorge nella pianura dell'Elide, nella parte nord-occidentale del Peloponneso greco, alla confluenza dei fiumi Alfeo e Kladeo, in un paesaggio di dolci colline boscose che ha conservato per millenni un carattere di quiete rurale particolarmente adatto a un luogo di sosta, preghiera e raduno. Non era una città nel senso convenzionale del termine — non aveva mura, non era sede di un governo politico — ma era qualcosa di più: un santuario panellenico, un luogo sacro riconosciuto da tutti i Greci come territorio di Zeus, in cui la rivalità delle poleis cedeva temporaneamente il posto alla koiné, alla condivisione di una cultura comune.

Le prime testimonianze di attività sacrale ad Olimpia risalgono al III millennio avanti Cristo, con prove di offerte votive e strutture cultuali primitive nella zona dell'altis — il bosco sacro che costituisce il nucleo del santuario. I Giochi Olimpici nella loro forma ufficiale e competitiva iniziarono, secondo la tradizione greca codificata dagli antichi storiografi, nel 776 avanti Cristo — una data considerata il punto di partenza del sistema greco di computo del tempo per Olimpiadi, ovvero periodi di quattro anni. Per dodici secoli consecutivi, fino al 393 dopo Cristo quando l'imperatore Teodosio I vietò i Giochi in quanto manifestazione pagana, Olimpia fu il centro del mondo agonistico greco.

Il Tempio di Zeus: una delle sette meraviglie del mondo antico

Il monumento principale del complesso panellenico di Olimpia era il Tempio di Zeus, costruito tra il 470 e il 456 avanti Cristo secondo i canoni del dorico maturo. La struttura era di proporzioni imponenti: 64 metri di lunghezza, 28 metri di larghezza, con colonne peristili alte quasi 11 metri in marmo di Doliana. Il tempio ospitava, nella cella centrale, una delle opere d'arte più celebrate del mondo antico: la statua crisoelefantina di Zeus, opera dello scultore Fidia — lo stesso che aveva creato l'Atena Parthenos all'Acropoli di Atene — realizzata in avorio e oro su un'anima di legno, alta circa 12 metri e considerata dagli antichi una delle sette meraviglie del mondo.

La statua raffigurava Zeus seduto in trono, con in mano uno scettro sormontato da un'aquila e una Nike alata sull'altra. I fregi del tempio — oggi in parte conservati al Museo Archeologico di Olimpia — narravano le fatiche di Eracle e la leggendaria gara di bighe tra Pelope e Oinomao. Le sculture dei frontoni, in particolare il frontone occidentale con la Centauromachia, sono considerate capolavori assoluti della scultura greca classica. Il terremoto del V o VI secolo dopo Cristo distrusse gran parte del tempio, ma i fusti di molte colonne sono ancora visibili sul suolo del sito, abbattuti in file ordinate dall'impatto sismico.

Lo stadio e il ginnasio: gli spazi dell'agonismo greco

Accanto al complesso templare, Olimpia ospitava le strutture fisiche dedicate alle competizioni. Lo stadio, costruito a est dell'altis nella sua versione definitiva nel V secolo avanti Cristo, poteva ospitare circa 45.000 spettatori disposti sulle pendenze dei terrapieni laterali — non esistevano gradinate di pietra come nei teatri — e misurava 192 metri di lunghezza, lunghezza standard dello stadio greco (equivalente a circa 600 piedi greci, lo stadion, da cui deriva il termine). La pista, ancora perfettamente identificabile dagli scavi, recava alle estremità le lastre di pietra delle linee di partenza e di arrivo con gli alloggiamenti per i piedi degli atleti.

Il ginnasio e la palestra erano le strutture dove gli atleti si allenavano durante il periodo di preparazione obbligatoria di un mese che precedeva i Giochi. Il ginnasio era una vasta area colonnata dove si praticava la corsa, mentre la palestra era destinata alla lotta e al pancrazio — la forma più dura di combattimento greco, che ammetteva quasi tutte le prese e i colpi eccetto mordersi e strappare gli occhi. Gli atleti si allenavano nudi, cosparsi di olio e polvere, sotto la supervisione degli allenatori e degli arbitri degli Elei, la popolazione locale incaricata di organizzare i Giochi.

Le discipline olimpiche e la tregua sacra

I Giochi Olimpici dell'antichità erano profondamente diversi dalle competizioni moderne: non esistevano medaglie, non si teneva il conto delle nazioni, e i vincitori ricevevano solo una corona di rami d'ulivo selvatico — simbolo di purezza e dedizione agli dei — accompagnata da gloria imperittura nelle loro città di origine. Le discipline comprendevano la corsa del singolo stadio, la corsa di due stadi (diaulos), la corsa lunga (dolichos), il pentathlon (salto, lancio del disco, lancio del giavellotto, corsa e lotta), la lotta, il pugilato, il pancrazio, la corsa con le armi e le gare equestri con bighe e quadrighe.

Per tutta la durata dei Giochi — circa cinque giorni — una tregua sacra (ekecheiria) interrompeva tutti i conflitti armati tra le città greche, garantendo la sicurezza dei viaggiatori e degli atleti che convergevano da tutto il mondo ellenico verso l'Elide. La tregua non era un trattato di pace: era un impegno religioso ratificato da tutti i rappresentanti delle poleis greche, la cui violazione comportava pesanti sanzioni economiche e religiose. Essa rappresenta forse l'idea più radicale prodotta dalla civiltà greca: la guerra può essere fermata, se c'è qualcosa che vale abbastanza.

Il sito oggi: museo, scavi e turismo culturale

Il sito archeologico di Olimpia è patrimonio mondiale dell'UNESCO dal 1989 e costituisce una delle mete del turismo culturale più visitate della Grecia, con oltre 700.000 visitatori l'anno. Gli scavi sistematici, avviati dalla Società Archeologica di Berlino nel 1875 e proseguiti dall'Istituto Archeologico Tedesco (DAI) fino ad oggi, hanno riportato alla luce la quasi totalità del complesso monumentale. Il Museo Archeologico di Olimpia, uno dei più ricchi della Grecia, conserva le sculture dei frontoni del Tempio di Zeus, l'Ermes di Prassitele in marmo, bronzi votivi, terrecotte e migliaia di oggetti che documentano dodici secoli di vita religiosa e sportiva nel santuario.

Ogni quattro anni, la fiamma olimpica viene accesa nel sito usando uno specchio ustorio che concentra i raggi del sole sull'altare di Era, riprendendo il rito di accensione dell'antichità e inaugurando il percorso della torcia olimpica verso la città ospite dei Giochi. In questo gesto di continuità simbolica, Olimpia continua a essere, dopo tremila anni, il luogo da cui il mondo riconosce il valore dell'agonismo pacifico tra i popoli.

Olimpia è il luogo dove i Greci inventarono qualcosa che nessuna civiltà prima di loro aveva immaginato: fermare la guerra per giocare. Non per paura, ma per scelta. E quella scelta, ripetuta per dodici secoli, è diventata un'idea abbastanza potente da attraversare il tempo e ricominciare.

Di Alex (pubblicato @ 12:00:00 in Sviluppo sostenibile, letto 825 volte)

Un veicolo autonomo senza conducente in una città del futuro con parcheggi trasformati in parchi verdi

Nel 2026 i veicoli senza conducente operano già 24 ore su 24 in molte città americane e cinesi. La loro espansione consente di ridurre le auto private, trasformare i parcheggi in parchi verdi e decentralizzare le metropoli attraverso trasporti fluidi e accessibili. Una rivoluzione silenziosa dello spazio urbano.LEGGI TUTTO L'ARTICOLO

Lo stato del 2026: dove operano già i robotaxi

Nel 2026, la guida autonoma di livello 4 — quella in cui il veicolo gestisce tutte le situazioni senza intervento umano all'interno di un perimetro geografico definito — è una realtà commerciale in espansione in oltre una decina di metropoli americane e cinesi. Waymo, la divisione di Alphabet nata da Google, opera robotaxi 24 ore su 24 a San Francisco, Los Angeles, Phoenix e Austin, con un parco veicoli che supera i 700 unità e oltre 150.000 passeggeri trasportati ogni settimana senza un conducente umano a bordo. In Cina, Baidu Apollo Go gestisce servizi commerciali a Wuhan, Chongqing, Shenzhen e Pechino con flotte di centinaia di veicoli, beneficiando di normative più permissive che hanno accelerato la commercializzazione rispetto all'Occidente.

La diffusione dei veicoli autonomi ha superato la fase sperimentale per diventare un servizio di mobilità alternativo al taxi tradizionale in queste città, con costi per chilometro competitivi e, in alcuni casi, inferiori alle piattaforme con conducente. I dati sulla sicurezza, pur con le cautele necessarie, mostrano tassi di incidenti per chilometro percorso inferiori alla media dei veicoli guidati da umani nelle stesse aree operative, un risultato che ha accelerato l'approvazione normativa in diversi stati americani e in tre province cinesi.

Il parcheggio come problema urbanistico: i numeri del cambiamento

Per capire perché la mobilità autonoma sia rilevante non solo come tecnologia ma come fenomeno urbanistico, è necessario partire da un dato spesso sottovalutato: nelle città americane, tra il 30% e il 50% della superficie urbana è dedicata a strade, parcheggi e infrastrutture per le automobili. A Los Angeles, studi urbanistici stimano che ci siano più di 18 milioni di posti auto per circa 10 milioni di abitanti — quasi due parcheggi per persona. In Europa le percentuali sono inferiori ma comunque significative: nelle grandi città italiane, Istat stima che i parcheggi occupino tra il 10% e il 15% della superficie edificata.

Un veicolo autonomo a servizio condiviso (robotaxi) è in movimento la maggior parte del giorno invece di stare parcheggiato, come accade per le auto private che in media rimangono ferme il 95% del tempo. Se una singola flotta di robotaxi può sostituire dieci o quindici auto private — come suggeriscono i modelli di simulazione dei ricercatori di MIT e ETH Zurich — la riduzione del numero di veicoli in circolazione libererebbe enormi quantità di spazio urbano attualmente destinato alla sosta. I parcheggi sotterranei potrebbero essere convertiti in depositi logistici, spazi culturali o abitazioni; quelli di superficie in parchi, orti urbani, piazze e zone pedonali.

Urban design e mobilità: le città che si stanno già trasformando

Alcune città stanno già anticipando questo cambiamento senza aspettare che la guida autonoma raggiunga la massa critica. Oslo ha convertito quasi tutti i parcheggi del suo centro storico in spazi ciclabili e pedonali. Helsinki ha approvato un piano decennale per la riduzione progressiva dei parcheggi di superficie nell'anello interno. A Barcellona, il piano delle "Superilles" (superblocchi) trasforma intere griglie stradali in aree quasi pedonali, riservando la circolazione motorizzata ai soli perimetri dei blocchi. Queste trasformazioni sono avvenute prima dell'arrivo dei veicoli autonomi ma prefigurano esattamente il tipo di città che la guida autonoma potrebbe rendere più facilmente realizzabile su scala globale.

Negli Stati Uniti, San Francisco ha eliminato centinaia di parcheggi di superficie in zone ad alta densità pedonale, favorendo la diffusione proprio dei robotaxi Waymo come alternativa pratica per chi rinuncia all'auto privata. La correlazione non è ancora causale — la trasformazione urbana e l'adozione dei veicoli autonomi si alimentano reciprocamente — ma gli urbanisti vedono nei due fenomeni una sinergia strutturale che potrebbe trasformare radicalmente la morfologia delle città nei prossimi vent'anni.

Decentralizzazione urbana: il trasporto autonomo come motore di equità

Uno degli effetti meno discussi ma più potenzialmente significativi della mobilità autonoma riguarda la decentralizzazione urbana e la riduzione delle disuguaglianze spaziali. Le periferie sono oggi svantaggiate rispetto ai centri per ragioni di accessibilità: i trasporti pubblici sono meno frequenti, le connessioni più lente, il car sharing convenzionale meno redditizio da operare. I veicoli autonomi, operando in modo economicamente efficiente anche in aree a bassa densità perché non hanno costi di salario per il conducente, potrebbero rendere redditizio offrire servizi di mobilità nei quartieri periferici dove un taxi tradizionale non è economicamente sostenibile.

Modelli di simulazione elaborati dalle università di MIT e di Berkeley mostrano che una flotta di robotaxi accessibile a tutti i ceti sociali potrebbe ridurre significativamente il cosiddetto "transport poverty" — la povertà di mobilità che colpisce chi non possiede un'auto e vive lontano dai servizi. Anziani, persone con disabilità, abitanti di aree rurali e giovani senza patente sarebbero i principali beneficiari di un sistema di trasporto autonomo davvero accessibile. Se il costo per chilometro continuerà a scendere — da circa 2 dollari attuali verso gli 0,50 dollari previsti entro il 2030 — il robotaxi potrebbe diventare più conveniente del possesso di un'auto privata per la grande maggioranza degli utenti urbani.

Le sfide: regolamentazione, cybersicurezza e impatto sul lavoro

La transizione verso la mobilità autonoma non è priva di ostacoli. Il primo è normativo: in Europa, il quadro regolatorio per i veicoli di livello 4 è ancora in fase di costruzione, con la Commissione Europea impegnata a definire gli standard di responsabilità civile, i requisiti di certificazione e i criteri di accesso alle infrastrutture stradali. L'Italia ha approvato nel 2025 una legge sperimentale che consente test su percorsi chiusi, ma i servizi commerciali aperti al pubblico sono ancora lontani.

Il secondo tema critico è quello dell'impatto occupazionale: in Italia ci sono circa 150.000 autisti di taxi e NCC e circa 450.000 autisti di mezzi commerciali leggeri. La transizione verso la guida autonoma potrebbe colpire duramente queste categorie in archi temporali relativamente brevi, richiedendo politiche di riqualificazione professionale che le istituzioni stanno ancora faticando a progettare in modo concreto. La mobilità autonoma promette un futuro urbano più verde e più equo, ma solo se la transizione sarà gestita con attenzione alle sue conseguenze sociali.

I veicoli autonomi non sono solo una tecnologia: sono un reagente urbanistico che potrebbe ridisegnare la città del ventunesimo secolo, liberando spazio, tempo e risorse per un modo di abitare gli spazi comuni che l'automobile ha sottratto per un secolo. La domanda non è se succederà, ma se sapremo guidare il cambiamento prima che sia il cambiamento a guidare noi.

Di Alex (pubblicato @ 11:00:00 in Nuovi materiali, letto 278 volte)

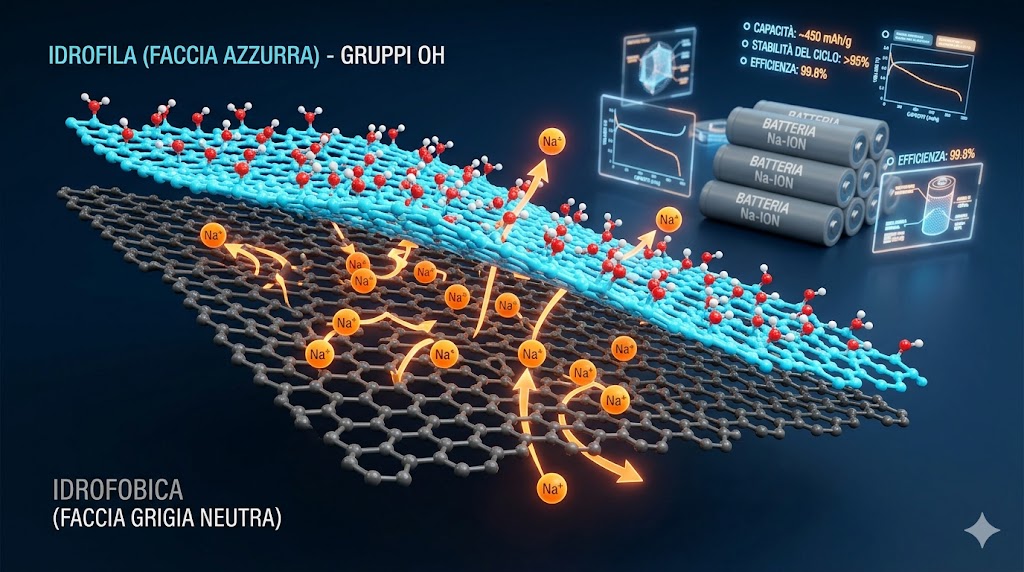

Struttura del grafene Janus con due facce chimicamente differenti per batterie agli ioni di sodio

Il grafene "Janus", con due facce chimicamente differenti, permette alle batterie agli ioni di sodio di eguagliare la densità energetica delle odierne batterie al litio. Poiché il sodio è abbondante e conveniente, questa tecnologia potrebbe rendere i veicoli elettrici e lo storage energetico molto più sostenibili ed economici.LEGGI TUTTO L'ARTICOLO

Il limite delle batterie al litio: perché il sodio è una risposta

Le batterie agli ioni di litio sono il cuore dell'attuale rivoluzione dei veicoli elettrici e dello storage energetico stazionario. Ma il litio ha un problema strutturale: è un elemento relativamente raro, geograficamente concentrato in poche regioni del mondo (principalmente il "triangolo del litio" tra Argentina, Cile e Bolivia, più l'Australia) e la cui domanda crescente sta creando pressioni geopolitiche ed economiche significative. Secondo le stime dell'International Energy Agency, la domanda mondiale di litio potrebbe aumentare di quaranta volte entro il 2040 rispetto ai livelli attuali, rendendo critica la questione della disponibilità e del costo della materia prima.

Il sodio è la risposta ovvia a questa dipendenza: è il sesto elemento più abbondante nella crosta terrestre, si trova in quantità praticamente illimitate nell'acqua di mare e nel sale comune, e il suo prezzo di mercato è circa cento volte inferiore a quello del litio. Le batterie agli ioni di sodio (Na-ion) sono concettualmente identiche a quelle al litio — un catodo, un anodo e un elettrolita attraverso cui gli ioni migrano durante la carica e la scarica — ma hanno sempre sofferto di un limite fondamentale: la capacità energetica per unità di peso (densità energetica) significativamente inferiore a quella delle controparti al litio, a causa della massa atomica maggiore e del raggio ionico più grande del sodio.

Il grafene Janus: la struttura biface che risolve il problema

Il grafene "Janus" — il nome richiama il dio romano bifronte, patrono dei passaggi e delle soglie — è una variante del grafene monostrato in cui le due facce del foglio atomico presentano funzionalizzazioni chimiche differenti: una faccia è decorata con gruppi idrofili come idrossili e carbossili (tipici dell'ossido di grafene), mentre l'altra faccia presenta gruppi idrofobici o è lasciata chimicamente inerte come il grafene puro. Questa asimmetria chimica è ottenuta attraverso processi di funzionalizzazione selettiva monolaterale sviluppati in laboratorio a partire dal 2020, usando plasmi chimici e reazioni di superficie controllate.

Questa struttura biface conferisce al materiale proprietà straordinariamente utili per l'anodo delle batterie agli ioni di sodio. La faccia idrofila interagisce con gli ioni Na+ facilitandone l'inserimento e la migrazione nello strato di grafene, mentre la faccia idrofobica ottimizza le proprietà di conducibilità elettronica e riduce le reazioni parassite con l'elettrolita. Il risultato complessivo è un anodo capace di intercalare gli ioni di sodio con un'efficienza e una velocità simili a quelle della grafite per il litio, colmando il divario di prestazioni che aveva finora limitato le batterie Na-ion rispetto alle loro concorrenti.

I risultati sperimentali: densità energetica e cicli di carica

I risultati sperimentali ottenuti con anodi in grafene Janus nelle batterie Na-ion sono stati riportati in pubblicazioni su Nature Energy e Advanced Materials nel corso del 2025-2026, e mostrano progressi significativi su tutti i parametri chiave. La capacità specifica dell'anodo raggiunge valori tra 280 e 320 milliamperora per grammo — comparabili ai migliori anodi di grafite per litio (372 milliamperora per grammo) e superiori di tre volte agli anodi in carbonio duro convenzionalmente usati nelle Na-ion battery. La densità energetica a livello di cella completa si avvicina ai 250-280 Wh/kg, eguagliando i valori tipici delle batterie LFP (litio-ferro-fosfato) attualmente usate nei veicoli elettrici entry-level e nello storage residenziale.

Altrettanto promettenti sono i dati sulla ciclabilità: le celle con anodi in grafene Janus mostrano una capacità residua superiore all'85% dopo 1.000 cicli di carica-scarica completa, un valore che si avvicina ai requisiti dei costruttori automobilistici per l'utilizzo in veicoli elettrici. La velocità di carica è un altro punto di forza: la struttura biface del grafene Janus permette una diffusione più rapida degli ioni di sodio rispetto al carbonio duro, consentendo tempi di ricarica parziale (da 20% a 80%) inferiori ai 30 minuti — compatibili con le infrastrutture di ricarica rapida esistenti.

Impatto per i veicoli elettrici: costo e catena di fornitura

L'impatto potenziale della tecnologia grafene Janus Na-ion sui veicoli elettrici è principalmente economico. Una batteria Na-ion con prestazioni equivalenti a una batteria LFP costerà significativamente meno, per la ragione semplice che il sodio vale circa un cinquantesimo del litio e la sua catena di fornitura non è concentrata geograficamente come quella del litio. Analisti del settore come Wood Mackenzie e BloombergNEF stimano che le batterie Na-ion mature potrebbero costare il 20-30% in meno rispetto alle LFP, portando il costo del kWh di storage su veicolo sotto la soglia di 50 dollari — il livello al di sotto del quale i veicoli elettrici diventano intrinsecamente più economici di quelli a combustione interna anche senza incentivi pubblici.

Produttori cinesi come CATL e BYD hanno già avviato linee di produzione di batterie Na-ion di prima generazione, principalmente per i veicoli economici del mercato cinese. La sfida è ora portare il grafene Janus dalla sintesi in laboratorio alla produzione industriale in quantità sufficienti: il processo di funzionalizzazione biface richiede ancora condizioni di processo controllate che ne aumentano il costo rispetto al carbonio duro convenzionale. I ricercatori di Graphene Flagship e i gruppi di ricerca di MIT, ETH Zurich e l'Università di Pechino stanno lavorando in parallelo su processi di sintesi continua in flusso che potrebbero ridurre significativamente i costi di produzione entro il 2028-2030.

Storage energetico stazionario: la grande opportunità del sodio

Accanto all'applicazione nei veicoli elettrici, le batterie Na-ion con anodi in grafene Janus trovano un'applicazione particolarmente promettente nello storage energetico stazionario — il mercato delle batterie installate negli edifici e nelle grandi centrali di accumulo che stoccano l'energia prodotta da fonti rinnovabili intermittenti come il solare e l'eolico. In questo segmento, il peso specifico della batteria è meno critico rispetto ai veicoli, mentre il costo per kWh e la durabilità (numero di cicli utili) sono i parametri dominanti.

Le batterie Na-ion con grafene Janus si prestano particolarmente bene per lo storage di rete (grid-scale storage), dove possono operare in un range di temperatura più ampio rispetto alle Li-ion (-40 gradi Celsius fino a +60 gradi Celsius senza degradazione significativa) e con cicli di vita potenzialmente superiori ai 3.000 cicli. Questo le rende candidate ideali per le installazioni nei paesi con climi estremi e per lo storage a lungo termine che richiede centinaia di cicli l'anno per decenni. In Italia, il Piano Nazionale per la Transizione Energetica prevede l'installazione di oltre 30 GWh di capacità di storage nei prossimi dieci anni: se le batterie Na-ion mature arriveranno sul mercato nei tempi previsti, potrebbero catturare una quota significativa di questa domanda.

Il grafene Janus e le batterie agli ioni di sodio sono la dimostrazione che le rivoluzioni tecnologiche a volte non richiedono nuovi elementi: richiedono nuovi modi di usare quelli che abbiamo sempre avuto. Il sodio è nell'acqua del mare, nella cucina di casa, nell'aria che respiriamo. Usarlo per guidare le auto del futuro è quasi poetico nella sua semplicità.

Di Alex (pubblicato @ 10:00:00 in Geopolitica e tecnologia, letto 317 volte)

Lo stretto di Ormuz tra Iran e Arabia Saudita, arteria petrolifera mondiale al centro delle tensioni

L'ipotesi di una missione navale europea nello stretto di Ormuz, in risposta alle tensioni con l'Iran, divide profondamente Spagna, Italia, Francia, Germania e Gran Bretagna. I rischi reali sono enormi: escalation militare, chiusura dello stretto e crisi energetica globale. Il Papa Leone XIV chiede la pace.LEGGI TUTTO L'ARTICOLO

Lo stretto di Ormuz: la gola del mondo

Lo stretto di Ormuz è il passaggio marittimo più strategicamente critico del pianeta: largo appena 39 chilometri nel punto più stretto, tra le coste dell'Iran e dell'Oman, attraverso di esso transita ogni giorno circa il 21% del petrolio mondiale — oltre 17 milioni di barili al giorno — oltre a enormi quantità di gas naturale liquefatto provenienti dal Qatar e dall'Arabia Saudita. Qualsiasi interruzione del traffico nello stretto, anche temporanea, provocherebbe un'impennata immediata dei prezzi dell'energia sui mercati globali e una crisi economica di dimensioni potenzialmente catastrofiche per le economie importatrici di petrolio, prima tra tutte l'Europa.

L'Iran ha minacciato più volte, nel corso degli anni e con maggiore frequenza nell'escalation del 2025-2026, di "chiudere lo stretto di Ormuz" in risposta a sanzioni economiche o ad azioni militari dirette contro il suo territorio. Non si tratta di vuote minacce: la Guardia Rivoluzionaria Islamica dispone di flotte di motovedette veloci, missili antinave, mine navali e sottomarini di piccola taglia specificamente addestrati per operazioni asimmetriche nello stretto. La chiusura non richiederebbe una vittoria militare; basterebbe creare condizioni di insicurezza tali da rendere il passaggio troppo rischioso per le petroliere commerciali.

Le posizioni dei cinque paesi europei: un fronte tutt'altro che compatto

L'ipotesi di una missione navale europea nello stretto di Ormuz divide profondamente i cinque maggiori paesi dell'Unione Europea e del continente. La Francia, con la sua tradizione di potenza militare autonoma e il suo interesse a proiettare forza in Medio Oriente, è la più aperta all'opzione militare: Parigi ha già esperienza di missioni navali nel Golfo Persico e considera la sicurezza degli approvvigionamenti energetici un interesse nazionale di primario rilievo.

La Germania è invece profondamente riluttante: l'esperienza delle guerre in Afghanistan e Iraq ha consolidato nell'opinione pubblica tedesca un riflesso di avversione alla proiezione militare internazionale, e il Bundestag ha già dovuto superare aspre resistenze interne per approvare le missioni navali nel Mar Rosso. La Spagna, con una tradizione di politica estera più orientata al Mediterraneo e all'America Latina, è anch'essa contraria all'escalation. L'Italia si trova in una posizione intermedia: tradizionalmente favorevole alla cooperazione atlantica ma consapevole della propria dipendenza dal gas del Golfo, il governo Meloni deve bilanciare lealtà atlantiste e interessi energetici. Il Regno Unito, ormai fuori dall'UE ma parte della NATO, ha già schierato navi nel Golfo Persico in missione di scorta alle petroliere britanniche.

I pericoli reali: dall'escalation alla crisi energetica

Gli esperti di sicurezza internazionale identificano tre scenari di rischio principali nel caso di una presenza navale europea nello stretto di Ormuz. Il primo è l'escalation per incidente: nello spazio ristretto dello stretto, dove le motovedette della Guardia Rivoluzionaria operano a pochi chilometri dalle navi militari straniere, un incidente navale — un'avvicinamento eccessivo, un'avaria, uno scambio di colpi d'artiglieria per fraintendimento — potrebbe innescare una risposta militare iraniana che le navi europee non sarebbero in grado di ignorare.

Il secondo rischio è la chiusura economica dello stretto: di fronte a una presenza navale europea percepita come ostile, l'Iran potrebbe decidere di minare le acque dello stretto o di attaccare le petroliere, non necessariamente quelle militari. Le conseguenze sarebbero devastanti per i prezzi energetici europei, già sotto pressione per le conseguenze delle sanzioni e delle tensioni geopolitiche. Il terzo scenario riguarda il trascinamento dell'Europa in un conflitto più ampio: qualsiasi azione militare iraniana contro navi europee attiverebbe automaticamente gli obblighi dell'articolo 5 della NATO, trascinando l'Europa in un conflitto con l'Iran che nessun governo europeo desidera e per cui l'opinione pubblica non sarebbe preparata.

L'appello di Papa Leone XIV: "La pace non è debolezza"

Una voce potente e inattesa si è alzata dal Vaticano contro la logica della presenza militare nello stretto di Ormuz. Papa Leone XIV, eletto nel 2025 come successore di Francesco, ha dedicato la sua udienza del mercoledì di questa settimana a un appello accorato alla pace nel Golfo Persico, riprendendo e approfondendo la tradizione diplomatica della Santa Sede in Medio Oriente. "La pace non è debolezza: è l'atto di coraggio più difficile che gli uomini di governo siano chiamati a compiere", ha detto il pontefice, parlando davanti a decine di migliaia di fedeli in piazza San Pietro.

Leone XIV ha invitato i leader europei a non cedere alla "logica delle cannoniere" — richiamando il concetto storico della diplomazia coercitiva ottocentesca — e a privilegiare invece il dialogo diplomatico multilaterale. Il Papa ha fatto appello anche alle autorità iraniane affinché "rinuncino alla retorica della minaccia" e si aprano a negoziati che coinvolgano le Nazioni Unite e le potenze regionali. Il Vaticano, che mantiene relazioni diplomatiche con l'Iran e ha canali di comunicazione con la dirigenza religiosa sciita, potrebbe svolgere un ruolo di mediazione discreta che le potenze occidentali non sono in grado di assumere direttamente.

La voce del pacifismo europeo: l'alternativa alla deterrenza militare

Accanto all'appello del Papa, numerosi movimenti pacifisti europei e personalità del mondo culturale e accademico hanno firmato un appello comune contro la militarizzazione dello stretto di Ormuz. Il documento, promosso dal Centro per la Pace e i Diritti Umani dell'Università di Utrecht e firmato da oltre 400 accademici, diplomatici ed ex ministri europei, propone come alternativa alla deterrenza militare un "accordo energetico di sicurezza collettiva" in cui le potenze europee si impegnino formalmente a non partecipare a sanzioni unilaterali contro l'Iran in cambio di garanzie iraniane sulla sicurezza del traffico nello stretto.

L'argomento centrale dell'appello è che la presenza militare europea nello stretto di Ormuz non garantirebbe la sicurezza degli approvvigionamenti energetici — perché un conflitto aperto renderebbe lo stretto inaccessibile comunque — ma aumenterebbe le probabilità di un conflitto che l'Europa sarebbe chiamata a sostenere senza averlo scelto democraticamente. "Le basi americane nel territorio europeo ci espongono automaticamente alle conseguenze di ogni escalation americana in Medio Oriente, senza che i nostri parlamenti abbiano mai votato su questo", scrive il documento, riecheggiando temi simili a quelli sollevati da voci critiche sulla presenza militare americana in Europa.

Lo stretto di Ormuz è stretto non solo geograficamente: è il collo di bottiglia attraverso cui scorrono petrolio, ambizioni geopolitiche e tensioni che potrebbero trasformarsi in catastrofe in qualsiasi momento. La domanda per l'Europa non è se può permettersi di essere presente militarmente: è se può permettersi il lusso di un conflitto che nessuno ha scelto e che tutti rischiano di non riuscire a fermare.

La giornalista Milena Gabanelli ha ragione!

Di Alex (pubblicato @ 09:00:00 in Storia Medioevo, letto 281 volte)

Il Castello Orsini-Odescalchi di Bracciano con le torri cilindriche sul lago

Il Castello Orsini-Odescalchi di Bracciano, eretto tra il XIII e il XV secolo, è una delle più straordinarie sintesi italiane tra fortezza militare e dimora signorile. Le sue torri cilindriche colossali controllavano il lago e le vie per Roma. Oggi è tra i castelli medievali meglio conservati del Lazio.LEGGI TUTTO L'ARTICOLO

Bracciano e il suo lago: una posizione strategica millenaria

Il castello sorge sul bordo del cratere vulcanico che ospita il Lago di Bracciano, a circa 35 chilometri a nord-ovest di Roma. La posizione è di eccezionale valore strategico: il lago, il secondo d'Italia per profondità, era non solo una risorsa alimentare e idrica di prim'ordine ma anche un punto di controllo sulle vie di comunicazione che collegavano Roma all'Etruria e al Lazio settentrionale. Chiunque controllasse Bracciano controllava i traffici tra Roma e il mare Tirreno lungo la Via Claudia e le direttrici verso Sutri, Viterbo e la Tuscia.

La storia insediativa del sito è antica: i resti di una città etrusca sono stati ritrovati nelle immediate vicinanze, e la zona fu sede di una mansio romana lungo la Via Claudia. Ma è nel Medioevo che Bracciano acquista la sua fisionomia definitiva: il borgo medievale si stringe intorno al castello come a una rocca naturale, e il castello stesso diventa il nucleo di un sistema difensivo che controlla l'accesso al lago da ogni direzione.

Gli Orsini e la costruzione del castello: XIII-XV secolo

Il castello di Bracciano fu costruito e sviluppato dalla potente famiglia Orsini, una delle grandi casate nobiliari romane che per secoli disputò con i Colonna il controllo del Lazio. La struttura originaria risale probabilmente al XIII secolo, ma fu nel corso del Quattrocento, sotto Napoleone Orsini e poi sotto il figlio Gentil Virginio Orsini, che il castello raggiunse la sua forma attuale: una pianta pentagonale irregolare dominata da sei torri cilindriche di diverse dimensioni, tre delle quali — le torri angolari maggiori — raggiungono un diametro di circa 14 metri e un'altezza superiore ai 25 metri.

Le torri cilindriche non sono una scelta estetica ma una risposta funzionale all'evoluzione dell'artiglieria da fuoco nel Quattrocento. Le torri circolari sono più resistenti ai proiettili delle torri quadrangolari perché deflettono i colpi invece di riceverli perpendicolarmente, e non hanno angoli ciechi che i difensori non riescono a coprire. La costruzione riflette la fase di transizione tra la fortezza medievale pura — pensata per resistere all'assedio con armi da taglio e catapulte — e la cittadella rinascimentale progettata per resistere all'artiglieria e per usarla offensivamente.

La dimora signorile: la transizione verso il Rinascimento

Accanto alla funzione militare, il castello di Bracciano ospitava una dimora signorile di notevole raffinatezza, rivelando quella caratteristica tensione tra fortezza e palazzo che è tipica dell'architettura italiana del tardo Quattrocento. I saloni interni — la sala delle armi, la sala del trono, i salotti affrescati dei piani superiori — presentano decorazioni pittoriche che rispecchiano il gusto classicista del primo Rinascimento, con cicli di affreschi attribuiti a Antoniazzo Romano e alla sua scuola che raffigurano episodi di storia sacra e mitologica.

I portali in pietra scolpita, i camini monumentali in marmo bianco con stemmi araldici degli Orsini, i soffitti a lacunari lignei intagliati e dorati e le finestre a bifora con colonnine tortili rivelano committenti sensibili alla cultura artistica del loro tempo, consapevoli che la dimora del signore doveva essere anche un manifesto visivo del suo potere e della sua civiltà. Il castello era abitabile in condizioni di lusso relativo, non solo inespugnabile: un equilibrio che anticipa i grandi palazzi-fortezza del Rinascimento maturo.

Gli Odescalchi e la storia moderna del castello

Alla fine del Seicento il castello passò alla famiglia Odescalchi, dinastia di origine comasca che aveva raggiunto l'apice del potere con l'elezione di Benedetto Odescalchi al soglio pontificio come Papa Innocenzo XI nel 1676. Gli Odescalchi acquisirono Bracciano nel 1696 come parte dell'espansione dei propri domini nel Lazio, e ne sono ancora oggi proprietari — una delle rare continuità proprietarie private di questo tipo nel patrimonio monumentale italiano, durata oltre tre secoli e senza interruzioni significative.

Questa continuità proprietaria ha avuto conseguenze positive sulla conservazione del castello: a differenza di molti siti simili divenuti proprietà statale e poi abbandonati per mancanza di fondi, il castello di Bracciano è stato mantenuto in condizioni di relativa integrità strutturale dagli Odescalchi, che ne fanno anche uso per eventi privati di alto profilo. Il caso più famoso è il matrimonio tra Tom Cruise e Katie Holmes, celebrato nel castello nel 2006, che ha proiettato Bracciano sulle pagine dei media internazionali e ha contribuito a rendere il castello una delle location matrimoniali più prestigiose d'Italia.

Come visitare il castello di Bracciano

Il castello è aperto al pubblico con visite guidate che percorrono le sale storiche del piano nobile, le torri, i camminamenti di ronda e le terrazze panoramiche sul lago. Da queste ultime, la vista sul Lago di Bracciano e sui comuni di Anguillara Sabazia e Trevignano Romano è di rara bellezza, specie nelle ore mattutine quando la foschia evaporando dal lago rivela progressivamente i profili delle colline del Lazio settentrionale.

Bracciano è raggiungibile da Roma in circa 40 minuti d'auto lungo la Via Claudia, oppure in treno dalla stazione di Roma Ostiense lungo la linea FL3 fino alla stazione di Bracciano. La visita al castello, che dura circa un'ora, si integra naturalmente con una passeggiata nel centro storico medievale del borgo e con un pranzo a base di pesce di lago nelle trattorie affacciate sull'acqua.

Il Castello Orsini-Odescalchi di Bracciano è uno di quei luoghi in cui la storia si stratifica visibilmente: la pietra medievale porta i segni dell'artiglieria quattrocentesca, gli affreschi raccontano una corte che voleva essere colta oltre che guerriera, e il lago guarda tutto dall'alto della sua quiete millenaria. Alcune fortezze durano perché resistono; questo è durato perché si è trasformato.

Di Alex (pubblicato @ 08:00:00 in Nuovi materiali, letto 296 volte)

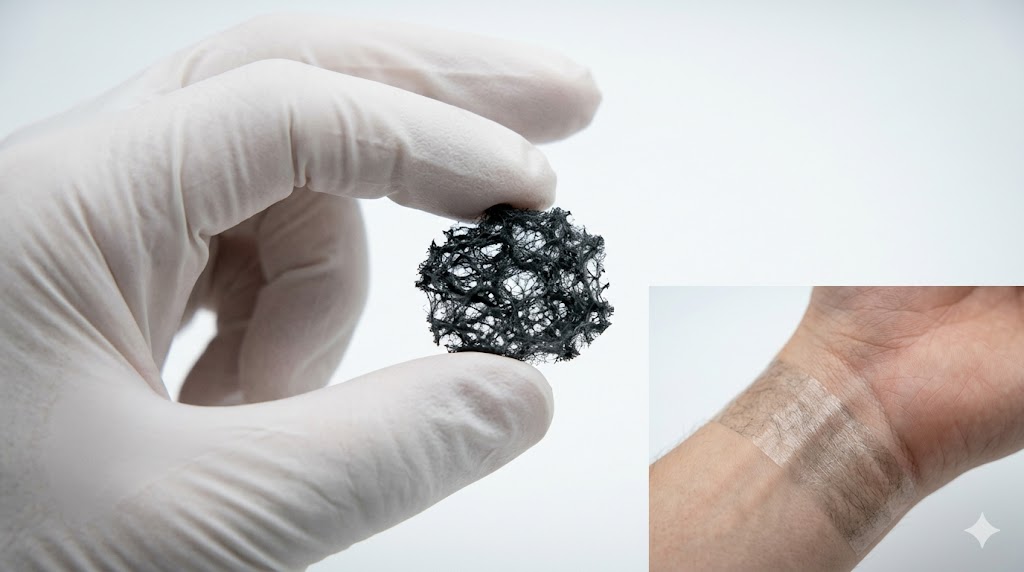

Struttura microscopica dell'aerogel di ossido di grafene per sensori indossabili e interfacce uomo-macchina

Un nuovo metamateriale aerogel a base di ossido di grafene, leggero come fumo e resistente come acciaio, mostra una sensibilità al tocco umano senza precedenti. Nel 2026 viene usato per sensori indossabili con precisione millimetrica e per interfacce uomo-macchina più intuitive di qualsiasi schermo touch attuale.LEGGI TUTTO L'ARTICOLO

Cosa sono gli aerogel di ossido di grafene: materia quasi immateriale

Gli aerogel sono la categoria di materiali solidi meno densi esistenti in natura: strutture porose formate per oltre il 99% da aria, in cui una rete tridimensionale ultraleggera di nanofibre o nanopiastrine costituisce l'unico scheletro solido. Il primo aerogel fu sviluppato negli anni Trenta dal chimico Samuel Kistler usando silice; oggi i materiali aerogel comprendono decine di varianti, ma nessuna ha catturato l'attenzione scientifica e industriale come quelle a base di ossido di grafene (GO), il derivato ossidale dello strato monatomico di carbonio che ha rivoluzionato la scienza dei materiali dal 2004 in poi.

L'aerogel di ossido di grafene si ottiene attraverso un processo di riduzione chimica o termica di dispersioni acquose di GO, seguito da essiccazione con CO2 supercritico per preservare la struttura porosa tridimensionale. Il risultato è un materiale con una densità di appena 0,16 milligrammi per centimetro cubo — circa sei volte più leggero dell'aria — ma con una rigidità meccanica e una conducibilità elettrica sorprendenti, che lo rendono un candidato ideale per sensori deformabili, interfacce flessibili e materiali tattili di nuova generazione.

La sensibilità al tocco: come funziona il meccanismo piezoelettrico

La caratteristica che rende gli aerogel GO particolarmente promettenti per le interfacce uomo-macchina è la loro eccezionale sensibilità piezoelettrica e piezoresistiva. Quando il materiale viene deformato da una pressione — anche minima, come quella di un dito che lo sfiora o di un battito cardiaco — la rete di nanopiastrine di ossido di grafene si comprime, modificando le distanze interlaminari e producendo variazioni misurabili della resistenza elettrica o del potenziale di superficie. Queste variazioni, registrate da elettrodi disposti sulla struttura porosa, vengono convertite in segnali digitali che descrivono con grande precisione l'intensità, la posizione e la dinamica temporale del contatto.

Le prestazioni dei migliori aerogel GO di ultima generazione sono notevoli: sensibilità pressoria fino a 1,1 kilopascal — sufficiente a rilevare la pressione di una formica — tempi di risposta inferiori a 2 millisecondi e capacità di localizzare il punto di contatto con risoluzione spaziale inferiore al millimetro. Questi valori superano di molto le capacità dei migliori sensori tattili capacitivi dei moderni schermi touch, che tipicamente non vanno sotto i 3-5 millimetri di risoluzione spaziale e i 5-10 millisecondi di latenza.

Applicazioni nel 2026: guanti robotici, esoscheletri e chirurgia da remoto

Nel 2026, le applicazioni più avanzate degli aerogel GO per le interfacce uomo-macchina riguardano tre domini principali. Il primo è la robotica collaborativa: guanti strumentati con strati di aerogel GO permettono al chirurgo robotico di ricevere un feedback tattile fedele durante le operazioni laparoscopiche teleoperate, colmando parzialmente l'assenza di sensazione che è sempre stato il principale limite della chirurgia robotica rispetto a quella a mani nude. I sistemi attualmente in sperimentazione clinica presso il Johns Hopkins Hospital e l'Ospedale San Raffaele di Milano mostrano una riduzione statisticamente significativa degli errori di manovra nei compiti che richiedono discriminazione delle texture e misurazione della forza applicata.

Il secondo dominio è quello degli esoscheletri riabilitativi: sensori aerogel GO integrati nelle superfici di contatto con gli arti del paziente misurano in tempo reale la distribuzione delle pressioni durante la camminata assistita, permettendo all'algoritmo di controllo di adattare istantaneamente l'assistenza meccanica al profilo di forza individuale. Il terzo è la realtà aumentata immersiva: guanti aptico-tattili basati su aerogel GO permettono di "sentire" oggetti virtuali tridimensionali con una fedeltà di feedback tattile che il silicone piezoelettrico convenzionale non è in grado di replicare.

Sensori indossabili per il monitoraggio del movimento: precisione millimetrica