\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 18/03/2026

Di Alex (pubblicato @ 17:00:00 in Scienza e Spazio, letto 315 volte)

Strumenti di misura sismici storici esposti al Museo Geofisico di Rocca di Papa

Il Museo Geofisico di Rocca di Papa custodisce oltre un secolo di storia scientifica dedicata al monitoraggio sismico e vulcanico. Ospitato nell'Osservatorio Geofisico dei Castelli Romani, racconta l'evoluzione degli strumenti e delle tecniche di misura dei fenomeni della Terra. LEGGI TUTTO L'ARTICOLO

L'Osservatorio Geofisico dei Castelli Romani

Rocca di Papa, nel cuore dei Castelli Romani sui Colli Albani, ospita uno degli osservatori geofisici più antichi d'Italia. La struttura fu fondata alla fine dell'Ottocento sfruttando la posizione elevata e geologicamente significativa del sito, ubicato nell'area di un antico apparato vulcanico quiescente. L'osservatorio fu concepito per raccogliere dati sismici e meteorologici in una zona considerata tra le più sensibili del territorio italiano per l'attività tellurica e vulcanica.

La collezione di strumenti storici

Il museo conserva una collezione di strumenti scientifici di straordinario valore storico e didattico. Tra i pezzi più significativi si trovano sismografi meccanici di fine Ottocento, magnetometri, barografi e mareografi d'epoca, molti dei quali ancora perfettamente funzionanti. Questi apparecchi testimoniano l'evoluzione tecnologica della geofisica: dai sistemi meccanici a carta affumicata fino alle moderne stazioni digitali in tempo reale collegate alla rete sismica nazionale.

Il monitoraggio sismico: dalla carta affumicata al digitale

Il cuore della missione storica dell'osservatorio era il monitoraggio continuo dell'attività sismica. Le prime registrazioni venivano tracciate su rulli di carta affumicata da aghi metallici mossi dalle oscillazioni del suolo. Ogni rotolo veniva conservato come archivio permanente degli eventi tellurici. L'archivio storico dell'osservatorio contiene registrazioni di terremoti avvenuti a partire dalla fine dell'Ottocento, tra cui quelli catastrofici di Messina del 1908 e della Marsica del 1915.

La vulcanologia dei Colli Albani

L'area dei Colli Albani è classificata come vulcano quiescente, non estinto: le ultime eruzioni risalgono a circa ventimila anni fa, ma il sottosuolo presenta ancora attività idrotermale, emissioni di gas e una microsismicità rilevante. L'osservatorio di Rocca di Papa ha svolto per decenni un ruolo fondamentale nel monitoraggio di questi fenomeni. I dati raccolti nel corso del tempo hanno permesso di costruire modelli geofisici dell'area che vengono tuttora aggiornati dall'Istituto Nazionale di Geofisica e Vulcanologia.

Il museo come strumento di divulgazione scientifica

Negli ultimi anni il Museo Geofisico di Rocca di Papa ha intensificato la propria vocazione divulgativa, aprendo le porte a scolaresche, ricercatori e appassionati di scienze della Terra. Laboratori didattici, visite guidate agli strumenti storici e simulazioni di eventi sismici permettono al pubblico di comprendere in modo concreto il funzionamento del pianeta su cui viviamo. Il museo rappresenta un presidio culturale unico nel panorama italiano della comunicazione scientifica sul territorio.

Il Museo Geofisico di Rocca di Papa è un luogo dove la scienza incontra la memoria. Ogni strumento esposto è un testimone silenzioso di decenni di osservazione paziente, di notti passate a leggere oscillazioni su carta, di tentativi di ascoltare il respiro della Terra. Un patrimonio che merita di essere conosciuto e preservato.

Di Alex (pubblicato @ 16:00:00 in Storia Grecia Antica, letto 234 volte)

Rovine del sito archeologico di Dion con il Monte Olimpo sullo sfondo

Dion, ai piedi del Monte Olimpo, era la città sacra per eccellenza dei Macedoni. I santuari di Zeus e Iside, un teatro ellenistico e ritrovamenti straordinari ne fanno uno dei siti archeologici più suggestivi della Grecia settentrionale, ancora oggi in parte da scavare. LEGGI TUTTO L'ARTICOLO

Il significato religioso di Dion per la Macedonia

Dion, in greco antico Dion o Dium, sorgeva ai piedi del versante orientale del Monte Olimpo, la dimora degli dei nella mitologia greca. Per i Macedoni questa prossimità alla montagna sacra aveva un valore simbolico e religioso profondissimo. La città era il luogo dove i re macedoni celebravano i sacrifici in onore di Zeus Olimpio prima delle grandi campagne militari, conferendo così legittimità divina alle proprie imprese belliche.

Archelao I e la fondazione dei giochi sacri

Verso la fine del V secolo avanti Cristo, il re macedone Archelao I trasformò Dion in un centro culturale e religioso di primo piano. Istituì i giochi in onore di Zeus e delle Muse, della durata di nove giorni, che comprendevano competizioni atletiche e rappresentazioni teatrali. Invitò a corte il drammaturgo Euripide, che compose e mise in scena alcune delle sue ultime tragedie proprio a Dion, consolidando la reputazione della Macedonia come regno civile e non più periferico rispetto alla cultura greca.

Alessandro Magno e il rito della partenza

Dion è strettamente legata alla figura di Alessandro Magno. Prima di intraprendere la spedizione contro l'impero persiano nel 334 avanti Cristo, Alessandro si fermò a Dion per compiere sacrifici agli dei e celebrare giochi atletici e musicali in onore di Zeus Olimpio. Questo rito di partenza aveva una funzione sia religiosa sia politica: sanciva la continuità tra la tradizione macedone e la missione panellenica che Alessandro stava per intraprendere.

I santuari: Zeus, Demetra e Iside

Gli scavi hanno portato alla luce diversi complessi sacri sovrapposti nel tempo. Il santuario di Zeus Olimpio è il più antico e imponente, con tracce di altari e strutture templari risalenti almeno al V secolo avanti Cristo. Particolarmente affascinante è il santuario di Iside, divinità egizia assimilata nel pantheon greco-macedone a partire dall'epoca ellenistica, che conserva splendide statue delle sacerdotesse ancora in situ, riemerse dall'acqua nel loro luogo originale.

Il teatro e il museo archaeologico

Il teatro ellenistico di Dion è uno dei meglio conservati della Grecia settentrionale. Costruito in età ellenistica e ampliato in epoca romana, poteva ospitare diverse migliaia di spettatori. Il Museo Archaeologico di Dion raccoglie i principali reperti emersi dagli scavi: sculture, mosaici, strumenti musicali in bronzo tra i più antichi mai rinvenuti, e la famosa testa di Alessandro attribuita a Lisippo. Il sito è ancora in corso di scavo e restituisce nuove scoperte a ogni campagna.

Dion è uno di quei luoghi dove la storia si sovrappone al mito in modo quasi tangibile. Passeggiare tra i suoi santuari con lo sguardo rivolto alle cime innevate dell'Olimpo significa avvicinarsi al cuore della civiltà macedone, a quella sintesi unica di religione, politica e cultura che Alessandro Magno avrebbe poi portato fino ai confini del mondo conosciuto.

Di Alex (pubblicato @ 15:00:00 in Sistemi Operativi, letto 247 volte)

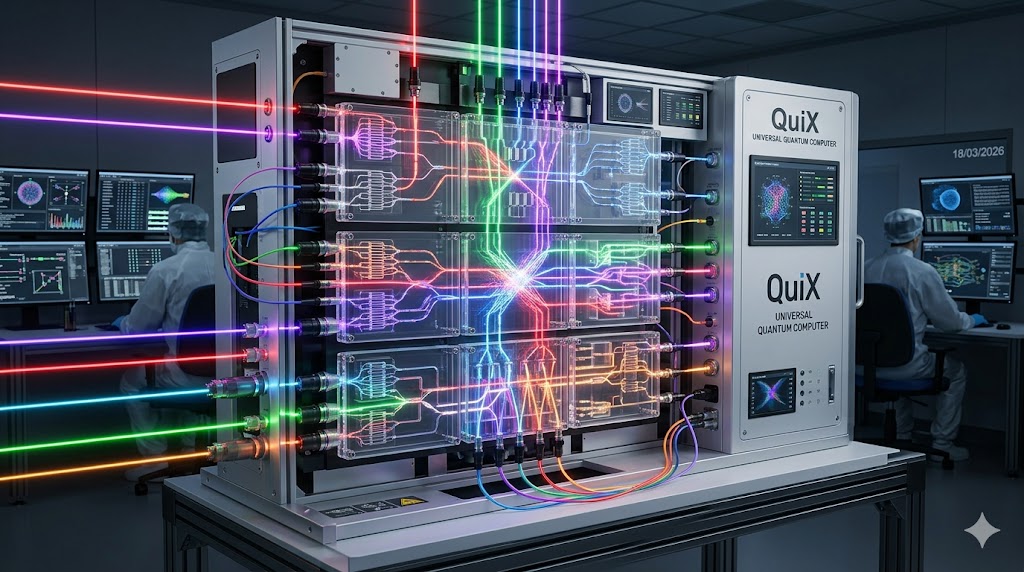

Sistema di calcolo quantistico fotonico con chip di silice e fasci di luce laser colorati

QuiX Quantum punta a costruire entro il 2026 il primo computer quantistico universale basato su fotoni. Il successo aprirebbe la strada a simulazioni molecolari avanzate e ad analisi dati a velocità irraggiungibili per qualsiasi hardware tradizionale, rivoluzionando farmacologia, crittografia e logistica. LEGGI TUTTO L'ARTICOLO

QuiX Quantum: chi sono e cosa stanno costruendo

QuiX Quantum è una startup olandese fondata nel 2019 e spin-off dell'Università di Twente, specializzata nella costruzione di processori fotonici quantistici basati su chip di nitruro di silicio. L'azienda ha sviluppato la piattaforma di calcolo quantistico fotonico più avanzata al mondo per numero di modalità ottiche integrate su un singolo chip. Con i finanziamenti ottenuti nel 2023 e nel 2024 da investitori europei e dal programma Quantum Flagship dell'Unione Europea, QuiX punta a realizzare entro il 2026 il primo sistema quantistico fotonico universale operativo.

Perché usare i fotoni al posto dei qubit superconduttori

I principali computer quantistici oggi disponibili, come quelli di IBM e Google, utilizzano qubit superconduttori che devono essere raffreddati a temperature vicine allo zero assoluto, richiedendo impianti criogenici enormi e costosi. I computer fotonici usano fotoni, particelle di luce, come portatori di informazione quantistica. I fotoni operano a temperatura ambiente, non interagiscono facilmente con l'ambiente e soffrono meno di decoerenza. Questo li rende potenzialmente più scalabili e pratici per applicazioni industriali rispetto ai sistemi superconduttori.

Il concetto di universalità quantistica

Un computer quantistico si definisce universale quando è in grado di eseguire qualsiasi algoritmo quantistico, non solo quelli per cui è stato specificamente progettato. I sistemi fotonici attuali, inclusi quelli di QuiX, sono per lo più specializzati in compiti come il campionamento bosonico. La sfida che QuiX si è posta è implementare porte logiche quantistiche fotoniche programmabili in modo sufficientemente affidabile da raggiungere l'universalità, un traguardo che richiederebbe la gestione precisa di decine di fotoni entangled su chip integrati.

Applicazioni: simulazioni molecolari e analisi dati

Le applicazioni più immediate di un computer quantistico fotonico universale riguardano la simulazione di sistemi molecolari complessi, un compito per cui i computer quantistici hanno un vantaggio strutturale sui sistemi classici. Simulare con precisione il comportamento di una molecola proteica o di un catalizzatore chimico potrebbe accelerare enormemente la scoperta di nuovi farmaci e materiali. Parallelamente, gli algoritmi quantistici per l'ottimizzazione e il machine learning potrebbero trasformare la logistica, la finanza e la sicurezza informatica.

Lo stato della competizione globale nel quantistico fotonico

QuiX Quantum non è sola nel campo fotonico. PsiQuantum, startup californiana sostenuta da Microsoft, punta a costruire un computer fotonico da un milione di qubit entro la fine del decennio. Xanadu, canadese, ha già reso disponibile il suo sistema fotonicoGaussian Boson Sampling sul cloud. La corsa globale al computer quantistico fotonico universale è aperta e le prossime release di QuiX nel 2025 e nel 2026 saranno un banco di prova decisivo per l'intera tecnologia.

Il computer quantistico fotonico universale di QuiX Quantum rappresenta una delle scommesse tecnologiche più ambiziose del decennio. Se il progetto raggiungerà i suoi obiettivi entro il 2026, la fotonica quantistica potrebbe scalzare i sistemi superconduttori come piattaforma dominante, ridisegnando il futuro del calcolo e aprendo orizzonti computazionali che oggi possiamo solo intravedere.

Di Alex (pubblicato @ 13:00:00 in Scienza Ambiente, letto 294 volte)

Superficie oceanica che emette una luminescenza lattea blu-verde visibile nella notte

Intere porzioni di oceano brillano di una luce lattea visibile persino dai satelliti: è il fenomeno dei Milky Seas. Il mistero risiede nella coordinazione spontanea di trilioni di batteri luminosi su aree vaste centinaia di chilometri, un meccanismo biologico ancora non del tutto spiegato. LEGGI TUTTO L'ARTICOLO

Cos'è un Milky Sea

Il termine Milky Sea descrive un fenomeno di bioluminescenza batterica su scala oceanica: vaste zone di oceano aperto, estese anche per migliaia di chilometri quadrati, emettono una luce bluastra e continua che rende la superficie del mare visibile di notte come se fosse illuminata dall'interno. A differenza della bioluminescenza da dinoflagellati, che produce lampi brevi attivati dal movimento, la luce dei Milky Seas è costante e persiste per ore o giorni.

Il batterio responsabile: Vibrio harveyi

Il principale responsabile del fenomeno è il batterio marino Vibrio harveyi, capace di produrre luce attraverso una reazione enzimatica che coinvolge la proteina luciferasi. Questo batterio emette luce solo quando raggiunge una soglia critica di densità di popolazione, grazie a un meccanismo di comunicazione chimica noto come quorum sensing: le cellule percepiscono la concentrazione di molecole segnale prodotte dai propri simili e attivano collettivamente la produzione di luce solo quando sono abbastanza numerose da renderla visibile.

La prima conferma satellitare

Per secoli i Milky Seas erano noti solo attraverso le testimonianze dei marinai, che li descrivevano come oceani di latte nei propri diari di bordo. La prima conferma scientifica tramite immagini satellitari arrivò nel 2005, quando i ricercatori Steven Miller e Steven Haddock identificarono un evento di Milky Sea nell'Oceano Indiano nordoccidentale usando i dati del satellite militare DMSP-OLS. Le immagini mostravano una chiazza luminosa di circa diecimila chilometri quadrati che persisteva per tre settimane consecutive.

Il mistero della coordinazione su scala chilometrica

La domanda scientifica più aperta e affascinante riguarda il meccanismo con cui miliardi di batteri riescono a sincronizzarsi su aree enormi. Il quorum sensing funziona su scale di millimetri o centimetri in laboratorio: come possa operare su centinaia di chilometri in oceano aperto rimane una questione irrisolta. Una delle ipotesi più accreditate è che i batteri colonizzino masse di fitoplancton o particelle organiche in decomposizione che fungono da substrato di concentrazione, creando isole ad alta densità batterica che si espandono e si fondono progressivamente.

Distribuzione geografica e condizioni favorevoli

I Milky Seas sono stati documentati prevalentemente nell'Oceano Indiano nordoccidentale, nel Mar Arabico e nelle acque costiere dell'Indonesia, spesso in associazione con la presenza di alghe e fitoplancton in fioritura. Le condizioni ambientali favorevoli includono acque calde, ricche di nutrienti e con bassa turbolenza. Alcuni ricercatori hanno ipotizzato una correlazione con le correnti di upwelling e con le anomalie termiche superficiali legate al ciclo El Niño, ma le prove restano ancora parziali.

I Milky Seas sono uno dei fenomeni naturali più spettacolari e misteriosi del nostro pianeta. Rappresentano la prova vivente che la vita microscopica è capace di manifestazioni su scala geografica, coordinandosi in modi che la scienza fatica ancora a spiegare. Ogni nuova osservazione satellitare aggiunge un tassello a un puzzle biologico di straordinaria complessità.

Di Alex (pubblicato @ 12:00:00 in Scienza e Spazio, letto 387 volte)

Il Foundational Surface Habitat della missione Artemis VIII sulla superficie lunare

Nel 2033 la missione Artemis VIII installerà il primo avamposto permanente sulla Luna. Il Foundational Surface Habitat della NASA proteggerà gli astronauti da radiazioni cosmiche e micrometeoriti, abilitando permanenze fino a 60 giorni e aprendo la strada alle operazioni minerarie e alle future missioni verso Marte. LEGGI TUTTO L'ARTICOLO

Artemis VIII: la quarta generazione di missioni lunari

Il programma Artemis della NASA si articola in una sequenza di missioni progressive. Dopo i primi sbarchi di Artemis III e IV, Artemis V e VI hanno consolidato la presenza umana temporanea sulla superficie lunare con uscite extraveicolari sempre più prolungate. Artemis VII ha testato i sistemi logistici di rifornimento e la comunicazione autonoma con la Gateway, la stazione spaziale lunare in orbita. Artemis VIII rappresenta il salto qualitativo definitivo: non più visite, ma insediamento. Il 2033 segnerà la transizione dalla fase di esplorazione alla fase di occupazione permanente della superficie lunare.

Il Foundational Surface Habitat: architettura di sopravvivenza

Il nucleo fisico dell'avamposto è il Foundational Surface Habitat, una struttura abitativa progettata per resistere alle condizioni estreme della superficie lunare. I materiali della struttura esterna comprendono strati di polietilene ad alta densità e regolite lunare compattata — la polvere del suolo selenico — che fungono da schermatura passiva contro la radiazione cosmica galattica e le particelle energetiche solari. La struttura è concepita per essere espandibile: il modulo iniziale costituisce il nucleo di quello che, nel corso degli anni successivi, diventerà un complesso abitativo progressivamente più esteso e attrezzato.

Radiazioni e micrometeoriti: le minacce invisibili

La Luna non dispone di campo magnetico né di atmosfera: due scudi che sulla Terra proteggono continuamente la vita. Sulla superficie lunare, gli astronauti sarebbero esposti a dosi di radiazione circa 200 volte superiori a quelle ricevute a livello del mare sulla Terra, e fino a 1.000 volte superiori durante gli eventi di tempesta solare. Il Habitat è progettato per mantenere la dose di radiazione al di sotto dei limiti NASA per le missioni di lunga durata. La struttura è inoltre dimensionata per resistere agli impatti di micrometeoriti — frammenti rocciosi che colpiscono la superficie lunare a velocità di decine di chilometri al secondo, senza l'attrito atmosferico che li distrugge nell'entrata terrestre.

Sessanta giorni: la soglia psicologica e fisiologica

La durata massima prevista delle missioni di Artemis VIII — 60 giorni — non è una scelta arbitraria. In assenza di gravità piena, il corpo umano subisce perdita di massa ossea e muscolare, redistribuzione dei fluidi corporei e alterazioni della visione causate dall'aumento della pressione intracranica. Sulla Luna, dove la gravità è pari a un sesto di quella terrestre, questi effetti sono attenuati rispetto all'orbita, ma non eliminati. Sessanta giorni rappresenta il confine oltre il quale i costi fisiologici supererebbero i benefici operativi senza contromisure mediche più avanzate di quelle attualmente disponibili.

Il trampolino verso Marte

La Luna è esplicitamente considerata dalla NASA come il banco di prova obbligatorio per Marte. Una missione marziana con equipaggio richiederà tecnologie di supporto vitale autonomo, produzione di risorse in loco (ISRU), sistemi di comunicazione a lungo raggio e protocolli medici per emergenze lontane da qualsiasi soccorso terrestre. Tutte queste tecnologie possono essere sviluppate e validate sulla Luna a costi e rischi infinitamente inferiori rispetto a testarle direttamente su Marte, che si trova tra 55 e 400 milioni di chilometri dalla Terra.

Il 2033 sembra lontano, ma nella logistica spaziale è già domani. I contratti con i fornitori del Foundational Surface Habitat sono già in fase di definizione, i materiali vengono testati, i protocolli medici scritti. L'avamposto permanente sulla Luna non è fantascienza: è ingegneria in corso di realizzazione. Quando il primo equipaggio di Artemis VIII varicherà la soglia del Habitat lunare sapendo che ci resterà per due mesi, l'umanità avrà compiuto il passo che separa l'esplorazione dalla colonizzazione.

Di Alex (pubblicato @ 11:00:00 in Scienza e Spazio, letto 346 volte)

Impatto di una cometa ricca di ghiaccio sulla Terra primordiale: l'origine dell'acqua

L'acqua è arrivata sulla Terra dall'esterno, trasportata da comete e asteroidi, o era già presente nel mantello primordiale del pianeta? Le analisi isotopiche dell'idrogeno stanno riscrivendo la storia del nostro pianeta blu, suggerendo una risposta molto più complessa di quanto pensassimo. LEGGI TUTTO L'ARTICOLO

Il problema dell'acqua sulla Terra primordiale

La Terra si formò circa 4,5 miliardi di anni fa dall'aggregazione di materiale roccioso nella regione interna del sistema solare, una zona dove le temperature erano troppo elevate perché l'acqua potesse esistere allo stato solido o liquido. In teoria, la Terra avrebbe dovuto formarsi come un pianeta arido. Eppure oggi il 71% della superficie terrestre è coperto dagli oceani, e l'acqua è presente nel sottosuolo, nei ghiacciai e nell'atmosfera in quantità enormi. Come ci è arrivata? Questa è una delle domande più affascinanti della geologia e della cosmogonia planetaria.

La firma isotopica dell'idrogeno: il detector cosmico

La chiave per rispondere a questa domanda è il rapporto isotopico tra deuterio e idrogeno ordinario — scritto D/H — nell'acqua. Il deuterio è un isotopo dell'idrogeno con un neutrone in più nel nucleo. Diverse fonti di acqua nel sistema solare hanno rapporti D/H caratteristici e misurabili: le comete provenienti dalla Nube di Oort hanno tipicamente un D/H molto più alto dell'acqua terrestre; gli asteroidi di tipo C, cioè gli asteroidi carbonacei della fascia principale, hanno un D/H molto simile a quello dell'acqua oceanica terrestre. Questo dato ha storicamente indicato gli asteroidi come la principale fonte dell'acqua terrestre.

Le comete: escluse ma non del tutto

Per decenni le comete erano state considerate i principali "trasportatori d'acqua" verso la Terra primordiale. L'immagine classica era quella del Grande Bombardamento Tardivo, circa 4 miliardi di anni fa, quando una pioggia di comete e asteroidi colpì i pianeti del sistema solare interno. La misurazione del D/H della cometa di Halley, poi di Hale-Bopp e infine della cometa 67P/Churyumov-Gerasimenko dalla sonda Rosetta dell'ESA, ha però mostrato valori D/H circa doppi rispetto all'acqua terrestre. Se le comete fossero l'unica fonte, l'acqua degli oceani dovrebbe essere molto più ricca di deuterio di quanto non sia. Le comete dunque contribuirono, ma non possono essere la fonte principale.

Il mantello profondo: l'acqua era già qui

Una scoperta recente ha aggiunto una terza ipotesi: parte dell'acqua terrestre potrebbe essere "autoctona", presente già nelle rocce che formarono il pianeta. Minerali idratati come la serpentinite e la brucite possono intrappolare molecole d'acqua nella loro struttura cristallina e trasportarle in profondità durante la formazione planetaria. Nel 2020, analisi di diamanti risalenti al mantello profondo hanno rivelato inclusioni di ringwoodite, un minerale che può contenere fino al 3% del suo peso in acqua. Se il mantello terrestre fosse saturato di acqua anche solo parzialmente, conterrebbe più acqua di tutti gli oceani superficiali messi insieme.

La storia dell'acqua terrestre non ha ancora un capitolo finale. La risposta più accurata che la scienza può dare oggi è che l'acqua degli oceani è probabilmente il risultato di almeno tre contributi sovrapposti: asteroidi carbonacei che bombardarono la Terra giovane, una piccola quota di comete, e il degassamento lento del mantello terrestre nel corso di miliardi di anni. Il pianeta blu non ha ricevuto l'acqua da un unico mittente: l'ha accumulata da tutto il sistema solare, e forse l'aveva anche già in casa.

Il reattore a fusione nucleare ARC di Commonwealth Fusion Systems in Virginia

Nel 2035, due rivoluzioni trasformeranno la civiltà: l'attivazione di ARC, prima centrale a fusione nucleare commerciale di Commonwealth Fusion Systems in Virginia, capace di erogare 400 megawatt puliti, e i progressi della medicina rigenerativa. Un trionfo della fisica applicata e della bioingegneria che cambierà la storia. LEGGI TUTTO L'ARTICOLO

La promessa secolare della fusione nucleare

Per oltre settant'anni la fusione nucleare — la reazione che alimenta il Sole e le stelle — è rimasta la promessa energetica perennemente a trenta anni dal suo raggiungimento. La battuta ricorrente tra i fisici è diventata quasi un mantra malinconico. Eppure, negli anni Venti del XXI secolo, qualcosa di strutturalmente diverso ha cominciato ad accadere: grazie all'avanzamento nella tecnologia dei magneti superconduttori ad alta temperatura e alla disponibilità di capitali privati disposti a investire in ricerca di base, startup come Commonwealth Fusion Systems hanno reso credibile e prossima la prospettiva di un reattore a fusione che produca più energia di quanta ne consumi, in modo continuo e commercialmente competitivo.

Commonwealth Fusion Systems e il progetto ARC

Commonwealth Fusion Systems, azienda nata come spin-off del MIT nel 2018, ha sviluppato il progetto ARC — Affordable, Robust, Compact — come risposta diretta alle limitazioni dei grandi progetti governativi come ITER. L'idea di fondo è radicalmente diversa: invece di costruire macchine sempre più grandi e costose, CFS punta su reattori compatti ma ad altissima densità di campo magnetico, resi possibili dai magneti a nastro REBCO — superconduttori ad alta temperatura basati sull'ossido di rame, bario e renio — capaci di generare campi magnetici di 20 tesla, oltre il doppio di quanto ottenibile con le tecnologie superconduttive precedenti. La compattezza del reattore ARC riduce i costi costruttivi di un ordine di grandezza rispetto a ITER.

Il reattore SPARC e la dimostrazione scientifica

Prima di costruire ARC, CFS ha sviluppato il reattore dimostrativo SPARC, completato nei primi anni Trenta del XXI secolo. SPARC è progettato non per produrre energia commerciale ma per dimostrare il raggiungimento del cosiddetto Q maggiore di 1 — ovvero che la fusione produce più energia di quella necessaria a scaldare il plasma — in un reattore di dimensioni praticabili industrialmente. I risultati di SPARC hanno confermato le proiezioni teoriche dei magneti REBCO e hanno validato la scala fisica su cui è stato dimensionato ARC. Il successo di SPARC ha convinto i principali investitori istituzionali — tra cui il Dipartimento dell'Energia americano — a finanziare la costruzione della centrale ARC presso il James River Industrial Park in Virginia.

400 megawatt puliti nella griglia elettrica del Virginia

La centrale ARC, la cui attivazione è prevista per il 2035, è dimensionata per erogare 400 megawatt di elettricità stabile e priva di emissioni di carbonio direttamente nella rete elettrica nazionale americana. A differenza dei reattori a fissione convenzionali, ARC non produce scorie nucleari ad alta radioattività a lungo termine: i prodotti della fusione deuterio-trizio sono principalmente elio e neutroni, e l'unico materiale che si attiva per irraggiamento è la struttura del reattore stesso, con tempi di decadimento dell'ordine di decenni anziché di millenni. La disponibilità di un reattore dimostrativo di scala industriale aprirà la strada a una proliferazione rapida di centrali tokamak compatte, con l'obiettivo dichiarato di schierarne migliaia entro il 2050.

Medicina rigenerativa: organi costruiti su misura

Parallelamente alla rivoluzione energetica, il 2035 vedrà la maturazione industriale della medicina rigenerativa, la branca della biomedicina che ambisce a riparare o sostituire tessuti e organi danneggiati attraverso la biologia molecolare piuttosto che attraverso il trapianto convenzionale. Le tecnologie di bioprinting tridimensionale — la stampa di tessuti biologici viventi strato per strato a partire da bioink contenenti cellule staminali e biomateriali — avranno raggiunto entro quella data la capacità di produrre strutture tissutali funzionali come cartilagini, cornee, strutture vascolari e segmenti di tessuto cardiaco. Questi progressi si baseranno sull'integrazione di dati genomici personalizzati con protocolli di differenziazione cellulare controllata da intelligenza artificiale.

Staminali, bioprinting e xenotrapianti: il futuro della medicina

Il 2035 segnerà probabilmente anche il consolidamento degli xenotrapianti di seconda generazione come pratica clinica accettata. I maiali geneticamente modificati per eliminare i geni responsabili del rigetto immunologico umano — sviluppati da aziende come eGenesis e Revivicor — forniranno reni, cuori e fegati trapiantabili in pazienti umani con tassi di successo comparabili ai trapianti da donatore umano. L'integrazione tra xenotrapianti, bioprinting e terapia con cellule staminali indotte pluripotenti creerà un arsenale rigenerativo senza precedenti, riducendo drammaticamente la mortalità per insufficienza d'organo e la dipendenza da donatori. La lista d'attesa per un trapianto, che oggi può durare anni, è destinata a diventare un ricordo del passato.

Il 2035 non sarà soltanto un anno del calendario: sarà il punto in cui due delle più antiche ambizioni dell'umanità — energia illimitata e vita più lunga — diventeranno realtà ingegneristiche. Un mondo che non dipende più dal petrolio per scaldarsi e che non accetta più la morte per mancanza di un organo è un mondo strutturalmente più giusto e più libero. Non utopia: fisica applicata e bioingegneria al servizio del genere umano.

Di Alex (pubblicato @ 09:00:00 in Nuovi materiali, letto 259 volte)

Computer quantistico con qubit luminosi e struttura cristallina di materiale futuristico a livello atomico

La manipolazione della materia a livello atomico produce materiali con proprietà straordinarie e computer quantistici capaci di risolvere problemi irraggiungibili dai sistemi classici, aprendo scenari rivoluzionari per medicina, crittografia, energia e industria globale. LEGGI TUTTO L'ARTICOLO

Il calcolo quantistico: oltre i limiti classici

I computer classici elaborano informazioni in bit, che assumono valore zero o uno. I computer quantistici usano qubit, che grazie alla sovrapposizione quantistica possono essere simultaneamente zero e uno. Questo permette di esplorare parallelamente un numero esponenzialmente maggiore di combinazioni. Per problemi come la simulazione molecolare, l'ottimizzazione logistica e la crittografia, i vantaggi sono potenzialmente trasformativi.

I materiali quantistici: proprietà al limite dell'impossibile

La manipolazione della materia a livello atomico ha portato alla sintesi di materiali con comportamenti che sfidano l'intuizione comune. I superconduttori ad alta temperatura critica eliminano la resistenza elettrica, aprendo la via a reti energetiche senza perdite di trasmissione. I materiali topologici ospitano stati elettronici protetti dalle perturbazioni esterne, utili per l'elettronica ultrastabile. Il grafene e i suoi derivati bidimensionali combinano resistenza meccanica estrema con proprietà elettriche eccezionali.

Applicazioni in medicina e farmacologia

La simulazione quantistica permette di modellare con precisione il comportamento di molecole biologiche complesse, accelerando la scoperta di nuovi farmaci. Processi che richiederebbero migliaia di anni ai supercomputer classici diventano calcolabili in ore. Aziende come IBM, Google e numerose startup del settore farmaceutico stanno già collaborando per applicare algoritmi quantistici alla ricerca su Alzheimer, tumori e patologie rare.

Crittografia e sicurezza nell'era quantistica

I computer quantistici sufficientemente potenti saranno in grado di violare i sistemi di crittografia asimmetrica attualmente in uso, come RSA. Questo ha spinto governi e organizzazioni internazionali a sviluppare standard di crittografia post-quantistica. Il National Institute of Standards and Technology statunitense ha pubblicato nel 2024 i primi standard ufficiali di algoritmi resistenti agli attacchi quantistici, segnando un punto di svolta nella sicurezza informatica globale.

Le sfide ancora aperte

I computer quantistici attuali soffrono di decoerenza: i qubit perdono il loro stato quantistico in tempi brevissimi a causa delle interferenze ambientali. Il numero di qubit logici stabili necessari per applicazioni pratiche su larga scala non è ancora stato raggiunto. La correzione degli errori quantistici richiede un numero elevato di qubit fisici per ogni qubit logico, rendendo la scalabilità una sfida ingegneristica di prima grandezza.

La fisica quantistica e i nuovi materiali stanno ridisegnando i confini di ciò che è tecnicamente possibile. Sebbene le applicazioni su larga scala richiedano ancora anni di sviluppo, la traiettoria è inequivocabile: il potere di manipolare la materia al livello dei singoli atomi trasformerà industria, medicina e sicurezza in modi che oggi possiamo solo intravedere.

Di Alex (pubblicato @ 08:00:00 in Networking e Connettività, letto 284 volte)

Smartphone connesso direttamente a un satellite in orbita bassa sopra un paesaggio remoto

Dal 2026 i telefoni si connettono direttamente ai satelliti senza torri terrestri. Starlink Direct to Cell e sistemi concorrenti garantiranno copertura globale anche nelle zone più remote del pianeta, eliminando definitivamente le aree senza segnale e democratizzando la connettività mondiale. LEGGI TUTTO L'ARTICOLO

Come funziona la connessione diretta satellite-telefono

La tecnologia Direct to Cell (D2C) permette ai normali smartphone di connettersi direttamente a satelliti in orbita bassa senza hardware aggiuntivo, antenne paraboliche o modem speciali. Il satellite funge da torre cellulare spaziale, traducendo i segnali nella banda LTE standard già supportata dai telefoni moderni. L'utente non nota differenze operative rispetto a una chiamata o a un messaggio inviato tramite rete terrestre.

Starlink e i principali operatori

SpaceX ha ottenuto le prime autorizzazioni regolatorie negli Stati Uniti e in altri paesi per il servizio Starlink Direct to Cell. Dal 2024 i satelliti Starlink di nuova generazione includono già l'antenna D2C integrata. AST SpaceMobile con la costellazione BlueWalker e Amazon con il progetto Kuiper rappresentano i principali competitor. Operatori come T-Mobile, Optus e Rakuten hanno già siglato accordi commerciali per integrare il D2C nelle proprie offerte.

Fine delle zone morte: impatto concreto

Oggi circa il quaranta per cento della superficie terrestre non è coperta da alcuna rete cellulare: oceani, foreste, montagne, deserti e vaste aree rurali rimangono irraggiungibili. La telefonia D2C satellitare elimina strutturalmente questo divario. Per i lavoratori in pesca, agricoltura, logistica e turismo d'avventura la connettività diventa uno strumento di sicurezza primaria. Per le comunità remote dei paesi in via di sviluppo, rappresenta un salto diretto verso i servizi digitali essenziali.

Velocità, latenza e limiti attuali

I servizi D2C di prima generazione supportano messaggistica SMS e dati a bassa velocità. Le evoluzioni successive, previste entro il 2026 e il 2027, introdurranno voce e dati a velocità più elevate. La latenza rimane superiore a quella delle reti terrestri a causa delle distanze percorse dal segnale, ma è sufficiente per comunicazioni vocali e trasmissione dati di base. L'autonomia della batteria degli smartphone non è significativamente compromessa dalla comunicazione satellitare.

Impatto economico e geopolitico

La connettività universale ridisegna anche gli equilibri economici e geopolitici. Governi di paesi con vaste aree disabitate possono ridurre drasticamente gli investimenti in infrastrutture terrestri costose. Al tempo stesso, la dipendenza da costellazioni private di proprietà statunitense pone interrogativi strategici sulla sovranità digitale delle nazioni che sceglieranno di affidarsi a questi servizi senza sviluppare alternative proprie.

La telefonia satellitare diretta da smartphone non è più un servizio di nicchia riservato all'industria: dal 2026 diventa un'infrastruttura di connettività universale. Per la prima volta nella storia delle telecomunicazioni, essere fuori rete sta per diventare tecnicamente impossibile su qualunque punto della superficie terrestre.

Fotografie del 18/03/2026

Nessuna fotografia trovata.

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3

Think different!

Think different!

(p)Link

(p)Link Commenti

Commenti Storico

Storico Stampa

Stampa