\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 31/03/2026

Di Alex (pubblicato @ 17:00:00 in Storia Medioevo, letto 991 volte)

Veduta aerea dell'antica Costantinopoli con le sue imponenti mura e l'Ippodromo

Nel vasto palcoscenico della storia europea e mediorientale, il periodo compreso approssimativamente tra il V e la fine del XV secolo, convenzionalmente denominato Medioevo, è stato caratterizzato da profondi sconvolgimenti demografici. Tuttavia, in netto contrasto con la de-urbanizzazione che affliggeva l'Occidente, la porzione orientale dell'Impero Romano mantenne una straordinaria continuità, trovando il suo fulcro inespugnabile nella città di Costantinopoli. Conosciuta come la "Nuova Roma", questa metropoli non fu semplicemente una capitale amministrativa, ma si eresse come il centro di gravità assoluto del mondo medievale, un ecosistema urbano di proporzioni colossali che per un millennio dettò i ritmi della diplomazia, del commercio globale e dello sviluppo tecnologico. LEGGI TUTTO L'ARTICOLO

Demografia, struttura sociale e logistica urbana

Per cogliere la reale portata dell'anomalia storica rappresentata da Costantinopoli, è fondamentale analizzare i suoi dati demografici in comparazione con i coevi centri urbani europei. La capacità di sostenere una popolazione immensa in epoca pre-industriale richiedeva un'organizzazione statale e logistica che non aveva eguali nel resto del continente. Al suo apice, tra il X e il XII secolo, Costantinopoli ospitava tra i 350.000 e il milione di abitanti, una cifra inimmaginabile per Parigi, Londra o le principali città italiane dell'epoca, che raramente superavano le decine di migliaia di residenti. Mentre paesi come la Francia o le isole britanniche registravano densità di popolazione estremamente basse, Costantinopoli rappresentava un accentramento demografico straordinario che poneva sfide formidabili, risolte attraverso la sinergia tra geografia e intervento statale. Il primo elemento vitale per il mantenimento di tale popolazione era l'igiene urbana. Le città fluviali europee, come Parigi e Londra, affrontavano ciclicamente epidemie devastanti a causa dell'inquinamento delle acque. Costantinopoli, al contrario, sfruttava le potenti e costanti correnti del Bosforo e del Mar di Marmara per disperdere le acque reflue con un'efficienza naturale che riduceva drasticamente l'impatto delle malattie infettive. Il secondo pilastro demografico era l'approvvigionamento alimentare centralizzato. Lo Stato bizantino mantenne un ferreo controllo sulle forniture di grano, importando quantità monumentali di cereali dall'Egitto e, successivamente, dalle coste del Mar Nero. Il pane era considerato una questione di sicurezza nazionale, e le corporazioni dei fornai erano costantemente monitorate per prevenire carenze e fluttuazioni di prezzo che avrebbero potuto innescare sommosse. La società era rigidamente divisa in honestiores (i privilegiati) e humiliores (gli umili), una dicotomia che si rifletteva nel sistema penale: mentre i primi potevano espiare le colpe con multe, i secondi erano soggetti a punizioni corporali brutali come la mutilazione facciale. Le donne godevano di una flessibilità economica notevole, gestendo botteghe e affari, mentre la famiglia nucleare, promossa dalla Chiesa Ortodossa, permise una concentrazione del patrimonio che stimolò gli investimenti privati. Questo dinamismo, unito a un tasso di alfabetizzazione eccezionalmente elevato, alimentò una vasta classe burocratica di professionisti del "colletto bianco" – avvocati, contabili, diplomatici e scribi – essenziali per l'amministrazione del vasto impero.

La topografia urbana: la Mese, i fori monumentali e la vita quotidiana

Il paesaggio urbano di Costantinopoli era un labirinto eclettico in cui l'ordine monumentale delle piazze imperiali si scontrava con il disordine organico dei vicoli residenziali. Il cuore logistico e cerimoniale della metropoli era la Mese (la "Strada di Mezzo"), una maestosa via colonnata che attraversava la penisola fungendo da palcoscenico per i trionfi militari e le processioni religiose. Il percorso della Mese iniziava dal Milion, un tetrapilo monumentale che fungeva da pietra miliare zero per tutte le distanze dell'Impero. Procedendo verso ovest, la strada si apriva nell'Augustaion, una vasta piazza lastricata circondata dai centri del potere. Proseguendo, il tessuto urbano si articolava in una sequenza di imponenti fori. Il Foro di Costantino rappresentava il centro geometrico e ideologico della Nuova Roma, adornato da inestimabili statue in bronzo sottratte ai santuari pagani e dominato da una monumentale colonna di porfido, la Çemberlitaş, ancora oggi visibile. Ancora più a ovest, la Mese attraversava il Foro di Teodosio, costruito per esaltare i trionfi militari della dinastia teodosiana, dominato dalla Colonna di Teodosio e da un grandioso arco trionfale, purtroppo distrutti dai frequenti terremoti che flagellavano la regione. Tra queste immense architetture di pietra, brulicava la vita quotidiana. Le piazze e i porticati erano animati da una moltitudine cosmopolita e rumorosa: giocolieri, acrobati, mendicanti, venditori ambulanti di reliquie, prostitute, indovini e predicatori ascetici si mescolavano ai cittadini comuni e all'aristocrazia. Il concetto moderno di "street food" era una pratica quotidiana profondamente radicata, con persone di tutte le classi sociali che consumavano pasti caldi acquistati dai venditori ambulanti. La dieta degli umili era spartana e basata su cereali, ortaggi e pesce fresco, mentre i tavoli dei ricchi abbondavano di proteine nobili come pernici, piccioni e oche gigantesche. La religione permeava ogni istante della vita urbana, non solo come costrutto teologico, ma come infrastruttura sociale. Le chiese di quartiere fungevano da centri di aggregazione primaria dove i vicini scambiavano notizie e risolvevano dispute. Tuttavia, per il cittadino comune sfiancato dalle lunghe ore di lavoro, la via di fuga per eccellenza era l'Ippodromo. Le corse dei carri non erano solo un evento sportivo, ma il vero cuore politico della metropoli, dove le fazioni degli Azzurri e dei Verdi, vere e proprie milizie paramilitari, si affrontavano in violenze urbane di proporzioni devastanti.

L'economia imperiale: la via della Seta e il segreto della porpora

Se la geografia forniva a Costantinopoli le fondamenta del suo potere, furono l'astuzia politica e l'innovazione commerciale a riempire le cripte del tesoro imperiale. La città si ergeva come il terminale occidentale assoluto della Via della Seta, l'arteria transcontinentale che facilitava lo scambio di beni di lusso, tecnologie e religioni tra l'Asia Orientale e il bacino del Mediterraneo. Il percorso delle carovane verso ovest era irto di ostacoli colossali, dai banditi nel corridoio del Gansu al monopolio dei Parti e dell'Impero Sasanide persiano. Questi potenti intermediari non solo applicavano dazi enormi, ma, essendo spesso in guerra contro Costantinopoli, utilizzavano l'oro bizantino per finanziare i propri eserciti. La svolta, un vero e proprio atto di spionaggio industriale su scala geopolitica, avvenne nel 552 d.C. durante il regno dell'imperatore Giustiniano I. Ansioso di spezzare la dipendenza strategica ed economica dai nemici persiani, Giustiniano commissionò a due monaci nestoriani un'operazione clandestina. Sfruttando la loro copertura di missionari, i monaci viaggiarono fino al cuore della Cina e riuscirono a contrabbandare uova vitali di baco da seta e semi della pianta di gelso, nascondendoli all'interno di cavità di innocui bastoni da passeggio in bambù. Questo evento alterò in modo irreversibile gli equilibri dell'economia mondiale. L'Impero Bizantino fondò rapidamente un'industria serica autoctona, supervisionata dallo Stato, che iniziò a produrre sete di una qualità e complessità tecnica tali da annientare il monopolio cinese sul mercato occidentale. La produzione serica divenne una fonte inesauribile di valuta pregiata, mantenendo la sua preminenza per secoli. La forza del commercio imperiale era sostenuta da una politica monetaria di eccezionale lungimiranza. A differenza dell'Europa occidentale, l'Impero Bizantino mantenne un'economia monetaria stabile per oltre milleduecento anni. La valuta d'oro bizantina, il solido o nomisma, circolava in tutto il bacino del Mediterraneo ed era considerata il dollaro del Medioevo. Spesso adornate con la figura di Cristo e i ritratti degli imperatori, queste monete fungevano anche da strumento di propaganda soft-power, diffondendo le ideologie teologiche imperiali ben oltre i confini fisici dell'Impero.

L'architettura della difesa: inespugnabilità e ingegneria militare

La sopravvivenza millenaria di Costantinopoli non fu il risultato di una mera superiorità numerica, ma dell'applicazione scientifica dell'ingegneria all'arte della guerra. I bizantini non consideravano l'ingegneria come un supporto logistico, ma come l'arma difensiva primaria, fondendo architettura, idraulica e chimica in un complesso sistema di interdizione spaziale. Il fianco continentale della penisola era sigillato dal sistema di fortificazioni più formidabile dell'antichità tardiva: le Mura Teodosiane. Dopo il crollo di ampi tratti a causa di un terremoto nel 447 d.C., mentre le orde degli Unni di Attila erano in marcia verso la capitale, lo Stato mobilitò l'intera popolazione urbana. Unendo le fazioni rivali dell'Ippodromo in uno sforzo titanico, le ciclopiche fortificazioni, complete di fossati profondi e terrazzamenti multipli, furono riedificate in appena due mesi, un capolavoro di coordinazione civile e ingegneristica che protesse l'Europa orientale per mille anni. Se le mura bloccavano le armate terrestri, il tallone d'Achille della città risiedeva nel Corno d'Oro. La risposta bizantina fu la "Grande Catena", una barriera artificiale lunga circa 750 metri, tesa attraverso la foce dell'estuario. Ancorata a enormi pontoni galleggianti e fissata a torri difensive, la catena poteva essere tesa o abbassata tramite un intricato sistema di ruote e contrappesi, bloccando qualsiasi flotta nemica sotto il fuoco incrociato delle mura marittime. La difesa passiva era integrata dalla più celebre e letale arma offensiva: il Fuoco Greco. Introdotto nel 672 d.C., questa miscela incendiaria liquida salvò ripetutamente Costantinopoli dall'annientamento totale. La sua peculiarità agghiacciante consisteva nella capacità di bruciare a contatto con l'acqua, propagandosi sulle onde per incenerire i fragili scafi di legno nemici. Il metodo di somministrazione era ingegneristicamente pionieristico: gli ingegneri navali bizantini svilupparono un vero e proprio lanciafiamme pressurizzato, che spruzzava il liquido infuocato a notevoli distanze. Il segreto della composizione chimica era considerato un segreto di Stato di importanza vitale. L'analisi chimico-storica contemporanea converge su una miscela eterogenea: una sospensione di petrolio, ossido di calcio (calce viva) e impurità di nitrati. Il petrolio fungeva da base fluida e vischiosa, mentre l'ossido di calcio reagiva esotermicamente a contatto con l'acqua, sprigionando il calore letale per incendiare il gas e creare l'infernale getto infuocato descritto dai testimoni.

La spada dell'imperatore: la Guardia Variaga

All'interno di queste impenetrabili fortificazioni, il nucleo della sicurezza imperiale e dello shock offensivo era affidato a una forza d'élite etnicamente distante dal mondo mediterraneo: la Guardia Variaga. Le origini di questo reggimento leggendario risalgono al 986 d.C., quando l'imperatore Basilio II, dopo una pesante sconfitta, stipulò trattati con il principe Vladimir di Kiev per ricevere truppe ausiliarie. La guardia fu composta inizialmente in modo schiacciante da mercenari scandinavi – norvegesi, svedesi e danesi – insieme ai guerrieri Rus'. L'ingaggio di truppe nordiche rispondeva a una logica politica ferrea: questi guerrieri, estranei agli intrighi di palazzo, garantivano una fedeltà incorruttibile alla persona dell'Imperatore, in quanto il loro prestigio e i loro emolumenti dipendevano esclusivamente dalla sua sopravvivenza. Sul piano tattico, operavano come fanteria pesante d'urto, spesso tenuti in riserva per essere scatenati nel momento culminante dello scontro per spezzare il morale del nemico. L'iconografia li ritrae mentre brandiscono la terrificante ascia danese a due mani, capace di penetrare armature e decapitare i cavalli, meritandosi l'eponimo di "barbari portatori d'ascia". Il loro impiego non si limitava alle operazioni campestri. A causa del loro insuperabile background nella marineria, i Variaghi venivano intensamente impiegati per operazioni di abbordaggio navale e di soppressione della pirateria. Il caso più emblematico fu quello di Harald Sigurðarson, il futuro re Harald Hardrada di Norvegia, che accumulò immense ricchezze servendo nella guardia, finanziando le sue successive ambizioni di conquista. Il panorama etnico della Guardia mutò dopo il 1066. In seguito alla Conquista Normanna dell'Inghilterra, migliaia di guerrieri e nobili anglosassoni esiliati trovarono impiego a Costantinopoli, sostituendo gradualmente la componente scandinava, tanto che l'inglese antico divenne una lingua comune nei presidi militari. Il posizionamento religioso di questi mercenari svela il pragmatismo bizantino: ai Variaghi veniva imposta una rigida ortodossia di facciata per le cerimonie pubbliche, ma nel segreto dei loro accampamenti era accordata una silenziosa tolleranza per i loro rituali pagani. Resti archeologici, come lame di spade norrene ritrovate nei Balcani, attestano l'estesa campagna militare compiuta da queste truppe, che rimasero operative a Costantinopoli almeno fino all'inizio del 1400 d.C.

Il teatro del potere: il Grande Palazzo, automazione e sottomissione diplomatica

Se l'architettura esterna esaltava la potenza marziale di Costantinopoli, la sua politica estera veniva amministrata all'interno del "Sacro Palazzo" attraverso un uso magistrale dell'etichetta di corte, un sistema concepito per paralizzare psicologicamente ambasciatori e vassalli stranieri. Esteso su terrazzamenti che digradavano dall'Ippodromo fino al mare, il Grande Palazzo era una cittadella imperiale composta da decine di padiglioni, sale consiliari e giardini. Il cuore pulsante del potere era il Chrysotriklinos (la "Sala d'Oro") e l'enorme basilica colonnata della Magnaura. Le complesse interazioni all'interno di questa fortezza erano scandite dal De Ceremoniis, il "Libro delle Cerimonie" redatto dall'imperatore Costantino VII Porfirogenito. Più che un manuale protocollare, l'opera era la codificazione della Taxis, il concetto per il quale l'ordinamento rigoroso della corte terrena era lo specchio dell'ordine celestiale, con il sovrano nel ruolo di luogotenente di Dio. Uno degli strumenti coercitivi più efficaci era il rigido controllo del vestiario istituzionale, che trasformava le nomine in estenuanti maratone sartoriali. La diplomazia si trasformava in una guerra psicologica di sopraffazione sensoriale. Quando un delegato occidentale penetrava nei saloni, enormi organi musicali saturavano l'acustica e l'illuminazione accecava il visitatore. Avanzando verso il trono, l'ambasciatore veniva confrontato con l'apice della cibernetica ellenistica: un enorme albero di platano in oro massiccio con uccelli metallici che cinguettavano, e due enormi leoni meccanici che sbattevano la coda e ruggivano. Travolto dal frastuono, il delegato era obbligato a eseguire la proskynesis, un atto di sottomissione che consisteva nel prosternarsi tre volte davanti ai piedi del sovrano, profondamente offensivo per gli standard occidentali. La cronaca di Liutprando di Cremona rivela l'illusione scenica definitiva: mentre era prono sul pavimento, un sistema idraulico sollevava il trono imperiale per svariati metri verso il soffitto, e l'Imperatore cambiava abito, presentandosi con paramenti ancora più imponenti. L'impatto psicologico era devastante, decostruiva le pretese di parità di qualsiasi regno straniero e permetteva ai funzionari di Palazzo di dominare le negoziazioni da una posizione di incontestabile superiorità psicologica e politica. Nelle occasioni pubbliche, le strade venivano ripulite e profumate, e fontane speciali offrivano vino e prelibatezze ai cittadini, cementando l'aura di infallibilità e provvidenza della dinastia regnante.

Analizzando la vasta mole di evidenze ingegneristiche, socio-demografiche ed economico-cerimoniali, emerge in modo incontrovertibile che la grandezza di Costantinopoli durante il millennio medievale non risiedeva esclusivamente nei suoi possedimenti territoriali, sovente effimeri, ma nella sua sofisticata integrazione sistemica. L'impero seppe istituzionalizzare la complessità, trasformando la chimica e la fisica in apparati di difesa statale ineguagliabili come il Fuoco Greco, e convertendo le fragilità topografiche in difese impenetrabili. Subordinando guerrieri nordici, macchine idrauliche e un protocollo umiliante a una narrazione teologico-politica di "Taxis" inattaccabile, i sovrani di Costantinopoli forgiarono molto più di una capitale funzionante: ingegnerizzarono il centro gravitazionale dell'universo medievale, mantenendo accesa per mille anni la fiaccola dell'antichità.

Ricostruzione AI

Di Alex (pubblicato @ 16:00:00 in Razzismo USA spiega Trump, letto 425 volte)

Panoramica di Los Angeles dal cielo con downtown e le montagne sullo sfondo, rappresentazione della metropoli contemporanea

L'immaginario collettivo globale ha cristallizzato Los Angeles come quintessenza del "Sogno Americano", ma l'espressione nostalgica "Quando l'America era grande" cela una realtà complessa. La storia di questa megalopoli californiana non è stata un'esplosione spontanea, bensì il risultato di titaniche ingegnerie sociali, idriche e promozionali che hanno plasmato un territorio da remoto avamposto coloniale a potenza globale, intrecciando conquiste straordinarie con dinamiche di espropriazione e conflitto. LEGGI TUTTO L'ARTICOLO

L'ecosistema originario, le missioni e l'era spagnola (pre-1781 - 1821)

Molto prima che le narrazioni occidentali imponessero i propri paradigmi urbani, il bacino costiero che oggi ospita la contea più popolosa degli Stati Uniti era un ecosistema florido e densamente abitato. La regione, conosciuta come Tovangar, si estendeva per oltre 4.000 miglia quadrate, territorio ancestrale della nazione Tongva e delle limitrofe tribù Chumash. In epoca precoloniale, la struttura sociale dei Tongva non si basava su un'entità pan-tribale centralizzata, ma su una rete di circa 100 villaggi autonomi, con un'economia profondamente radicata in una complessa visione del mondo che posizionava gli esseri umani come un singolo filo in una più vasta rete vitale.

Il primo contatto registrato con gli europei avvenne l'8 ottobre 1542, quando l'esploratore spagnolo Juan Rodriguez Cabrillo navigò lungo la costa californiana, battezzando l'odierna baia di San Pedro come "Baia dei Fumi". Tuttavia, la vera e propria colonizzazione fu ritardata di oltre due secoli. Il 2 agosto 1769, la spedizione guidata dal Capitano Gaspar de Portolá si accampò nell'insediamento Tongva di Yaang'na, segnando l'inizio di una trasformazione radicale. Nel 1771, Padre Junípero Serra fondò la Missione San Gabriel Arcángel, imponendo un brutale sistema di lavoro coatto e assimilazione culturale. Le missioni spagnole operavano simultaneamente come chiese, città, scuole, fattorie, fabbriche e prigioni, supportate da presidi militari. I Tongva, ribattezzati "Gabrieleño", furono sistematicamente ridotti in schiavitù per costruire le infrastrutture coloniali, mentre le malattie introdotte dagli europei e le conversioni forzate smantellarono la struttura sociale indigena. Ancora oggi, il sigillo ufficiale della città di Los Angeles reca un rosario a 77 grani, testimonianza del controverso ruolo delle missioni spagnole nei primi anni dell'insediamento.

L'istituzione formale del nucleo urbano avvenne il 4 settembre 1781, quando un gruppo di coloni noti come Los Pobladores intraprese una logorante spedizione di oltre mille miglia attraverso il deserto dall'attuale Messico settentrionale. Contrariamente ai successivi miti di purezza razziale, i fondatori di Los Angeles erano straordinariamente eterogenei: 14 famiglie composte da 44 individui con ascendenze native americane, africane ed europee. L'insediamento venne solennemente nominato "El Pueblo de Nuestra Señora la Reina de los Ángeles de Porciúncula", e la sopravvivenza dipese fin da subito dal controllo delle risorse idriche, con l'immediata escavazione della Zanja Madre, un fosso in terra battuta che deviava le acque del fiume Los Angeles per irrigare i campi agricoli, determinando le primissime forme di zonizzazione urbana.

Il dominio messicano e l'invenzione dei rancho (1821-1848)

Con la conclusione della Guerra d'Indipendenza Messicana nel 1821, la sovranità sull'Alta California passò al neonato Stato messicano, inaugurando un'epoca di profonde trasformazioni fondiarie. La Costituzione del Messico del 1824 e il successivo Colonization Act mirarono a decentralizzare il potere e a incoraggiare l'insediamento demografico concedendo terre a cittadini e naturalizzati. Il punto di svolta per lo sviluppo territoriale del bacino di Los Angeles si verificò tra il 1833 e il 1834, quando il governo messicano approvò la legge sulla secolarizzazione delle missioni (Mexican Secularization Act). Sulla carta, la legislazione imponeva che una parte considerevole delle vaste proprietà terriere della Chiesa fosse ridistribuita alle famiglie indigene cristianizzate che avevano storicamente abitato e lavorato in quelle aree. Nella pratica, la distribuzione fu caotica e corrotta: la maggior parte dei nativi non fu mai informata dei propri diritti, finendo per essere assorbita come manodopera a basso costo nel nuovo sistema economico.

Le immense tenute agricole furono invece acquisite, attraverso concessioni governative (land grants), da una ristretta oligarchia locale nota come Californios. A differenza delle precedenti concessioni spagnole, che tornavano alla corona alla morte del beneficiario, i grants messicani, che variavano solitamente in dimensioni di due o più leghe quadrate, offrivano diritti di proprietà permanenti. Tra il 1833 e il 1846, il Messico rilasciò circa 270 di queste concessioni in tutta la California, consolidando il "sistema dei Rancho" come primaria istituzione economica e sociale della regione. L'economia si focalizzò in modo predominante sull'allevamento del bestiame e sul commercio del sego e del cuoio, supportata da una struttura sociale gerarchica basata sui clan familiari allargati e sull'esplicito sfruttamento del lavoro nativo. Figure come Francisco Reyes, un ex alcalde di Los Angeles, ricevettero concessioni enormi governando su vasti latifondi in uno stile che ricalcava la nobiltà terriera della Nuova Spagna. I confini stabiliti in questa "era dei Rancho" avrebbero poi costituito la base del sistema di rilevamento catastale della California, influenzando in modo permanente la mappa moderna di Los Angeles.

La conquista statunitense e le battaglie di Los Angeles (1846-1848)

L'autonomia della provincia messicana dell'Alta California subì una brutale interruzione a causa delle mire espansionistiche degli Stati Uniti. Dopo l'annessione della Repubblica del Texas nel 1845, il Presidente James K. Polk, animato dall'ideologia del "Destino Manifesto", inviò truppe nei territori contesi, scatenando la Guerra Messicano-Americana (1846-1848). L'occupazione di Los Angeles non fu pacifica né immediata. Sebbene le truppe americane avessero inizialmente preso il controllo della città nel 1846, la resistenza messicana locale fu in grado di riconquistare temporaneamente l'insediamento. La riconquista definitiva da parte degli Stati Uniti si concretizzò attraverso un'offensiva navale e terrestre combinata all'inizio del 1847.

Il momento decisivo della campagna militare in California si svolse lungo le sponde del fiume San Gabriel. L'8 gennaio 1847, le truppe statunitensi, composte da circa 600 uomini tra dragoni appiedati, volontari californiani, marine e marinai, guidate dal Commodoro della Marina Robert F. Stockton e dal Generale dell'Esercito Stephen W. Kearny, affrontarono la milizia dei Californios comandata dal Generale José María Flores. Nella Battaglia di Río San Gabriel, le scorte di munizioni insufficienti e difettose dei messicani furono soverchiate dall'efficace fuoco di artiglieria americana. Dopo uno scontro durato circa 90 minuti, la controffensiva americana aprì una breccia decisiva nelle difese messicane, forzandone la ritirata. Il giorno successivo, il 9 gennaio 1847, l'ultimo scontro militare della campagna californiana ebbe luogo nella Battaglia di La Mesa, permettendo alle forze statunitensi di entrare a Los Angeles il 10 gennaio "senza molestie".

La formalizzazione della conquista giunse il 2 febbraio 1848 con la firma del Trattato di Guadalupe Hidalgo, un documento fondamentale che estese i confini degli Stati Uniti fino all'Oceano Pacifico. In base a questo accordo, il Messico cedette un territorio immenso, la Cesión mexicana (circa 529.000 miglia quadrate), in cambio di 15 milioni di dollari. Sebbene il trattato garantisse formalmente la protezione della proprietà e dei diritti civili dei cittadini messicani residenti nei territori annessi, nei decenni successivi gran parte dei Californios perse i propri storici possedimenti fondiari a causa di un sistema legale ostile, di tasse esorbitanti e della pressione esercitata dai nuovi pionieri anglo-americani. L'indagine e la demarcazione dei nuovi confini vennero condotte, tra il 1849 e il 1855, dal Commissario statunitense William Hemsley Emory e dalla sua controparte messicana José Salazar Ylarregui.

Transizione statunitense, speculazione e nascita delle infrastrutture (1850 - 1900)

Il 1850 fu un anno spartiacque: Los Angeles fu incorporata formalmente come municipalità e la California fu ammessa come trentesimo stato dell'Unione. Nonostante questa ufficializzazione, la città era ancora un remoto villaggio della costa occidentale, con una popolazione che nel 1870 ammontava ad appena 5.728 anime nel centro cittadino. Affinché potesse metamorfosarsi nel centro economico desiderato dai nuovi investitori immobiliari, era necessario superare tre limiti geografici formidabili: la carenza di approvvigionamenti idrici stabili, il totale isolamento dalle reti commerciali terrestri del paese e l'assenza di un vero porto in acque profonde. L'isolamento terrestre fu infranto grazie allo sviluppo ferroviario: la prima linea locale, la Los Angeles & San Pedro Railroad, entrò in funzione nel 1869, mentre nel 1881 la Southern Pacific Railroad completò il primo collegamento transcontinentale verso est, innestando saldamente la città nell'economia nazionale.

La vera esplosione demografica fu innescata dall'arrivo di una seconda linea transcontinentale, la Santa Fe Railroad, nel 1885. La fine del monopolio della Southern Pacific scatenò una spietata guerra delle tariffe per i passeggeri provenienti dal Midwest, tanto che nel 1886 il prezzo di un biglietto del treno da Kansas City a Los Angeles crollò temporaneamente alla cifra irrisoria di un solo dollaro. Questo fenomeno innescò un'enorme ondata migratoria, prevalentemente composta da protestanti bianchi del Midwest, generando il "Grande Boom degli Anni Ottanta" (The Great Boom of the Eighties). Questa sfrenata speculazione immobiliare raggiunse il suo apice tra il 1886 e il 1888, quando vasti appezzamenti derivati dai vecchi ranchos furono frettolosamente frammentati in lotti edificabili. Sebbene il boom immobiliare si sgonfiò alla fine del decennio provocando il collasso di molte fortune, le infrastrutture commerciali e la base demografica della futura megalopoli erano ormai saldamente stabilite.

Parallelamente al boom ferroviario, fu lanciata un'aggressiva campagna di pubbliche relazioni volta a inventare l'immagine di Los Angeles come paradiso terrestre. La neonata Camera di Commercio di Los Angeles, fondata nel 1888 e guidata da figure visionarie come Frank Wiggins, si dedicò scientificamente al boosterism urbano. Gli agenti immobiliari e i politici cittadini ignorarono deliberatamente le strade polverose e l'assenza di vita culturale del tempo, concentrandosi sulla commercializzazione del clima mediterraneo ideale e sulle infinite opportunità agricole. Wiggins ideò esposizioni spettacolari per impressionare l'Est, il cui culmine fu un gigantesco elefante a grandezza naturale costituito da 850 libbre di enormi noci californiane montate su una struttura metallica, presentato all'Esposizione Colombiana di Chicago del 1893, stabilendo un modello di marketing urbano tra i più fortunati della storia.

La stabilità economica della nascente metropoli poggiò ben presto su due straordinarie scoperte industriali: l'agricoltura su vasta scala e il petrolio. La coltivazione degli agrumi non fu solo un'industria, ma uno stile di vita e il simbolo della prosperità californiana. Partendo dalle prime coltivazioni dei missionari francescani, il settore fu rivoluzionato dall'introduzione dell'arancia di tipo "Washington Navel", nota per la sua fioritura invernale e per la buccia priva di semi. Per razionalizzare i profitti, i coltivatori crearono potenti cooperative come la Southern California Fruit Exchange nel 1893, che in seguito divenne il colosso "Sunkist". Dietro questa idilliaca cartolina agrumicola, si nascondeva tuttavia uno spietato sfruttamento della manodopera migratoria, spesso messicana, relegata a vivere in quartieri segregati chiamati colonias e sottoposta a condizioni di lavoro e salariali inique. La seconda rivoluzione fu quella petrolifera: nel febbraio del 1892, Edward Doheny e Charles A. Canfield scoprirono il petrolio all'interno degli stessi confini cittadini di Los Angeles, presso "Greasy Gulch". Nel giro di pochi mesi, il paesaggio urbano fu letteralmente invaso dalle torri di trivellazione, rendendo rapidamente la California il terzo stato produttore di greggio in America.

La sete e l'ingegneria: il conflitto idrico e william mulholland (1860-1928)

Se la ferrovia aveva portato la popolazione, l'infrastruttura per dissetare questa folla stava rapidamente collassando. Il sistema idrico originario, la Zanja Madre, pur essendo stato aggiornato dopo il 1884, era insufficiente e venne formalmente dismesso intorno al 1904. La sopravvivenza idrica passò quindi sotto il controllo municipale. Il 3 febbraio 1902, la città acquisì formalmente la proprietà del sistema idrico locale, ponendolo sotto la direzione del neo-costituito Los Angeles Department of Water and Power (LADWP). Alla guida vi era William Mulholland, un ingegnere civile autodidatta immigrato dall'Irlanda nel 1855, la cui fenomenale ascesa professionale era iniziata proprio con l'umile ruolo di Vice Zanjero a manutenzione della Zanja Madre. Mulholland comprese rapidamente che il fiume Los Angeles era incapace di sostenere le visioni espansionistiche della Camera di Commercio.

La soluzione immaginata e realizzata da Mulholland fu tra le più audaci della storia ingegneristica moderna: il Los Angeles Aqueduct. Concepito per trasportare acqua per scivolamento gravitazionale dalla remota Owens Valley fino alla San Fernando Valley, il progetto fu epico e controverso. I lavori iniziarono nel 1908 e, attraversando deserti e montagne per una lunghezza di 233 miglia, vennero completati il 5 novembre 1913. Alla memorabile cerimonia di inaugurazione, osservando le acque precipitarsi nella valle, Mulholland pronunciò la leggendaria frase: "There it is. Take it". Il possesso esclusivo di diritti idrici divenne uno strumento di espansione geopolitica urbana, costringendo municipalità indipendenti come Hollywood a votare per l'annessione alla città di Los Angeles pur di accedere alla preziosa risorsa, determinando la conformazione diffusa della Los Angeles moderna.

Tuttavia, l'impatto ambientale e sociale dell'acquedotto fu disastroso per le comunità d'origine dell'acqua. Il prelievo prosciugò progressivamente il lago Owens e distrusse l'economia agricola locale, innescando le celebri "Guerre dell'Acqua della California", un decennio di aspre dispute legali e sabotaggi dinamitardi da parte degli agricoltori espropriati della Owens Valley contro le infrastrutture del LADWP. Il declino della carriera di Mulholland fu tanto teatrale quanto la sua ascesa: il 12 marzo 1928, appena poche ore dopo che l'ingegnere aveva effettuato un'ispezione di sicurezza dichiarandola stabile, la diga di St. Francis cedette catastroficamente. Il crollo riversò milioni di galloni d'acqua nella valle di Santa Clara, uccidendo centinaia di persone nel peggior disastro antropogenico del Ventesimo secolo in America, oscurando permanentemente il lascito dell'uomo che aveva "creato" la Los Angeles moderna.

Trasporto pubblico e costruzione dell'immagine: dai red cars alle palme (1900-1940)

Se l'acqua fornì il carburante biologico per l'espansione, i mezzi di trasporto ne dettarono la morfologia. L'immagine di Los Angeles come utopia esclusivamente legata all'automobile maschera un paradosso storico: all'inizio del Novecento, l'area metropolitana di Los Angeles vantava il sistema di trasporto di massa elettrico più esteso del mondo. Fondata nel 1901 per volere del magnate Henry E. Huntington e consolidata attraverso la "Great Merger" del 1911, la Pacific Electric Railway Company gestiva la leggendaria rete dei "Red Cars". Questa vasta ragnatela di tram elettrici urbani e interurbani arrivò a operare su oltre 1.000 miglia di binari, connettendo in modo capillare le nascenti comunità suburbane nelle contee di Los Angeles, Orange, San Bernardino e Riverside.

Nonostante la formidabile capillarità, il sistema celava un fine prettamente speculativo. Huntington era in primo luogo uno speculatore immobiliare: la funzione primaria dei "Red Cars" non era l'erogazione di un servizio pubblico, ma l'aumento del valore delle estese proprietà fondiarie periferiche in suo possesso. I binari venivano posati verso terreni non ancora sviluppati; una volta lottizzati e venduti gli immobili lungo i tracciati, l'interesse per la manutenzione e il potenziamento del servizio declinava vertiginosamente. L'uso dei Red Cars conobbe un picco senza precedenti durante il boom demografico della Seconda Guerra Mondiale, con stime fino a 100 milioni di corse annuali, a causa del razionamento della benzina e degli pneumatici. Tuttavia, nel dopoguerra, il sistema iniziò un declino irreversibile. Negli anni Cinquanta, i massicci investimenti statali e federali in autostrade pubbliche a scapito dei trasporti su ferro, la pianificazione urbana subordinata al veicolo privato e la vendita della rete ai consorzi di autobus portarono alla chiusura definitiva della rete passeggeri nel 1961. Le storiche vetture rosse finirono accatastate ad arrugginire a Terminal Island, suggellando il passaggio definitivo di Los Angeles a icona planetaria della car culture.

Nel mezzo della Grande Depressione, le élite locali compresero l'urgente necessità di solidificare l'immagine di Los Angeles a livello globale con l'assegnazione dei Giochi della Decima Olimpiade del 1932. A dispetto delle previsioni pessimistiche dovute al collasso finanziario mondiale, l'evento si rivelò uno straordinario trionfo organizzativo ed economico, generando un profitto di un milione di dollari. Più importante del bilancio finanziario fu l'impronta urbanistica ed estetica che la città ricevette. In previsione dei Giochi, con l'obiettivo collaterale di fornire impiego ai migliaia di disoccupati della Depressione, la città finanziò una ciclopica operazione di abbellimento paesaggistico: ben 30.000 palme vennero piantate metodicamente lungo i grandi boulevard e all'interno del Rose Garden di Exposition Park. Dal punto di vista semantico e cinematografico, l'investimento fu un colpo di genio: le fronde fluttuanti contro il cielo azzurro divennero il simbolo incancellabile della golden state, un feticcio esotico che associava la città alla prosperità, al benessere e a un eterno riposo vacanziero.

L'arsenale della democrazia e la metropoli aerospaziale (1940-1980)

L'illusione hollywoodiana della città delle palme si fuse bruscamente con le esigenze geopolitiche americane in seguito allo scoppio della Seconda Guerra Mondiale, innescando un boom industriale senza precedenti che avrebbe definitivamente alterato la demografia e la geografia della regione. L'industria manifatturiera aeronautica e della difesa, attratta in California fin dagli anni Venti e Trenta dalle condizioni meteorologiche ideali per i collaudi e dall'ampia disponibilità di suolo edificabile, divenne l'asse portante dell'economia. Società come Lockheed, Northrop e Hughes stabilirono i propri quartier generali nell'area. Durante il solo conflitto mondiale, gli impianti di Los Angeles impiegarono circa 2 milioni di lavoratori e assemblarono la sbalorditiva cifra di 300.000 aeroplani.

Questa spaventosa domanda di manodopera agì come un magnete per la popolazione civile. I lavoratori provenienti da ogni parte degli Stati Uniti affluirono nel sud della California, facendo crescere la popolazione della Contea di Los Angeles da 2,78 milioni nel 1940 a 4,15 milioni nel 1950, fino a 6,03 milioni nel 1960. Per far fronte a un aumento demografico così esplosivo, i campi coltivati di agrumi e noci vennero convertiti freneticamente in immensi quartieri di case unifamiliari. L'occupazione aerospaziale continuò a fungere da spina dorsale dell'economia anche dopo il conflitto, impiegando, per tutti gli anni Cinquanta e Sessanta, oltre il 40% degli operai manifatturieri della contea. Le esigenze tattiche della Guerra Fredda trasformarono l'industria dei velivoli a reazione in una complessa rete dedicata all'esplorazione spaziale e alla produzione di missili balistici. Downey divenne il centro di assemblaggio dei moduli di comando dell'Apollo, e il Jet Propulsion Laboratory (JPL) di La Cañada Flintridge divenne preminente nello sviluppo dell'esplorazione spaziale robotica. Entro il 1980, circa il 40% di tutte le aziende aerospaziali degli Stati Uniti manteneva la propria sede centrale nel sud della California.

Il volto oscuro del "sogno": rinnovamento urbano e tensioni etniche (1940-1992)

L'edificazione di un impero economico basato sulle automobili, sugli aeroplani e sull'immagine non fu un processo inclusivo. La storia di Los Angeles del Ventesimo secolo è profondamente sfregiata dall'alienazione e dallo sfollamento sistematico delle popolazioni minoritarie. Mentre l'apparato industriale ferveva a favore dello sforzo bellico, sul fronte interno divampava la violenza a sfondo razziale. Connesso al fenomeno dell'immigrazione messicana e all'affermazione di una nuova identità culturale ibrida, sorse il movimento giovanile dei Pachucos, ragazzi messicano-americani che vestivano abiti di sartoria caratterizzati da pantaloni a sbuffo e giacche con spalle larghissime noti come "zoot suits". I media locali dell'epoca dipingevano i giovani zoot-suiters come devianti sociali e non patriottici, poiché i loro abiti ampi violavano le regole di razionamento dei tessuti in tempo di guerra.

Questo clima di xenofobia culminò all'inizio di giugno 1943 in una serie di attacchi violentissimi passati alla storia come gli "Zoot Suit Riots". Intere guarnigioni di marinai e militari statunitensi bianchi in licenza si organizzarono in squadracce punitive, invadendo le enclavi ispaniche di East Los Angeles. I giovani messicani furono selvaggiamente pestati, svestiti e i loro abiti furono bruciati per strada. La risposta istituzionale palesò il razzismo strutturale: il Los Angeles Police Department (LAPD) spesso assecondò gli attacchi, arrestando le vittime messicano-americane per disturbo della quiete pubblica. Il Consiglio Comunale si limitò a vietare formalmente di indossare gli "zoot suits" in pubblico. Solo a ottant'anni di distanza, nel 2023, la Contea di Los Angeles ha ufficialmente emesso scuse pubbliche e condannato gli atti perpetrati all'epoca.

Negli anni Cinquanta, la pianificazione urbana si rivolse al cuore della città con progetti monumentali sostenuti dalle leggi sull'Urban Renewal e dall'esproprio statale (Eminent Domain). Il caso di Bunker Hill fu paradigmatico: originariamente un esclusivo sobborgo collinare adornato di magnifiche magioni in stile vittoriano, con lo spostamento delle élite economiche verso ovest i vasti palazzi furono frazionati in pensioni sovraffollate che diventarono rifugio per migliaia di immigrati europei, ispanici e minoranze disagiate. Denunciato come slum intollerabile, l'intero distretto fu acquisito, sventrato dalle ruspe e livellato altimetricamente. Nel 1958, le circa 6.000 anime residenti furono costrette all'evacuazione senza reali opzioni di ricollocamento. Al loro posto, in decenni di lavori, sorsero le moderne corporazioni del distretto finanziario del Downtown.

Ancora più traumatico fu l'epilogo di Chavez Ravine, una profonda valle vicina al centro abitata da tre fiorenti comunità messicano-americane (Palo Verde, La Loma e Bishop). I residenti furono inizialmente espropriati delle loro abitazioni all'inizio degli anni Cinquanta sulla base di promesse, poi ritirate, riguardanti la costruzione del massiccio progetto abitativo pubblico "Elysian Park Heights". La paralisi politica bloccò il progetto abitativo. Infine, in un celebre e controverso accordo a porte chiuse tra la città e l'imprenditore Walter O'Malley, le decine di acri di terra svuotate dagli abitanti a bassissimo costo furono devolute alla costruzione dell'imponente Dodger Stadium per attrarre la franchigia di baseball dei Brooklyn Dodgers a Los Angeles, sradicando irreversibilmente le comunità originarie.

La marginalizzazione geografica e la violenza poliziesca innescarono reazioni sociali violente, tra cui spiccano i devastanti Riot di Watts del 1965, esplosi nel cuore della periferia sud-centrale della metropoli per l'insostenibile segregazione della comunità afroamericana. Il clima di tensione generale subì la deflagrazione decisiva con l'esplosione dei Riot di Los Angeles del marzo-aprile 1992, susseguenti all'assoluzione degli agenti del LAPD videoregistrati mentre pestavano brutalmente l'automobilista nero Rodney King. Questo evento portò alla costituzione delle commissioni indipendenti Christopher e Kolts, che scoperchiarono decenni di culture organizzative intrise di abusi a sfondo razzista incistate nelle forze dell'ordine metropolitano.

Rinascita post-industriale e la confluenza tecnologica (1984 - 2026)

Con la conclusione della Guerra Fredda all'inizio degli anni Novanta, l'influsso governativo alla base del complesso aerospaziale subì drastici tagli, lasciando migliaia di dipendenti altamente specializzati disoccupati. Los Angeles dovette necessariamente reinventarsi, trovando ispirazione in un nuovo modello finanziario per i megaeventi sportivi e gettando i semi per l'industria digitale del Ventesimo secolo. L'assegnazione dei Giochi della XXIII Olimpiade del 1984 giunse in un momento in cui l'interesse per il movimento olimpico era ai minimi storici. Il comitato organizzatore, presieduto da Peter Ueberroth, impostò l'evento non sulla costruzione speculativa di nuovi e dispendiosi stadi, bensì sull'utilizzo di impianti esistenti distribuiti su tutta la Contea, implementando un sofisticato modello di sponsorizzazione aziendale. Il risultato fu un'anomalia assoluta: le Olimpiadi del 1984 generarono un sorprendente profitto netto di oltre 235 milioni di dollari.

Nel ventunesimo secolo, la città di Los Angeles è stata assorbita e rimodellata dall'economia digitale, dando origine a un polo industriale costiero battezzato "Silicon Beach". La genesi affonda le sue radici infrastrutturali nel 1972, quando l'USC istituì il cruciale Information Sciences Institute (ISI) presso Marina del Rey, contribuendo materialmente alla costruzione di Arpanet. La moderna impennata dell'industria digitale ha preso avvio nel 2003 con lo sbarco a Santa Monica di Google, seguita da importanti sviluppatori del settore videoludico come Activision Blizzard. Nel 2011, Google ha rilevato a Venice l'iconico Binoculars Building, progettato da Frank Gehry; in seguito, nel 2018, si è mossa verso l'adiacente Playa Vista riadattando l'hangar aeronautico in legno anni Quaranta dello storico velivolo Hughes H-4 "Spruce Goose".

Silicon Beach comprende oggi oltre 500 compagnie operative. Piattaforme digitali come Snap, TikTok e Amazon hanno calamitato decine di miliardi in venture capital, cementando la supremazia californiana nella cosiddetta "confluenza tecnologica", che mescola realtà virtuale, nuovi algoritmi e l'inossidabile settore narrativo hollywoodiano. Nel 2024, la metropoli è divenuta il terzo ecosistema di start-up e polo di impiego hi-tech più denso della nazione americana, con circa 375.000 lavoratori impiegati. Tuttavia, queste aziende, attratte e prosperate in sobborghi limitati da strette regolamentazioni urbanistiche in altezza, spingono al rialzo patologico il valore degli affitti, esacerbando le espulsioni dei ceti medio-bassi e stimolando il movimento delle compagnie verso confini inesplorati.

Il futuro tra gentrificazione e giochi olimpici (2028 e oltre)

Guardando all'orizzonte del Terzo Millennio, Los Angeles si confronta di nuovo con l'onere e l'opportunità offerta dalla preparazione del megaevento per eccellenza: le Olimpiadi Estive di LA 2028, in cui diventerà la terza città a ospitare per tre volte la manifestazione. Paradossalmente, i tentativi di mitigare l'antica dipendenza veicolare attraverso l'investimento multimiliardario nella linea LA Metro hanno accelerato l'allontanamento delle classi a basso reddito. Dati forniti dall'Urban Displacement Project della UCLA rilevano che, in quartieri molto collegati, la vicinanza a stazioni ferroviarie in via di sviluppo predice inneschi speculativi immobiliari vertiginosi. I locatari meno abbienti, che rappresentano il 73% dell'effettiva utenza metropolitana, si ritrovano sradicati dal quartiere per l'incapacità di sopportare l'aumento medio degli affitti, sostituiti poi da residenti a reddito più alto che preferiscono usare i mezzi privati.

Per colmare decenni di lassismo nel trasporto pubblico, le autorità e LA Metro hanno presentato l'aggressivo manifesto programmatico denominato "Twenty-Eight by '28". L'iniziativa stanzia circa 20 miliardi di dollari per accelerare la consegna e finalizzazione di 28 imponenti progetti di trasporto regionale entro il taglio del nastro olimpico del 2028. Tale piano mira in modo perentorio a organizzare un modello olimpico "transit-first", esclusivamente gestito con trasporti collettivi, vietando le auto personali nei perimetri dei siti di gara. Gli interventi includono estensioni ferroviarie come la Linea K (completata nell'ottobre 2022), il Regional Connector (completato nel 2023), l'estensione della Subway Linea D a Westwood (attesa nel 2026), corridoi autostradali express, Bus Rapid Transit e una logistica straordinaria con oltre 2.700 nuovi autobus a emissioni zero.

Il piano del Metro non è mirato semplicemente allo show di 60 giorni, ma intende imprimere una svolta che disincentivi il pendolarismo monoposto nel futuro della contea. Il rinnovo architettonico di avvicinamento al 2028 implica di reimmaginare l'idrologia del paesaggio. Con gli investimenti del provvedimento Measure W, gli inquinati letti in calcestruzzo del Los Angeles River sono oggetto di rinaturalizzazione, mentre le tecniche edilizie di "Low Impact Development" (LID) implementano biofiltri e trincee drenanti permeabili, culminanti nell'idea del "Decentral Park" diffuso, per recuperare l'acqua piovana di scolo anziché sversarla nell'oceano, mitigando l'impatto ecologico.

Nell'intricato panorama delle grandi metropoli del globo, l'analisi storica, geografica e demografica di Los Angeles invalida l'idea di un'esplosione spontanea dovuta a fattori ambientali. La nozione ideologica "Quando l'America era grande", riletta in questo frammento d'Occidente, descrive in realtà l'esercizio prolungato, tenace e a tratti distruttivo del potere sull'ambiente, sui sistemi idrici e sui popoli da parte di una società affamata di crescita. Los Angeles è stata brutalmente edificata sfruttando il genio di speculatori capaci di prosciugare bacini idrografici distanti oltre 200 miglia, posando linee ferroviarie per valorizzare latifondi agricoli, e confezionando campagne di manipolazione pubblica in grado di convertire gli agrumeti intrisi del sudore delle colonie ispaniche in un paradiso della classe media protestante. La grandezza, allora, non riposa in un momento cristallizzato della Guerra Fredda, ma continua a fluire irrequieta, stratificandosi sui complessi livelli urbani che hanno partorito e sorreggono per sempre la Città degli Angeli.

Ricostruzione AI

Di Alex (pubblicato @ 15:00:00 in Amici animali, letto 427 volte)

Il Parco Natura Viva di Bussolengo con gli animali negli ampi spazi naturali e le colline moreniche sullo sfondo

Il Parco Natura Viva di Bussolengo si configura come uno dei centri di eccellenza europei per la conservazione delle specie minacciate. Fondato ufficialmente nel 1969, il parco ha saputo trasformarsi da esposizione zoologica a moderno centro di ricerca, partecipando attivamente a programmi internazionali di tutela della biodiversità e reintroduzione in natura, con un approccio scientifico che pone al centro il benessere animale e la conservazione ex-situ. LEGGI TUTTO L'ARTICOLO

Struttura del parco e aree tematiche

Il Parco Natura Viva si estende su 42 ettari di colline moreniche e boschi di querce, un ambiente naturale che riproduce fedelmente gli habitat originari delle specie ospitate, offrendo un'esperienza immersiva suddivisa in due percorsi principali che richiedono mediamente oltre mezza giornata per una visita completa. Nel 2026, l'offerta del parco si è ulteriormente arricchita con l'apertura del nuovo habitat sudamericano "Pantanal", un progetto ambizioso progettato per ospitare convivenze multispecie che replicano le complesse relazioni ecologiche delle zone umide del Mato Grosso brasiliano, tra cui l'unico esemplare di formichiere gigante presente in Italia, un animale particolarmente esigente in termini di spazio e alimentazione. L'area Africa Safari rappresenta un percorso da compiere a bordo della propria auto o su bus guidati, dove animali come giraffe, leoni, zebre e rinoceronti bianchi vivono in ampi spazi aperti senza barriere visive tradizionali, consentendo ai visitatori di osservare comportamenti naturali che difficilmente si potrebbero apprezzare in contesti più ristretti. Questa sezione del parco si estende su una superficie di oltre 25 ettari e ospita branchie di erbivori africani che vivono in condizioni di semilibertà, con programmi di alimentazione e cure veterinarie che garantiscono il massimo benessere possibile nel rispetto delle esigenze comportamentali di ciascuna specie. Il Percorso Faunistico è invece una sezione pedonale organizzata per continenti che ospita circa 1.500 animali di 200 specie diverse, tra cui la tigre siberiana, il panda rosso e il leopardo delle nevi, tutti inseriti in programmi europei di conservazione. La House of Giants è un padiglione tematico dedicato ai concetti di gigantismo e nanismo in natura, dove i visitatori possono osservare da vicino draghi di Komodo, anaconde verdi e coccodrilli nani africani, accompagnati da pannelli informativi che illustrano le strategie evolutive alla base delle diverse dimensioni corporee. L'Extinction Park rappresenta infine un'area educativa di grande impatto emotivo, che utilizza ricostruzioni a grandezza naturale di dinosauri e specie estinte in epoca storica, come il dodo dell'isola Mauritius o la tigre dai denti a sciabola, per illustrare le dinamiche delle estinzioni di massa e sensibilizzare i visitatori sull'urgenza della conservazione della biodiversità attuale.

Progetti di conservazione e reintroduzione (EEP)

Il cuore scientifico del Parco Natura Viva risiede nei 25 progetti di conservazione e nei 6 progetti di reintroduzione coordinati a livello globale attraverso i programmi EEP, l'acronimo di European Endangered Species Programme gestito dall'Associazione Europea degli Zoo e degli Acquari. Gli animali ospitati non vengono prelevati dalla natura, ma provengono da scambi controllati tra zoo che aderiscono a questi programmi, garantendo la conservazione della diversità genetica e la sostenibilità delle popolazioni in cattività senza impattare sulle popolazioni selvatiche. Il bisonte europeo rappresenta uno dei più grandi successi di questo approccio: grazie a decenni di programmi di riproduzione in cattività e successive reintroduzioni, la specie è stata salvata dall'estinzione completa e oggi conta popolazioni selvatiche stabili in Romania e Polonia, incrementate grazie agli esemplari nati proprio all'interno del parco veronese. L'ibis eremita è invece oggetto di un programma di migrazione assistita particolarmente innovativo, che utilizza ultraleggeri per insegnare agli uccelli nati in cattività le rotte migratorie storiche tra l'Europa centrale e le aree di svernamento in Toscana, ripristinando un percorso migratorio scomparso da secoli a causa della caccia e della distruzione degli habitat. Per il gipeto e il grifone, il parco fornisce supporto alle colonie selvatiche attraverso la liberazione programmata di giovani individui nelle Alpi e in Sardegna, contribuendo al ripopolamento di aree da cui queste specie erano scomparse a causa dell'avvelenamento secondario e della persecuzione diretta. Il formichiere gigante, specie classificata come vulnerabile dalla Lista Rossa IUCN, è stato recentemente introdotto nel nuovo habitat Pantanal non solo per scopi didattici ma anche come parte di un programma di studio del comportamento riproduttivo che potrebbe in futuro supportare progetti di reintroduzione in Sud America. L'attività del parco è supportata da servizi educativi integrati gestiti in collaborazione con Biosphaera, una cooperativa sociale specializzata in educazione ambientale, che porta l'educazione alla biodiversità direttamente nelle scuole dell'infanzia, primarie e secondarie, raggiungendo ogni anno decine di migliaia di studenti con laboratori interattivi e percorsi didattici strutturati.

Record di presenze e ruolo nella conservazione europea

Il successo del modello di gestione del Parco Natura Viva è testimoniato dai numeri da record registrati nel 2025, che hanno consolidato il ruolo della struttura come leader nazionale nella tutela della fauna selvatica e come destinazione turistica di eccellenza nel panorama italiano. L'afflusso di visitatori ha superato le 400.000 unità nell'ultimo anno, con un incremento significativo rispetto ai periodi precedenti, trainato dall'apertura delle nuove aree tematiche e dal crescente interesse del pubblico per le tematiche legate alla conservazione ambientale e al turismo sostenibile. Il parco ha inoltre rafforzato la propria rete di collaborazioni scientifiche internazionali, entrando a far parte di consorzi di ricerca che studiano il comportamento animale in cattività e sviluppano protocolli per la reintroduzione delle specie minacciate nei loro habitat originari. Particolare attenzione è dedicata alla formazione delle nuove generazioni di biologi e veterinari specializzati in fauna selvatica: il parco ospita ogni anno stagisti e ricercatori provenienti da università italiane e straniere, offrendo loro l'opportunità di acquisire competenze pratiche nella gestione delle popolazioni animali e nei programmi di conservazione ex-situ. L'impegno del Parco Natura Viva si estende anche alla sensibilizzazione del grande pubblico sulle minacce globali alla biodiversità, attraverso campagne di comunicazione che affrontano temi come il commercio illegale di specie protette, la deforestazione tropicale e l'impatto del cambiamento climatico sugli ecosistemi più fragili. In un'epoca caratterizzata dalla sesta estinzione di massa, il ruolo dei parchi zoologici moderni come centri di conservazione, ricerca ed educazione diventa sempre più cruciale per invertire la tendenza al declino della biodiversità e per preservare per le future generazioni il patrimonio naturale del pianeta.

Il Parco Natura Viva rappresenta un esempio virtuoso di come le strutture zoologiche possano evolversi da semplici esposizioni di animali a centri polifunzionali al servizio della conservazione della biodiversità. Attraverso un approccio integrato che combina ricerca scientifica, programmi di reintroduzione, educazione ambientale e turismo sostenibile, il parco dimostra che è possibile conciliare la fruizione pubblica con l'impegno concreto per la tutela delle specie più minacciate, offrendo un modello replicabile in altri contesti nazionali e internazionali.

Di Alex (pubblicato @ 14:00:00 in Geopolitica e tecnologia, letto 556 volte)

Manifestanti a Roma durante il No Kings Day contro le politiche migratorie e l'amministrazione USA.

Il 28 marzo 2026 segna un punto di rottura globale: mentre 3.300 città americane sono insorte nel "No Kings Day", a Roma la protesta si fonde con le critiche al governo italiano. Dietro le quinte, miliardi di dollari della filantropia progressista muovono una macchina organizzativa senza precedenti, mentre il bilancio delle vittime nelle operazioni ICE raggiunge record tragici.

Il declino democratico e la rivolta globale

Gli Stati Uniti non sono più la "città splendente sulla collina". Secondo gli ultimi dati del Democracy Report, per la prima volta in mezzo secolo, gli USA hanno perso lo status di democrazia liberale, retrocedendo a parametri paragonabili a quelli del 1965. Questa erosione istituzionale ha scatenato il "No Kings Day", una mobilitazione oceanica che ha visto la partecipazione di milioni di persone. La protesta non è più confinata nelle enclave progressiste: il 66% degli eventi si svolge in territori conservatori, segnando una penetrazione del dissenso nel cuore profondo dell'America.

La piazza di Roma: tra solidarietà e critica locale

L'onda d'urto è arrivata nella Capitale. Sotto lo slogan "Together", una vasta rete di associazioni, sindacati e ONG ha sfilato da Piazza della Repubblica. La piazza romana ha operato una fusione tattica: la solidarietà ai movimenti anti-autoritari americani si è intrecciata con la ferma condanna delle politiche migratorie italiane. Nel mirino dei manifestanti sono finiti i protocolli di esternalizzazione delle frontiere — con riferimenti espliciti agli accordi con Albania, Libia e Tunisia — e i recenti decreti sicurezza, letti come una limitazione dell'agibilità democratica nel nostro Paese.

La "Longa Manus": l'infrastruttura del dissenso

Dietro la spontaneità delle piazze emerge un apparato logistico monumentale, definito dagli analisti come il "Complesso Industriale della Protesta". L'Indivisible Project, motore della mobilitazione, risulta beneficiario di oltre 7,6 milioni di dollari erogati dalla Open Society Foundations di George Soros. Questa rete, foraggiata anche dalle fondazioni Ford e Tides, gestisce capitali superiori ai 400 milioni di dollari, garantendo una capacità di sfida legale e mediatica che paralizza l'azione del governo federale e alimenta lo scontro istituzionale al Congresso.

Militarizzazione e vittime: il bilancio di sangue

Il cuore oscuro di questa crisi è rappresentato dalle operazioni dell'ICE. Con il lancio della "Operation Metro Surge", il Minnesota è diventato un campo di battaglia urbano. La militarizzazione ha portato a tragici omicidi extragiudiziali, come quelli dei cittadini americani Renée Good e Alex Pretti, uccisi in circostanze che le autorità federali hanno tentato di occultare. All'interno dei centri di detenzione, la situazione è catastrofica: nel 2025 sono stati registrati 33 decessi, il record più alto dal 2004, mentre il primo trimestre del 2026 conta già 13 vittime. Report indipendenti confermano che il 95% di queste morti sarebbe stato evitabile con cure mediche basilari.

L'intreccio tra il collasso delle garanzie legali e la risposta monumentale del dissenso globalizzato delinea i contorni di uno scontro finale per l'egemonia sui poteri costituzionali. Mentre le strade si riempiono, il futuro dell'architettura democratica occidentale sembra decidersi nel sangue versato nelle strutture detentive e nella determinazione di chi rifiuta ogni forma di nuova oligarchia.

Di Alex (pubblicato @ 13:00:00 in Nuove Tecnologie, letto 613 volte)

Rappresentazione artistica di un chip neuromorfico con sinapsi artificiali e neuroni elettronici interconnessi

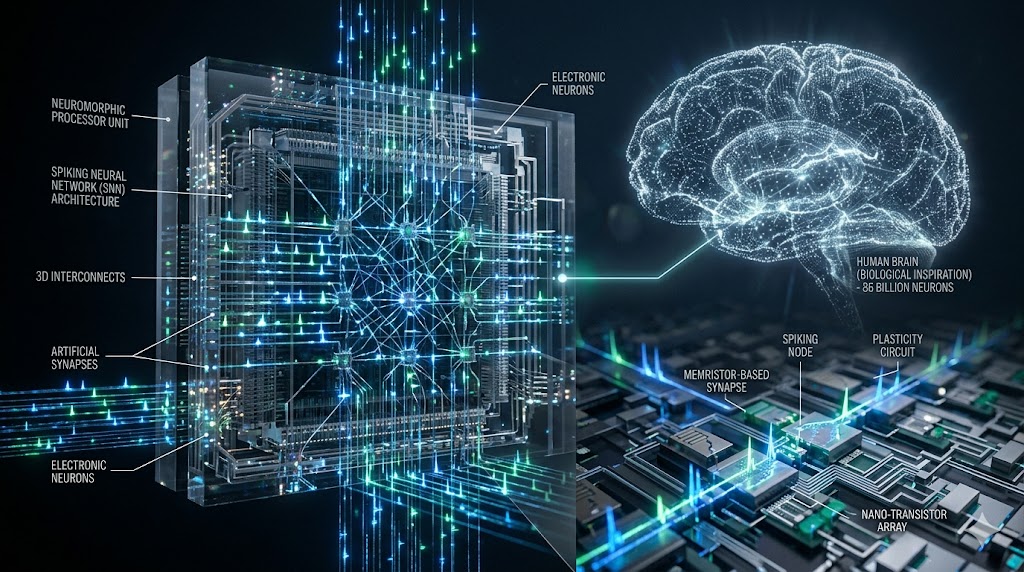

Il calcolo neuromorfico rappresenta una rottura radicale rispetto all'architettura di von Neumann che ha dominato l'informatica per oltre settant'anni. Ispirati dal cervello umano, che consuma circa 20 Watt per alimentare 86 miliardi di neuroni, i chip neuromorfici promettono un'efficienza energetica frazionale rispetto alle GPU tradizionali, aprendo la strada all'intelligenza artificiale complessa direttamente all'interno di dispositivi mobili a bassa potenza. LEGGI TUTTO L'ARTICOLO

Meccanismi operativi: snn e event-driven processing

A differenza dei processori convenzionali che operano con clock sincroni e seguono l'architettura di von Neumann che separa fisicamente la memoria dall'unità di elaborazione, i sistemi neuromorfici utilizzano le Spiking Neural Networks, comunemente abbreviate in SNN, un paradigma computazionale che replica fedelmente il funzionamento dei neuroni biologici. In queste reti neurali di nuova concezione, le informazioni non vengono trasmesse come valori continui attraverso moltiplicazioni matriciali ad alta intensità computazionale, ma attraverso brevi impulsi elettrici chiamati "spikes", che simulano i potenziali d'azione dei neuroni naturali. Il sistema opera secondo una logica "event-driven": i neuroni artificiali rimangono in uno stato di quiescenza consumando energia solo per mantenere il potenziale di membrana, e si attivano esclusivamente quando ricevono uno stimolo specifico che supera una soglia predefinita, riducendo drasticamente il consumo energetico soprattutto in scenari a bassa attività o con ingressi sparsi, che rappresentano la stragrande maggioranza delle situazioni reali. L'integrazione di calcolo e memoria, nota in letteratura come Compute-in-Memory o CIM, elimina il collo di bottiglia che ha afflitto l'architettura di von Neumann per decenni, ovvero lo spostamento continuo di dati tra processore e RAM, un processo che nei sistemi tradizionali consuma la maggior parte dell'energia e rappresenta il principale limite alle prestazioni per le applicazioni di intelligenza artificiale. Questa innovazione architetturale consente un'efficienza energetica teorica superiore di diversi ordini di grandezza rispetto ai sistemi tradizionali, con stime che indicano un miglioramento potenziale fino a mille volte per specifiche classi di problemi, un vantaggio talmente significativo da giustificare gli ingenti investimenti in ricerca e sviluppo che aziende come Intel, IBM e numerose startup stanno dedicando a questa tecnologia emergente.

Stato dell'arte nel 2026: loihi 3 e northpole

Nel corso del 2026, lo sviluppo hardware nel settore neuromorfico ha visto emergere soluzioni sempre più mature, con giganti come Intel e IBM che hanno presentato processori pronti per il mercato industriale e consumer, segnando il passaggio dalla ricerca accademica alla commercializzazione su larga scala. L'Intel Loihi 3 rappresenta la terza generazione della piattaforma neuromorfica di Intel, integrando 8 milioni di neuroni in un singolo chip realizzato con processo produttivo a 4 nanometri, uno dei più avanzati attualmente disponibili nell'industria dei semiconduttori. La caratteristica più innovativa del Loihi 3 è l'introduzione dei "graded spikes", impulsi a 32 bit che trasportano informazioni multidimensionali in un singolo evento sinaptico, colmando il divario prestazionale tra le reti neurali profonde tradizionali e l'efficienza delle SNN e consentendo di eseguire su architetture neuromorfiche modelli di intelligenza artificiale precedentemente accessibili solo a costose GPU. IBM ha invece puntato su un approccio diverso con NorthPole, un processore che spinge al limite il concetto di co-locazione di memoria e calcolo, integrando 256 core su un singolo die con una gerarchia di memoria ottimizzata per le operazioni di inferenza delle reti neurali, ottenendo prestazioni particolarmente brillanti nei benchmark di visione artificiale per applicazioni enterprise e nel settore della difesa. Nel panorama delle startup, BrainChip ha consolidato la propria posizione con Akida Pulsar, un processore che vanta un consumo energetico 500 volte inferiore a quello delle GPU equivalenti, posizionandosi come soluzione ideale per l'IoT sempre attivo e per i sensori intelligenti che devono operare per anni con batterie di piccole dimensioni. Innatera, un'azienda europea emersa dal Politecnico di Delft, ha sviluppato il processore T1, una soluzione sub-milliwatt progettata specificamente per applicazioni su sensori audio e visione in dispositivi indossabili e per il monitoraggio sanitario continuo, dimostrando come il settore stia rapidamente diversificandosi per rispondere alle esigenze di mercati verticali molto differenziati tra loro.

Impatto sui dispositivi mobili e la robotica

Nel 2026, l'integrazione di chip neuromorfici negli smartphone di fascia alta ha abilitato funzionalità prima impensabili su dispositivi a batteria, come il riconoscimento vocale continuo e l'elaborazione biometrica in tempo reale senza drenare la batteria nel giro di poche ore, risolvendo uno dei principali problemi di usabilità che affliggevano le prime implementazioni di intelligenza artificiale su dispositivi mobili. Tuttavia, è nel settore della robotica che la tecnologia neuromorfica ha mostrato il suo impatto più profondo e potenzialmente rivoluzionario, consentendo lo sviluppo di robot autonomi capaci di operare per periodi prolungati senza necessità di ricarica e di reagire agli stimoli ambientali con latenze impossibili da ottenere con architetture tradizionali. Il robot quadrupede ANYmal D Neuro, equipaggiato con il chip Loihi 3 di Intel, ha dimostrato in test sul campo un'autonomia di 72 ore di funzionamento continuo in condizioni operative reali, un miglioramento di nove volte rispetto ai modelli precedenti alimentati da GPU che richiedevano ricariche frequenti e limitavano l'operatività in ambienti remoti o difficilmente accessibili. La latenza "quasi zero" garantita dall'elaborazione event-driven è diventata un requisito fondamentale per i sistemi di frenata autonoma in aziende automobilistiche come Mercedes-Benz e BMW, dove i chip neuromorfici processano i dati provenienti dalle "event cameras", sensori che rilevano le variazioni di luminosità pixel per pixel con tempi di risposta nell'ordine dei microsecondi, in millisecondi, reagendo agli ostacoli molto prima che un frame video tradizionale possa essere bufferizzato, trasmesso e analizzato dai sistemi di visione convenzionali. Le prospettive future per questa tecnologia sono estremamente promettenti: secondo le proiezioni degli analisti del settore, entro il 2030 si prevede che almeno il 30 percento dei dispositivi Edge AI, ovvero quelli che eseguono modelli di intelligenza artificiale localmente senza connettersi al cloud, sarà alimentato da tecnologie neuromorfiche, segnando il passaggio definitivo dall'era della forza bruta computazionale, caratterizzata da consumi energetici insostenibili e latenze elevate, a quella dell'efficienza biologica applicata al silicio, che promette di portare l'intelligenza artificiale ovunque, in modo pervasivo ed efficiente.

Il calcolo neuromorfico rappresenta una delle più promettenti frontiere dell'innovazione informatica, con il potenziale di rivoluzionare non solo l'efficienza energetica dei sistemi intelligenti ma anche il modo stesso di concepire l'architettura dei computer. Ispirandosi al cervello umano, che rimane il sistema di elaborazione più efficiente mai esistito, i chip neuromorfici ci ricordano che l'evoluzione tecnologica non procede necessariamente verso una maggiore complessità computazionale fine a se stessa, ma può trarre insegnamenti preziosi dalla natura, che ha già risolto, attraverso milioni di anni di evoluzione, molti dei problemi che l'ingegneria umana sta ancora imparando a gestire.

Di Alex (pubblicato @ 12:00:00 in Storia Medioevo, letto 436 volte)

Panorama di Montepulciano con le mura medievali e la campagna circostante della Val d'Orcia

Montepulciano sorge su una dorsale calcarea che domina la Val d'Orcia e la Valdichiana, una posizione strategica che ne ha definito l'assetto urbano come "città-fortezza" dedita al controllo del territorio. Sebbene il volto odierno della città sia marcatamente rinascimentale, con palazzi nobiliari e chiese monumentali, la sua struttura profonda rivela una radice medievale forgiata dalle dispute comunali per il controllo delle risorse agrarie. LEGGI TUTTO L'ARTICOLO

Genesi storica e disputa tra potenze

Le origini di Montepulciano risalgono all'epoca etrusca, con evidenze archeologiche che attestano insediamenti stabili già nel quarto secolo avanti Cristo. Il nome stesso della città deriva probabilmente dalla deformazione del termine etrusco "purth", indicante un comandante o un generale militare, a testimonianza della vocazione strategica del sito fin dalle sue origini più antiche. Durante il periodo romano, il territorio fu interessato da un processo di centuriazione e sfruttamento agricolo che lasciò tracce ancora oggi riconoscibili nella maglia agraria della Valdichiana. Tuttavia, è nel Medioevo che il borgo assume un ruolo cruciale come "baluardo" strategico nel complesso gioco di alleanze e conflitti che caratterizzava l'Italia centro-settentrionale. Per secoli, Montepulciano fu contesa tra le potenti repubbliche di Siena e Firenze, con l'interferenza sporadica di Perugia e di altri attori minori, diventando il teatro delle lotte tra le famiglie locali che si schieravano alternativamente con l'una o con l'altra fazione. Questo conflitto perpetuo culminò con l'ascesa della famiglia Del Pecora, che riuscì a imporre la propria egemonia sulla città e sul suo contado, giocando abilmente le rivalità tra le potenze maggiori. Nel 1390, dopo secoli di incertezze e di alterni assoggettamenti, Montepulciano compì una scelta geopolitica di portata storica: legarsi stabilmente a Firenze, un'alleanza che garantì due secoli di stabilità politica, prosperità economica e splendore artistico, sottraendo definitivamente la città all'influenza senese. Questa scelta politica influenzò profondamente l'urbanistica della città: il Corso, la via principale che si snoda sinuosa verso la sommità del colle, fu concepito non solo come asse commerciale e luogo di rappresentanza del potere, ma anche come percorso difensivo protetto da tre anelli concentrici di mura, ancora oggi parzialmente visibili e perfettamente integrati nel tessuto urbano.

La valdichiana e l'ingegneria del paesaggio

L'importanza strategica di Montepulciano non era limitata alla sua posizione militare dominante, ma era intrinsecamente legata alla gestione della Valdichiana, un vasto bacino alluvionale che in epoca medievale subì un progressivo e catastrofico impaludamento. Questo fenomeno fu causato dall'abbandono delle manutenzioni idrauliche di epoca romana e dal progressivo rialzamento del letto dei fiumi che attraversavano la valle, in particolare il Clanis, che con le sue piene ricorrenti trasformava l'intera regione in una palude insalubre e malarica. Il controllo di queste terre non era solo una questione di sovranità territoriale, ma di vera e propria sopravvivenza economica e demografica, poiché dalla capacità di bonificare e coltivare la valle dipendeva la produzione agricola necessaria a sostenere le popolazioni dei centri collinari. Nel corso del Medioevo, le lotte per il controllo del territorio chiusino, ovvero l'area intorno all'antica città etrusca di Chiusi, si intrecciarono con le dispute idrauliche, trasformando le zone palustri in vere e proprie barriere difensive naturali che entrambe le fazioni utilizzavano a proprio vantaggio per rallentare le incursioni nemiche. Dal tredicesimo al quattordicesimo secolo, si assistette ai primi tentativi organici di regimazione idraulica, con la manutenzione dei fossi esistenti e la costruzione di infrastrutture come il ponte di Valiano, che consentiva di attraversare le zone umide e ristabilire le comunicazioni commerciali tra le due sponde della valle. Il sedicesimo secolo segnò l'inizio della grande bonifica medicea, un progetto ambizioso che introdusse il modello di "rusticità" buontalentiano nelle case coloniche, trasformando il paesaggio agrario in un sistema organizzato e produttivo. Tuttavia, fu la bonifica realizzata sotto il granduca Pietro Leopoldo di Lorena nel diciottesimo secolo a determinare la definitiva trasformazione della Valdichiana da zona insalubre a distretto agricolo d'eccellenza. Il Canale Maestro della Chiana, una monumentale opera ingegneristica che ancora oggi costituisce l'asse portante del sistema idraulico vallivo, permise il deflusso controllato delle acque e la conseguente ricolonizzazione agricola delle terre bonificate.

La costruzione del "bel paesaggio" toscano

La bonifica della Valdichiana ha plasmato quello che i geografi definiscono il "bel paesaggio toscano", un'opera d'arte antropica dove ogni elemento naturale è stato modellato dall'intervento umano secondo precise logiche di gestione e sorveglianza agraria. La disposizione delle case coloniche, dei filari di cipressi e delle strade poderali non rispondeva a criteri estetici fortuiti, ma costituiva un sistema funzionale di controllo del territorio, dove ogni casa colonica dominava visivamente la propria porzione di campagna e poteva comunicare con le proprietà limitrofe attraverso segnali visivi e acustici. Questo sistema di organizzazione agraria, perfezionato nel corso dei secoli, ha prodotto un paesaggio unico al mondo, riconosciuto dall'UNESCO come Patrimonio dell'Umanità e divenuto icona globale della cultura e dell'identità italiana. La bonifica permise inoltre l'impianto dei vigneti che oggi producono il Vino Nobile di Montepulciano, una delle denominazioni più prestigiose del panorama enologico italiano, la cui fama risale almeno al sedicesimo secolo quando il vino di Montepulciano era già celebrato da poeti e mercanti in tutta Europa. Il passaggio amministrativo dalla provincia di Arezzo a quella di Siena, avvenuto nel 1984 dopo decenni di dibattiti e di rivendicazioni identitarie, riflette la continua evoluzione geopolitica di questo territorio di confine, dove le appartenenze storiche e culturali si intrecciano con le esigenze amministrative e di sviluppo economico. Montepulciano rappresenta oggi un caso paradigmatico di come la storia, l'urbanistica e l'ingegneria idraulica possano convergere nella costruzione di un paesaggio che è al tempo stesso opera d'arte, sistema produttivo e deposito di memoria collettiva, offrendo un modello di sviluppo territoriale che ha ispirato politiche di valorizzazione in tutto il mondo.

La storia di Montepulciano dimostra come l'urbanistica medievale non possa essere compresa separatamente dal controllo delle risorse naturali e dalla gestione del territorio circostante. Le mura, le torri e i palazzi che ancora oggi caratterizzano il profilo della città sono il risultato visibile di secoli di lotte per il dominio su un paesaggio agrario che è stato progressivamente plasmato dall'ingegno umano. In questa sintesi tra natura e cultura, Montepulciano offre una lezione di straordinaria attualità su come la pianificazione territoriale possa coniugare sviluppo economico, tutela ambientale e valorizzazione delle identità storiche.

Di Alex (pubblicato @ 11:00:00 in Geopolitica e tecnologia, letto 610 volte)

L'Avana al centro delle nuove tensioni geopolitiche internazionali nei Caraibi.

Il panorama geopolitico del bacino dei Caraibi sta attraversando una fase di estrema instabilità. Le recenti dichiarazioni del Presidente degli Stati Uniti a Miami, culminate nell'avvertimento "Cuba is next", hanno innescato una crisi diplomatica internazionale. Tra blocchi energetici, emergenze umanitarie e complessi intrecci con la crisi globale, l'isola si trova al centro di una contesa che minaccia gli equilibri dell'intera regione.

Il vertice di Miami e il precedente venezuelano

Durante il forum FII Priority a Miami Beach, l'amministrazione statunitense ha esplicitamente indicato Cuba come potenziale bersaglio di future manovre strategiche. Utilizzando una retorica legata a concetti di "acquisizione amichevole", Washington ha giustificato la pressione sull'Avana definendo l'isola una minaccia per la sicurezza nazionale, accusandola di ospitare asset militari di nazioni avversarie. L'avvertimento assume un peso specifico maggiore se letto alla luce delle operazioni condotte in Venezuela all'inizio dell'anno, che hanno stabilito un nuovo paradigma di intervento unilaterale nel continente americano e interrotto le vitali forniture energetiche verso Cuba.

L'Ordine Esecutivo 14380 e lo strangolamento energetico

Il fulcro dell'attuale strategia di Washington è l'Ordine Esecutivo 14380. Questo provvedimento introduce sanzioni secondarie estremamente rigide contro qualsiasi entità internazionale che fornisca petrolio all'isola. Il risultato è stato un drammatico ammanco energetico: le importazioni sono crollate e la rete elettrica nazionale fatica a erogare un quarto del fabbisogno necessario. Organizzazioni internazionali e analisti delle Nazioni Unite hanno sollevato gravi preoccupazioni legali, avvertendo che questa coercizione economica rischia di causare il collasso delle infrastrutture civili critiche.

Crisi sanitaria, infrastrutturale e migratoria

L'impatto sulla popolazione è severo. Blackout prolungati fino a 20 ore giornaliere hanno paralizzato i trasporti e compromesso la catena del freddo per alimenti e medicinali. Il sistema ospedaliero è in forte sofferenza, costretto a razionare l'elettricità in mezzo a un'epidemia congiunta di dengue e chikungunya. Questa immensa pressione materiale ha accelerato un massiccio esodo migratorio, privando il Paese di capitale umano essenziale e creando tensioni demografiche che potrebbero essere utilizzate come pretesto per ulteriori interventi esterni legati alla sicurezza dei confini.

Il contesto globale e la risposta del convoglio Nuestra América

La crisi cubana si intreccia con le tensioni in Medio Oriente e le difficoltà di transito nello Stretto di Hormuz. In risposta all'isolamento di Cuba, è emersa una forte mobilitazione internazionale. Il convoglio "Nuestra América", supportato da delegazioni di 33 Paesi e scortato simbolicamente da imbarcazioni messicane, ha tentato di forzare il blocco per consegnare aiuti medici e pannelli solari. L'iniziativa, sostenuta da leader politici e sindacali mondiali, punta a creare una rete di assistenza energetica regionale che aggiri le sanzioni.