\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 06/03/2026

Di Alex (pubblicato @ 17:00:00 in Storia Grecia Antica, letto 259 volte)

Illustrazione medievale di un torneo cavalleresco con stemmi araldici

I tornei medievali furono molto più di semplici spettacoli bellici: erano il teatro in cui la cavalleria costruiva la propria identità, misurava il valore dei combattenti e forgiava legami di lealtà. Da queste competizioni nacque l'araldica, un sofisticato sistema di simboli che trasformò gli scudi in registri genealogici e i blasoni in manifesti di potere. LEGGI TUTTO L'ARTICOLO

Le origini del torneo medievale

Le origini del torneo medievale come istituzione organizzata si collocano convenzionalmente nel XI secolo, nella Francia settentrionale e nella regione della Borgogna. La tradizione attribuisce la paternità del torneo a un nobile franco di nome Goffredo di Preuilly, che si ritiene abbia stabilito per primo un insieme di regole codificate per le combattimenti cavallereschi collettivi intorno al 1066, anno della Conquista normanna dell'Inghilterra. Le forme più antiche del torneo erano le "mesclées" o "mêlées", combattimenti collettivi che vedevano due squadre di cavalieri affrontarsi su un territorio aperto che poteva estendersi per diversi chilometri, con battaglie caotiche che si sviluppavano senza un ordine prestabilito e che spesso si protraevano per un'intera giornata. L'obiettivo primario non era l'eliminazione fisica dell'avversario, ma la sua cattura: il cavaliere sconfitto era tenuto a consegnare il proprio cavallo e le proprie armi — beni di valore immenso — e a pagare un riscatto per la propria liberazione. Questa pratica rendeva i tornei una fonte di arricchimento significativa per i cavalieri più abili, come testimonia la straordinaria carriera di Guglielmo il Maresciallo, che accumulò una fortuna considerevole partecipando a tornei in tutta la Francia nella seconda metà del XII secolo.

Il torneo come teatro della cavalleria

Nel corso del XII e soprattutto del XIII secolo, il torneo medievale si trasformò progressivamente da esercitazione militare brutale e caotica in spettacolo codificato e ritualizzato, riflettendo la contemporanea elaborazione ideologica del codice cavalleresco e l'influenza della cultura cortese e della letteratura romanzesca. La singola giostra — il combattimento individuale tra due cavalieri che si affrontavano con la lancia a cavallo lungo una palizzata dividente il campo chiamata "tela" o "lizza" — andò a sostituire progressivamente la mêlée collettiva come forma dominante del torneo, permettendo una valorizzazione molto più chiara del singolo combattente. Le donne della nobiltà assistevano dagli spalti ornati di drappi e gonfaloni come giudici morali e come premi simbolici della competizione: il concetto cortese dell'amore come motore dell'eccellenza cavalleresca, diffuso dalla poesia dei trovatori provenzali, trasformò il torneo in una performance di galanteria oltre che di valore bellico. Un cavaliere combatteva non solo per la propria gloria, ma per onorare la dama di cui era cavalier servente, portando i suoi colori e i suoi simboli sulle proprie armi e sulla propria armatura.

La nascita dell'araldica: identificare i guerrieri in campo

La necessità pratica di identificare i cavalieri sul campo di battaglia e nei tornei, quando il viso era completamente nascosto dall'elmo e l'armatura rendeva indistinguibili i combattenti, fu il motore principale dello sviluppo dell'araldica come sistema codificato. A partire dal XII secolo, i cavalieri cominciarono ad adottare simboli distintivi pittorici sugli scudi e sulle coperture dell'armatura — le cosiddette "sopravvesti araldiche" o "cottae armorum" — che consentivano l'identificazione immediata anche da lontano. Questi simboli erano trasmessi ereditariamente di padre in figlio, secondo regole precise di combinazione e modifica (la cosiddetta "brisura") che distinguevano il ramo principale della famiglia dai rami cadetti, creando di fatto un linguaggio visivo per la rappresentazione della genealogia e dell'appartenenza sociale. L'elaborazione di questo sistema richiese la creazione di una terminologia tecnica specificamente araldica, mutuata in gran parte dalla lingua francese (lo "blasonare" indica descrivere uno stemma con i termini araldici codificati), e la nascita di una nuova categoria professionale: gli araldi d'armi, funzionari specializzati nella conoscenza e nel registro degli stemmi delle famiglie nobili.

Lo stemma come manifesto di lignaggio e potere

Lo stemma araldico medievale non era semplicemente un logo identificativo, ma un testo visivo complesso che comunicava l'identità genealogica, le alleanze politiche, le imprese militari e le ambizioni simboliche della famiglia che lo portava. La struttura dello stemma si articolava in elementi codificati: lo scudo (diviso in campi di diversi colori chiamati "smalti", distinti in metalli — oro e argento — e colori — azzurro, rosso, verde, nero, porpora), le figure araldiche su di esso (animali, oggetti geometrici o simbolici chiamati "pezze onorevoli"), il cimiero sopra l'elmo, i supporti laterali e il motto. Colori e figure erano scelti per comunicare significati precisi: il leone rampante simboleggiava il coraggio e la nobiltà reale, l'aquila l'autorità imperiale e la giustizia, la croce la fede cristiana e spesso un antenato crociato. La diffusione della cultura araldica fu straordinariamente rapida: nel giro di poche generazioni si estese dalla cavalleria alle corporazioni artigiane, alle città, alle università e persino alla Chiesa, creando un linguaggio visivo condiviso che attraversava le barriere linguistiche dell'Europa medievale. Il declino dei tornei come pratica militare nel corso del XVI secolo — accelerato dalla morte accidentale del re Enrico II di Francia durante una giostra nel 1559 — non cancellò ma semmai consacrò l'araldica come sistema simbolico permanente. I blasoni sopravvissero ai cavalieri che li avevano creati, trasmettendo fino ai nostri giorni un linguaggio visivo di identità e appartenenza che ancora oggi ritroviamo negli stemmi comunali, nei loghi aziendali e nei simboli universitari, testimonianza silenziosa di un mondo che, pur scomparso, ha plasmato profondamente il modo in cui l'Occidente pensa all'identità e alla rappresentazione del potere.

Di Alex (pubblicato @ 16:00:00 in Storia Grecia Antica, letto 232 volte)

Cavalieri in armatura su destrieri da guerra nel Medioevo europeo

Tra il X e l'XI secolo, i pensatori ecclesiastici teorizzarono un ordine sociale diviso in tre ceti immutabili: bellatores, oratores e laboratores. Da questa visione nacque la cavalleria, che tra il XII e il XIII secolo si trasformò da ceto militare aperto in un'élite nobiliare ereditaria, ritualizzata e sacralizzata dalla Chiesa. LEGGI TUTTO L'ARTICOLO

Il modello tripartito di Adalberone di Laon

L'ordine sociale medievale fu sistematizzato intellettualmente dal vescovo Adalberone di Laon nel suo Carmen ad Robertum regem, composto intorno all'anno 1027 dopo Cristo e dedicato al re Roberto II di Francia. In quest'opera poetica di carattere politico-teologico, Adalberone descrisse una società suddivisa in tre ordini funzionali, concepiti come riflesso immutabile della volontà divina: i bellatores, l'aristocrazia militare deputata alla difesa armata della comunità; gli oratores, il clero che intercedeva presso Dio per la salvezza spirituale dell'intera umanità; e infine i laboratores, la stragrande maggioranza della popolazione rurale incaricata di produrre il sostentamento materiale. Questa visione non era semplicemente descrittiva, ma profondamente normativa: presentando le disuguaglianze come volute da Dio, legittimava la struttura gerarchica feudale e scoraggiava qualsiasi aspirazione alla mobilità sociale tra i ceti.

Le origini nomadi della cavalleria europea

La guerra a cavallo, che sarebbe diventata il fulcro del sistema militare medievale, affonda le sue radici nella tarda antichità e nelle grandi ondate migratorie delle popolazioni nomadi delle steppe eurasiatiche. Furono popoli come gli Unni, gli Alani e i Sarmati a trasmettere alle popolazioni germaniche in contatto con loro l'arte del combattimento equestre, con la tecnica della carica a piena velocità e l'utilizzo dell'arco da sella. Con la caduta dell'Impero Romano d'Occidente nel 476 dopo Cristo e il consolidamento dei regni romano-barbarici, la fanteria legionaria fu progressivamente soppiantata dalla cavalleria come forza militare dominante. Il termine latino miles, che originariamente indicava genericamente il soldato, cominciò a specializzarsi semanticamente fino a designare quasi esclusivamente il cavaliere armato.

Dal cnith all'aristocratico: il processo di elitarizzazione

Nelle sue origini carolingie, il cavaliere era indicato dal termine germanico cnith (servitore), e la sua estrazione sociale non era necessariamente nobile: si trattava di guerrieri professionali legati al proprio signore da un rapporto contrattuale basato su fedeltà in cambio di protezione. Tuttavia, i costi proibitivi legati al mantenimento dei destrieri da guerra — animali la cui selezione richiedeva anni di allevamento specializzato — e all'acquisto del pesante equipaggiamento bellico, il cui valore economico complessivo era paragonabile a quello di una considerevole proprietà terriera, innescarono tra il X e il XII secolo un inesorabile processo di chiusura sociale. Tra il XII e il XIII secolo la cavalleria si fuse completamente con l'aristocrazia, transitando da una nobiltà di fatto, basata sull'effettiva capacità militare, a una nobiltà di diritto, un ceto giuridicamente chiuso, ereditario e ritualizzato.

L'adoubement e la sacralizzazione del miles Christi

L'ingresso nella cavalleria era sancito dalla solenne cerimonia dell'adoubement, la vestizione e l'investitura delle armi, un rituale che assunse tra il XII e il XIII secolo connotazioni sempre più religiose e liturgiche. Il giovane aspirante cavaliere era tenuto a trascorrere una notte intera in veglia di preghiera e digiuno, a ricevere il bagno purificatore simbolico del battesimo rinnovato, e ad ascoltare la messa prima di essere definitivamente armato dal proprio signore. La Chiesa promosse le Paci di Dio — a partire dal Concilio di Charroux del 989 dopo Cristo — e le Tregue di Dio, che vietavano i combattimenti durante i periodi liturgici e contro categorie indifese. Il cavaliere fu così trasfigurato nell'ideale del miles Christi, il soldato di Cristo difensore degli oppressi, fornendo un substrato etico fondamentale per la successiva epopea crociata e per la nascita degli ordini monastico-militari come i Templari e gli Ospitalieri. Il predominio della cavalleria pesante cominciò a incrinarsi con la battaglia degli Speroni d'Oro a Courtrai nel 1302, in cui artigiani e mercanti fiamminghi sconfissero il fiore della cavalleria francese, raccogliendo dagli armati caduti così tanti speroni d'oro da dare il nome alla battaglia stessa. Nei decenni successivi, gli arcieri gallesi a Crécy nel 1346 e infine le armi da fuoco nel XV secolo resero obsoleta la corazza, chiudendo per sempre l'era del miles Christi e aprendo la strada alla guerra moderna.

Di Alex (pubblicato @ 15:00:00 in Scienza e Spazio, letto 277 volte)

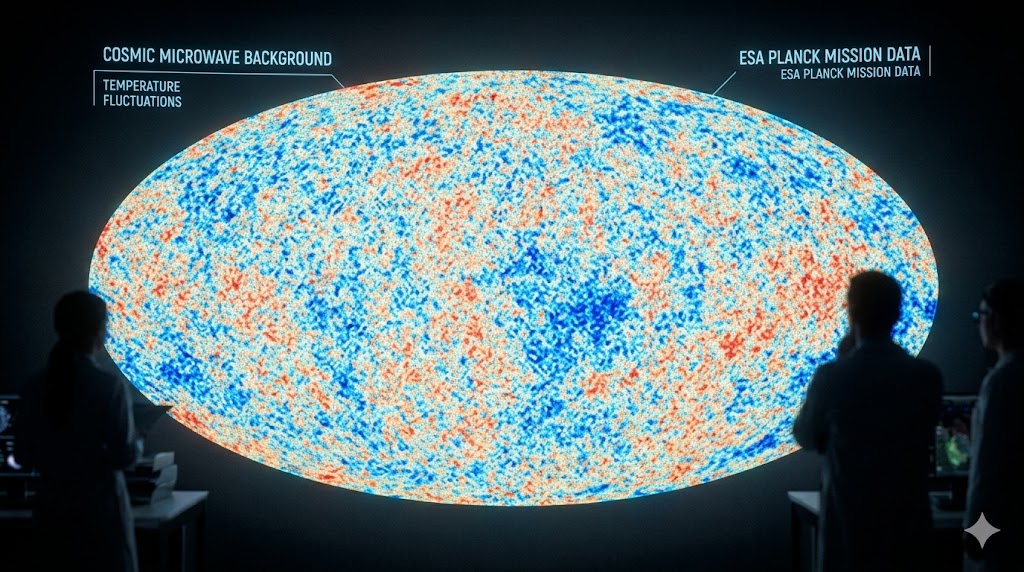

Mappa della Radiazione Cosmica di Fondo ottenuta dalla missione Planck dell'ESA

La Radiazione Cosmica di Fondo, detta CMB, è il più antico segnale elettromagnetico dell'universo, emesso circa 380.000 anni dopo il Big Bang quando il cosmo si raffreddò abbastanza da permettere la formazione degli atomi. Rilevata per la prima volta nel 1965 da Penzias e Wilson, è oggi la fonte più preziosa per comprendere le origini del cosmo. LEGGI TUTTO L'ARTICOLO

Che cos'è la radiazione cosmica di fondo

La Radiazione Cosmica di Fondo — in inglese Cosmic Microwave Background, abbreviata CMB — è una forma di radiazione elettromagnetica che permea in modo estremamente uniforme l'intero universo osservabile. Si tratta della luce fossile dell'universo primordiale: la radiazione che si liberò quando, circa 380.000 anni dopo il Big Bang, il cosmo si espanse e si raffreddò abbastanza da permettere agli elettroni liberi di combinarsi con i protoni per formare i primi atomi neutri di idrogeno e di elio. Prima di quel momento cruciale — tecnicamente chiamato ricombinazione — l'universo era un plasma opaco e denso in cui la radiazione non poteva propagarsi liberamente, rimbalzando continuamente sulle particelle cariche. Con la ricombinazione, l'universo divenne trasparente e la luce poté viaggiare liberamente per la prima volta: quella luce è appunto la CMB, che oggi, dopo oltre 13 miliardi di anni di viaggio e di progressivo spostamento verso le lunghezze d'onda delle microonde per effetto dell'espansione cosmica, raggiunge i nostri rilevatori a una temperatura media di circa 2,725 Kelvin sopra lo zero assoluto.

La scoperta di Penzias e Wilson nel 1965

La CMB fu rilevata per la prima volta in modo accidentale nel 1965 dai radioastronomi americani Arno Penzias e Robert Wilson, mentre lavoravano presso i Bell Telephone Laboratories del New Jersey con un'antenna radio progettata per ricevere segnali di satelliti per telecomunicazioni. I due scienziati notarono un rumore di fondo persistente, costante in ogni direzione del cielo e a qualsiasi ora del giorno e della notte, che non riuscivano a eliminare nonostante avessero accuratamente ripulito l'antenna persino da ogni traccia di escrementi di piccioni annidatisi nella struttura. La natura cosmica di questo segnale fu compresa quasi in simultanea dal gruppo teorico di Robert Dicke all'Università di Princeton, che stava cercando proprio quel segnale previsto dalla teoria del Big Bang. Per questa scoperta rivoluzionaria, Penzias e Wilson ricevettero il Premio Nobel per la Fisica nel 1978. La CMB fornì la prima prova osservativa diretta e inconfutabile della teoria del Big Bang, trasformando la cosmologia da disciplina speculativa in scienza osservativa di precisione.

Le missioni COBE, WMAP e Planck: mappare l'universo primordiale

Nei decenni successivi alla scoperta di Penzias e Wilson, la misurazione sempre più precisa della CMB è diventata uno dei programmi scientifici più ambiziosi e tecnologicamente avanzati della storia dell'astronomia. Il satellite COBE (COsmic Background Explorer), lanciato dalla NASA nel 1989, rilevò per la prima volta le minuscole fluttuazioni di temperatura nella CMB — dell'ordine di una parte su centomila — che rappresentano i semi delle future strutture cosmiche. I responsabili scientifici di COBE, John Mather e George Smoot, ricevettero il Premio Nobel per la Fisica nel 2006 per questi risultati. Il satellite WMAP (Wilkinson Microwave Anisotropy Probe), operativo tra il 2001 e il 2010, produsse mappe di risoluzione molto superiore, determinando i parametri cosmologici fondamentali con una precisione senza precedenti. La missione Planck dell'Agenzia Spaziale Europea, che operò tra il 2009 e il 2013, ha infine prodotto le mappe più dettagliate e precise della CMB mai realizzate, stabilendo con straordinaria accuratezza l'età dell'universo (13,8 miliardi di anni), la sua composizione e la geometria dello spazio-tempo.

Anisotropie e struttura cosmica: la mappa del futuro

Le fluttuazioni di temperatura rilevate nella CMB — tecnicamente chiamate anisotropie — non sono casuali ma riflettono le oscillazioni acustiche del plasma primordiale, piccole variazioni di densità generate dalle fluttuazioni quantistiche dell'universo primordiale amplificate durante la fase inflazionaria. Queste irregolarità di densità sono i semi da cui, nel corso di miliardi di anni, si sono formati per gravitazione le galassie, gli ammassi di galassie e la grande struttura filamentare dell'universo che osserviamo oggi. La posizione e le caratteristiche statistiche dei picchi acustici nel cosiddetto spettro di potenza della CMB permettono agli cosmologi di misurare con grande precisione la curvatura dell'universo, il rapporto tra materia ordinaria, materia oscura ed energia oscura, e persino la velocità di espansione cosmica attuale, il parametro di Hubble. La Radiazione Cosmica di Fondo resta oggi, a oltre sessant'anni dalla sua scoperta, la finestra più preziosa che abbiamo sull'universo primordiale e sui processi fisici che hanno plasmato la realtà in cui viviamo. Ogni nuova generazione di telescopi e satelliti dedicati alla sua misura ci restituisce una visione sempre più nitida di quel momento luminoso in cui l'universo divenne per la prima volta trasparente, aprendoci prospettive scientifiche che toccano le domande più fondamentali sulla natura dello spazio, del tempo e dell'esistenza.

Di Alex (pubblicato @ 14:00:00 in Scienza e Tecnologia, letto 247 volte)

Interno del Planetario di Roma con proiezione astronomica immersiva digitale

La museologia scientifica contemporanea ha abbandonato il modello del deposito statico di reperti per diventare un ecosistema dinamico di apprendimento esperienziale. Il Planetario di Roma e i 120 grandi musei scientifici mondiali analizzati in questo rapporto rappresentano laboratori vivi di divulgazione capaci di democratizzare conoscenze complesse. LEGGI TUTTO L'ARTICOLO

La metamorfosi della museologia scientifica contemporanea

La museologia scientifica del XXI secolo ha attraversato una metamorfosi radicale che ha ridefinito in modo profondo la funzione stessa del museo. Se per gran parte del XIX e del XX secolo i musei della scienza erano fondamentalmente depositari statici di reperti — minerali, fossili, modelli anatomici, strumenti scientifici — esposti dietro vetrine con didascalie dense e tecnicamente ostiche, la virata verso l'interattività e l'esperienza immersiva ha trasformato questi spazi in laboratori viventi di apprendimento. Questa transizione non è stata puramente estetica o tecnologica, ma riflette una necessità socioculturale più profonda: la democratizzazione della conoscenza scientifica complessa in un'epoca in cui la comprensione della scienza è diventata indispensabile per la cittadinanza attiva e per la partecipazione al dibattito democratico su temi come il cambiamento climatico, la bioetica, l'intelligenza artificiale e le biotecnologie.

Il Planetario di Roma: astronomia accessibile alla città

Il Planetario di Roma, situato in Piazza Giovanni Agnelli all'interno del Parco della Musica nel quartiere Parioli, rappresenta il pilastro fondamentale della cultura astronomica capitolina e uno dei più importanti centri di divulgazione scientifica dell'Italia centrale. La struttura ospita una cupola di proiezione di ultima generazione che utilizza tecnologie digitali full-dome per creare spettacoli immersivi di straordinaria qualità visiva. Programmi come Space Opera e Interstellari trasportano il pubblico in un viaggio virtuale attraverso il sistema solare, le nebulose, le galassie e i confini osservabili dell'universo, rendendo accessibili concetti cosmologici complessi attraverso la narrazione visiva e sonora. Il Planetario offre anche programmi didattici dedicati alle scuole di ogni ordine e grado, contribuendo a costruire una cultura scientifica di base nelle nuove generazioni romane.

I grandi musei scientifici europei: Londra, Monaco, Milano

Nel panorama europeo, il Science Museum di Londra occupa una posizione di assoluto rilievo: fondato nel 1857, conserva collezioni storiche di strumenti scientifici originali che vanno dalla macchina a vapore di James Watt al modulo di comando dell'Apollo 10, affiancando ai pezzi storici mostre interattive di punta sul futuro dell'intelligenza artificiale e della medicina. Il Deutsches Museum di Monaco di Baviera, con i suoi oltre 73.000 oggetti esposti su una superficie di circa 73.000 metri quadrati, è considerato il più grande museo della scienza e della tecnologia del mondo e include ricostruzioni a scala reale di miniere, centrali elettriche e laboratori chimici. In Italia, il Museo Nazionale della Scienza e della Tecnologia Leonardo da Vinci di Milano è il più grande museo scientifico italiano, con le sue gallerie dedicate ai codici leonardeschi, alla fisica, alla chimica, alle telecomunicazioni e all'innovazione tecnologica contemporanea.

Le frontiere dell'innovazione museale globale

A livello globale, alcune istituzioni hanno spinto l'innovazione museale verso frontiere inedite. Il California Academy of Sciences di San Francisco ospita sotto un unico tetto un acquario, un planetario, una foresta pluviale tropicale vivente e un'estesa collezione di storia naturale, costruendo un'esperienza enciclopedica della biodiversità planetaria. Il Miraikan di Tokyo, il Museo Nazionale delle Scienze Emergenti e dell'Innovazione giapponese, propone installazioni interattive su robotica, esplorazione spaziale, genomica e cambiamento climatico con una densità tecnologica e una qualità espositiva difficilmente eguagliabili. In Cina, il China Science and Technology Museum di Pechino ha investito massicciamente in tecnologie di realtà aumentata e realtà virtuale per creare esperienze museali completamente immersive, attraendo ogni anno decine di milioni di visitatori. Questi modelli dimostrano come la divulgazione scientifica, quando ben progettata, possa raggiungere pubblici vastissimi e trasversali. Il futuro della museologia scientifica si gioca sulla capacità di integrare le tecnologie emergenti — realtà virtuale, intelligenza artificiale, simulazioni interattive — senza perdere la dimensione umana e narrativa che rende un museo un luogo di emozione autentica oltre che di conoscenza. Il Planetario di Roma e i grandi musei mondiali che abbiamo esplorato dimostrano che scienza e meraviglia non sono opposti, ma compagni inseparabili in ogni grande avventura della conoscenza.

Di Alex (pubblicato @ 13:00:00 in Sistemi Operativi, letto 346 volte)

Il computer quantistico Origin Wukong da 72 qubit su cui gira Origin Pilot

A febbraio 2026, la Cina ha reso disponibile per il download globale Origin Pilot, il primo sistema operativo quantistico open source al mondo. Sviluppato da Origin Quantum Computing di Hefei e basato sul processore Wukong a 72 qubit, questo OS segna una svolta storica: per la prima volta la tecnologia quantistica si apre a ricercatori e sviluppatori di tutto il mondo. LEGGI TUTTO L'ARTICOLO

Un cervello software per l'hardware del futuro

Origin Pilot è stato ufficialmente presentato al pubblico per il download globale a febbraio 2026, dopo essere stato lanciato per la prima volta nel 2021 e aver attraversato numerosi cicli di aggiornamento e ottimizzazione. Sviluppato dall'azienda Origin Quantum Computing Technology Co., con sede nella città di Hefei nella provincia cinese dell'Anhui — uno dei principali hub mondiali della ricerca quantistica — questo sistema operativo non è un semplice software di gestione ma una piattaforma integrata che combina tre paradigmi computazionali distinti: il calcolo quantistico, il calcolo classico e il calcolo intelligente basato su intelligenza artificiale. La sua funzione principale è quella di agire come il cuore software dell'ecosistema di computazione quantistica, gestendo risorse critiche come la schedulazione dei compiti computazionali, la coordinazione in tempo reale tra software applicativo e hardware quantistico fisico, e il monitoraggio continuo delle prestazioni dei qubit. A differenza dei sistemi operativi classici, che gestiscono processori con stati binari deterministici, Origin Pilot deve gestire qubit che esistono in stati di sovrapposizione quantistica intrinsecamente probabilistici e fragilissimi.

Esecuzione parallela e calibrazione automatica dei qubit

Tra le funzionalità più innovative che rendono Origin Pilot tecnicamente avanzato rispetto alle soluzioni concorrenti vi sono due capacità complementari: l'esecuzione parallela di compiti quantistici multipli e la calibrazione automatica dei qubit in tempo reale. L'esecuzione parallela consente al sistema di gestire simultaneamente più compiti computazionali su diversi sottoinsiemi del processore quantistico, massimizzando l'utilizzo delle risorse hardware e riducendo drasticamente i tempi di attesa per gli utenti. La calibrazione automatica dei qubit è forse la caratteristica tecnicamente più significativa: i qubit fisici, che possono essere realizzati attraverso circuiti superconduttori raffreddati a temperature vicino allo zero assoluto, ioni intrappolati in campi elettromagnetici, o atomi neutri manipolati con laser, sono entità estremamente sensibili a qualsiasi perturbazione ambientale — vibrazioni meccaniche, campi elettromagnetici parassiti, variazioni di temperatura. Senza una calibrazione continua e precisa, i qubit perdono rapidamente la coerenza quantistica necessaria per i calcoli, in un fenomeno chiamato decoerenza che rappresenta il principale ostacolo tecnico alla scalabilità dei computer quantistici. Origin Pilot automatizza completamente questo processo critico, aumentando la disponibilità operativa del sistema e standardizzando le prestazioni nel tempo.

Compatibilità multi-architettura e interfaccia unificata

Una delle scelte progettuali più lungimiranti di Origin Pilot è la sua compatibilità con le principali architetture hardware quantistiche esistenti: il sistema supporta nativamente i qubit superconduttori — la tecnologia di IBM, Google e della stessa Origin Quantum — quelli basati su ioni intrappolati sviluppati da aziende come IonQ e Quantinuum, e quelli a atomi neutri esplorati da realtà come QuEra e Pasqal. Questa flessibilità architetturale è fondamentale per una potenziale adozione su larga scala: i ricercatori possono utilizzare lo stesso sistema operativo per sviluppare e testare algoritmi quantistici su piattaforme hardware fisicamente diverse senza dover riscrivere il codice da zero. Il team di sviluppo guidato da Dou Menghan ha progettato un'interfaccia di programmazione applicativa (API) unificata e un sistema di driver standardizzato compatibile con i principali framework di programmazione quantistica disponibili, tra cui il linguaggio proprietario QPanda sviluppato da Origin Quantum stessa, ma anche standard aperti internazionali come OpenQASM.

Indipendenza tecnologica e strategia open source globale

La decisione di rendere Origin Pilot open source e liberamente scaricabile da tutto il mondo non è solo una scelta tecnica ma una chiara mossa strategica nell'ambito della competizione tecnologica globale. Guo Guoping, scienziato capo di Origin Quantum, ha dichiarato che questo passaggio segna un cambiamento paradigmatico nell'industria quantistica cinese, che si apre dall'innovazione a porte chiuse allo sviluppo di un più ampio ecosistema collaborativo internazionale. L'iniziativa si inserisce esplicitamente negli obiettivi del 15o Piano Quinquennale cinese, che identifica la tecnologia quantistica come uno dei settori strategici prioritari per il raggiungimento dell'indipendenza tecnologica nazionale e della leadership globale nell'innovazione. A livello internazionale, la mossa è particolarmente significativa: mentre colossi come IBM, con il suo framework Qiskit, e Google, con Cirq, offrono strumenti di programmazione quantistica open source, i loro sistemi operativi sottostanti non sono mai stati resi pubblicamente scaricabili, mantenendo il controllo del livello più profondo dello stack software. Origin Pilot è il primo sistema operativo quantistico al mondo reso disponibile per il download diretto, segnando un precedente storico nell'ecosistema tecnologico globale. Il rilascio di Origin Pilot rappresenta una pietra miliare che porta la computazione quantistica fuori dai laboratori e più vicina a una comunità globale di sviluppatori, ricercatori e aziende. La Cina, con questa mossa, non dimostra solo i propri progressi tecnologici, ma cambia le regole del gioco promuovendo un modello di sviluppo collaborativo e aperto per una delle tecnologie più trasformative del XXI secolo, con applicazioni potenziali che vanno dalla crittografia alla scoperta di nuovi farmaci, dalla scienza dei materiali all'ottimizzazione finanziaria.

Di Alex (pubblicato @ 12:00:00 in Scienza e Tecnologia, letto 245 volte)

Colture di microbi ingegnerizzati per la degradazione delle plastiche in laboratorio

Con 29 milioni di tonnellate di plastica disperse ogni anno nell'ambiente, la biologia sintetica offre una risposta rivoluzionaria: microbi ingegnerizzati con CRISPR, potenziati con enzimi chimerici PETasi e cutinasi, capaci di depolimerizzare plastiche complesse in pochi giorni. In parallelo, alghe ottimizzate catturano CO2 industriale e la convertono in bioplastiche. LEGGI TUTTO L'ARTICOLO

La crisi globale dell'inquinamento da plastica

Le proiezioni più recenti sull'inquinamento da plastica dipingono uno scenario allarmante: si stima che entro il 2030 circa 29 milioni di tonnellate di rifiuti plastici raggiungeranno ogni anno gli oceani e gli ecosistemi terrestri, con effetti devastanti sulla biodiversità marina, sulla catena alimentare e sulla salute umana attraverso l'ingestione di microplastiche. Le plastiche convenzionali derivate dal petrolio — polietilene, polipropilene, polistirene, PET — sono per definizione non biodegradabili in condizioni ambientali normali: possono persistere nell'ambiente per centinaia o addirittura migliaia di anni, frammentandosi progressivamente in particelle sempre più piccole senza decomporsi chimicamente. Le soluzioni tradizionali di riciclo meccanico sono efficaci solo per frazioni limitate di plastica di alta purezza e qualità, mentre la gran parte dei rifiuti plastici misti e contaminati resta di fatto impossibile da trattare con le tecnologie convenzionali. La biologia sintetica emerge come la risposta più promettente a questa sfida, offrendo la prospettiva di microbi industriali capaci di "digerire" biologicamente le plastiche riducendole ai loro componenti chimici di base riutilizzabili.

Biologia sintetica e ingegneria genomica CRISPR

La biologia sintetica è la disciplina scientifica che combina principi dell'ingegneria con le conoscenze della biologia molecolare per progettare, modificare e costruire sistemi biologici con funzioni nuove o migliorate. La rivoluzionaria tecnologia CRISPR-Cas9, sviluppata dalla biologa Jennifer Doudna e dalla chimica Emmanuelle Charpentier — premiate con il Premio Nobel per la Chimica nel 2020 — ha reso l'ingegneria genomica straordinariamente più precisa, veloce ed economica rispetto alle tecniche precedenti, abbattendo le barriere tecnologiche che limitavano la progettazione di microbi industriali. Grazie a CRISPR è ora possibile inserire, eliminare o modificare con chirurgica precisione sequenze genomiche specifiche in batteri e altri microrganismi, programmandoli per produrre enzimi non naturali capaci di catalizzare reazioni che in natura non avvengono o avvengono con velocità estremamente basse. Ceppi batterici come Pseudomonas putida e Ideonella sakaiensis sono diventati piattaforme di riferimento per lo sviluppo di questi microbi biodegradatori industriali.

Enzimi chimerici PETasi e cutinasi: depolimerizzare il PET

La chiave tecnologica per la degradazione biologica delle plastiche sintetiche è rappresentata dagli enzimi chimerici, proteine artificiali progettate combinando domini funzionali di enzimi naturali diversi per creare catalizzatori con proprietà ottimizzate. La PETasi è un enzima originariamente identificato nel batterio Ideonella sakaiensis, scoperto nel 2016 in un impianto di riciclo giapponese, capace di idrolizzare il polietilene tereftalato (PET, la plastica delle bottiglie) in monomeri riutilizzabili come acido tereftalico e etilenglicole. La versione chimerica ingegnerizzata chiamata FAST-PETasi, sviluppata dai ricercatori dell'Università del Texas ad Austin nel 2022, ha dimostrato una capacità di degradazione del PET fino a 5.000 volte superiore alla versione naturale, operando a temperature compatibili con l'implementazione industriale. Le cutinasi, enzimi originariamente coinvolti nella degradazione della cutina vegetale, si sono rivelate ugualmente promettenti per il trattamento di plastiche miste complesse come i tessuti sintetici in poliestere, aprendo la strada al riciclo biologico dell'industria tessile.

La cattura biologica del carbonio: alghe e cianobatteri

Parallelamente alla biodegradazione delle plastiche, la biologia sintetica sta sviluppando approcci rivoluzionari per trasformare il problema dell'anidride carbonica industriale in una risorsa. Ceppi di microalghe unicellulari come Chlorella vulgaris e Nannochloropsis oceanica, e di cianobatteri fotosintetici come Synechocystis e Arthrospira (spirulina), vengono ingegnerizzati con tecnologie CRISPR per massimizzare l'efficienza dell'enzima RuBisCO (ribulosio-1,5-bifosfato carbossilasi/ossigenasi), il catalizzatore responsabile della fissazione fotosintetica della CO2. Ottimizzando la struttura e la regolazione di questo enzima, i ricercatori puntano a creare ceppi algali capaci di sequenstrare CO2 direttamente dai gas di scarico di ciminiere industriali con efficienze drasticamente superiori a quelle della fotosintesi naturale, convertendo il carbonio catturato in biomassa ricca di lipidi utilizzabile per la produzione di biocarburanti di seconda generazione o in polimeri plastici biodegradabili PHa (poliidrossialcanoati). La convergenza tra biologia sintetica, ingegneria genomica CRISPR e machine learning per l'ottimizzazione dei percorsi metabolici sta costruendo le fondamenta di un'economia bio-circolare radicalmente diversa dall'economia estrattiva del passato. Entro il 2030, questi microbi sintetici potrebbero trasformare i rifiuti plastici da un problema ambientale devastante in una preziosa materia prima biologica, contribuendo in modo significativo alla transizione verso un modello economico in cui nulla si butta e tutto si rigenera.

Di Alex (pubblicato @ 11:00:00 in Scienza e Spazio, letto 284 volte)

Rappresentazione artistica dell'inflazione cosmica nei primi istanti dopo il Big Bang

L'inflazione cosmica è una delle teorie più rivoluzionarie della fisica moderna: ipotizza che nei primissimi istanti dopo il Big Bang l'universo sia cresciuto in modo esponenziale. La Radiazione Cosmica di Fondo ne porta le tracce impresse, rivelando la composizione dell'universo primordiale e risolvendo profondi enigmi cosmologici ancora aperti. LEGGI TUTTO L'ARTICOLO

Il problema dell'orizzonte e della piattezza

Prima che Alan Guth formulasse la teoria dell'inflazione cosmica nel 1980, la cosmologia del Big Bang era alle prese con due anomalie teoriche profonde che non riusciva a spiegare in modo soddisfacente. Il primo è il problema dell'orizzonte: regioni opposte del cielo, che non avrebbero mai potuto comunicare tra loro perché separate da distanze superiori alla velocità della luce moltiplicata per l'età dell'universo, mostrano temperature della CMB quasi identiche, con variazioni inferiori a una parte su centomila. Come è possibile che regioni causalmente disconnesse abbiano raggiunto un equilibrio termico così preciso? Il secondo è il problema della piattezza: le misure cosmologiche mostrano che l'universo ha una geometria spaziale piatta con una precisione straordinaria, il che richiede che la densità di energia cosmica corrisponda con incredibile esattezza alla cosiddetta densità critica. Secondo la teoria standard del Big Bang senza inflazione, questa coincidenza sarebbe incredibilmente improbabile, come un matita perfettamente in equilibrio verticale sulla sua punta.

La soluzione di Guth: espansione esponenziale

Alan Guth, fisico teorico del Massachusetts Institute of Technology, propose nel 1980 una soluzione elegante e radicale ad entrambi i problemi: l'ipotesi che l'universo primordiale, in un brevissimo intervallo di tempo compreso tra 10 alla meno 36 e 10 alla meno 32 secondi dopo il Big Bang, abbia subito un'espansione accelerata di carattere esponenziale, crescendo di un fattore almeno pari a 10 elevato alla 26 — un aumento di scala di proporzioni che sfidano qualsiasi intuizione umana. Questo fenomeno, che Guth chiamò inflazione, era guidato da un campo scalare quantistico ipotetico detto inflatone, in uno stato di falso vuoto ad alta energia. La straordinaria rapidità dell'espansione inflazionaria spiega l'uniformità termica dell'universo attuale (le regioni oggi separate erano in contatto causale prima dell'inflazione) e la sua piattezza geometrica (qualsiasi curvatura iniziale viene appiattita dall'espansione come la superficie di un palloncino che si gonfia). Negli anni successivi, fisici come Andrei Linde e Paul Steinhardt raffinarono e ampliarono il modello originale di Guth con varianti come l'inflazione caotica e l'inflazione eterna.

La composizione dell'universo: un universo misterioso

Le misure della CMB effettuate dalle missioni WMAP e Planck hanno permesso di determinare con straordinaria precisione la composizione dell'universo, rivelando un quadro profondamente controintuitivo. Solo il 4,9% circa della densità di energia totale dell'universo è costituito da materia ordinaria barionica — atomi, molecole, stelle, pianeti, gas interstellare, tutto ciò che siamo abituati a considerare come "materia". Il 26,8% circa è materia oscura, una forma di materia sconosciuta che non emette, assorbe né riflette luce ma che rivela la sua presenza attraverso gli effetti gravitazionali sulle galassie e sugli ammassi galattici. Il rimanente 68,3% circa è energia oscura, una forma di energia ancora più misteriosa uniformemente distribuita nello spazio e responsabile dell'accelerazione dell'espansione cosmica osservata per la prima volta nel 1998 dalle squadre di Saul Perlmutter, Brian Schmidt e Adam Riess, cui fu assegnato il Premio Nobel per la Fisica nel 2011.

Le onde gravitazionali primordiali: la firma dell'inflazione

Una delle previsioni più importanti e ancora non confermate della teoria inflazionaria riguarda la generazione di onde gravitazionali primordiali — increspature nello spazio-tempo create dalle violente fluttuazioni quantistiche dell'universo durante l'inflazione. Queste onde gravitazionali avrebbero lasciato un'impronta caratteristica sulla polarizzazione della CMB, un pattern specifico chiamato modo B, che esperimenti come BICEP2, Keck Array e il futuro satellite LiteBIRD dell'agenzia spaziale giapponese JAXA stanno cercando con determinazione. La rilevazione di questo segnale costituirebbe una conferma diretta dell'inflazione cosmica e aprirebbe una finestra osservativa sull'universo nei suoi primi istanti, quando le energie in gioco erano miliardi di miliardi di volte superiori a quelle raggiungibili dai nostri acceleratori di particelle. L'inflazione cosmica rimane una delle teorie scientifiche più potenti e controversamente affascinanti della fisica moderna. La sua conferma osservativa attraverso le onde gravitazionali primordiali impregnate nella polarizzazione della CMB rappresenterebbe non solo un trionfo della cosmologia, ma una finestra aperta sull'universo nei suoi primissimi istanti, quando le leggi della fisica quantistica e della gravità si fondevano in un'unità ancora da comprendere.

Di Alex (pubblicato @ 10:00:00 in Meraviglie Naturali Recondite, letto 298 volte)

Gorilla di montagna nella foresta impenetrabile di Bwindi in Uganda

La foresta di Bwindi in Uganda e il Parco Masoala in Madagascar sono due delle ultime fortezze della biodiversità globale. La prima ospita circa la metà della popolazione mondiale di gorilla di montagna, la seconda custodisce foreste pluviali costiere tra le più integre dell'Africa. Entrambi rappresentano l'ultima difesa contro deforestazione ed espansione agricola. LEGGI TUTTO L'ARTICOLO

Bwindi Impenetrable Forest: un rifugio di 25.000 anni

La foresta di Bwindi, il cui nome in lingua locale significa letteralmente "luogo oscuro e impenetrabile", si estende per circa 331 chilometri quadrati sulle ripide colline vulcaniche del sud-ovest dell'Uganda, al confine con la Repubblica Democratica del Congo e il Ruanda. Patrimonio Mondiale dell'UNESCO dal 1994, Bwindi è uno degli ecosistemi africani più antichi e preziosi: la sua continuità forestale risale a circa 25.000 anni fa, il che significa che ha mantenuto la propria integrità ecologica durante l'ultimo massimo glaciale, quando gran parte della vegetazione africana fu drasticamente ridotta o trasformata. Questa eccezionale stabilità geologica e climatica ha permesso all'ecosistema di conservare un livello straordinario di biodiversità: la foresta ospita oltre 1.000 specie di piante, più di 350 specie di uccelli — tra cui numerosi endemici dell'Albertine Rift — 120 specie di mammiferi e una varietà di rettili, anfibi e invertebrati di straordinaria ricchezza. Il substrato geologico vulcanico dei Monti Virunga, che si solleva fino a quasi 2.700 metri di altitudine, crea una varietà di microhabitat che sostiene questa straordinaria ricchezza biologica.

I gorilla di montagna: biologia e conservazione

La ragione principale per cui Bwindi è diventato un riferimento mondiale della conservazione è la presenza del gorilla di montagna (Gorilla beringei beringei), una delle sottospecie più rare e minacciate del pianeta. Bwindi ospita circa la metà dell'intera popolazione mondiale di gorilla di montagna, che secondo il censimento del 2018 conta complessivamente circa 1.000 individui distribuiti tra Uganda, Ruanda e Repubblica Democratica del Congo. I gorilla di montagna sono animali altamente sociali, organizzati in gruppi familiari guidati da un maschio adulto dominante — il "silverback" così chiamato per il caratteristico mantello grigio-argenteo che si sviluppa con la maturità — e comprendenti femmine, giovani e cuccioli. La dieta è prevalentemente vegetariana: foglie, germogli, radici, frutti e corteccia costituiscono la base alimentare, con una preferenza stagionale per le piante ricche di amido durante la stagione secca. Il programma di ecoturismo gestito dall'Uganda Wildlife Authority, che consente a piccoli gruppi di visitatori di osservare i gorilla nel loro habitat naturale per un'ora al giorno, ha contribuito significativamente alla protezione della specie generando risorse economiche fondamentali per il mantenimento del parco e per le comunità locali.

Il Parco Masoala: biodiversità dell'ultimo arcipelago verde del Madagascar

Il Parco Nazionale di Masoala, che si estende sulla Penisola di Masoala nel nord-est del Madagascar, protegge uno degli ultimi grandi blocchi di foresta pluviale costiera integra dell'isola, un ecosistema di straordinaria unicità biologica. Il Madagascar, separato dal continente africano circa 88 milioni di anni fa, ha seguito un percorso evolutivo del tutto autonomo: l'80-90% delle sue specie viventi è endemico e non si trova in nessun'altra parte del mondo. Masoala, raggiungibile solo via barca dalla città di Maroantsetra attraverso la Baia di Antongil, ospita habitat diversificati che comprendono foresta pluviale di pianura, foresta montana, foreste di mangrovie costiere e barriere coralline marine tra le più belle dell'Oceano Indiano occidentale. Il lemure vari rosso (Varecia rubra), uno dei primati più colorati e minacciati del mondo, trova in Masoala uno dei suoi ultimi rifugi significativi. La penisola ospita inoltre specie endemiche di orchidee, camaleoni, geckos e rane che non esistono letteralmente in nessun altro luogo della Terra.

Le sfide della conservazione: deforestazione e pressione agricola

Nonostante il loro status di aree protette riconosciute a livello internazionale, sia Bwindi che Masoala affrontano pressioni antropiche sempre più intense che mettono a rischio la loro integrità ecologica a lungo termine. Il Madagascar ha perso circa il 90% della sua copertura forestale originaria nell'arco degli ultimi tremila anni, con una drammatica accelerazione nei decenni recenti guidata dalla pratica del tavy — il disboscamento e incendio per ricavare nuovi terreni agricoli — e dalla produzione di carbone vegetale. Bwindi subisce pressioni simili dalle popolazioni delle comunità rurali circostanti, per le quali la foresta rappresenta una risorsa di legna, cibo e medicine, ma anche un ostacolo all'espansione dei campi agricoli necessari alla sopravvivenza. Il bracconaggio, praticato sia per la caccia di animali selvatici che per il commercio internazionale di animali esotici vivi, rappresenta un'ulteriore minaccia. La risposta delle autorità di conservazione ha incluso programmi di condivisione dei benefici economici dell'ecoturismo con le comunità locali, programmi di educazione ambientale nelle scuole e incentivi economici alternativi alla deforestazione. Bwindi e Masoala rappresentano molto più di semplici riserve naturali: sono serbatoi genetici insostituibili, laboratori viventi dell'evoluzione e prove tangibili che la conservazione della biodiversità non è un lusso per paesi ricchi ma una necessità assoluta per la sopravvivenza di tutto il pianeta. La loro protezione richiede non solo risorse finanziarie internazionali, ma un cambiamento profondo nel modo in cui le comunità locali percepiscono la propria relazione con la natura che le circonda.

Di Alex (pubblicato @ 09:00:00 in Sci-Fi e Rigore Scientifico, letto 266 volte)

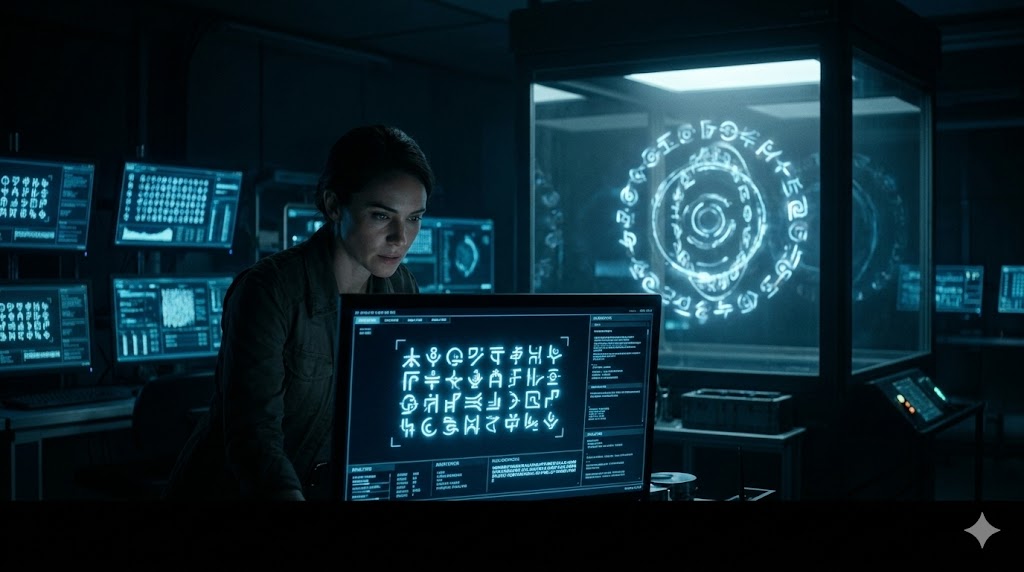

Scena concettuale di analisi del linguaggio logografico alieno nel film Arrival

Arrival (2016) di Denis Villeneuve è uno dei film di fantascienza più scientificamente accurati degli ultimi decenni. Con la consulenza della linguista Jessica Coon e del matematico Stephen Wolfram, il regista ha costruito un linguaggio alieno coerente e scene di analisi basate su veri processi di sintassi computazionale e data mining. LEGGI TUTTO L'ARTICOLO

La consulenza scientifica: Coon e Wolfram sul set

La produzione di Arrival si distinse sin dall'inizio per un approccio radicalmente diverso rispetto alla fantascienza convenzionale: Denis Villeneuve e il suo team di sceneggiatura ingaggiarono consulenti scientifici di altissimo profilo per garantire la plausibilità delle sequenze linguistiche e matematiche del film. Jessica Coon, professoressa di linguistica alla McGill University di Montreal e specialista delle lingue maya, fu coinvolta per supervisionare il modo in cui la protagonista Louise Banks (interpretata da Amy Adams) approccio il linguaggio degli eptapodi. Coon contribuì a rendere realistiche le procedure metodologiche di decifrazione: dall'osservazione sistematica dei pattern ricorrenti all'identificazione di unità minime di significato, ogni passaggio riflette i protocolli reali della linguistica di campo. Il matematico e imprenditore Stephen Wolfram, ideatore del software Mathematica e del motore computazionale Wolfram Alpha, sviluppò invece i grafici e i programmi visualizzati sugli schermi dei laboratori del film, basandosi su reali tecniche di analisi sintattica e riconoscimento di pattern.

Il sistema logografico degli eptapodi: oltre cento simboli unici

Il linguaggio alieno degli eptapodi, chiamato Heptapod B nella terminologia interna del film, fu creato dall'artista Martine Bertrand come un vero sistema di scrittura coerente e non una semplice serie di segni decorativi. Il sistema si compone di oltre cento logograms unici — segni che rappresentano concetti completi piuttosto che suoni — dotati di una logica grammaticale interna e di regole morfologiche proprie. La caratteristica più affascinante e narrativamente centrale di questo sistema è la sua natura non lineare: ogni logogramma eptapode è una struttura circolare chiusa, priva di inizio e fine distinguibili, che può essere "letta" in qualsiasi direzione. Questa proprietà riflette la concezione del tempo propria degli eptapodi, che percepiscono passato, presente e futuro come un unico continuum simultaneo piuttosto che come una sequenza lineare. La scenografa Patrice Vermette e il team di Bertrand lavorarono per mesi per garantire che i logograms avessero una coerenza interna verificabile: ogni simbolo è unico e distinguibile dagli altri, con variazioni sistematiche che rispecchiano differenze semantiche precise.

La teoria di Sapir-Whorf e la relatività linguistica

Il nucleo filosofico e scientifico di Arrival poggia sulla cosiddetta ipotesi di Sapir-Whorf, anche nota come ipotesi della relatività linguistica. Formulata negli anni Trenta del XX secolo dal linguista Edward Sapir e dal suo allievo Benjamin Lee Whorf sulla base di studi sulle lingue native americane, questa ipotesi sostiene che la struttura del linguaggio influenza e in parte determina il modo in cui i suoi parlanti percepiscono e concettualizzano la realtà. Nella versione forte dell'ipotesi, il linguaggio non si limita a descrivere il pensiero ma lo plasma attivamente, rendendo certi concetti letteralmente impensabili per chi non possiede le strutture linguistiche adeguate. Nel film, questa idea viene portata alle sue conseguenze estreme e speculative: imparare il linguaggio non-lineare degli eptapodi non si limita ad ampliare il vocabolario della protagonista, ma ristruttura radicalmente la sua percezione del tempo, consentendole di accedere a eventi futuri come se fossero già avvenuti.

Linguistica computazionale e data mining nel film

Le sequenze di analisi scientifica mostrate nel laboratorio della protagonista non sono semplici decorazioni visive ma riflettono processi reali della linguistica computazionale contemporanea. Wolfram sviluppò specificamente per il film una serie di visualizzazioni basate sul suo Wolfram Language, che mostrano tecniche autentiche di analisi morfologica, segmentazione del segnale e riconoscimento di pattern strutturali nei corpus linguistici. Il data mining applicato ai logograms eptapodi rispecchia le metodologie usate realmente dai linguisti computazionali quando affrontano una lingua sconosciuta: l'identificazione statistica delle unità ricorrenti, l'analisi delle co-occorrenze, la costruzione progressiva di un lessico e di una grammatica a partire da esempi contestuali. Questa attenzione alla correttezza procedurale ha reso Arrival un riferimento culturale anche all'interno della comunità scientifica della linguistica computazionale. Arrival rappresenta uno dei rari esempi in cui Hollywood ha integrato la consulenza scientifica non come semplice ornamento di credibilità, ma come elemento generativo della narrativa stessa. Il film dimostra che la fantascienza può essere insieme rigorosa e poetica: la relatività linguistica di Sapir-Whorf, la struttura logografica non-lineare, le tecniche di data mining diventano non semplici dettagli tecnici ma gli ingranaggi di una riflessione filosofica profonda sul linguaggio, il tempo e la coscienza umana.

Di Alex (pubblicato @ 08:00:00 in Storia Grecia Antica, letto 257 volte)

Il Partenone sull'Acropoli di Atene, capolavoro dell'ordine dorico greco

A partire dall'VIII secolo avanti Cristo, i Greci avviarono un processo di 'pietrificazione' dell'architettura templare, abbandonando legno e argilla per la pietra e il marmo. Codificarono tre ordini architettonici — dorico, ionico e corinzio — che ancora oggi plasmano l'estetica occidentale e si ritrovano in parlamenti, tribunali e musei di tutto il mondo. LEGGI TUTTO L'ARTICOLO

La pietrificazione dell'architettura templare

A partire dall'VIII secolo avanti Cristo, il mondo greco assistette a una delle trasformazioni più significative della storia dell'architettura: il passaggio dall'uso di materiali deperibili come il legno, l'argilla essiccata al sole e le coperture di paglia all'impiego della pietra calcarea prima e del marmo poi per la costruzione dei templi sacri. Questo processo, che gli studiosi moderni definiscono "pietrificazione", non fu immediato né uniforme, ma si sviluppò gradualmente nell'arco di diverse generazioni, seguendo percorsi regionali differenziati. I templi greci non erano luoghi di culto collettivo nel senso moderno del termine: al loro interno era custodita la statua della divinità, mentre i rituali sacrificali si svolgevano all'esterno, sull'altare posto davanti alla facciata principale. La funzione del tempio era dunque quella di casa della divinità, e la sua grandiosità rifletteva la ricchezza e il potere politico della comunità che lo aveva eretto.

L'ordine dorico: severità e monumentalità

Il più antico e austero degli ordini architettonici greci è il dorico, originatosi nel Peloponneso e nella Grecia continentale tra il VII e il VI secolo avanti Cristo. L'ordine dorico si distingue per la sua caratteristica mancanza di base: la colonna poggia direttamente sullo stilobate, la piattaforma su cui sorge il tempio, con un effetto di massività e solidità che trasmette un senso di severità monumentale. Il capitello dorico è ridotto all'essenziale: un echino a forma di disco e un abaco quadrato senza decorazioni. La trabeazione comprende il fregio dorico, suddiviso in triglifi — elementi scanalati alternati — e metope, pannelli che potevano essere lasciati lisci o decorati con sculture. Il Partenone di Atene, completato nel 432 avanti Cristo, e i templi di Paestum nella Magna Grecia rappresentano i vertici assoluti di questo stile, capaci di fondere perfezione matematica e forza espressiva in una sintesi irripetibile.

L'ordine ionico e il corinzio: eleganza e ornamento

L'ordine ionico si sviluppò sulle coste dell'Asia Minore e nelle isole dell'Egeo tra il VI e il V secolo avanti Cristo, in contatto con le raffinate civiltà orientali della Lidia e della Persia. A differenza del dorico, la colonna ionica poggia su una base modanata e presenta un fusto più slanciato ed elegante. Il suo elemento caratteristico è il capitello con le due grandi volute laterali a spirale, che conferiscono alla colonna un aspetto dinamico e ornamentale. L'Eretteo sull'Acropoli di Atene, con le sue celebri cariatidi, è uno degli esempi più raffinati di questo ordine. L'ordine corinzio, nato secondo la tradizione a Corinto nel V secolo avanti Cristo per opera dello scultore Callimaco, si distinse immediatamente per il suo capitello sontuosamente decorato con foglie di acanto intrecciate, destinate a diventare uno dei motivi ornamentali più fortunati di tutta la storia dell'arte occidentale. Accolto con grande entusiasmo in età ellenistica e poi romana, il corinzio divenne l'ordine per eccellenza delle architetture imperiali.

L'acropoli e l'agorà: la struttura della polis greca

La città greca, la polis, si organizzava tipicamente attorno a due fulcri complementari che rispecchiavano le due dimensioni fondamentali della vita civile: il sacro e il politico-commerciale. L'Acropoli — dal greco akros, sommità, e polis, città — era la cittadella sacra posta in posizione dominante sulla cima di una rupe o di un colle, originariamente luogo di rifugio difensivo e in seguito sede dei più importanti templi civici. Con il tempo essa divenne soprattutto il cuore religioso della comunità, il luogo dove risiedeva la divinità protettrice della polis. L'Agorà era invece la piazza bassa della città, il cuore pulsante della vita quotidiana: uno spazio aperto circondato da portici coperti detti stoai, che accoglieva i mercati, le assemblee dei cittadini, i tribunali e le botteghe. Nell'agorà si svolgeva non solo il commercio, ma anche il dibattito politico e filosofico che rese celebre la cultura greca in tutto il mondo antico. L'architettura greca ha esercitato un'influenza senza pari sull'intera civiltà occidentale: Roma la assimilò e la trasmise all'Europa, il Rinascimento la riscoprì come modello di perfezione, e il Neoclassicismo la ripropone ancora oggi nei grandi edifici pubblici, dalle banche ai musei, dai parlamenti alle università. Ogni colonna dorica, ogni capitello ionico che incontriamo nelle nostre città è un frammento vivo di quel miracolo intellettuale ed estetico che fu la civiltà greca.

Fotografie del 06/03/2026

Nessuna fotografia trovata.

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3 Visite guidate a Roma

Visite guidate a Roma

Think different!

Think different!

(p)Link

(p)Link Commenti

Commenti Storico

Storico Stampa

Stampa