\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 08/03/2026

La deputata Anna Paulina Luna durante un'audizione al Congresso degli Stati Uniti sui fenomeni aerei non identificati

La deputata Anna Paulina Luna ha portato al Congresso americano la questione dei fenomeni aerei non identificati. Denunciando ostacoli sistematici all'oversight parlamentare, ha affermato di aver visto, in contesto classificato, documentazione fotografica che ritiene di origine non umana, scuotendo il dibattito politico. LEGGI TUTTO L'ARTICOLO

Da UFO a UAP: il cambio di paradigma istituzionale

Per decenni, i fenomeni aerei non identificati — tradizionalmente noti come UFO, Unidentified Flying Objects — sono stati relegati ai margini del dibattito scientifico e politico ufficiale, associati alla cultura pop e alle teorie cospirazioniste. Questa marginalizzazione ha cominciato a cedere nel 2017, quando il New York Times pubblicò documenti e riprese classificate del Dipartimento della Difesa americano che mostravano incontri di piloti militari con oggetti dalle prestazioni aerodinamiche apparentemente impossibili. Da quel momento, il tema ha ricevuto un'attenzione istituzionale crescente.

La ridenominazione ufficiale da UFO a UAP — Unidentified Aerial Phenomena, o più recentemente Unidentified Anomalous Phenomena — riflette un deliberato cambiamento di approccio: l'obiettivo dichiarato è rimuovere lo stigma culturale associato al termine UFO e trattare il fenomeno come una questione di sicurezza nazionale meritevole di indagine rigorosa. Nel 2022, il Congresso ha istituito l'All-domain Anomaly Resolution Office (AARO), con il mandato di centralizzare la raccolta e l'analisi dei dati UAP provenienti da tutte le forze armate.

L'esperienza di Anna Paulina Luna: dal campo militare al Congresso

La deputata repubblicana Anna Paulina Luna, eletta in Florida, porta alla battaglia per la trasparenza UAP un background personale insolito. Ex militare con esperienza come airfield manager presso la Portland Air National Guard, ha raccontato di aver assistito, durante il suo servizio, a un'incursione nello spazio aereo che i piloti di F-15 con cui lavorava si rifiutavano di discutere apertamente. Quella reticenza, percepita come significativa da una professionista abituata alla cultura militare, ha lasciato un'impressione duratura.

Luna descrive un ambiente in cui esiste un forte stigma culturale attorno al tema UAP nelle forze armate: i piloti temono conseguenze per la propria carriera e per il mantenimento dello status di volo se segnalano incontri anomali. Questo stigma, secondo lei, ha storicamente soppresso informazioni preziose e continua a farlo nonostante le dichiarazioni ufficiali di incoraggiamento alle segnalazioni. Il problema non è solo individuale: è strutturale, radicato in decenni di cultura istituzionale che ha punito chi ha parlato.

L'indagine a Eglin Air Force Base e lo scontro con il Pentagono

Un episodio particolarmente significativo nel percorso investigativo di Luna riguarda la base aerea di Eglin, in Florida. Insieme ai colleghi Matt Gaetz e Tim Burchett, si è recata sulla base per verificare segnalazioni di piloti dell'USAF che sostenevano l'esistenza di un insabbiamento su incidenti UAP. Ciò che ha trovato, secondo la sua testimonianza, è stata una resistenza sistematica della catena di comando a condividere informazioni con i rappresentanti del Congresso.

Il punto di frizione principale riguarda i Programmi ad Accesso Speciale (SAP, Special Access Programs): programmi classificati a cui solo individui con specifici "read-in" ufficiali possono accedere. Luna denuncia che lei e altri membri del Congresso siano stati di fatto esclusi da informazioni relative a UAP perché "non read-in" su determinati SAP, una situazione che considera una distorsione grave del mandato costituzionale di oversight parlamentare. Il Congresso, che approva il bilancio della Difesa, si troverebbe nell'impossibilità di vigilare su programmi finanziati con fondi pubblici.

Le prove fotografiche in un contesto classificato (SCIF)

Tra le affermazioni più dirompenti di Anna Paulina Luna c'è quella relativa a documentazione fotografica visionata all'interno di una SCIF — Sensitive Compartmented Information Facility, un ambiente certificato per la discussione di materiale classificato al massimo livello. Senza poter entrare nei dettagli per ovvie ragioni di segretezza, Luna ha affermato pubblicamente che le fotografie viste in quella sede la rendono "molto sicura" dell'esistenza di oggetti di origine non umana.

Questa affermazione, proveniente da un membro del Congresso in carica con accesso ufficiale a materiale classificato, si distingue dalle dichiarazioni di appassionati o teorici del complotto. Rimane impossibile verificarla indipendentemente per definizione, ma il suo peso politico e simbolico è considerevole: riflette una convinzione maturata non sulla base di testimonianze di terze parti o materiale pubblico, ma di prove classificate a cui pochi hanno avuto accesso.

David Grusch, i whistleblower e la campagna di screditamento

Un caso centrale nel dibattito UAP è quello di David Grusch, ex ufficiale dell'intelligence americana che nel 2023 ha testimoniato sotto giuramento davanti al Congresso di essere a conoscenza di programmi governativi segreti per il recupero di veicoli non umani. Luna afferma di averlo incontrato personalmente e di aver appreso che, prima della sua testimonianza pubblica, avrebbe ricevuto minacce, seguite da un'operazione orchestrata per screditarlo.

Il meccanismo di risposta istituzionale ai whistleblower UAP — secondo Luna — segue uno schema ricorrente: la persona viene inizialmente ignorata, poi, se persiste, bersagliata da campagne di delegittimazione che ne mettono in discussione la salute mentale o la credibilità professionale. Questo schema, documentato in ambiti diversi dalla storia dei servizi di intelligence, renderebbe sistematicamente impossibile emergere per chiunque abbia informazioni genuine da condividere.

Al di là delle singole affermazioni, la battaglia di Anna Paulina Luna solleva una questione politica fondamentale: in una democrazia, il Congresso ha diritto di controllare ogni attività finanziata con fondi pubblici, anche la più classificata. Che l'origine dei fenomeni UAP sia tecnologica avversariale, naturale o altro, il diritto dei rappresentanti eletti di sapere rimane un principio cardine del governo democratico che non dovrebbe tollerare eccezioni.

Di Alex (pubblicato @ 16:00:00 in Storia Medioevo, letto 277 volte)

Miniatura medievale raffigurante crociati e mercanti nel porto di una città marinara

Dopo l'Anno Mille, l'Europa visse una straordinaria rinascita economica e demografica. Nuove tecnologie agricole moltiplicarono i raccolti, le città rifiorirono, nacquero i Comuni e le Repubbliche Marinare dominarono i mari. Le Crociate aprirono infine l'Occidente a un vitale scambio con l'Oriente. LEGGI TUTTO L'ARTICOLO

La rivoluzione agricola del Pieno Medioevo

L'Anno Mille non portò la catastrofe temuta da molti, ma inaugurò un'epoca di profonda trasformazione. L'introduzione dell'aratro pesante a versoio metallico, del collare rigido per i cavalli da tiro e della rotazione triennale delle colture — affiancata dalla diffusione capillare dei mulini ad acqua e a vento — generò un incremento senza precedenti dei rendimenti agricoli. Per la prima volta nella storia medievale, la produzione di cibo superò stabilmente il fabbisogno immediato delle comunità rurali.

Questo surplus alimentare segnò la fine dell'economia curtense di pura sussistenza. Le eccedenze potevano essere vendute nei mercati locali, innescando un processo di monetarizzazione degli scambi che, in pochi decenni, avrebbe rivoluzionato l'intera struttura sociale ed economica dell'Occidente. La popolazione europea crebbe rapidamente, e la pressione demografica spinse migliaia di contadini verso i centri abitati in cerca di nuove opportunità.

La fioritura delle città e il fenomeno comunale

La crescita urbana fu uno dei fenomeni più dirompenti del Pieno Medioevo, particolarmente vitale nell'Italia centro-settentrionale. Le città non erano più semplici centri religiosi o amministrativi: diventarono luoghi di produzione artigianale, scambio commerciale e, soprattutto, di organizzazione politica autonoma. I Liberi Comuni si affrancarono progressivamente dal controllo feudale e vescovile, rivendicando proprie magistrature, codici di legge e autonomia fiscale.

Questa emancipazione non fu indolore. I tentativi di restaurazione imperiale, come quelli di Federico I Barbarossa, si scontrarono con la resistenza organizzata delle città lombarde, culminata nella vittoriosa battaglia di Legnano del 1176. Il Comune rappresentava un modello politico radicalmente nuovo: una forma di governo basata sul consenso dei cittadini, che anticipava in molti aspetti i principi del governo rappresentativo moderno.

Le Repubbliche Marinare e la Lega Anseatica

Mentre le città dell'entroterra costruivano i propri comuni, le Repubbliche Marinare — Amalfi, Genova, Pisa e Venezia — riaprivano le grandi rotte del Mediterraneo, interrotte da secoli di instabilità. Grazie alle loro flotte da guerra e da commercio, questi Stati-città dominarono il traffico delle spezie, della seta, del cotone e di altri beni pregiati provenienti dall'Oriente. Venezia, in particolare, riuscì a costruire un vero e proprio impero commerciale con basi e fondachi in tutto il Levante.

Nel Nord Europa, un ruolo analogo fu svolto dalla Lega Anseatica, la confederazione di città mercantili tedesche e baltiche che controllava i commerci del Mar del Nord e del Baltico. Lubecca, Amburgo e Brema erano i suoi centri nevralgici. La Lega garantiva ai propri membri protezione militare, privilegi doganali e sistemi di regolazione del commercio che prefiguravano le moderne organizzazioni sovranazionali.

La nascita del sistema bancario moderno

L'intensificarsi degli scambi commerciali a lunga percorrenza pose urgenti problemi pratici: come trasportare grandi quantità di denaro in modo sicuro? Come finanziare spedizioni commerciali rischiose? Come gestire debiti e crediti tra mercanti separati da centinaia di chilometri? L'Italia medievale rispose a queste sfide inventando gli strumenti fondamentali della finanza moderna. La lettera di cambio — un documento che permetteva di trasferire denaro senza spostamento fisico di monete — rivoluzionò il commercio a distanza.

Le grandi famiglie bancarie fiorentine, senesi e genovesi divennero i finanziatori delle corone europee, concedendo prestiti a re e principi in cambio di privilegi commerciali. Le assicurazioni marittime nacquero per coprire i rischi delle traversate oceaniche, mentre le prime forme di società per azioni consentirono di raccogliere capitali da più investitori. Tuttavia, la dipendenza da debitori sovrani portò anche a clamorose bancarotte: le case dei Bardi e dei Peruzzi di Firenze crollarono nel XIV secolo proprio per i debiti insoluti della corona inglese.

Le Crociate: fede, politica e interessi commerciali

L'espansionismo militare e spirituale dell'Occidente medievale trovò la sua massima espressione nelle Crociate. Nel 1095, papa Urbano II lanciò a Clermont un appello accorato per soccorrere l'Impero Bizantino, minacciato dall'avanzata dei Turchi Selgiuchidi, e per liberare il Santo Sepolcro di Gerusalemme. La risposta fu travolgente: nobili, cavalieri e contadini si mossero in ondate successive verso la Terrasanta, animati da motivazioni diverse — fede penitenziale, sete di avventura, desiderio di terre o semplicemente spirito bellicoso.

Dietro la retorica religiosa si celavano potenti interessi economici e politici. Le Repubbliche Marinare sfruttarono le spedizioni per ottenere lucrosi monopoli commerciali e quartieri esenti da dazi nei porti del Levante. Venezia, in modo particolarmente spregiudicato, riuscì a dirottare la Quarta Crociata verso Costantinopoli nel 1204, saccheggiando la capitale bizantina e fondando un proprio impero coloniale nell'Egeo.

Gli ordini religiosi cavallereschi

La necessità di proteggere i pellegrini e difendere i fragili Stati Crociati generò un fenomeno istituzionale del tutto originale: gli Ordini Religiosi Cavallereschi. I Templari, fondati attorno al 1120, fondevano la disciplina monastica con l'efficienza militare: i loro cavalieri pronunciavano voti di povertà, castità e obbedienza, ma combattevano sul campo di battaglia con un addestramento d'élite. Gli Ospitalieri, nati come confraternita di assistenza ai pellegrini ammalati, assunsero progressivamente anche funzioni militari.

I Cavalieri Teutonici, originariamente attivi in Terrasanta, spostarono poi la loro azione verso il Nord Europa, diventando protagonisti della colonizzazione militare delle regioni baltiche. Questi ordini accumularono enormi ricchezze e proprietà fondiarie in tutta Europa, diventando potenze politiche ed economiche di primo piano. Il Tempio, in particolare, sviluppò un sofisticato sistema bancario protocontinentale che anticipò molte funzioni delle banche moderne.

Le Crociate interne e la colonizzazione del Nord

Il concetto di "guerra santa" non rimase confinato alla Terrasanta. Il papato lo utilizzò anche contro i nemici interni della cristianità. La Crociata Albigese, avviata nel 1209 contro l'eresia catara nella regione francese dell'Occitania, fu un conflitto di eccezionale brutalità che si concluse solo nel 1229 con lo sterminio pratico di quella cultura. L'operazione permise alla corona capetingia di annettere un territorio ricco e culturalmente vivace, trasformando una crociata religiosa in uno strumento di espansione politica.

Nel Nord Europa, le Crociate del Nord portarono all'assimilazione forzata e alla colonizzazione delle regioni baltiche e finniche, con i Cavalieri Teutonici come protagonisti. Le popolazioni native — Prussiani, Livoni, Estoni — furono sottomesse militarmente e convertite al Cristianesimo con metodi coercitivi, mentre coloni tedeschi si insediarono nelle terre conquistate, fondando città come Riga e Tallinn.

Il trasferimento di saperi tra Oriente e Occidente

Nonostante i violenti conflitti, e le drammatiche ondate di antisemitismo che accompagnarono le spedizioni — con i pogrom perpetrati contro le comunità ebraiche in Renania già durante la Prima Crociata — i contatti con l'Oriente innescarono un vitale trasferimento di conoscenze. Matematica, astronomia, filosofia, medicina: la civiltà arabo-islamica aveva conservato e sviluppato il patrimonio classico greco in secoli di straordinaria fioritura intellettuale.

Personaggi come Leonardo Fibonacci, che apprese nel Nord Africa la matematica araba e reintrodusse in Europa il sistema posizionale decimale e il concetto di zero, e Marco Polo, che aprì lo sguardo europeo verso i domini mongoli e cinesi, testimoniano la permeabilità culturale di un'epoca tutt'altro che chiusa in sé stessa. Il Medioevo, spesso ridotto a secoli bui, fu in realtà il laboratorio in cui si forgiarono le fondamenta dell'Europa moderna.

Di Alex (pubblicato @ 15:00:00 in Nuove Tecnologie, letto 361 volte)

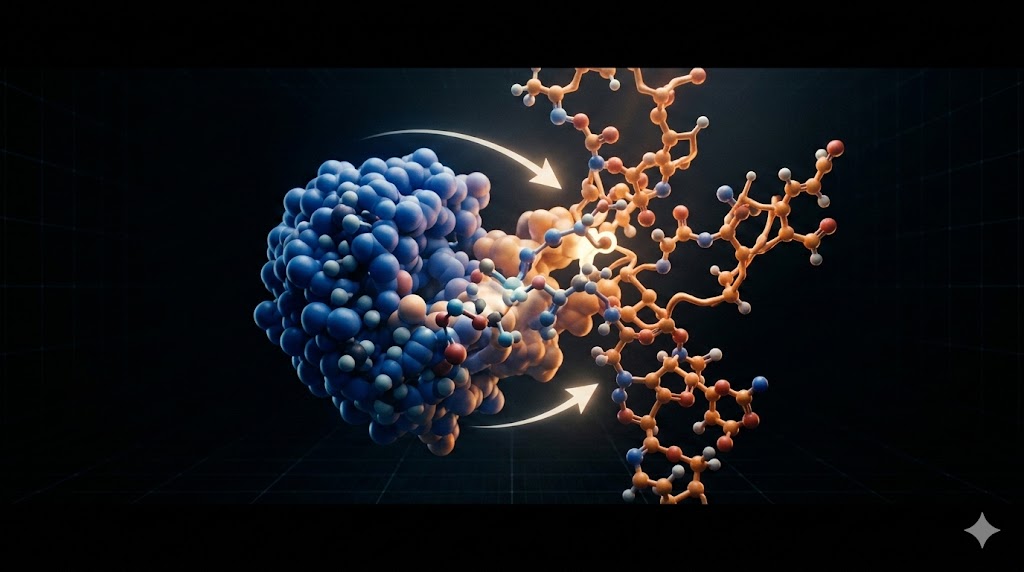

Rappresentazione tridimensionale di una proteina artificiale mutaforma che cambia conformazione in risposta a stimoli chimici

All'Università della California è stata creata la prima proteina artificiale mutaforma tramite calcolo avanzato. Queste molecole cambiano struttura in risposta a stimoli specifici, aprendo nuove frontiere per la somministrazione mirata di farmaci e la creazione di biosensori biologici intelligenti senza precedenti. LEGGI TUTTO L'ARTICOLO

Il design computazionale delle proteine: una nuova frontiera

Per decenni, la biologia molecolare ha studiato le proteine naturali — le molecole che eseguono praticamente ogni funzione biologica all'interno delle cellule — cercando di capire come la loro sequenza di aminoacidi determini la loro struttura tridimensionale e, di conseguenza, la loro funzione. Questo problema, noto come "protein folding", era considerato uno dei più difficili della biologia computazionale, fino a quando nel 2020 il sistema AlphaFold di DeepMind non ha rivoluzionato il campo, prevedendo con precisione senza precedenti la struttura di quasi tutte le proteine conosciute.

Ma il problema inverso — progettare una nuova sequenza aminoacidica che produca una proteina con una funzione desiderata — è ancora più complesso. Il design computazionale delle proteine mira a creare molecole che la natura non ha mai elaborato, con proprietà su misura per applicazioni terapeutiche, industriali e di diagnostica. Presso l'Università della California, questo approccio ha portato a una scoperta di portata potenzialmente rivoluzionaria: la prima proteina artificiale mutaforma creata interamente tramite calcolo avanzato.

Come funziona una proteina mutaforma

In natura, alcune proteine — come i recettori cellulari o i canali ionici — sono già in grado di cambiare conformazione in risposta a specifici segnali chimici o fisici. Questa proprietà, chiamata allostery, è fondamentale per la trasduzione del segnale biologico: una molecola piccola si lega in un punto della proteina e induce un cambiamento strutturale che modifica l'attività in un sito distante. Le proteine artificiali mutaforma progettate dall'équipe californiana sfruttano questo principio, ma lo portano a un livello di controllo e specificità non raggiungibile dalle molecole naturali.

Il meccanismo funziona così: i ricercatori utilizzano algoritmi di design computazionale per progettare una sequenza aminoacidica capace di adottare due strutture tridimensionali stabili e distinte. In assenza di stimolo, la proteina si trova in una conformazione "inattiva"; quando incontra una specifica molecola trigger — che può essere un farmaco, un metallo, un pH specifico o una luce di determinata lunghezza d'onda — cambia radicalmente forma, passando alla conformazione "attiva" con proprietà funzionali completamente diverse. Questo cambio è reversibile e controllabile con grande precisione.

Applicazioni nella somministrazione mirata di farmaci

Una delle applicazioni più promettenti delle proteine mutaforma riguarda la drug delivery — la somministrazione mirata di farmaci alle cellule malate. Uno dei problemi fondamentali della chemioterapia oncologica tradizionale è la tossicità sistemica: il farmaco non distingue tra cellule tumorali e cellule sane, causando gravi effetti collaterali. Una proteina artificiale progettata per "aprirsi" e rilasciare il farmaco contenuto solo in presenza di molecole-segnale caratteristiche del microambiente tumorale — come specifici livelli di acidità o particolari proteine di superficie — permetterebbe una terapia chirurgicamente precisa.

I primi test in vitro hanno mostrato risultati incoraggianti: le proteine mutaforma artificiali sono in grado di incapsulare molecole farmacologiche nella conformazione chiusa e di rilasciarle selettivamente in risposta al trigger programmato. Il passo successivo — la validazione in modelli animali e, eventualmente, negli studi clinici sull'uomo — richiederà anni di lavoro, ma la prova di concetto è stata stabilita con chiarezza.

Biosensori biologici intelligenti

Un'altra applicazione di grande interesse è lo sviluppo di biosensori di nuova generazione. I biosensori tradizionali rilevano la presenza di molecole bersaglio attraverso reazioni chimiche relativamente semplici; i biosensori basati su proteine mutaforma potrebbero invece eseguire elaborazioni logiche, rispondendo non a singoli stimoli ma a combinazioni di segnali con una precisione del tutto nuova. Una proteina progettata per cambiare conformazione solo quando contemporaneamente presente una molecola A e assente una molecola B potrebbe, di fatto, eseguire un'operazione logica AND NOT a livello molecolare.

Questa capacità computazionale biochimica apre la strada a diagnostiche di laboratorio capaci di rilevare malattie in stadi precocissimi con sensibilità e specificità superiori ai test attuali, a sistemi di monitoraggio continuo impiantabili che segnalano in tempo reale variazioni delle condizioni fisiologiche, e persino a reti neurali molecolari — sistemi che processano informazioni usando reazioni chimiche invece di transistor elettronici.

La creazione di proteine artificiali mutaforma rappresenta uno dei più significativi progressi della biologia sintetica degli ultimi anni. Dimostra che il confine tra ingegneria e biologia è ormai dissolto, e che le molecole della vita possono essere progettate con la stessa logica con cui si progetta un software. Il corpo umano del futuro potrebbe essere custodito e riparato da proteine che nessuna cellula ha mai prodotto, ma che un algoritmo ha immaginato per noi.

Di Alex (pubblicato @ 14:00:00 in Scienza e Spazio, letto 271 volte)

Rendering artistico del Lunar Gateway con il modulo Crew and Science Airlock agganciato in orbita cislunare

Nel marzo del 2031, la missione Artemis VI consegnerà al Lunar Gateway il Crew and Science Airlock. Questa camera di equilibrio permetterà il trasferimento di apparecchiature scientifiche tra l'habitat pressurizzato e il vuoto cislunare, aprendo nuove possibilità di ricerca spaziale a lunga durata mai esplorate prima. LEGGI TUTTO L'ARTICOLO

Il Lunar Gateway: un avamposto umano in orbita lunare

Il Lunar Gateway è la stazione spaziale internazionale che la NASA, in collaborazione con ESA, JAXA, CSA e altri partner, sta costruendo in orbita cislunare nell'ambito del programma Artemis. A differenza della Stazione Spaziale Internazionale, che orbita a circa 400 chilometri dalla Terra, il Gateway si troverà in un'orbita altamente ellittica attorno alla Luna, variando la sua distanza dalla superficie lunare tra alcune migliaia e decine di migliaia di chilometri. Questa posizione strategica lo rende un nodo logistico ideale per le operazioni lunari e un trampolino verso l'esplorazione più profonda del Sistema Solare.

Il Gateway è progettato per non essere presidiato in modo permanente: le missioni Artemis vi si agganceranno periodicamente, lasciando equipaggi a bordo per settimane o mesi, alternati a periodi di operazione autonoma non presidiata. Questa flessibilità, unita alle sue ridotte dimensioni rispetto alla ISS, lo rende una piattaforma di esplorazione più agile ed economica, adattabile alle esigenze delle singole missioni.

Artemis VI e il Crew and Science Airlock

La missione Artemis VI, pianificata per il marzo del 2031, avrà tra i suoi obiettivi principali la consegna e l'installazione del Crew and Science Airlock, un modulo di fondamentale importanza per le capacità operative della stazione. Una camera di equilibrio spaziale — l'airlock — è un volume pressurizzato con due porte stagne che permette di passare dall'interno pressurizzato di una struttura al vuoto esterno senza compromettere l'atmosfera interna. È, in senso letterale, una porta sullo spazio.

Il Crew and Science Airlock del Gateway è progettato per svolgere una duplice funzione. Come airlock per equipaggio, supporterà le attività extraveicolari (EVA) degli astronauti che eseguiranno ispezioni, manutenzione o lavori scientifici all'esterno della stazione. Come airlock scientifico, consentirà il trasferimento di strumenti, esperimenti e carichi utili dall'ambiente pressurizzato all'esposizione diretta al vuoto cislunare, senza la necessità di una EVA completa.

La ricerca scientifica nel vuoto cislunare

L'opportunità di esporre esperimenti direttamente al vuoto cislunare — lontano dalla magnetosfera terrestre e dalla sua protezione dalle radiazioni cosmiche — è di straordinaria importanza scientifica. L'ambiente spaziale profondo offre condizioni impossibili da replicare sulla Terra o in orbita terrestre bassa: flussi di radiazione cosmica galattici di alta energia, irraggiamento solare non filtrato, temperature cicliche da -180 a +130 gradi centigradi, e un vuoto di qualità superiore a quello ottenibile nei laboratori.

I tipi di esperimenti che il Science Airlock renderà possibili includono la scienza dei materiali — studio del degrado di leghe, polimeri e rivestimenti in condizioni spaziali prolungate — la biologia spaziale, l'astrofisica delle alte energie con rivelatori di particelle, e la tecnologia dei satelliti di piccole dimensioni. I CubeSat e nanosatelliti potranno essere lanciati direttamente dall'airlock in orbita cislunare, senza necessità di missioni di lancio dedicate.

La logistica spaziale: carichi utili e sistemi di trasferimento

Oltre alla funzione scientifica, il Crew and Science Airlock sarà un elemento critico della logistica del Gateway. Con la crescente frequenza delle missioni lunari previste nel programma Artemis, la capacità di trasferire efficientemente carichi utili tra l'interno della stazione e i veicoli agganciati all'esterno — o di esporli al vuoto per test di qualificazione — diventa operativamente essenziale. Il modulo è dotato di sistemi di handling meccanizzati per facilitare la movimentazione di oggetti pesanti senza usurare il tempo prezioso degli astronauti.

I sensori di rilevamento e i sistemi di comunicazione integrati nel modulo permetteranno di monitorare in tempo reale le condizioni degli esperimenti esposti, trasmettendo dati continui al team scientifico a Terra. In caso di anomalie — variazioni impreviste di temperatura, impatto di micrometeoriti, guasti strumentali — il sistema può richiamare automaticamente l'esperimento nell'airlock per protezione, salvaguardando mesi di preparazione scientifica.

Il Crew and Science Airlock di Artemis VI rappresenta molto più di un componente tecnico: è la materializzazione dell'ambizione umana di rendere permanente la propria presenza oltre l'orbita terrestre. Con il Gateway pienamente operativo, la Luna cesserà di essere una destinazione occasionale per diventare una frontiera abituale, il primo passo concreto verso un futuro in cui l'umanità è una specie multiplanetaria.

Di Alex (pubblicato @ 13:00:00 in Scienza e Tecnologia, letto 293 volte)

Sorgente idrotermale sul fondo oceanico, uno dei candidati ambienti per l'origine della vita sulla Terra

La scienza non è un libro chiuso: esistono fenomeni che sfidano ancora ogni spiegazione. Tra questi, il mistero dell'abiogenesi — come la materia inanimata sia diventata vita — rimane uno dei più profondi. Teorie contrapposte e sperimentazioni d'avanguardia animano un dibattito che non ha ancora trovato risposta definitiva. LEGGI TUTTO L'ARTICOLO

Il problema dell'abiogenesi: la domanda più antica della scienza

Come la materia inanimata è diventata vita? Questa domanda, che i filosofi greci formulavano in termini di "generazione spontanea", ha trovato nel XX secolo una risposta parziale ma rivoluzionaria: la vita non nasce spontaneamente da materia complessa (come pensavano Aristotele e i medievali), ma si è originata miliardi di anni fa, una sola volta o pochissime volte, attraverso un processo chimico lungo e graduale che trasformò molecole organiche semplici in sistemi capaci di auto-replicarsi e di evolvere.

Questa transizione — dall'abiologico al biologico — è ciò che i ricercatori chiamano abiogenesi. Nonostante decenni di ricerche intensive, il processo rimane incompreso nei suoi passaggi fondamentali. La difficoltà principale è che non abbiamo testimonianze dirette di ciò che accadde circa 3,8 miliardi di anni fa, quando i primi sistemi biologici comparvero sulla Terra primordiale. Dobbiamo ricostruire un evento unico e irripetibile dai suoi effetti, ossia la vita come la conosciamo oggi.

La teoria del "Mondo a RNA"

Una delle ipotesi più accreditate sull'origine della vita è quella del Mondo a RNA, proposta negli anni Ottanta del Novecento indipendentemente da Walter Gilbert, Carl Woese e Francis Crick. Il DNA, la molecola che custodisce il codice genetico di tutti gli esseri viventi, non può replicarsi senza proteine; e le proteine non possono essere sintetizzate senza DNA. Questo circolo apparentemente vizioso ha fatto a lungo sembrare impossibile l'origine spontanea della vita.

L'RNA risolve elegantemente il paradosso: a differenza del DNA, l'RNA è capace sia di portare informazione genetica — come il DNA — sia di svolgere funzioni catalitiche — come le proteine. I ribozimi, molecole di RNA dotate di attività enzimatica, dimostrano che questa doppia funzione è realizzabile. Secondo la teoria del Mondo a RNA, le prime forme di vita erano sistemi basati esclusivamente su RNA autocatalitico, che si replicavano e si evolvevano in assenza sia di DNA che di proteine. Il DNA e le proteine sarebbero emersi successivamente come specializzazioni più efficienti.

La teoria "Metabolismo Primo"

Una visione alternativa e per molti versi complementare è quella del "Metabolismo Primo", sostenuta da scienziati come Günter Wächtershäuser e Nick Lane. Secondo questo modello, la vita non è nata attorno a molecole replicanti, ma attorno a cicli chimici auto-sostenuti — precursori del metabolismo cellulare — che convertivano energia e materia in maniera continua. In questa prospettiva, il metabolismo viene prima della genetica: i sistemi primitivi imparavano a sfruttare gradienti energetici naturali prima ancora di sviluppare meccanismi di copiatura dell'informazione.

Le sorgenti idrotermali alcaline dei fondali oceanici, come il campo Lost City scoperto nell'Atlantico nel 2000, sono considerate candidati ideali per la culla della vita secondo questo modello. Queste strutture, formate da reazioni geologiche tra l'acqua di mare e le rocce del mantello, producono gradienti di pH e temperatura simili a quelli che le cellule usano per generare energia attraverso la chemiosmosi. Secondo Lane e collaboratori, la vita potrebbe letteralmente essere nata sfruttando questi gradienti naturali per costruire le prime membrane e i primi cicli metabolici.

Sorgenti idrotermali e piscine di Darwin: ambienti a confronto

Il dibattito sull'ambiente primordiale della vita è ancora vivace. Da un lato ci sono le sorgenti idrotermali dei fondali oceanici; dall'altro, un'ipotesi alternativa che richiama la famosa intuizione di Charles Darwin sulle "piccole pozze calde". Recenti ricerche australiane hanno individuato nelle piscine geotermali continentali — ambienti con cicli di essiccamento e reidratazione — condizioni ideali per la concentrazione e la polimerizzazione delle molecole organiche.

Questi due ambienti non sono necessariamente in competizione: è possibile che diversi passaggi verso la vita siano avvenuti in luoghi diversi, o che life sia emersa più volte in modo indipendente, con una sola linea evolutiva che ha poi colonizzato il pianeta. La risposta definitiva richiederà probabilmente la sintesi di un sistema vivente artificiale dal nulla in laboratorio — un obiettivo che la biologia sintetica sta lentamente avvicinando.

Il mistero dell'abiogenesi non è un fallimento della scienza: è la prova della sua onestà intellettuale. Riconoscere ciò che non si sa è il primo passo per scoprirlo. Ogni molecola di RNA autocatalitico sintetizzata in laboratorio, ogni sorgente idrotermale esplorata dai robot sottomarini, ogni modello computazionale della cellula primordiale ci avvicina alla risposta più profonda che l'umanità abbia mai cercato: cosa siamo, e come siamo cominciati.

Di Alex (pubblicato @ 12:00:00 in Scienza e Tecnologia, letto 310 volte)

Interfaccia di un sistema AI generativo per il design molecolare di farmaci con strutture chimiche visualizzate in 3D

La ricerca medica vive una nuova metamorfosi. L'intelligenza artificiale generativa e i modelli profondi permettono di progettare molecole terapeutiche esplorando milioni di strutture chimiche. I gemelli digitali simulano poi la risposta del paziente, riducendo drasticamente tempi, costi e rischi della sperimentazione clinica. LEGGI TUTTO L'ARTICOLO

Il modello tradizionale di scoperta dei farmaci e i suoi limiti

Per decenni, la farmacologia moderna si è basata sul paradigma della Target-Based Drug Discovery (TBDD): i ricercatori identificano una proteina o un enzima coinvolto in una malattia, ne determinano la struttura tridimensionale, e cercano molecole capaci di legarsi a quel bersaglio bloccandone o attivandone la funzione. Questo approccio ha prodotto farmaci di straordinaria efficacia — dagli inibitori delle proteasi per l'HIV agli anticorpi monoclonali oncologici — ma presenta limiti strutturali sempre più evidenti.

Il principale limite è la tassonomia riduttiva della malattia: molte patologie, soprattutto quelle neurodegenerative e psichiatriche, non hanno un singolo bersaglio molecolare ben definito, ma emergono da reti complesse di interazioni tra centinaia di proteine. Progettare un farmaco contro un singolo bersaglio in questi contesti produce spesso efficacia clinica limitata o effetti indesiderati legati all'inibizione di vie biologiche condivise. I costi e i tempi di sviluppo sono esplosi: portare un nuovo farmaco dalla scoperta all'approvazione richiede oggi in media 12-15 anni e oltre un miliardo di euro di investimento.

La Phenotypic Drug Discovery e il ritorno all'empirismo intelligente

In risposta a questi limiti, negli ultimi anni ha guadagnato terreno un approccio alternativo noto come Phenotypic Drug Discovery (PDD). Invece di partire da un bersaglio molecolare noto, la PDD parte dall'osservazione di effetti biologici macroscopici: si testa un grande numero di molecole su modelli cellulari o animali di malattia e si selezionano quelle che producono il miglioramento desiderato del fenotipo — il comportamento, la morfologia o la funzionalità delle cellule malate — indipendentemente dalla comprensione del meccanismo d'azione.

Questo approccio empirico non è nuovo — molti farmaci storici, dagli antidepressivi alle statine, sono stati scoperti fenotipicamente — ma è stato riabilitato dalla disponibilità di tecnologie di screening massivo ad alta automazione (High-Throughput Screening) e, soprattutto, dall'intelligenza artificiale, che permette di analizzare i dati generati da milioni di esperimenti alla ricerca di pattern invisibili all'analisi umana.

L'intelligenza artificiale generativa e il design molecolare de novo

Il contributo più dirompente dell'intelligenza artificiale alla farmacologia moderna è la capacità dei Deep Generative Models (DGM) di creare nuove strutture molecolari "de novo" — letteralmente, dal nulla. Sistemi come i Variational Autoencoders e le Generative Adversarial Networks, addestrati su biblioteche di milioni di molecole note con le loro proprietà biologiche, hanno imparato a navigare lo spazio chimico come un territorio cartografato, suggerendo nuove molecole che soddisfino contemporaneamente requisiti di efficacia sul bersaglio, sicurezza tossicologica, stabilità metabolica e proprietà farmacocinetiche favorevoli.

Lo spazio chimico teoricamente esplorabile — tutte le possibili molecole organiche stabili con un peso molecolare inferiore a 500 dalton — conta un numero di entità superiore ai 10 elevato alla 60: molto più degli atomi nell'universo osservabile. Nessuna campagna di sintesi chimica tradizionale potrà mai esplorarla interamente. I modelli generativi permettono di concentrare la ricerca nelle regioni più promettenti di questo spazio sconfinato, riducendo drammaticamente i costi e i tempi della fase di ottimizzazione chimica.

I gemelli digitali del paziente

Una delle innovazioni più affascinanti dell'intelligenza artificiale applicata alla medicina è il concetto di Digital Twin — gemello digitale. Un gemello digitale del paziente è un modello computazionale individualizzato che integra dati genomici, proteomici, metabolomici, clinici e di imaging per simulare il comportamento biologico di uno specifico individuo in risposta a un farmaco o a un trattamento. Non un modello medio di "paziente tipo", ma una simulazione personalizzata che riflette l'unicità biologica di ogni persona.

Applicato alla sperimentazione clinica, il gemello digitale permette di "testare" virtualmente un farmaco su un paziente simulato prima di somministrarglielo realmente, prevedendo con buona approssimazione l'efficacia e il profilo di sicurezza individuale. Questo approccio potrebbe rivoluzionare la medicina oncologica personalizzata, dove la scelta del farmaco ottimale tra decine di opzioni disponibili è ancora in larga misura empirica e basata su tentativi successivi, spesso a discapito del tempo prezioso del paziente.

La medicina sta diventando sempre più molecolare, predittiva e personalizzata. Se un tempo il medico cercava di ripristinare un ipotetico equilibrio umorale, il ricercatore di oggi interviene direttamente sui meccanismi subcellulari, armato di intelligenza artificiale e modelli computazionali di straordinaria potenza. Le scoperte di questa stagione scientifica non sono solo traguardi tecnici: sono i capitoli di un'epopea che sta trasformando il mistero della malattia in una sfida razionalmente risolvibile.

Di Alex (pubblicato @ 11:00:00 in Smartphone, letto 309 volte)

Il prototipo Honor Robot Phone con il braccio robotico esteso e la fotocamera su gimbal a tre assi in primo piano

Honor ha presentato al Mobile World Congress di Barcellona il Robot Phone, il primo smartphone dotato di un braccio robotico che fa emergere una fotocamera su gimbal a tre assi. Con un sensore da 200 MP guidato dall'intelligenza artificiale, segue i soggetti come la testa pensante del dispositivo. LEGGI TUTTO L'ARTICOLO

OFFERTA

🛒 Compralo ora su

|

Il Robot Phone: quando lo smartphone incontra la robotica

Honor, il produttore cinese di smartphone che si è affermato come uno dei marchi più innovativi del settore mobile, ha scelto il palcoscenico del Mobile World Congress di Barcellona per svelare un dispositivo che ridefinisce i confini del concetto di smartphone. Il Robot Phone non è semplicemente uno smartphone con una fotocamera migliore: è un ibrido tra telefono e robot, un oggetto che fa emergere letteralmente una parte di sé per interagire con l'ambiente circostante. L'evento di presentazione si è riempito rapidamente, segnale di un'attesa già elettrica tra i professionisti del settore.

Il cuore dell'innovazione è un minuscolo braccio robotico integrato nella scocca superiore del dispositivo, in grado di staccarsi dal corpo del telefono per far emergere nella parte alta dello schermo una piccola fotocamera montata su un gimbal motorizzato. Quando non è in uso, il meccanismo si ritrae completamente all'interno della scocca, mantenendo il profilo sottile e il design lineare di uno smartphone tradizionale. L'integrazione meccanica è così riuscita che l'intero sistema risulta quasi invisibile a dispositivo chiuso.

La miniaturizzazione: ingegneria al limite del possibile

La sfida ingegneristica affrontata da Honor nella realizzazione del Robot Phone è considerevole. L'intero sistema robotico — braccio, gimbal, motori, sensore fotografico e cablaggio — deve essere contenuto in un volume minimo, integrarsi con la struttura portante dello smartphone, sopportare migliaia di cicli di estensione e retrazione senza degrado meccanico, e funzionare senza drenare eccessivamente la batteria. I motori che azionano il meccanismo sono più piccoli di una moneta da un euro, ma sufficientemente potenti da muovere il gimbal con rapidità e precisione.

Il gimbal a tre assi è stato sviluppato in collaborazione con ARR, un'azienda con esperienza nella produzione di sistemi di stabilizzazione per il cinema professionale. Questa partnership ha portato all'applicazione di tecnologie normalmente riservate alle produzioni cinematografiche di alto livello in un dispositivo consumer tascabile. La costruzione del gimbal deve bilanciare leggerezza, rigidità strutturale, ampiezza del range di movimento e velocità di risposta: requisiti spesso in contraddizione che richiedono soluzioni di compromesso ingegneristicamente sofisticate.

Il sensore da 200 MP e le capacità fotografiche

Al centro del gimbal è alloggiato un sensore fotografico da 200 megapixel, una risoluzione che fino a pochi anni fa era appannaggio esclusivo delle fotocamere reflex professionali. Questa risoluzione straordinaria permette di catturare immagini con un livello di dettaglio tale da consentire ritagli massivi senza perdita percettibile di qualità — una funzionalità preziosa per chi scatta con intenzione di ricadrage in post-produzione o di stampare a grandi formati.

La mobilità del gimbal moltiplica le possibilità d'uso del sensore. Potendo ruotare su tre assi in modo indipendente, la fotocamera può fungere da telecamera frontale per video e selfie di altissima qualità — con la stabilizzazione meccanica che elimina ogni tremore — da sistema di tracking automatico del soggetto durante le riprese in movimento, e da sensore zenitale per angolazioni impossibili con le fotocamere fisse. La versatilità ottica che ne risulta è senza precedenti in un dispositivo mobile.

L'intelligenza artificiale che anima il Robot Phone

Il gimbal del Robot Phone non si muove solo su comando manuale: è guidato da algoritmi di intelligenza artificiale per il tracking automatico dei soggetti. Durante la presentazione di Barcellona, il dispositivo ha dimostrato di seguire in tempo reale i movimenti di una ballerina di flamenco, anticipandone le traiettorie e mantenendola sempre nel centro del fotogramma con fluidità impressionante. Il sistema riconosce i soggetti designati dall'utente e li segue attraverso tutto il campo visivo coperto dal range di movimento del gimbal.

Le capacità comportamentali del gimbal vanno oltre il semplice tracking: il dispositivo è in grado di "reagire" alla musica, sincronizzando i propri movimenti con il ritmo dell'audio riprodotto dallo smartphone. Questo crea un effetto quasi antropomorfico — come se il telefono stesse annuendo o ballando — che Honor usa deliberatamente come elemento di identità del prodotto, trasformando la fotocamera in una vera e propria "testa" del dispositivo con una sua espressività.

Il Robot Phone presentato a Barcellona è ancora un prototipo in fase di sviluppo, non pronto per il lancio commerciale. Tuttavia, il fatto che funzioni già con convincente efficacia dimostra che la visione di Honor non è speculativa: è un'ingegneria concreta, verificabile, in attesa di ottimizzazione. Quando arriverà sul mercato, ridefinirà non solo la fotografia mobile, ma l'idea stessa di cosa possa essere uno smartphone.

Di Alex (pubblicato @ 10:00:00 in Sci-Fi e Rigore Scientifico, letto 296 volte)

Supervisore VFX al lavoro su simulazioni di fumo e distruzione in un software di effetti visivi moderno

La fantascienza moderna si affida a pipeline di effetti visivi di straordinaria precisione tecnica. Software come Houdini simulano le leggi della fisica, mentre Maya e Nuke garantiscono l'integrazione tra elementi digitali e riprese dal vivo, rendendo credibili mondi che non possono esistere nella realtà. LEGGI TUTTO L'ARTICOLO

Il pipeline VFX moderno: dalla sceneggiatura allo schermo

La creazione di effetti visivi convincenti per la fantascienza contemporanea non è un processo creativo libero: è un'operazione ingegneristica di precisione che coinvolge centinaia di professionisti e software specializzati, organizzati in un flusso di lavoro chiamato "pipeline". Dalla pre-produzione — dove i supervisori VFX collaborano con registi e direttori della fotografia per pianificare ogni sequenza — fino alla post-produzione finale, ogni passaggio è codificato e documentato per garantire coerenza visiva e rispetto delle leggi fisiche.

Il paradigma che guida la fantascienza rigorosa non è quello della fantasia arbitraria, ma del realismo percettivo: ogni elemento — che si tratti di un pianeta alieno, di un vascello spaziale o di un'esplosione in microgravità — deve comportarsi esattamente come le leggi della fisica prevederebbero. Questo approccio richiede una conoscenza approfondita di termodinamica, fluidodinamica, ottica e fisica dei materiali da parte degli artisti VFX.

SideFX Houdini: la simulazione fisica come linguaggio creativo

Tra i software diventati standard nell'industria VFX, SideFX Houdini occupa una posizione dominante per la creazione di effetti procedurale basati su simulazione fisica. A differenza dei tradizionali software di animazione che si basano sul controllo diretto dell'artista, Houdini adotta un approccio "node-based": l'artista definisce i parametri fisici del sistema — massa, velocità, viscosità, temperatura, pressione — e lascia che l'algoritmo calcoli il comportamento risultante fotogramma per fotogramma.

Questo approccio permette di creare fumo, fuoco, esplosioni, nebule cosmiche e distruzioni strutturali di impressionante realismo. Sul set di produzioni come "Interstellar" o "Dune", i supervisori VFX hanno utilizzato Houdini per simulare fenomeni atmosferici di pianeti immaginari basandosi su dati scientifici reali, collaborando con fisici e astrofisici per garantire l'accuratezza dei modelli. Il risultato è un'estetica in cui lo spettacolo visivo e la plausibilità scientifica coesistono senza contraddizioni.

Autodesk Maya: modellazione e animazione di precisione

Autodesk Maya rimane lo strumento d'elezione per la modellazione di personaggi, veicoli, architetture e creature digitali che devono integrarsi con riprese reali. La sua forza sta nella capacità di gestire sistemi di rigging complessi — gli "scheletri" digitali che permettono di animare personaggi con movimenti naturali — e nella potenza del suo sistema di shading, che consente di riprodurre fedelmente come i materiali reali interagiscono con la luce.

Per la fantascienza, Maya è spesso utilizzato per costruire veicoli spaziali e stazioni orbitali con geometrie ingegneristicamente plausibili. I designer si ispirano ai disegni tecnici reali delle agenzie spaziali, modellando bulloni, pannelli solari, sistemi di raffreddamento e bocchette di scarico con un livello di dettaglio che raramente è visibile sullo schermo, ma che contribuisce alla convincente impressione di realtà che lo spettatore percepisce inconsciamente.

Nuke e il compositing profondo

Una volta che tutti gli elementi digitali sono stati creati e renderizzati, devono essere integrati con le riprese reali degli attori e degli ambienti fisici: questo processo si chiama compositing, e il software di riferimento dell'industria è The Foundry Nuke. Il compositing non consiste semplicemente nel sovrapporre immagini: richiede una comprensione sofisticata della fisica della luce, del colore e dell'ottica delle macchine da presa.

Nuke introduce il concetto di "deep compositing", che gestisce l'informazione di profondità pixel per pixel, permettendo di integrare elementi digitali e reali in modo perfettamente coerente anche in situazioni di iluminazione complessa. Un fumo digitale deve reagire alla luce del sole con gli stessi valori di dispersione e assorbimento del fumo reale; un robot metallico deve riflettere l'ambiente circostante esattamente come farebbe un oggetto fisico. Ogni imperfezione in questo processo rompe la sospensione dell'incredulità dello spettatore.

Fisica e chimica visiva: il dettaglio che convince

I supervisori VFX delle produzioni più rigorose si consultano regolarmente con scienziati di diversi campi per garantire l'accuratezza dei loro modelli. Per rappresentare un'esplosione nucleare nell'atmosfera di un esopianeta con diversa composizione gassosa, occorre capire come cambiano le caratteristiche della bolla di plasma e dell'onda d'urto. Per rappresentare correttamente la combustione nell'assenza di gravità, bisogna sapere che le fiamme tendono a diventare sferiche e di colore azzurro intenso, senza la caratteristica forma a goccia prodotta dalla convezione.

Il paradosso della grande fantascienza visiva è che per creare l'impossibile bisogna conoscere profondamente il possibile. Gli artisti VFX più rispettati del settore sono, in molti casi, tanto fisici applicati quanto artisti digitali. L'immaginazione visionaria rimane il motore creativo, ma è la padronanza rigorosa delle leggi della natura a trasformarla in qualcosa che lo spettatore percepisce, quasi inconsciamente, come vero.

Di Alex (pubblicato @ 09:00:00 in Amici animali, letto 305 volte)

Gorilla di pianura occidentale ospitato al Bioparco di Roma nel contesto di un programma europeo di conservazione

Il Bioparco di Roma è molto più di uno zoo tradizionale: è un presidio scientifico per la tutela della biodiversità. Attraverso programmi di riproduzione in cattività, ricerca veterinaria avanzata e sensibilizzazione del pubblico, contribuisce attivamente alla salvaguardia delle specie animali più minacciate del pianeta. LEGGI TUTTO L'ARTICOLO

Storia e trasformazione del Bioparco di Roma

Il Bioparco di Roma, situato all'interno di Villa Borghese nel cuore della capitale, ha una storia che risale al 1911, quando fu inaugurato come Giardino Zoologico in occasione del cinquantenario dell'Unità d'Italia. Per quasi un secolo, come molti zoo dell'epoca, fu concepito principalmente come luogo di esposizione degli animali per il pubblico. A partire dagli anni Novanta del Novecento, con la direzione scientifica rinnovata e l'adesione alle nuove linee guida internazionali, l'istituzione ha avviato una profonda metamorfosi nel proprio mandato e nelle proprie strutture.

La trasformazione da zoo tradizionale a bioparco — il cambio di denominazione è avvenuto nel 1997 — ha segnato un cambiamento radicale di filosofia. Gli animali non sono più semplici attrazioni: sono individui di specie minacciate, ospitati in strutture progettate per rispondere alle loro esigenze etologiche, protagonisti di programmi scientifici internazionali. Il benessere animale, la ricerca biologica e la conservazione ex situ sono diventati i tre pilastri dell'attività istituzionale.

I programmi internazionali di riproduzione in cattività

Il Bioparco di Roma partecipa attivamente ai Programmi Europei per le Specie Minacciate (EEP), coordinati dall'Associazione Europea degli Zoo e degli Acquari (EAZA). Questi programmi gestiscono, a livello continentale, la riproduzione pianificata di specie in pericolo di estinzione, garantendo la variabilità genetica delle popolazioni in cattività e preparando eventualmente il terreno per reintroduzioni in natura. Tra le specie coinvolte figurano il gorilla di pianura occidentale, il rinoceronte bianco e numerosi felini in pericolo critico.

La pianificazione riproduttiva è gestita attraverso studbook internazionali — registri genealogici che tracciano l'intera storia riproduttiva di ogni individuo — e algoritmi di matching genetico che individuano le coppie ottimali per massimizzare la diversità del patrimonio ereditario. Spesso questo significa trasferire animali tra zoo di paesi diversi, creando una rete transnazionale di gestione delle popolazioni che è, a tutti gli effetti, una forma di conservazione attiva della biodiversità.

Le specie simbolo e le sfide della conservazione

Alcune specie ospitate al Bioparco sono diventate simboli globali della crisi della biodiversità. Il gorilla di pianura occidentale, classificato come "in pericolo critico" dalla Lista Rossa dell'IUCN, è minacciato dalla deforestazione nell'Africa centrale e dal commercio illegale di carne di animali selvatici. I programmi in cattività rappresentano, per questa specie, una vera e propria assicurazione contro l'estinzione totale in caso di collasso delle popolazioni selvatiche.

Anche numerosi rettili, uccelli e anfibi — gruppi spesso trascurati rispetto ai grandi mammiferi — trovano al Bioparco strutture dedicate e competenze specializzate. Gli anfibi sono il gruppo animale con il tasso di estinzione più elevato del pianeta, colpiti dalla devastante chitridiomicosi, una malattia fungina che ha già spazzato via intere popolazioni in America Centrale e Australia. I programmi di allevamento in cattività rappresentano l'ultimo rifugio per decine di specie.

Ricerca veterinaria e innovazione scientifica

Lo staff veterinario del Bioparco conduce ricerche originali sulla salute e la fisiologia delle specie ospitate, contribuendo all'avanzamento delle conoscenze in medicine veterinaria esotica. Le sfide sono immense: curare una malattia in un gorilla richiede competenze molto diverse da quelle necessarie per un cane domestico, e la letteratura scientifica disponibile è spesso limitata. Ogni intervento medico su specie rare diventa un'occasione di apprendimento preziosa per l'intera comunità scientifica internazionale.

Il Bioparco partecipa anche a programmi di ricerca sul benessere animale, sviluppando protocolli di arricchimento ambientale — strumenti, strutture e attività che stimolano i comportamenti naturali degli animali — che vengono poi condivisi con altri istituti. Queste ricerche hanno applicazioni dirette nel miglioramento delle condizioni di vita degli animali in cattività, riducendo comportamenti stereotipati e stress.

Il Bioparco di Roma rappresenta un esempio di come un'istituzione pubblica possa reinventarsi per rispondere alle sfide del presente. In un'epoca di crisi ecologica senza precedenti, gli zoo del XXI secolo non sono più luoghi in cui ammiraremos gli animali selvaggi: sono avamposti scientifici nella battaglia contro la sesta estinzione di massa, custodi di un patrimonio biologico che appartiene all'intera umanità.

Di Alex (pubblicato @ 08:00:00 in Storia Grecia Antica, letto 314 volte)

Ricostruzione dell'Agorà di Atene nel V secolo avanti Cristo con il Tempio di Efesto sullo sfondo

L'agorà di Atene era il cuore pulsante della vita civica, politica e religiosa della polis. Tra i suoi portici si discutevano le leggi, si celebravano i processi e si forgiava quell'identità democratica che avrebbe plasmato l'intera civiltà occidentale: un luogo dove filosofia, commercio e politica si fondevano ogni giorno. LEGGI TUTTO L'ARTICOLO

Origine e significato del termine "agorà"

La parola greca agorà deriva dal verbo ageirein, che significa "radunare". Nel mondo delle poleis elleniche, l'agorà designava lo spazio pubblico per eccellenza: una vasta piazza aperta al centro della città, attorno alla quale si addensavano i principali edifici civili, religiosi e commerciali. Non si trattava di un semplice luogo fisico, ma del simbolo stesso della comunità dei cittadini liberi, lo spazio dove la vita collettiva si manifestava in tutta la sua complessità.

L'agorà di Atene, sviluppatasi a partire dal VII-VI secolo avanti Cristo a nord-ovest dell'Acropoli, divenne nel corso del V secolo avanti Cristo il centro nevralgico della polis più influente del mondo greco. Ogni mattina, i cittadini ateniesi vi si recavano per fare acquisti, partecipare alle assemblee, assistere ai processi pubblici, incontrarsi con filosofi e politici. Era, in tutti i sensi, la piazza del mondo.

Le funzioni politiche: democrazia in azione

L'agorà era il palcoscenico privilegiato della democrazia ateniese. Le riunioni della Boulé — il consiglio dei cinquecento cittadini sorteggiati che preparava l'ordine del giorno dell'assemblea popolare — si tenevano nel Bouleuterion, un edificio appositamente costruito sul lato occidentale della piazza. L'Ekklesia, l'assemblea di tutti i cittadini maschi liberi adulti, si riuniva invece sulla collina della Pnice, immediatamente a occidente, ma l'agorà restava il luogo naturale del dibattito informale che preparava le grandi decisioni.

Il tribunale dell'Eliea, che radunava fino a cinquecento giudici sorteggiati tra i cittadini, era anch'esso strettamente legato agli spazi dell'agorà. Fu proprio qui che nel 399 avanti Cristo Socrate fu processato e condannato a morte, in uno degli episodi giudiziari più discussi della storia del pensiero. L'accusa — empietà e corruzione della gioventù — rifletteva le tensioni profonde di una democrazia che faticava a tollerare il dissenso radicale.

Il mercato e la vita economica

Nonostante la sua centralità politica, l'agorà era anche un vivacissimo mercato. Nelle ore mattutine, botteghe e banchetti si allineavano sotto i portici e in spazi aperti, offrendo di tutto: cibo, tessuti, utensili, profumi, schiavi, libri scritti a mano. I cambiatori di monete — i trapezitai, antenati dei banchieri — sedevano ai loro tavoli con le bilance per pesare le monete provenienti dalle diverse poleis e dall'estero.

La vocazione commerciale dell'agorà era regolamentata con cura: magistrati specifici, gli agoranomoi, vigilavano sulla correttezza delle transazioni, sui pesi e le misure, sulla qualità delle merci. Il controllo pubblico del mercato era un aspetto fondamentale del governo democratico: la città garantiva ai propri cittadini spazi di scambio equi e trasparenti, rifiutando il monopolio privato.

I principali monumenti e edifici

L'agorà ateniese era costellata di edifici di grande importanza storica e artistica. Il Tempio di Efesto — il cosiddetto Theseion, uno dei templi dorici meglio conservati del mondo antico — dominava la collina dell'Agoreo Kolonos sul lato occidentale, dedicato al dio del fuoco e della metallurgia. La Stoà di Attalo, un lungo portico con botteghe su due piani, offriva riparo agli ateniesi nei giorni di pioggia: l'edificio fu ricostruito fedelmente negli anni Cinquanta del Novecento e oggi ospita il Museo dell'Agorà Antica di Atene.

Al centro della piazza sorgeva l'altare dei Dodici Dei, punto zero della misurazione di tutte le distanze stradali dell'Attica, nonché luogo di asilo sacro. La Stoà Poikile — la "Stoà Dipinta" — era decorata con celebri affreschi che commemoravano le grandi battaglie della storia ateniese, tra cui Maratona; fu qui che il filosofo Zenone di Cizio fondò la scuola stoica, che prese il nome proprio da questo luogo.

Filosofia e vita intellettuale nell'agorà

L'agorà non era solo luogo di affari e politica: era anche il teatro naturale del confronto filosofico. Socrate amava percorrere i suoi portici, fermando artigiani, politici e giovani con i suoi scomodi interrogativi. Platone descrive nei Dialoghi numerose conversazioni che si svolgono esattamente in questo contesto: il filosofo che interpella il cittadino nel mezzo delle sue faccende quotidiane, trasformando la piazza in un'aula senza pareti.

Questa commistione tra vita pratica e riflessione intellettuale era il tratto più originale della cultura ateniese. Il sapere non era relegato nei templi o nelle accademie riservate a pochi: scendeva in piazza, dialogava con il mercante e con il marinaio, si confrontava con l'opinione comune. Questo modello di spazio pubblico come arena del pensiero libero ha influenzato in modo permanente la concezione occidentale della sfera pubblica.

L'agorà di Atene sopravvisse per molti secoli, attraversando la dominazione macedone, ellenistica e poi romana. Oggi, le sue rovine sono visitabili nel centro storico di Atene, testimonianza silenziosa di una stagione irripetibile in cui la politica, la filosofia e la vita quotidiana si intrecciavano in uno spazio comune, dando forma a un ideale di cittadinanza che l'umanità non ha ancora smesso di inseguire.

Fotografie del 08/03/2026

Nessuna fotografia trovata.

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3 Visite guidate a Roma

Visite guidate a Roma

Think different!

Think different!

(p)Link

(p)Link Commenti

Commenti Storico

Storico Stampa

Stampa