\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 03/06/2026

Di Alex (pubblicato @ 17:00:00 in Medicina e Tecnologia, letto 17 volte)

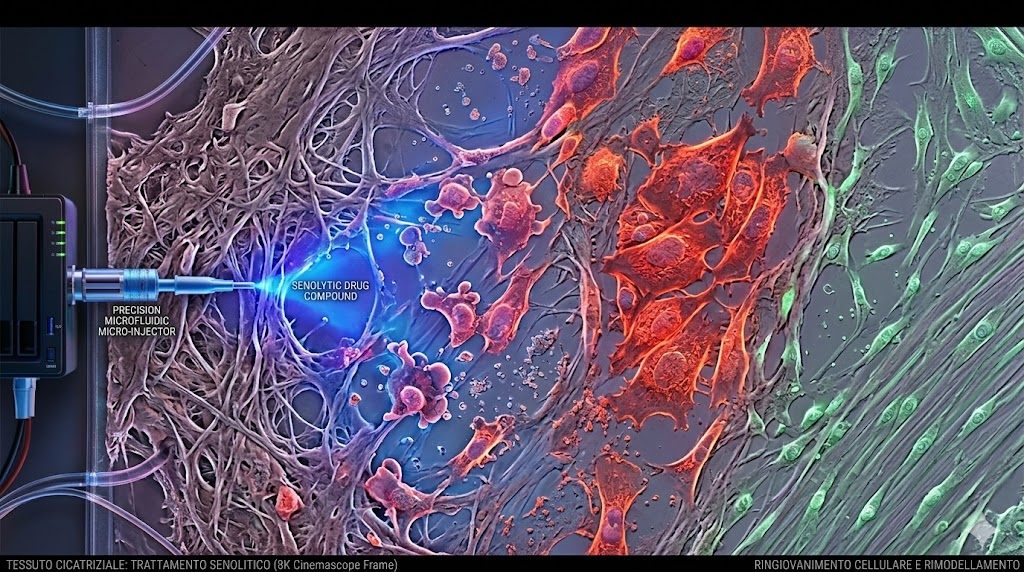

Cellule senescenti in coltura e tessuto cicatriziale dopo trattamento

Bonus Video

L'ossessione per l'eliminazione delle cellule senescenti

La ricerca contemporanea sulla longevità è ossessionata dalla senescenza cellulare, quella condizione in cui le cellule smettono di dividersi ma non muoiono, accumulandosi nei tessuti e secernendo molecole infiammatorie. I farmaci senolitici, come la combinazione di dasatinib e quercetina, sono stati accolti con entusiasmo dalla comunità scientifica e dal mercato del benessere come potenziali elisir di lunga vita. Negli studi preliminari su modelli murini, i risultati apparivano miracolosi: eliminando le cellule senescenti si otteneva un ringiovanimento dei tessuti, miglioramento delle funzioni cognitive e aumento della vita media. Eppure, a uno sguardo più profondo e matematicamente inquadrato, questa foga eradicativa incarna una hubris medica di gravità eccezionale. Trattare l'organismo umano come un ingranaggio meccanico difettoso porta a ignorare le sofisticate e stratificate logiche di sopravvivenza modellate da milioni di anni di evoluzione. Le cellule senescenti non sono solo "spazzatura", ma attori chiave in processi fisiologici essenziali, in particolare nella riparazione dei tessuti e nella rigenerazione.

Tabella dei ruoli naturali e degli effetti senolitici

| Stato del Tessuto Biologico | Ruolo Naturale delle Cellule Senescenti | Effetto della Somministrazione di Senolitici |

| Invecchiamento Fisiologico | Accumulo cronico, infiammazione sistemica (SASP) | Eliminazione mirata, possibile riduzione infiammazione |

| Trauma Acuto / Lesione | Cruciali per l'innesco della cascata riparativa | Interruzione fatale della rigenerazione tissutale |

| Rischio di Fibrosi | Frenano la fibrosi eccessiva durante la guarigione | Proliferazione incontrollata di tessuto cicatriziale |

| Rigenerazione (Es. Fegato) | Riprogrammazione cellulare per auto-guarigione | Blocco dei meccanismi di rigenerazione cellulare naturale |

La crepa logica: falsa dicotomia e fallimenti clinici

La crepa logica latente risiede nella falsa dicotomia che etichetta la senescenza come un "errore" da cancellare. Studi recenti dimostrano chirurgicamente che le cellule senescenti (esprimenti il marcatore p16Ink4a) non sono mera spazzatura patologica; nella fase acuta di un trauma, esse giocano un ruolo orchestrale di primaria importanza per innescare i segnali di riparazione dei tessuti e per fermare la pericolosa proliferazione incontrollata di tessuto cicatriziale (fibrosi). La loro presenza temporanea è il semaforo biochimico vitale che governa la chiusura di una ferita o la rigenerazione di organi complessi come il fegato, e sono alla base delle straordinarie capacità rigenerative degli anfibi. La somministrazione aggressiva o continua di cocktail senolitici, nell'inseguimento cieco dell'elisir di lunga vita, porta con sé l'effetto collaterale di sabotare l'abilità basilare dell'organismo di guarire da ferite e traumi. Il fallimento nei test clinici umani (Fase II) di agenti come l'UBX0101 dimostra che sopprimere i vigili del fuoco dell'organismo perché si è infastiditi dal rumore della sirena è una strategia intrinsecamente suicida. L'ottimizzazione forzata in una direzione si scontra brutalmente con il collasso strutturale di un'altra.

Conclusione: I senolitici non sono la panacea dell'invecchiamento: rimuovere le cellule senescenti senza discriminazione compromette la riparazione dei tessuti, ricordandoci che in biologia non esistono soluzioni semplici.

Di Alex (pubblicato @ 16:00:00 in Amici animali, letto 25 volte)

Pangolino della Sonda arrotolato con scaglie di cheratina

Bonus Video

Il mammifero più braccato del mondo

Nelle profonde foreste primarie e secondarie del Sud-Est asiatico si aggira un mammifero estremamente sfuggente e schivo, la cui fisiologia sembra sfidare la classificazione zoologica tradizionale: il Pangolino della Sonda (Manis javanica). Interamente ricoperto da scaglie corazzate fatte di pura cheratina sovrapposta, questo animale notturno si appallottola trasformandosi in una sfera impenetrabile per proteggersi dai grandi predatori terrestri. Dotato di robuste unghie falciformi e di una lingua vischiosa in grado di estendersi per metà della sua lunghezza corporea, il pangolino è un predatore iper-specializzato, capace di divorare circa 70 milioni di termiti e formiche nel corso di un singolo anno. Il dramma contemporaneo vede il pangolino in cima alla lista delle creature maggiormente vittime del bracconaggio a livello mondiale. I mercati neri asiatici lo estirpano dal suo habitat a un ritmo spaventoso per assecondare le illogiche credenze della medicina tradizionale, che attribuisce magici poteri curativi alle sue scaglie (costituite dalla stessa esatta sostanza di cui sono composte le unghie umane), e per servire la sua carne nei banchetti di lusso come macabro status symbol sociale. Il trasferimento di tutte le specie di pangolino nell'Appendice I della CITES non è riuscito ad arrestare l'estrazione illecita di tonnellate di esemplari congelati diretti verso il mercato nero. Tuttavia, l'indignazione globale si concentra quasi esclusivamente sulla crudeltà etica del traffico illegale e sul rischio di trasmissione di agenti patogeni zoonotici verso l'uomo nei mercati di fauna selvatica. L'osservatore analitico deve spostare lo sguardo sull'ingegneria del sottosuolo per scorgere l'imminente e catastrofica crepa strutturale ecologica.

Tabella delle funzioni ecologiche del pangolino

| Funzione Naturale del Pangolino | Azione Ecologica nel Sottosuolo | Conseguenza dell'Estinzione (Fallimento Strutturale) |

| Predazione Insetti | Regolazione della popolazione di 70 milioni di termiti/formiche all'anno | Esplosione demografica degli insetti infestanti, danni alla biomassa forestale e all'agricoltura umana |

| Escavazione Profonda | Rottura di tronchi marci e rovesciamento del terreno compatto | Rallentamento severo del ciclo di decomposizione minerale e blocco del ricambio di nutrienti |

| Aereazione del Suolo | Agisce come un "aratro" naturale per permettere infiltrazioni idriche | Compattazione arida del sottosuolo: impossibilità per i semi della flora primaria di radicare |

| Creazione di Tane | Abbandono di tunnel sotterranei profondi e sicuri | Collasso abitativo per innumerevoli specie commensali che necessitano di tunnel per sopravvivere |

L'ingegnere dell'ecosistema forestale

Il pangolino non è una semplice creatura esotica, ma un "giardiniere" e architetto di vitale importanza per l'integrità geomorfologica delle foreste. Quando il pangolino scava per rintracciare i termitai, ara letteralmente la terra, rompendo la crosta dura, seppellendo la materia organica morta e permettendo all'ossigeno e all'acqua piovana di percolare nel sottosuolo. Eliminando chirurgicamente l'unica macchina biologica capace di svolgere questo smottamento selettivo, l'uomo innesca un domino distruttivo invisibile. Senza il suo predatore apicale, le colonie di termiti esplodono in numero, divorando la biomassa vegetale viva e morta a un ritmo insostenibile, alterando la struttura del suolo fino a renderlo incapace di sostenere la rigenerazione della foresta. La compattazione del suolo impedisce alle piantine di attecchire, e il ciclo dei nutrienti si interrompe. Inoltre, le tane abbandonate dai pangolini sono rifugi essenziali per rettili, anfibi e piccoli mammiferi; senza di esse, l'intera catena trofica secondaria collassa. L'estinzione del pangolino non è solo una perdita di biodiversità, ma un disastro geologico e agricolo annunciato, che colpirà milioni di esseri umani nelle aree rurali del Sud-Est asiatico.

Conclusione: Proteggere il pangolino non è solo eticamente doveroso, ma strategicamente indispensabile: la sua estinzione causerebbe un collasso ecologico a catena, con impatti devastanti su foreste e agricoltura.

Di Alex (pubblicato @ 15:00:00 in Storia degli scienziati, letto 47 volte)

Rappresentazione geometrica di una quinta dimensione arrotolata su se stessa alla scala di Planck

Bonus Video

Il problema dell'unificazione delle forze

Il problema che affliggeva le menti più brillanti dell'epoca era la disconnessione strutturale tra le due forze fondamentali allora conosciute: la gravità, descritta dalla relatività generale di Einstein, e l'elettromagnetismo, codificato dalle equazioni di Maxwell. Già nel 1919, il matematico Theodor Kaluza aveva proposto una soluzione audace inviando un manoscritto ad Albert Einstein: l'unificazione di queste forze diventava matematicamente possibile se si postulava l'esistenza di una quinta dimensione spaziale, oltre alle tre dimensioni spaziali canoniche e alla dimensione temporale. Tuttavia, l'idea di Kaluza era puramente teorica e sollevava un interrogativo imbarazzante: se esiste una quinta dimensione, per quale motivo l'essere umano non ne ha alcuna percezione fisica? Oskar Klein intervenne su questo quesito applicando i nascenti principi della meccanica quantistica, in particolare i metodi elaborati da de Broglie e Schrödinger. Klein formulò un'ipotesi chirurgica: la quinta dimensione non si estende all'infinito come le altre, ma è "arrotolata" o compattata su se stessa in una geometria circolare. Attraverso calcoli minuziosi, Klein suggerì che il raggio di questa dimensione circolare fosse infinitesimale, misurabile in un valore prossimo alla lunghezza di Planck, ovvero un numero esprimibile come un dieci elevato alla meno trentacinque metri, cioè 0,00000000000000000000000000000000001 metri. A una scala così microscopica, una particella che si muovesse lungo questo asse pentadimensionale ritornerebbe quasi istantaneamente al suo punto di partenza, generando onde stazionarie. Nel nostro mondo macroscopico a quattro dimensioni, noi non percepiamo questa microscopica giostra spaziale, ma ne avvertiamo unicamente l'effetto secondario: la carica elettrica.

Confronto tra spazi e teorie

| Caratteristica Analizzata | Spazio-Tempo Classico (Einstein) | Spazio-Tempo di Kaluza-Klein |

| Dimensioni Totali | 4 (3 spaziali, 1 temporale) | 5 (4 spaziali, 1 temporale) |

| Estensione Spaziale | Infinita o cosmologica | 3 infinite, 1 microscopica circolare |

| Forze Unificate | Gravità | Gravità ed Elettromagnetismo |

| Scala di Osservazione | Macroscopica (Universo visibile) | Subatomica (Scala di Planck) |

| Falsificabilità Sperimentale | Alta (Lenti gravitazionali, orbite) | Nulla (Tecnologicamente irraggiungibile) |

La crepa logica dell'inosservabilità

A un'osservazione superficiale, questa costruzione matematica appare come una cattedrale di pura logica, una risoluzione elegante dei misteri cosmici. Eppure, dissezionando questo costrutto senza edulcorazioni, emerge una crepa logica latente di proporzioni epocali. L'ipotesi di Klein, pur essendo una pietra miliare che ha generato l'odierna Teoria delle Stringhe (la quale postula fino a undici dimensioni), ha inaugurato un'era in cui la fisica ha iniziato a sganciarsi pericolosamente dalla verifica sperimentale. Il rischio strutturale, che sfugge a una mente frettolosa sedotta dall'armonia delle equazioni, risiede nell'inosservabilità intrinseca del modello. Quando si confina una componente fondamentale dell'universo a una scala spaziale matematicamente irraggiungibile dai nostri strumenti di misurazione, si crea un dogma non falsificabile. La scienza, spinta dall'esigenza di trovare eleganza, rischia di trasformarsi in una teologia matematica. Stiamo fondando la nostra comprensione ultima del cosmo su dimensioni che non potremo mai esplorare o testare. Questo approccio occulta il pericoloso fattore per cui l'eleganza matematica di una formula non garantisce in alcun modo che essa corrisponda alla realtà materiale dell'universo in cui abitiamo.

Conclusione: L'ipotesi di Klein rappresenta un monumento intellettuale, ma anche un monito: senza possibilità di verifica empirica, la fisica rischia di perdersi in labirinti matematici slegati dal mondo reale.

Di Alex (pubblicato @ 14:00:00 in Amici animali, letto 59 volte)

Il calamaro Cockeyed con occhio sinistro enorme e occhio destro piccolo

Bonus Video

Anatomia oculare asimmetrica

Nelle tenebre schiaccianti della zona mesopelagica oceanica, situata tra i 200 e i 1000 metri di profondità, la sopravvivenza non è determinata dalla forza bruta, ma da una spietata ottimizzazione delle scarse risorse energetiche. Questa immensa area, nota come "zona crepuscolare", è permeata da una luce ambientale estremamente fioca, di natura monocromatica blu, che piove verticalmente dalla superficie. In questo laboratorio naturale, l'evoluzione ha forgiato il calamaro Histioteuthis heteropsis, conosciuto come "Calamaro Cockeyed" o calamaro fragola, a causa della sua colorazione rosa brillante e della presenza di fotofori luminescenti sul corpo. La caratteristica più enigmatica di questo cefalopode è la sua anatomia oculare, che appare brutalmente asimmetrica. Il tessuto visivo richiede un investimento metabolico e calorico enorme; sviluppare occhi giganti per vedere nel buio significherebbe sprecare risorse preziose. Pertanto, il calamaro assume una postura verticale nell'acqua, con la testa rivolta verso il basso, e divide il lavoro visivo tra due organi diametralmente opposti. L'occhio sinistro è monumentale, di forma tubulare e sporgente, ed è costantemente orientato verso l'alto. Il suo scopo matematico è catturare ogni singolo fotone della debole luce solare discendente per individuare, contro questo pallido sfondo, le sagome scure e le ombre dei predatori o delle prede che nuotano nei livelli superiori dell'oceano. L'occhio destro, per contro, è minuscolo e apparentemente atrofizzato, costantemente rivolto verso le profondità abissali sottostanti. Poiché la luce solare non viaggia verso il basso in quelle angolazioni, tentare di scorgere delle sagome sarebbe un'impresa fisicamente impossibile. Questo piccolo occhio ha una funzione singolare: registrare i flash luminosi della bioluminescenza emessi da altre creature contro lo sfondo del buio assoluto. Per percepire un lampo brillante nell'oscurità totale, un occhio di grandi dimensioni è biomeccanicamente superfluo.

Tabella comparativa dei due occhi

| Caratteristica Oculare | Occhio Sinistro (Rivolto verso l'Alto) | Occhio Destro (Rivolto verso il Basso) |

| Dimensioni Strutturali | Enorme, globoso, tubulare | Piccolo, retratto |

| Angolo di Visione | Da orizzontale a perpendicolare zenitale | Da 45° verso l'alto a perpendicolare abissale |

| Obiettivo Visivo Primario | Rilevamento di sagome e ombre in controluce | Rilevamento di lampi di bioluminescenza isolati |

| Fondo Luminoso Richiesto | Luce solare discendente (Zona Crepuscolare) | Oscurità assoluta |

| Costo Metabolico | Altissimo (giustificato dall'acquisizione di fotoni) | Basso (ottimizzazione delle risorse energetiche) |

Il vicolo cieco dell'iperspecializzazione

La comunità scientifica ha lungamente celebrato questa creatura come l'apoteosi dell'ingegneria biologica adattativa. Tuttavia, un'osservazione disincantata rivela una verità biologica inquietante: l'iperspecializzazione è una prigione. Sviluppando due strumenti ottici così rigidamente calibrati per sorgenti luminose immutabili, l'Histioteuthis heteropsis si è infilato in un vicolo cieco evolutivo, sacrificando totalmente l'adattabilità. Il rischio strutturale di questa "perfezione" è l'assenza assoluta di margine di errore. La sopravvivenza del calamaro dipende dogmaticamente dalla stabilità chimica e ottica della zona mesopelagica. Se un'alterazione antropica, come l'inquinamento da microplastiche, le estrazioni minerarie in acque profonde (deep-sea mining) o l'aumento della torbidità oceanica, dovesse attenuare o diffondere in modo anomalo la luce solare discendente, l'immenso occhio sinistro del calamaro perderebbe istantaneamente la sua funzione. La creatura diverrebbe cieca alle minacce sovrastanti. La natura ci avverte, tramite questo bizzarro cefalopode, che un sistema ottimizzato al limite estremo delle sue variabili ambientali è un sistema intimamente fragile, destinato al collasso alla prima perturbazione non calcolata.

Conclusione: La perfezione adattativa è spesso un vicolo cieco: la vera resilienza richiede ridondanza e flessibilità, non ottimizzazione spinta.

Di Alex (pubblicato @ 13:00:00 in Microsoft Windows, letto 66 volte)

Interfaccia di HeidiSQL con finestra di memorizzazione password nel registro di Windows

Bonus Video

La comodità di HeidiSQL e il paradosso della sicurezza

Nel cuore pulsante dell'economia dell'informazione contemporanea, i database relazionali costituiscono i caveau in cui sono custoditi i segreti finanziari, le identità personali e i flussi logistici globali. Navigare la complessità crittografica di questi archivi tramite riga di comando è un'operazione tediosa, motivo per cui gli amministratori di sistema si affidano a interfacce grafiche specializzate. Una delle più celebrate e pervasive a livello mondiale è HeidiSQL. Concepito originariamente nel 1999 dallo sviluppatore tedesco Ansgar Becker in linguaggio Delphi, questo programma gratuito e open-source permette di amministrare sistemi complessi come MySQL, MariaDB, Microsoft SQL Server e PostgreSQL con un'agilità senza pari. Tramite HeidiSQL, un tecnico può connettersi a molteplici server simultaneamente, editare tabelle, manipolare interi registri di utenti e gestire moli mastodontiche di informazioni con semplici interazioni del mouse. La sua fluidità ha garantito una penetrazione silente ma capillare nei dipartimenti IT di innumerevoli corporazioni. Ma è proprio all'interno di questa comoda interfaccia che si annida uno dei più insidiosi paradossi della sicurezza informatica moderna. Per azzerare l'attrito quotidiano dell'accesso, HeidiSQL offre una funzione basilare: la memorizzazione permanente delle credenziali di sessione, ovvero username e password degli account di amministrazione. Un analista attento, tuttavia, deve esaminare il sottosuolo di questa architettura per scorgere il disastro imminente.

Tabella delle vulnerabilità

| Componente della Sicurezza | Standard Auspicabile in Ambienti IT | Pratica Reale Riscontrata in HeidiSQL |

| Archiviazione Credenziali | Criptazione forte (AES) con Master Password | Memorizzazione nel Registro di Sistema Windows |

| Posizione Esatta dei Dati | Hardware dedicato o Vault Crittografico | Chiave HKEY_CURRENT_USER\Software\HeidiSQL |

| Livello di Offuscamento | Algoritmi irreversibili (Hashing/Salting) | Metodo reversibile debole ("homegrown") |

| Vulnerabilità Esposta | Resistente a script locali e malware base | Altamente suscettibile a esfiltrazione istantanea |

| Motivazione del Rischio | Protezione assoluta dei database aziendali | Massimizzazione della comodità dell'utente finale |

Le chiavi sotto lo zerbino digitale

Il programma, per impostazione ereditata dalle sue origini, salva queste password critiche nel registro di sistema di Windows, utilizzando un algoritmo di offuscamento "fatto in casa" (homegrown) che la stessa documentazione storica definisce rudimentale e obsoleto, una cifratura reversibile priva di una "master password" di sbarramento. Questo significa che le chiavi d'accesso per distruggere o esfiltrare l'intero apparato informativo di un'azienda risiedono, in un formato facilmente decodificabile, in una banale directory del sistema operativo dell'amministratore. Il fattore di rischio nascosto qui non è un difetto irrisolvibile del codice, bensì un grave vizio della psicologia umana applicata alla tecnologia della filiera (supply chain). Esiste una dissonanza cognitiva terrificante: le aziende investono milioni di euro in firewall, crittografia end-to-end e protocolli di rete avanzati, ignorando che gli amministratori di quegli stessi database lasciano letteralmente le chiavi master sotto lo zerbino digitale per risparmiare tre secondi di battitura. Qualsiasi banale malware o intruso capace di interrogare il registro di Windows della macchina locale ottiene accesso istantaneo e irreversibile all'infrastruttura centrale. Questa crepa logica dimostra come l'anello debole della sicurezza globale non risieda nei complessi algoritmi di calcolo, ma nella letale e insopprimibile preferenza dell'essere umano per la convenienza immediata a scapito della protezione strutturale.

Conclusione: La sicurezza informatica è spesso tradita dalla pigrizia umana: HeidiSQL è un monito su come la comodità possa diventare il più grave vettore di attacco.

Di Alex (pubblicato @ 12:00:00 in Meraviglie Naturali Recondite, letto 69 volte)

Il campo di geyser di El Tatio nelle Ande cilene con vapore e terrazzamenti minerali

Bonus Video

Un santuario geologico minacciato

Isolato nell'arido altopiano delle Ande nel nord del Cile, a un'altitudine proibitiva di 4.320 metri sul livello del mare, giace El Tatio, un ambiente estremo che sfida la biologia e la geologia. È il terzo campo di geyser più esteso della Terra e il maggiore dell'emisfero australe, una spianata di oltre 30 chilometri quadrati da cui prorompono circa 80 geyser attivi, fumarole vulcaniche e pozze di fango ribollente. Le acque termali, ricchissime di silice e arsenico, si raffreddano ed evaporano depositando elaborati terrazzamenti di sinter (croste minerali) i cui colori vibranti, tendenti all'arancione e al verde, sono originati da antichissimi tappeti microbici di cianobatteri estremofili. Questo ecosistema, costantemente flagellato da massicce dosi di radiazione ultravioletta, viene studiato dagli astrobiologi come un surrogato perfetto della Terra primordiale e delle condizioni passate del pianeta Marte. Eppure, a partire dai primi anni '20 del Novecento, le corporazioni industriali e i governi hanno guardato a questo santuario geologico non con reverenza scientifica, ma con mero calcolo estrattivo. El Tatio è posizionato sopra un complesso magmatico immenso, l'Altiplano-Puna, che alimenta i serbatoi idrotermali sotterranei. Gli ingegneri stimarono che l'energia racchiusa in questi strati profondi potesse generare fino a 100 megawatt di elettricità, trasformando l'area in un formidabile impianto di energia geotermica, etichettata dal mercato moderno come "pulita e rinnovabile". Tra il 2008 e il 2009, il progetto prese vita con nuove concessioni per perforare la roccia a pochi chilometri dai geyser centrali.

Tabella dell'impatto ambientale

| Parametro Analizzato | Ecosistema Naturale di El Tatio | Impatto dell'Esplorazione Geotermica |

| Termodinamica | Pressione stabile dissipata da 80 geyser attivi | Alterazione artificiale della pressione delle falde |

| Sorgente Idrica | Scarico naturale verso Rio Salado (0,25-0,5 metri cubi al secondo) | Rischio di svuotamento dei serbatoi idrotermali |

| Contaminazione | Rilascio naturale di 500 tonnellate/anno di arsenico | Potenziale sversamento massiccio di tossine in superficie |

| Microbiologia | Tappeti microbici intatti (ipertermofili) | Distruzione delle morfologie di silice |

| Valore Socio-Culturale | Luogo sacro per le comunità indigene Atacamegne | Industrializzazione pesante, danno al turismo |

Il blowout del 2009 e le cicatrici irreversibili

Il disastro si materializzò l'8 settembre 2009. Una trivellazione riutilizzata cedette sotto le dinamiche imponderabili del sottosuolo, generando un catastrofico blowout: una spaventosa colonna di vapore ardente alta oltre 60 metri eruttò ininterrottamente per 27 giorni prima di poter essere arginata. Questo evento ha lacerato il velo rassicurante della retorica sulle energie alternative. Dissezionando chirurgicamente il contesto, l'esplorazione geotermica rivela crepe logiche e ambientali devastanti. L'acqua termale di El Tatio non è vapore puro, ma un brodo caustico saturo di veleni pesanti. Naturalmente, il sistema disperde già circa 500 tonnellate di arsenico all'anno nel Rio Salado, che a sua volta confluisce nel Rio Loa, la principale vena d'acqua dolce per l'intera regione desertica. L'arroganza tecnica consisteva nell'ignorare l'iper-connettività delle faglie andine: alterare artificialmente la pressione in un pozzo significa destabilizzare le reti sotterranee, col rischio reale di moltiplicare esponenzialmente la concentrazione di metalli pesanti scaricati nelle fonti idriche vitali. La dura opposizione delle comunità indigene Atacamegne, che vedevano il ciclo dell'acqua come inviolabile, aveva colto un rischio strutturale che i calcoli di rendimento energetico avevano censurato: l'estrazione geotermica in ecosistemi vulcanici complessi equivale a giocare con arterie pressorizzate cariche di tossine, dove un singolo errore può avvelenare irreparabilmente un'intera vallata.

Conclusione: El Tatio ci ricorda che nemmeno le energie rinnovabili sono innocue se applicate senza rispetto per gli equilibri geologici e le comunità locali.

Di Alex (pubblicato @ 11:00:00 in Storia delle invenzioni, letto 81 volte)

Il telecomando Flash-Matic a forma di pistola spaziale con il televisore Zenith dotato di fotodiodi

Bonus Video

L'architettura rivoluzionaria del Flash-Matic

Nel 1955, la Zenith Radio Corporation, spinta dalla visione del suo presidente Eugene F. McDonald Junior (il quale disprezzava profondamente le interruzioni pubblicitarie televisive e desiderava un modo per ammutolirle), introdusse sul mercato un dispositivo destinato a mutare radicalmente la sociologia del consumo mediatico: il Flash-Matic. Sviluppato dal brillante ingegnere Eugene Polley, questo apparecchio fu il primissimo telecomando televisivo completamente senza fili, un'innovazione che soppiantò il precedente "Lazy Bones", un rudimentale telecomando collegato alla televisione tramite un ingombrante cavo su cui gli utenti inciampavano sistematicamente. L'architettura logica del Flash-Matic era rivoluzionaria perché spostava l'intera complessità del sistema dal trasmettitore al ricevitore. Il telecomando in sé aveva la forma di una piccola pistola spaziale dotata di un unico grilletto che, alla pressione, emetteva un semplice fascio di luce visibile, del tutto analogo a quello di una normale torcia elettrica. Il televisore, per contro, era equipaggiato con quattro fotodiodi sensibili alla luce (basati su cristalli di solfuro di cadmio) incastonati nei quattro angoli della cornice del monitor. Il funzionamento richiedeva all'utente di mirare con precisione chirurgica: puntando il fascio luminoso verso il fotodiodo inferiore sinistro, si controllava l'accensione e lo spegnimento della televisione; il fotodiodo inferiore destro innescava la valvola a titraton per disattivare l'audio; i recettori superiori azionavano piccoli motori fisici che facevano ruotare il sintonizzatore in senso orario o antiorario, cambiando canale. Fu così che Polley generò il fenomeno comportamentale noto come "channel surfing".

Tabella dei comandi e dei fotodiodi

| Posizione del Fotodiodo (Ricevitore Zenith) | Componente Elettronico Attivato | Azione Meccanica/Elettronica |

| Angolo Superiore Destro | Tubo di controllo motore (K1) | Rotazione del sintonizzatore in senso orario (Canale Su) |

| Angolo Superiore Sinistro | Tubo di controllo motore (K2) | Rotazione del sintonizzatore in senso antiorario (Canale Giù) |

| Angolo Inferiore Destro | Valvola Tiratron (V2) | Disattivazione del circuito audio (Muto) |

| Angolo Inferiore Sinistro | Valvola Tiratron (V1) | Interruzione/Avvio della corrente (On/Off) |

La vulnerabilità logica: interferenza della luce ambientale

Questa narrazione di successo nasconde tuttavia una vulnerabilità logica monumentale, spesso trascurata per l'entusiasmo della novità. L'invenzione di Polley partiva dall'assunto errato che l'ambiente domestico fosse un sistema chiuso, oscuro e inerte. In realtà, i fotodiodi del Flash-Matic erano reattivi a un ampio spettro di luce visibile e non possedevano alcun circuito di protezione o filtro di frequenza. La crepa strutturale si rivelava in tutta la sua potenza distruttiva non appena il sole tramontava o sorgeva: un raggio di luce solare che penetrava dalle finestre del salotto, o persino l'accensione di una plafoniera a incandescenza, bombardava i sensori con un'intensità fotonica sufficiente a innescare i comandi a ripetizione. I televisori Zenith presero a vivere di vita propria, accendendosi nel cuore della notte, cambiando canale freneticamente e disattivando l'audio come entità possedute. L'errore fatale di questa innovazione fu l'incapacità matematica di isolare il "segnale" intenzionale dal "rumore" ambientale. L'incidente del Flash-Matic, ritirato dopo un solo anno di vendite e rimpiazzato dal sistema a ultrasuoni "Space Command", ci consegna un monito perenne: qualsiasi architettura tecnologica che non consideri l'interferenza caotica del mondo fisico è intrinsecamente destinata al collasso.

Conclusione: Il Flash-Matic ci insegna che l'innovazione senza robustezza ambientale è fragile: la comodità non può ignorare il caos del mondo reale.

Di Alex (pubblicato @ 10:00:00 in Sicurezza informatica, letto 87 volte)

Reticolo matematico multidimensionale con un chip elettronico e onde elettromagnetiche

Bonus Video

La minaccia quantistica e la promessa dei reticoli

L'infrastruttura tecnologica globale è attualmente pervasa da un'angoscia silenziosa, un conto alla rovescia innescato dalla meccanica quantistica. I computer quantistici, la cui potenza computazionale minaccia di raggiungere a breve l'apice operativo, saranno in grado di polverizzare i protocolli di crittografia a chiave pubblica (come RSA ed Elliptic Curve) su cui si basa l'intera sicurezza delle telecomunicazioni, dei mercati finanziari e dei segreti militari. In vista di questa imminente catastrofe digitale, agenzie di massima sicurezza come la NSA e il NIST hanno promulgato nuovi standard salvifici, imponendo la transizione verso la Crittografia Post-Quantistica (PQC), racchiusa nella direttiva CNSA 2.0. L'ancora di salvezza prescelta è la "Lattice-Based Cryptography" (crittografia basata sui reticoli), con algoritmi primari quali ML-KEM (Kyber) e ML-DSA (Dilithium). Questi sistemi non fondano più la loro segretezza sulla scomposizione in fattori primi, ma sulla sconcertante difficoltà di orientarsi e trovare specifici vettori all'interno di griglie matematiche multidimensionali che presentano errori intenzionali, un ostacolo che paralizza persino i qubit quantistici. Le industrie hardware, come Microchip Technology, stanno precipitosamente incorporando questi moduli matematici complessi direttamente a livello di silicio nei loro controller embedded di ultima generazione (come la famiglia MEC175xB), vantando una protezione inespugnabile. Tuttavia, l'adorazione per l'impenetrabilità matematica acceca la comunità tecnica rispetto a un fattore di rischio fisico ineludibile. L'astrazione di un algoritmo deve obbligatoriamente reincarnarsi nella materia per funzionare. E la materia, inesorabilmente, tradisce.

Tabella dei livelli di sicurezza e attacchi

| Livello di Sicurezza | Metodologia di Attacco | Resistenza della Crittografia Lattice-Based |

| Livello Matematico/Algoritmico | Forza Bruta Classica | Inespugnabile |

| Livello Computazionale Avanzato | Computer Quantistici (Algoritmo di Shor) | Altamente Resistente |

| Livello Fisico (Canali Laterali) | Analisi del Consumo Energetico (CPA) | Vulnerabilità Critica |

| Livello Fisico (Canali Laterali) | Emissioni Elettromagnetiche | Vulnerabilità Critica |

Il tradimento del silicio: attacchi a canali laterali

I canali laterali (side-channel attacks) non attaccano l'algoritmo, ma la sua implementazione fisica: sfruttano il consumo energetico, le emissioni elettromagnetiche, il tempo di esecuzione o persino i suoni prodotti dal processore durante i calcoli crittografici. Nel 2024 e 2025, ricercatori hanno dimostrato che implementazioni ingenue di Kyber e Dilithium su microcontrollori embedded rivelano informazioni sufficienti a recuperare la chiave privata attraverso analisi di potenza differenziale (DPA). Il problema è strutturale: i reticoli matematici richiedono operazioni su vettori con errori, e queste operazioni hanno un profilo di potenza fortemente dipendente dai dati. Un attaccante con accesso fisico o anche solo remoto (tramite sensori come il microfono o la webcam) può ricostruire i segreti. La comunità sta correndo ai ripari con contromisure come la randomizzazione e il masking, ma ogni soluzione aumenta il costo computazionale e la complessità. La lezione è chiara: non esiste sicurezza assoluta nel mondo fisico. La crittografia lattice-based è matematica robusta, ma la sua incarnazione nel silicio è fragile come qualsiasi altra. L'arroganza di chi crede che un algoritmo nuovo risolva tutti i problemi si scontra con la termodinamica e l'elettromagnetismo.

Conclusione: La crittografia post-quantistica è necessaria ma non sufficiente: gli attacchi a canale laterale ci ricordano che la materia tradisce sempre la matematica.

Di Alex (pubblicato @ 09:00:00 in Mondo Android, letto 89 volte)

Smartphone con Collabora Office che modifica documento locale senza connessione cloud

Bonus Video

L'illusione del cloud e la sovranità dei dati

Nel corso dell'ultimo decennio, la gestione dell'informazione e la produttività aziendale hanno subito una metamorfosi dogmatica: la migrazione massiva verso il Cloud computing. Intere istituzioni, governi e cittadini hanno abdicato al controllo locale dei propri file, affidando documenti di testo, contratti e fogli di calcolo a piattaforme centralizzate fornite da ristretti colossi tecnologici. In questo ecosistema di latente dipendenza, lo sviluppo di strumenti come l'applicazione Android gratuita Collabora Office assume una valenza che trascende la semplice utilità informatica, trasformandosi in una questione di geopolitica dei dati. Sviluppata a partire dal 2012 e basata sul solido motore open-source di LibreOffice, Collabora Office permette la modifica di documenti complessi (nei formati aperti come .odt, ma anche nei formati proprietari di Microsoft Office) direttamente sulla memoria fisica del dispositivo mobile. L'architettura del software è concepita per operare in totale indipendenza: non impone all'utente di sincronizzare obbligatoriamente il documento su server esterni per poterlo visualizzare o elaborare. Tuttavia, analizzando profondamente questa dinamica, si disvela un concetto fondamentale oscurato dal gergo del marketing moderno: la Sovranità Digitale. La stragrande maggioranza delle menti si culla nella credenza che il Cloud sia uno spazio immateriale e benevolo. Ma il Cloud, tradotto brutalmente, è semplicemente il computer fisico di qualcun altro, posizionato in una nazione governata da leggi che sfuggono al nostro controllo.

Tabella comparativa cloud vs locale

| Elemento di Analisi | Infrastruttura Basata su Cloud Centralizzato | Architettura Locale (Es. Collabora Office) |

| Locazione dei Dati | Server proprietari in giurisdizioni altrui | Memoria fisica del dispositivo dell'utente |

| Proprietà Strutturale | L'utente "affitta" l'accesso al servizio | L'utente detiene il controllo dei file |

| Rischio di Interruzione | Altissimo (Cambiamenti di Policy, Sanzioni) | Nullo (Indipendenza dalle reti esterne) |

| Sovranità Digitale | Cessione totale del controllo legale/tecnico | Mantenimento della giurisdizione sui dati |

| Auditing del Codice | Impossibile (Algoritmi chiusi e proprietari) | Possibile (Codice Open Source ispezionabile) |

La crepa logica: illusione di proprietà

La crepa logica della nostra era è l'illusione della proprietà del dato. Sottoscrivendo servizi cloud centralizzati, le istituzioni non comprano un software, ma cedono la propria autonomia in cambio di un abbonamento temporaneo. Se il fornitore del servizio altera unilateralmente i termini di utilizzo, se subisce un attacco hacker su larga scala, o peggio, se le tensioni geopolitiche globali impongono sanzioni che vietano l'erogazione del servizio in determinate aree, l'utente perde istantaneamente l'accesso alla propria memoria storica e operativa. Il rischio strutturale è la paralisi sistemica: stiamo legando il funzionamento basilare delle nostre società a fili invisibili che possono essere recisi in qualsiasi momento dall'esterno. L'assenza di dipendenze cloud in strumenti come Collabora Office non è un dettaglio di nicchia, ma rappresenta una delle poche barricate superstiti contro la perdita totale della giurisdizione sulle nostre informazioni intellettuali.

Conclusione: La sovranità digitale non è un lusso da smanettoni, ma una necessità strategica: Collabora Office restituisce il controllo, lontano dagli abusi del cloud.

Di Alex (pubblicato @ 08:00:00 in Beni Arte e patrimonio UNESCO, letto 102 volte)

Castel del Monte con pianta ottagonale e torri ottagonali sotto il cielo pugliese

Bonus Video

Un'equazione di pietra nel cuore delle Murge

Nell'inospitale altopiano delle Murge pugliesi si innalza dal XIII secolo una struttura che paralizza la logica costruttiva medievale: Castel del Monte. Commissionato dallo "Stupor Mundi", l'Imperatore del Sacro Romano Impero Federico II di Svevia, l'edificio si impone sul paesaggio non come una roccaforte, ma come un'equazione in pietra. La sua forma è un rigoroso monolite ottagonale perfetto, sormontato a ogni vertice da otto torri secondarie, a loro volta rigorosamente ottagonali. L'ingegneria del castello trasuda un'educazione umanistica e multiculturale senza precedenti, fondendo l'architettura classica con raffinatezze d'Oriente. Al suo interno, nascosto all'occhio profano, operava un sofisticato impianto idraulico di evidente derivazione araba: le cisterne installate sui tetti di cinque torri convogliavano millimetricamente l'acqua piovana verso la grande cisterna centrale sotto il cortile, distribuendo l'acqua a stanze da bagno dotate di latrine pensili, lavabi in marmo e ambienti che ricalcavano fedelmente i princìpi del hammam, destinati alla purificazione corporea in un'epoca che disprezzava l'igiene. Tuttavia, l'ingannevole simmetria di questo edificio ha storicamente indotto studiosi e romanzieri a una deriva interpretativa edulcorata. Generazioni di intellettuali hanno etichettato comodamente Castel del Monte come un innocuo casino da caccia, un rifugio termale, oppure un tempio massonico-esoterico colmo di allineamenti astronomici segreti dedicati alla meditazione pacifica.

Tabella delle anomalie architettoniche

| Caratteristiche Difensive Standard (Castelli Medievali) | Anomalie Architettoniche di Castel del Monte | Implicazione Strategica |

| Presenza di fossati difensivi e cinte murarie esterne | Assenza totale di fossati e strutture di sbarramento | Esposizione calcolata: nessuna paura degli assedi |

| Ponti levatoi e feritoie funzionali per arcieri | Scale a chiocciola antiorarie, porte sguarnite | Inutilità difensiva in caso di aggressione armata |

| Geometrie funzionali al posizionamento delle truppe | Simmetria ottagonale alienante e ipnotica | Incutere un disorientamento psicologico |

| Ambienti grezzi per stoccaggio e guarnigioni | Ingegneria idraulica d'avanguardia (Hammam, latrine) | Dimostrazione di una superiorità intellettuale |

Guerra psicologica in pietra

Esaminando chirurgicamente l'anomalia attraverso le lenti del potere politico, la mancanza assoluta di reali fortificazioni militari — fossati, ponti levatoi o vere feritoie — non denota una natura pacifica o puramente mistica. Storici di peso come Massimiliano Ambruoso e Raffaele Licinio hanno spogliato il castello delle sue vesti fantasiose, rivelando il suo vero nucleo. Castel del Monte era, ed è, un capolavoro di guerra psicologica. Federico II innalzò questa corona calcarea nel vuoto del paesaggio murgiano per soggiogare la mente dei ribelli e dei sudditi. Eliminando la rozza fisicità della guerra tradizionale e rimpiazzandola con proporzioni geometriche alienanti e inumane, l'Imperatore trasmetteva un messaggio politico letale: il suo dominio assoluto non necessitava di muraglioni o di frecce, perché esso derivava dalla supremazia del suo intelletto e da un ordine quasi divino dell'universo. Mascherare la potenza coercitiva del castello dietro narrazioni di esoterismo o benessere termale significa fallire totalmente nel comprendere la più affilata e silenziosa delle armi umane: la sottomissione psicologica attraverso l'ostentazione di una perfezione matematica incomprensibile all'osservatore comune.

Conclusione: Castel del Monte non è un mistero esoterico ma un'arma di potere: la perfezione geometrica è stata usata da Federico II per intimidire e soggiogare, molto più efficacemente di un fossato.

Fotografie del 03/06/2026

Nessuna fotografia trovata.

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3 Visite guidate a Roma

Visite guidate a Roma

Think different!

Think different!

(p)Link

(p)Link Commenti

Commenti Storico

Storico Stampa

Stampa