\\ Home Page : Articolo

HANNO SUPPORTATO DIGITAL WORLDS INVIANDO PRODOTTI DA RECENSIRE

|

|

|

|

|

AI Observability e drift del modello: come si monitora l'intelligenza artificiale in produzione

Di Alex (del 18/02/2026 @ 07:00:00, in Intelligenza Artificiale, letto 345 volte)

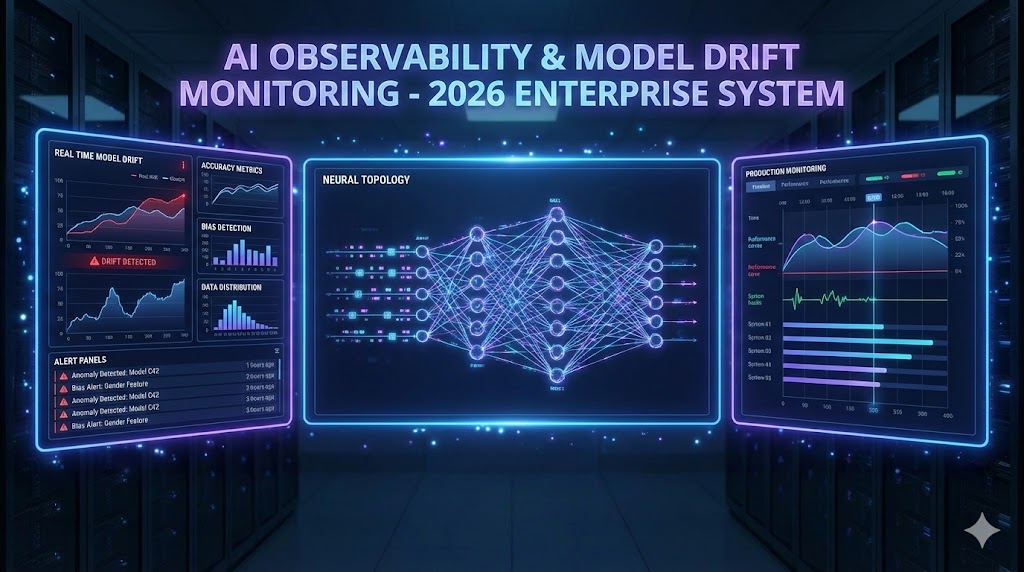

Dashboard di AI Observability con grafici di monitoraggio del drift del modello e metriche di qualità degli output in tempo reale

Con l'adozione massiccia dell'IA in produzione, l'AI Observability è diventata una pratica standard. Monitorare il drift dei modelli, la qualità degli output e i bias discriminatori garantisce che le decisioni automatizzate restino accurate anche quando il mondo reale cambia. LEGGI TUTTO L'ARTICOLO

Il problema del modello che invecchia: il drift in produzione

Un modello di machine learning viene addestrato su un dataset storico e impara a riconoscere pattern e relazioni statistiche che riflettono il mondo al momento della raccolta dei dati. Il problema fondamentale è che il mondo reale cambia continuamente: i comportamenti degli utenti evolvono, i mercati si spostano, le distribuzioni demografiche variano, emergono nuovi fenomeni linguistici. Quando la distribuzione dei dati in produzione inizia a divergere da quella su cui il modello è stato addestrato, si parla di drift: il modello continua a fare previsioni ma la sua accuratezza decade progressivamente, a volte in modo quasi impercettibile nel breve periodo ma significativo nel medio termine. Un modello di credit scoring addestrato nel 2022 potrebbe produrre valutazioni sistematicamente errate nel 2026 se i parametri economici e i comportamenti di pagamento della popolazione sono cambiati in modo sostanziale. Un modello di rilevamento delle frodi addestrato prima di una nuova tecnica di attacco diventa progressivamente cieco nei confronti del nuovo schema criminale.

Tipi di drift: dati, concetti e predizioni

Il campo dell'AI Observability distingue diverse tipologie di drift che richiedono strategie di rilevamento differenti. Il data drift (o covariate shift) si verifica quando cambia la distribuzione delle variabili di input: per esempio, se un modello di raccomandazione e-commerce è stato addestrato su utenti prevalentemente desktop e la maggioranza degli accessi diventa mobile, la distribuzione degli input cambia significativamente. Il concept drift è più sottile e più pericoloso: la relazione fondamentale tra le variabili di input e l'output corretto cambia. Un esempio classico è la parola "corona" in un modello di sentiment analysis del 2019: in quel contesto significava quasi sempre qualcosa di positivo (corona di fiori, gioielli) mentre dal 2020 ha acquisito connotazioni fortemente negative legate alla pandemia. Il prediction drift monitora la distribuzione degli output del modello nel tempo: se le previsioni di un modello iniziano a concentrarsi in modo anomalo su certi valori o categorie, è un segnale che qualcosa sta cambiando nel sistema.

Strumenti e piattaforme di AI Observability

Il mercato degli strumenti di AI Observability è cresciuto rapidamente negli ultimi anni, passando da soluzioni interne sviluppate dai grandi player tecnologici a un ecosistema commerciale maturo con decine di prodotti specializzati. Aziende come Arize AI, WhyLabs, Evidently AI, Fiddler AI e Aporia offrono piattaforme che automatizzano il monitoraggio continuo dei modelli in produzione, calcolando statistiche di distribuzione sui dati di input e di output, confrontandole con le distribuzioni di riferimento del training set e generando alert quando le divergenze superano soglie predefinite. Le piattaforme cloud più grandi, come AWS SageMaker Model Monitor, Google Vertex AI e Azure Machine Learning, integrano funzionalità di observability nativamente nei loro ambienti di deployment. Il denominatore comune di questi strumenti è la capacità di operare in streaming, analizzando i dati di produzione quasi in tempo reale invece di effettuare analisi batch periodiche, il che riduce drasticamente il tempo tra l'insorgenza del drift e la sua rilevazione.

Il bias discriminatorio: quando il drift produce discriminazione

Una delle conseguenze più gravi e meno ovvie del drift non rilevato è la produzione di bias discriminatori nei sistemi decisionali automatizzati. Un modello di selezione del personale addestrato su dati storici di assunzioni di un'azienda potrebbe apprendere pattern discriminatori latenti (per esempio, associare certi studi o indirizzi di provenienza a performance migliori) che riflettono pregiudizi storici piuttosto che meriti oggettivi. Se il contesto demografico del mercato del lavoro cambia e il modello non viene ricalibrato, questi bias possono amplificarsi progressivamente. Le normative europee sull'intelligenza artificiale (l'AI Act entrato in vigore nel 2024) impongono requisiti espliciti di monitoraggio continuo per i sistemi di IA ad alto rischio, includendo esplicitamente i sistemi di selezione del personale, di scoring creditizio, di accesso ai servizi essenziali e di sorveglianza biometrica. Il monitoraggio del bias è quindi non solo una best practice tecnica ma un obbligo normativo crescente in tutto il mondo occidentale.

Shadow mode e A/B testing: validare i modelli prima del deployment

Una delle pratiche più efficaci dell'AI Observability è il shadow mode deployment: il nuovo modello (o la versione aggiornata) viene eseguito in parallelo al modello in produzione, ricevendo gli stessi input ma senza che i suoi output vengano utilizzati nelle decisioni reali. Questo permette di confrontare sistematicamente i comportamenti dei due modelli su traffico reale prima di procedere alla sostituzione, rilevando divergenze significative che i test offline non avevano identificato. L'A/B testing, mutuato dall'ottimizzazione dei siti web, permette di esporre frazioni del traffico reale al nuovo modello mentre la maggioranza rimane sul modello stabile, raccogliendo metriche di performance comparative prima di un rollout completo. Queste pratiche di deployment graduale sono oggi considerate obbligatorie in qualsiasi organizzazione che usi modelli di IA per decisioni ad alto impatto, e la loro mancanza è citata nei post-mortem di molti incidenti legati a sistemi di IA che hanno prodotto danni significativi agli utenti.

Il futuro dell'AI Observability: autoguarigione e MLOps

La frontiera più avanzata dell'AI Observability è l'automazione non solo del rilevamento del drift ma della risposta a esso: sistemi che, una volta rilevata una divergenza significativa, avviano automaticamente pipeline di fine-tuning incrementale o di ri-addestramento completo del modello, senza intervento umano manuale. Questi sistemi di MLOps (Machine Learning Operations) di nuova generazione integrano il monitoraggio continuo con la gestione automatica del ciclo di vita del modello, dal rilevamento dell'anomalia alla selezione del dataset di aggiornamento, dall'addestramento al testing e al deployment del modello aggiornato. La sfida principale di questi sistemi automatizzati è la validazione: se il meccanismo di correzione automatica è esso stesso soggetto a errori, il rischio è di costruire sistemi che si autodegradano in loop. La supervisione umana nelle fasi critiche del ciclo di vita del modello rimane, nella visione più matura del settore, un elemento irrinunciabile di sicurezza.

L'AI Observability è la risposta tecnica a una verità fondamentale che spesso viene ignorata nel entusiasmo del deployment: un modello di IA non è un prodotto finito ma un sistema vivente che interagisce continuamente con un mondo che cambia. Trattarlo come un artefatto fisso, addestrato una volta e poi dimenticato in produzione, è la ricetta per disastri silenziosi. La maturità nell'uso dell'intelligenza artificiale si misura esattamente nella capacità di monitorare, correggere e responsabilizzarsi per i comportamenti di questi sistemi nel tempo reale.

Nessun commento trovato.

Disclaimer

L'indirizzo IP del mittente viene registrato, in ogni caso si raccomanda la buona educazione.

L'indirizzo IP del mittente viene registrato, in ogni caso si raccomanda la buona educazione.

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3

Think different!

Think different!

Articolo

Articolo  Storico

Storico Stampa

Stampa