\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 24/01/2026

Di Alex (pubblicato @ 15:00:00 in Tecnologia, letto 4 volte)

Storia dei cartoni animati dalle origini ad oggi

L'animazione ha trasformato disegni statici in movimento, evolvendosi da esperimenti ottici ottocenteschi fino alle sofisticate produzioni digitali contemporanee. Un viaggio attraverso tecniche, innovazioni e rivoluzioni creative che hanno definito un'arte in continua metamorfosi.LEGGI TUTTO L'ARTICOLO

🎧 Ascolta questo articolo

Gli antenati dell'animazione: giocattoli ottici

Le radici dell'animazione affondano negli esperimenti ottici del XIX secolo, quando scienziati e inventori esploravano la persistenza retinica, il fenomeno per cui l'occhio umano trattiene brevemente un'immagine dopo che questa è scomparsa. Questo principio fisiologico è il fondamento di ogni forma di cinema e animazione.

Il taumatropio, inventato nel 1825 da John Ayrton Paris, era un disco con immagini diverse sui due lati. Facendolo ruotare velocemente mediante cordicelle, le due immagini si fondevano creando l'illusione di un'unica scena composta. Un classico esempio mostrava un uccello su un lato e una gabbia sull'altro: in rotazione, l'uccello appariva dentro la gabbia.

Il fenachistoscopio, sviluppato indipendentemente nel 1832 da Joseph Plateau in Belgio e Simon von Stampfer in Austria, utilizzava dischi rotanti con sequenze di immagini leggermente diverse osservate attraverso fessure. Ruotando il disco davanti a uno specchio e guardando attraverso le fessure, le immagini si susseguivano creando movimento fluido. Questo dispositivo dimostrava che una serie di disegni statici poteva ingannare l'occhio generando percezione di movimento continuo.

Lo zootropio, perfezionato da William George Horner nel 1834, migliorava il fenachistoscopio eliminando la necessità dello specchio. Un cilindro cavo con fessure verticali conteneva una striscia di carta con sequenze disegnate all'interno. Ruotando il cilindro e osservando attraverso le fessure, le immagini prendevano vita. Questo giocattolo ottimo divenne popolare nei salotti vittoriani, democratizzando l'accesso all'animazione primitiva.

Il prassinoscopio e l'avvento del cinema

Nel 1877, Émile Reynaud inventò il prassinoscopio, che sostituiva le fessure dello zootropio con specchi posizionati al centro del cilindro. Questi specchi riflettevano le immagini eliminando lo sfarfallio causato dalle fessure, producendo animazioni più fluide e luminose. Reynaud sviluppò successivamente il teatro ottico, un sistema di proiezione che permetteva di proiettare su schermo sequenze animate lunghe anche 15 minuti, accompagnate da musica dal vivo.

Queste proiezioni pubbliche al Musée Grévin di Parigi, iniziate nel 1892, sono considerate da molti storici le prime vere esibizioni di animazione per un pubblico pagante, precedendo di tre anni la nascita ufficiale del cinema con i fratelli Lumière. Reynaud disegnava manualmente ogni fotogramma su strisce trasparenti di gelatina, creando narrazioni complete con personaggi ricorrenti.

L'invenzione del cinematografo nel 1895 aprì possibilità inedite. Mentre i Lumière documentavano la realtà, altri pionieri compresero che la macchina da presa poteva creare realtà impossibili. Georges Méliès, prestigiatore e cineasta francese, scoprì casualmente il trucco della sostituzione: fermando la ripresa, modificando la scena e riprendendo, gli oggetti apparivano magicamente cambiare o scomparire.

Questa tecnica di stop-motion divenne fondamentale. Applicata a disegni fotografati fotogramma per fotogramma, nacque l'animazione cinematografica vera e propria. James Stuart Blackton, nel 1906, realizzò Humorous Phases of Funny Faces, considerato uno dei primi film animati, disegnando espressioni facciali su lavagna e fotografandole progressivamente mentre le cancellava e ridisegnava.

L'era pionieristica: Winsor McCay e la nascita dell'arte

Winsor McCay, fumettista americano celebre per la striscia Little Nemo in Slumberland, elevò l'animazione da curiosità tecnica ad arte espressiva. Nel 1914 creò Gertie il Dinosauro, un cortometraggio di circa 12 minuti che richiedeva oltre 10.000 disegni eseguiti personalmente su fogli di riso.

Gertie non era solo una sequenza di movimenti ma un personaggio con personalità. McCay interagiva con il dinosauro animato durante proiezioni dal vivo, dandole ordini che Gertie eseguiva, disobbediva giocosamente o commentava con espressioni emotive. Questo pioneristico character animation dimostrava che personaggi disegnati potevano suscitare empatia e connessione emotiva come attori in carne e ossa.

La tecnica di McCay era laboriosa. Disegnava ogni fotogramma completamente, inclusi sfondi statici ridisegnati migliaia di volte. Questa ridondanza limitava la produttività, rendendo i progetti estremamente costosi in tempo e denaro. La necessità di efficienza produttiva avrebbe guidato le innovazioni successive.

L'invenzione del cel: rivoluzione produttiva

Nel 1914, Earl Hurd brevettò la tecnica del cel, acetato trasparente su cui venivano dipinti i personaggi in movimento. Gli sfondi statici venivano disegnati una sola volta su carta o cartoncino. Sovrapponendo i cel trasparenti con i personaggi sugli sfondi e fotografando l'insieme, si otteneva il fotogramma completo senza ridisegnare ripetutamente elementi immobili.

Questa innovazione ridusse drasticamente il lavoro necessario. Per un'animazione di 10 secondi a 24 fotogrammi al secondo servivano 240 disegni del personaggio ma un solo sfondo. Il risparmio economico e temporale rese possibile la produzione industriale di animazione, trasformandola da artigianato d'autore a industria organizzata.

I cel permettevano inoltre stratificazione complessa. Diversi livelli di acetato potevano essere sovrapposti: uno per il personaggio in primo piano, uno per elementi di medio piano, uno per effetti come pioggia o nebbia. Questa profondità spaziale arricchiva la composizione visiva, simulando tridimensionalità in immagini bidimensionali.

La tecnica del cel dominò l'animazione per oltre 70 anni, fino all'avvento del digitale negli anni Novanta. Praticamente ogni cartone animato classico, da Disney a Warner Bros, da Hanna-Barbera agli anime giapponesi, utilizzò acetati dipinti a mano e fotografati con camere multiplane.

L'età d'oro di Disney: innovazione tecnica e narrativa

Walt Disney non inventò l'animazione ma la perfezionò industrialmente e artisticamente. Nel 1928, Steamboat Willie introdusse Topolino e, crucialmente, il sonoro sincronizzato. Per la prima volta, movimenti labiali, passi, azioni, erano perfettamente coordinati con dialoghi, musica ed effetti sonori. Questa sincronia trasformava l'esperienza percettiva rendendo i personaggi credibilmente vivi.

Disney investì sistematicamente in ricerca e sviluppo. Nel 1932, Flowers and Trees fu il primo cartone animato a colori con il processo Technicolor, che utilizzava tre negativi separati per catturare l'intero spettro cromatico con saturazione e fedeltà superiori ai sistemi precedenti. Il colore non era decorativo ma narrativo: tonalità calde per scene gioiose, fredde per atmosfere minacciose.

La camera multiplane, sviluppata nel 1937, rivoluzionò la profondità spaziale. Invece di fotografare tutti i livelli appiattiti insieme, la camera multiplane disponeva sfondi, piani intermedi e primi piani su lastre di vetro separate verticalmente. Muovendo questi piani a velocità differenti durante la ripresa, si otteneva effetto parallasse: elementi vicini scorrevano più velocemente di quelli lontani, simulando movimento tridimensionale della macchina da presa in spazi dipinti.

Questo sistema debuttò pienamente in Biancaneve e i Sette Nani, primo lungometraggio animato della storia, rilasciato nel 1937. Il film richiese tre anni di produzione, 750 artisti, oltre due milioni di disegni. Scene come quella di Biancaneve che fugge nella foresta utilizzavano camera multiplane per creare profondità vertiginosa e senso di pericolo immersivo.

L'animazione limitata e l'efficienza produttiva

Produrre animazione completa, dove ogni fotogramma è disegnato ex novo con 24 disegni al secondo, è costoso. Negli anni Cinquanta, con l'avvento della televisione che richiedeva volumi produttivi enormi a budget limitati, studi come United Productions of America e poi Hanna-Barbera svilupparono tecniche di animazione limitata.

Invece di animare l'intero corpo del personaggio, si animavano solo parti in movimento. Un personaggio che parla poteva avere bocca animata mentre testa, corpo e sfondo restavano statici. Cicli di movimento ripetitivi venivano riutilizzati: una camminata disegnata in 8 fotogrammi poteva essere loopata indefinitamente. Personaggi visti di profilo evitavano complessità prospettiche.

Queste semplificazioni, nate da necessità economiche, svilupparono un'estetica distintiva. Serie come Gli Antenati, I Jetson, Scooby-Doo, adottavano design grafici stilizzati con colori piatti e linee pulite che funzionavano bene con animazione ridotta. Il focus si spostava su narrazione, dialoghi e character design piuttosto che sulla fluidità del movimento.

Questa filosofia influenzò profondamente l'animazione televisiva mondiale. Anime giapponesi degli anni Sessanta e Settanta, come Astro Boy di Osamu Tezuka, utilizzavano animazione limitata per ragioni analoghe, sviluppando convenzioni stilistiche proprie come bocche che si aprono a triangolo, linee di velocità, inquadrature statiche con solo bocca animata.

L'animazione sperimentale e d'autore

Parallelamente alla produzione commerciale, artisti esplorarono l'animazione come forma espressiva pura. Norman McLaren, animatore canadese, dipingeva e grattava direttamente sulla pellicola cinematografica, creando cortometraggi astratti dove forme colorate danzavano sincronizzate con musica. Questa tecnica eliminava completamente la fase di disegno e fotografia tradizionali.

Jan vankmajer e i fratelli Quay svilupparono stop-motion surreale con oggetti, pupazzi e materiali insoliti. Le loro opere, influenzate da surrealismo e espressionismo, dimostravano che animazione non significava necessariamente personaggi carini e storie lineari, ma poteva esplorare psicologie disturbate, sogni, incubi, filosofia.

Animatori come Frédéric Back realizzavano cortometraggi su tematiche ambientali e umanistiche con tecniche di matite colorate su acetato retroilluminato, producendo texture pittoriche calde e organiche. L'Uomo che Piantava gli Alberi vinse l'Oscar nel 1988, dimostrando che animazione contemplativa e lenta poteva competere con blockbuster ad alto budget.

Queste esplorazioni espansero i confini concettuali dell'animazione, influenzando generazioni successive di filmmaker che rifiutavano dicotomie tra arte e intrattenimento, tra sperimentazione formale e accessibilità narrativa.

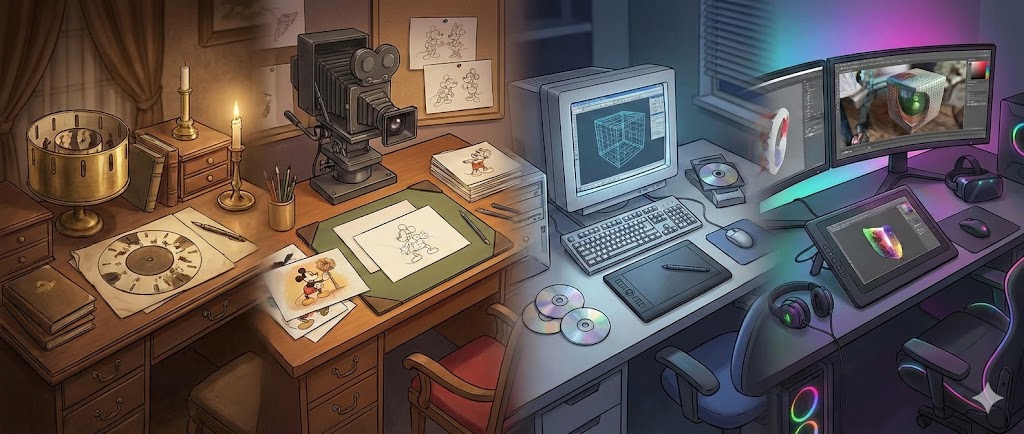

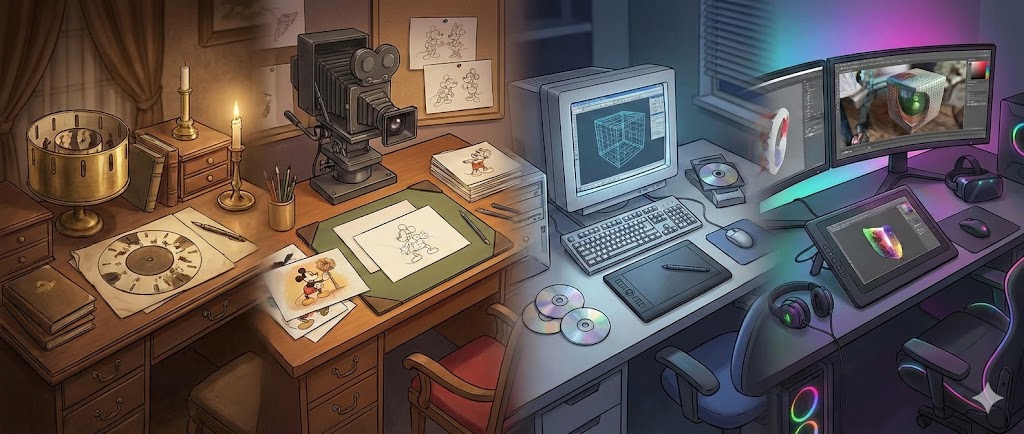

La rivoluzione digitale: dall'analogico al computer

Gli anni Ottanta videro i primi esperimenti di computer graphics applicata all'animazione. Tron, film Disney del 1982, conteneva circa 15 minuti di sequenze completamente generate al computer, una percentuale rivoluzionaria per l'epoca. Sebbene la grafica fosse primitiva con forme geometriche semplici e colori fluorescenti, dimostrava possibilità inedite.

I software di animazione 3D richiedevano workstation costosissime e competenze tecniche elevate. Pixar, nata come divisione grafica di Lucasfilm, sviluppò RenderMan, un motore di rendering che permetteva di calcolare illuminazione, ombre, riflessi e texture con realismo fotografico. I corti sperimentali di Pixar come Luxo Jr. e Tin Toy mostravano character animation espressiva in 3D.

Nel 1995, Toy Story divenne il primo lungometraggio interamente realizzato in computer grafica 3D. Il film richiedeva 800.000 ore di rendering distribuite su farm di computer. Ogni fotogramma, a seconda della complessità della scena, poteva richiedere da 2 a 15 ore di calcolo. Texture dettagliate, capelli, tessuti, superfici riflettenti, presentavano sfide tecniche enormi.

La pipeline produttiva digitale differiva radicalmente da quella tradizionale. Invece di disegnare, gli artisti modellavano personaggi tridimensionali in software come Maya o 3ds Max. Rig artists creavano scheletri virtuali con giunture e controlli che animatori manipolavano per posare i personaggi fotogramma per fotogramma. Lighting artists illuminavano scene virtualmente, texturing artists dipingevano superfici digitali.

L'animazione 2D digitale e la composizione

Mentre Pixar rivoluzionava il 3D, l'animazione 2D tradizionale adottava strumenti digitali. Software come Toon Boom, TVPaint e Retas permettevano di disegnare direttamente su tavolette grafiche, eliminando carta, matite e cel fisici. I disegni venivano colorati digitalmente con riempimenti uniformi o texture, accelerando processi che richiedevano ore di pittura manuale.

La composizione digitale, usando software come After Effects o Nuke, sostituiva la camera multiplane. Livelli di grafica venivano impilati virtualmente e animati nello spazio Z simulato. Effetti come sfocatura, correzioni cromatiche, particelle, potevano essere aggiunti proceduralmente senza ridisegnare nulla. Le modifiche diventavano non-distruttive: cambiare un colore o un movimento non richiedeva ricominciare da zero.

Don Bluth, animatore tradizionalista, adottò tecnologie digitali per film come Anastasia e Titan A.E., combinando disegni a mano scannerizzati con sfondi e effetti generati al computer. Questa ibridazione cercava di preservare l'estetica artigianale dell'animazione classica beneficiando dell'efficienza digitale.

Studio Ghibli di Hayao Miyazaki mantenne approccio prevalentemente analogico fino agli anni Duemila, con disegni su carta scannerizzati e colorati digitalmente ma evitando 3D per personaggi principali. La Città Incantata, Oscar 2003, rappresentava la transizione: disegni tradizionali compositi digitalmente con occasionali elementi 3D per veicoli o architetture complesse.

Motion capture e performance capture

La motion capture registra movimenti di attori reali tramite sensori applicati al corpo. Telecamere infrarosse tracciano marcatori riflettenti posizionati su articolazioni, registrando posizioni tridimensionali con precisione millimetrica. Questi dati vengono applicati a scheletri virtuali, trasferendo movimenti umani naturali a personaggi digitali.

Inizialmente usata per animazioni secondarie o creature realistiche, la motion capture evolse in performance capture che cattura anche espressioni facciali mediante telecamere ad alta risoluzione puntate sul viso dell'attore. Centinaia di punti di riferimento tracciano ogni minimo movimento di sopracciglia, labbra, guance, permettendo trasferimento di performance recitativa completa.

Il Signore degli Anelli utilizzò performance capture per Gollum, con Andy Serkis che recitava in tuta sensorizzata. Avatar di James Cameron spinse la tecnologia oltre, con sistema proprietario che filmava simultaneamente attore e ambiente virtuale, permettendo al regista di vedere in tempo reale come appariva la scena finale con personaggi Na'vi e paesaggi di Pandora.

Il Pianeta delle Scimmie reboot trilogy ha perfezionato performance capture per espressioni facciali simiesche ultrarealistiche, dove Andy Serkis interpretava Cesare con emotività umana tradotta in anatomia scimmiesca. Questa tecnologia sfuma confini tra live-action e animazione, creando categorie ibride difficili da classificare.

Rendering fisicamente basato e ray tracing

Il realismo visivo della computer grafica è progredito grazie a rendering fisicamente basato, che simula comportamento reale della luce. Invece di illuminazione artificiosa programmata artisticamente, algoritmi calcolano come fotoni rimbalzano tra superfici, assorbiti, riflessi o rifratti secondo proprietà fisiche dei materiali.

Il ray tracing traccia percorsi di raggi luminosi dall'occhio virtuale verso sorgenti di luce, calcolando ogni interazione. Questa tecnica, computazionalmente intensiva, produce ombre morbide realistiche, riflessi accurati in superfici metalliche o acquatiche, caustiche luminose, effetti impossibili con metodi di rendering più veloci ma approssimativi.

Film come Big Hero 6 e Frozen II utilizzano path tracing, evoluzione del ray tracing che simula diffusione globale della luce. Scene illuminate solo da luce ambiente indiretta, come interni tenuemente illuminati da finestre, acquistano realismo fotografico con illuminazione complessa calcolata automaticamente dall'algoritmo.

GPU moderne e farm di rendering cloud hanno reso accessibili tecniche precedentemente riservate a produzioni hollywoodiane. Software come Blender, gratuito e open-source, include motori di rendering ray-traced competitivi con soluzioni commerciali, democratizzando produzione di animazione di alta qualità.

L'intelligenza artificiale nell'animazione

Negli ultimi anni, machine learning e intelligenza artificiale stanno trasformando workflow produttivi. Algoritmi di inbetweening automatico generano fotogrammi intermedi tra keyframe disegnati da animatori, riducendo lavoro ripetitivo. Reti neurali analizzano stile di disegno di un artista e lo replicano coerentemente su migliaia di frame.

La sintesi di volti e voci tramite deepfake permette animazione facciale realistica partendo da audio. Un attore vocale recita dialoghi e algoritmi generano automaticamente movimenti labiali e espressioni coordinate. Questa tecnologia solleva questioni etiche su autenticità e proprietà della performance, ma accelera produzioni che richiederebbero mesi di animazione manuale.

Generative AI come Stable Diffusion e Midjourney producono immagini da descrizioni testuali. Alcuni sperimentano animazioni generate interamente da prompt testuali, sebbene la coerenza tra fotogrammi rimanga problematica. RunwayML e strumenti simili permettono trasformazioni stilistiche in tempo reale, convertendo video reale in stile cartoon o pittorico.

Queste tecnologie democratizzano creazione di contenuti animati ma generano dibattiti. Gli artisti tradizionali temono obsolescenza delle competenze artigianali. Questioni legali su copyright di opere generate da AI addestrate su dataset di opere protette restano irrisolte. L'industria sta navigando questa transizione cercando equilibri tra efficienza tecnologica e valorizzazione del talento umano.

Animazione contemporanea: diversità stilistica

L'animazione odierna presenta pluralità stilistica senza precedenti. Pixar e DreamWorks producono 3D fotorealistico con texture elaborate e fisica simulata. Sony Pictures Animation esplora stili grafici derivati dal fumetto, come in Spider-Man: Un Nuovo Universo che combina rendering 3D con effetti di stampa a mezzitoni e framerate variabili per estetica da comic book.

Netflix e piattaforme streaming investono in animazione adulta con serie come BoJack Horseman, che usa design minimalista e colori piatti servendo narrazioni psicologicamente complesse. Anime giapponesi raggiungono audience globale con produzioni che spaziano da azione shonen a drammi intimisti, mantenendo tecniche di animazione limitata evolute in linguaggio stilistico riconoscibile.

L'animazione indipendente prospera grazie a strumenti accessibili. Creators su YouTube e piattaforme social producono serie animate con team ridottissimi o individualmente, raggiungendo milioni di visualizzazioni. Hazbin Hotel e Helluva Boss, prodotti inizialmente come progetti passion, hanno ottenuto distribuzione mainstream grazie a fanbase costruite organicamente online.

La realtà virtuale introduce dimensione spaziale inedita. Animazioni VR immergono spettatori dentro scene tridimensionali navigabili. Quill di Oculus permette di disegnare direttamente in spazio 3D con headset VR, creando illustrazioni volumetriche animate. Dear Angelica, cortometraggio realizzato interamente in VR, esplora questa frontiera narrativa dove lo spettatore controlla parzialmente inquadratura e prospettiva.

Produzione sostenibile e sfide ambientali

Il rendering digitale consuma energia massiccia. Farm di server che calcolano milioni di ore di rendering per un singolo film generano impronte carbonio significative. Studi stanno adottando pratiche sostenibili: ottimizzazione algoritmica per ridurre tempi di calcolo, utilizzo di energie rinnovabili per datacenter, cloud rendering distribuito in regioni con energia pulita.

L'animazione tradizionale analogica aveva impatti ambientali diversi: carta, vernici acriliche, acetati. Sebbene fisicamente tangibili, i volumi erano gestibili con riciclo. La transizione digitale ha eliminato sprechi materiali ma ha introdotto consumi energetici nascosti e rifiuti elettronici da hardware obsoleto frequentemente sostituito.

Iniziative come Green Production Guide forniscono linee guida per produzioni eco-sostenibili. Calcolo dell'impronta carbonica diventa metrica considerata durante pianificazione. Alcuni studi compensano emissioni finanziando progetti di riforestazione o energia rinnovabile, sebbene critici considerino questi offset insufficienti senza riduzione assoluta dei consumi.

Il futuro dell'animazione: convergenze tecnologiche

Le traiettorie future suggeriscono integrazione crescente tra animazione, gaming e intelligenza artificiale. Motori grafici real-time come Unreal Engine 5, usati originariamente per videogiochi, producono grafica di qualità cinematografica renderizzata istantaneamente. The Mandalorian utilizza LED walls che mostrano sfondi virtuali generati real-time, permettendo interazione diretta tra attori e ambienti digitali senza greenscreen.

Animazione procedurale, dove algoritmi generano variazioni infinite di movimenti o ambienti da regole parametriche, permette creazione di mondi vasti con risorse limitate. Folla in scene epiche, vegetazione fotorealistica, effetti atmosferici, vengono simulati proceduralmente con dettaglio adattivo basato su distanza dalla camera.

La personalizzazione narrativa potrebbe permettere animazioni che si adattano a preferenze dello spettatore. Algoritmi potrebbero modificare dialoghi, ritmo, ending, creando esperienze uniche per ogni visione. Questo richiede produzione modulare con asset ricomponibili dinamicamente, sfidando concezioni tradizionali di opera finita e autorialità.

Dai dischi rotanti ottocenteschi alle reti neurali contemporanee, l'animazione ha attraversato rivoluzioni tecniche mantenendo costante una missione: dare vita all'inanimato, trasformare immaginazione in movimento percepibile. Ogni generazione ha ridefinito possibilità espressive ampliando linguaggio visivo disponibile. Il futuro vedrà probabilmente convergenze inimmaginabili oggi, ma il cuore dell'animazione rimarrà l'abilità umana di raccontare storie, evocare emozioni e costruire mondi attraverso sequenze di immagini che, nell'illusione del movimento, catturano verità sulla condizione umana impossibili da esprimere altrimenti.

Evoluzione delle tecniche di animazione dal disegno a mano al digitale

L'animazione ha trasformato disegni statici in movimento, evolvendosi da esperimenti ottici ottocenteschi fino alle sofisticate produzioni digitali contemporanee. Un viaggio attraverso tecniche, innovazioni e rivoluzioni creative che hanno definito un'arte in continua metamorfosi.LEGGI TUTTO L'ARTICOLO

Gli antenati dell'animazione: giocattoli ottici

Le radici dell'animazione affondano negli esperimenti ottici del XIX secolo, quando scienziati e inventori esploravano la persistenza retinica, il fenomeno per cui l'occhio umano trattiene brevemente un'immagine dopo che questa è scomparsa. Questo principio fisiologico è il fondamento di ogni forma di cinema e animazione.

Il taumatropio, inventato nel 1825 da John Ayrton Paris, era un disco con immagini diverse sui due lati. Facendolo ruotare velocemente mediante cordicelle, le due immagini si fondevano creando l'illusione di un'unica scena composta. Un classico esempio mostrava un uccello su un lato e una gabbia sull'altro: in rotazione, l'uccello appariva dentro la gabbia.

Il fenachistoscopio, sviluppato indipendentemente nel 1832 da Joseph Plateau in Belgio e Simon von Stampfer in Austria, utilizzava dischi rotanti con sequenze di immagini leggermente diverse osservate attraverso fessure. Ruotando il disco davanti a uno specchio e guardando attraverso le fessure, le immagini si susseguivano creando movimento fluido. Questo dispositivo dimostrava che una serie di disegni statici poteva ingannare l'occhio generando percezione di movimento continuo.

Lo zootropio, perfezionato da William George Horner nel 1834, migliorava il fenachistoscopio eliminando la necessità dello specchio. Un cilindro cavo con fessure verticali conteneva una striscia di carta con sequenze disegnate all'interno. Ruotando il cilindro e osservando attraverso le fessure, le immagini prendevano vita. Questo giocattolo ottimo divenne popolare nei salotti vittoriani, democratizzando l'accesso all'animazione primitiva.

Il prassinoscopio e l'avvento del cinema

Nel 1877, Émile Reynaud inventò il prassinoscopio, che sostituiva le fessure dello zootropio con specchi posizionati al centro del cilindro. Questi specchi riflettevano le immagini eliminando lo sfarfallio causato dalle fessure, producendo animazioni più fluide e luminose. Reynaud sviluppò successivamente il teatro ottico, un sistema di proiezione che permetteva di proiettare su schermo sequenze animate lunghe anche 15 minuti, accompagnate da musica dal vivo.

Queste proiezioni pubbliche al Musée Grévin di Parigi, iniziate nel 1892, sono considerate da molti storici le prime vere esibizioni di animazione per un pubblico pagante, precedendo di tre anni la nascita ufficiale del cinema con i fratelli Lumière. Reynaud disegnava manualmente ogni fotogramma su strisce trasparenti di gelatina, creando narrazioni complete con personaggi ricorrenti.

L'invenzione del cinematografo nel 1895 aprì possibilità inedite. Mentre i Lumière documentavano la realtà, altri pionieri compresero che la macchina da presa poteva creare realtà impossibili. Georges Méliès, prestigiatore e cineasta francese, scoprì casualmente il trucco della sostituzione: fermando la ripresa, modificando la scena e riprendendo, gli oggetti apparivano magicamente cambiare o scomparire.

Questa tecnica di stop-motion divenne fondamentale. Applicata a disegni fotografati fotogramma per fotogramma, nacque l'animazione cinematografica vera e propria. James Stuart Blackton, nel 1906, realizzò Humorous Phases of Funny Faces, considerato uno dei primi film animati, disegnando espressioni facciali su lavagna e fotografandole progressivamente mentre le cancellava e ridisegnava.

L'era pionieristica: Winsor McCay e la nascita dell'arte

Winsor McCay, fumettista americano celebre per la striscia Little Nemo in Slumberland, elevò l'animazione da curiosità tecnica ad arte espressiva. Nel 1914 creò Gertie il Dinosauro, un cortometraggio di circa 12 minuti che richiedeva oltre 10.000 disegni eseguiti personalmente su fogli di riso.

Gertie non era solo una sequenza di movimenti ma un personaggio con personalità. McCay interagiva con il dinosauro animato durante proiezioni dal vivo, dandole ordini che Gertie eseguiva, disobbediva giocosamente o commentava con espressioni emotive. Questo pioneristico character animation dimostrava che personaggi disegnati potevano suscitare empatia e connessione emotiva come attori in carne e ossa.

La tecnica di McCay era laboriosa. Disegnava ogni fotogramma completamente, inclusi sfondi statici ridisegnati migliaia di volte. Questa ridondanza limitava la produttività, rendendo i progetti estremamente costosi in tempo e denaro. La necessità di efficienza produttiva avrebbe guidato le innovazioni successive.

L'invenzione del cel: rivoluzione produttiva

Nel 1914, Earl Hurd brevettò la tecnica del cel, acetato trasparente su cui venivano dipinti i personaggi in movimento. Gli sfondi statici venivano disegnati una sola volta su carta o cartoncino. Sovrapponendo i cel trasparenti con i personaggi sugli sfondi e fotografando l'insieme, si otteneva il fotogramma completo senza ridisegnare ripetutamente elementi immobili.

Questa innovazione ridusse drasticamente il lavoro necessario. Per un'animazione di 10 secondi a 24 fotogrammi al secondo servivano 240 disegni del personaggio ma un solo sfondo. Il risparmio economico e temporale rese possibile la produzione industriale di animazione, trasformandola da artigianato d'autore a industria organizzata.

I cel permettevano inoltre stratificazione complessa. Diversi livelli di acetato potevano essere sovrapposti: uno per il personaggio in primo piano, uno per elementi di medio piano, uno per effetti come pioggia o nebbia. Questa profondità spaziale arricchiva la composizione visiva, simulando tridimensionalità in immagini bidimensionali.

La tecnica del cel dominò l'animazione per oltre 70 anni, fino all'avvento del digitale negli anni Novanta. Praticamente ogni cartone animato classico, da Disney a Warner Bros, da Hanna-Barbera agli anime giapponesi, utilizzò acetati dipinti a mano e fotografati con camere multiplane.

L'età d'oro di Disney: innovazione tecnica e narrativa

Walt Disney non inventò l'animazione ma la perfezionò industrialmente e artisticamente. Nel 1928, Steamboat Willie introdusse Topolino e, crucialmente, il sonoro sincronizzato. Per la prima volta, movimenti labiali, passi, azioni, erano perfettamente coordinati con dialoghi, musica ed effetti sonori. Questa sincronia trasformava l'esperienza percettiva rendendo i personaggi credibilmente vivi.

Disney investì sistematicamente in ricerca e sviluppo. Nel 1932, Flowers and Trees fu il primo cartone animato a colori con il processo Technicolor, che utilizzava tre negativi separati per catturare l'intero spettro cromatico con saturazione e fedeltà superiori ai sistemi precedenti. Il colore non era decorativo ma narrativo: tonalità calde per scene gioiose, fredde per atmosfere minacciose.

La camera multiplane, sviluppata nel 1937, rivoluzionò la profondità spaziale. Invece di fotografare tutti i livelli appiattiti insieme, la camera multiplane disponeva sfondi, piani intermedi e primi piani su lastre di vetro separate verticalmente. Muovendo questi piani a velocità differenti durante la ripresa, si otteneva effetto parallasse: elementi vicini scorrevano più velocemente di quelli lontani, simulando movimento tridimensionale della macchina da presa in spazi dipinti.

Questo sistema debuttò pienamente in Biancaneve e i Sette Nani, primo lungometraggio animato della storia, rilasciato nel 1937. Il film richiese tre anni di produzione, 750 artisti, oltre due milioni di disegni. Scene come quella di Biancaneve che fugge nella foresta utilizzavano camera multiplane per creare profondità vertiginosa e senso di pericolo immersivo.

L'animazione limitata e l'efficienza produttiva

Produrre animazione completa, dove ogni fotogramma è disegnato ex novo con 24 disegni al secondo, è costoso. Negli anni Cinquanta, con l'avvento della televisione che richiedeva volumi produttivi enormi a budget limitati, studi come United Productions of America e poi Hanna-Barbera svilupparono tecniche di animazione limitata.

Invece di animare l'intero corpo del personaggio, si animavano solo parti in movimento. Un personaggio che parla poteva avere bocca animata mentre testa, corpo e sfondo restavano statici. Cicli di movimento ripetitivi venivano riutilizzati: una camminata disegnata in 8 fotogrammi poteva essere loopata indefinitamente. Personaggi visti di profilo evitavano complessità prospettiche.

Queste semplificazioni, nate da necessità economiche, svilupparono un'estetica distintiva. Serie come Gli Antenati, I Jetson, Scooby-Doo, adottavano design grafici stilizzati con colori piatti e linee pulite che funzionavano bene con animazione ridotta. Il focus si spostava su narrazione, dialoghi e character design piuttosto che sulla fluidità del movimento.

Questa filosofia influenzò profondamente l'animazione televisiva mondiale. Anime giapponesi degli anni Sessanta e Settanta, come Astro Boy di Osamu Tezuka, utilizzavano animazione limitata per ragioni analoghe, sviluppando convenzioni stilistiche proprie come bocche che si aprono a triangolo, linee di velocità, inquadrature statiche con solo bocca animata.

L'animazione sperimentale e d'autore

Parallelamente alla produzione commerciale, artisti esplorarono l'animazione come forma espressiva pura. Norman McLaren, animatore canadese, dipingeva e grattava direttamente sulla pellicola cinematografica, creando cortometraggi astratti dove forme colorate danzavano sincronizzate con musica. Questa tecnica eliminava completamente la fase di disegno e fotografia tradizionali.

Jan vankmajer e i fratelli Quay svilupparono stop-motion surreale con oggetti, pupazzi e materiali insoliti. Le loro opere, influenzate da surrealismo e espressionismo, dimostravano che animazione non significava necessariamente personaggi carini e storie lineari, ma poteva esplorare psicologie disturbate, sogni, incubi, filosofia.

Animatori come Frédéric Back realizzavano cortometraggi su tematiche ambientali e umanistiche con tecniche di matite colorate su acetato retroilluminato, producendo texture pittoriche calde e organiche. L'Uomo che Piantava gli Alberi vinse l'Oscar nel 1988, dimostrando che animazione contemplativa e lenta poteva competere con blockbuster ad alto budget.

Queste esplorazioni espansero i confini concettuali dell'animazione, influenzando generazioni successive di filmmaker che rifiutavano dicotomie tra arte e intrattenimento, tra sperimentazione formale e accessibilità narrativa.

La rivoluzione digitale: dall'analogico al computer

Gli anni Ottanta videro i primi esperimenti di computer graphics applicata all'animazione. Tron, film Disney del 1982, conteneva circa 15 minuti di sequenze completamente generate al computer, una percentuale rivoluzionaria per l'epoca. Sebbene la grafica fosse primitiva con forme geometriche semplici e colori fluorescenti, dimostrava possibilità inedite.

I software di animazione 3D richiedevano workstation costosissime e competenze tecniche elevate. Pixar, nata come divisione grafica di Lucasfilm, sviluppò RenderMan, un motore di rendering che permetteva di calcolare illuminazione, ombre, riflessi e texture con realismo fotografico. I corti sperimentali di Pixar come Luxo Jr. e Tin Toy mostravano character animation espressiva in 3D.

Nel 1995, Toy Story divenne il primo lungometraggio interamente realizzato in computer grafica 3D. Il film richiedeva 800.000 ore di rendering distribuite su farm di computer. Ogni fotogramma, a seconda della complessità della scena, poteva richiedere da 2 a 15 ore di calcolo. Texture dettagliate, capelli, tessuti, superfici riflettenti, presentavano sfide tecniche enormi.

La pipeline produttiva digitale differiva radicalmente da quella tradizionale. Invece di disegnare, gli artisti modellavano personaggi tridimensionali in software come Maya o 3ds Max. Rig artists creavano scheletri virtuali con giunture e controlli che animatori manipolavano per posare i personaggi fotogramma per fotogramma. Lighting artists illuminavano scene virtualmente, texturing artists dipingevano superfici digitali.

L'animazione 2D digitale e la composizione

Mentre Pixar rivoluzionava il 3D, l'animazione 2D tradizionale adottava strumenti digitali. Software come Toon Boom, TVPaint e Retas permettevano di disegnare direttamente su tavolette grafiche, eliminando carta, matite e cel fisici. I disegni venivano colorati digitalmente con riempimenti uniformi o texture, accelerando processi che richiedevano ore di pittura manuale.

La composizione digitale, usando software come After Effects o Nuke, sostituiva la camera multiplane. Livelli di grafica venivano impilati virtualmente e animati nello spazio Z simulato. Effetti come sfocatura, correzioni cromatiche, particelle, potevano essere aggiunti proceduralmente senza ridisegnare nulla. Le modifiche diventavano non-distruttive: cambiare un colore o un movimento non richiedeva ricominciare da zero.

Don Bluth, animatore tradizionalista, adottò tecnologie digitali per film come Anastasia e Titan A.E., combinando disegni a mano scannerizzati con sfondi e effetti generati al computer. Questa ibridazione cercava di preservare l'estetica artigianale dell'animazione classica beneficiando dell'efficienza digitale.

Studio Ghibli di Hayao Miyazaki mantenne approccio prevalentemente analogico fino agli anni Duemila, con disegni su carta scannerizzati e colorati digitalmente ma evitando 3D per personaggi principali. La Città Incantata, Oscar 2003, rappresentava la transizione: disegni tradizionali compositi digitalmente con occasionali elementi 3D per veicoli o architetture complesse.

Motion capture e performance capture

La motion capture registra movimenti di attori reali tramite sensori applicati al corpo. Telecamere infrarosse tracciano marcatori riflettenti posizionati su articolazioni, registrando posizioni tridimensionali con precisione millimetrica. Questi dati vengono applicati a scheletri virtuali, trasferendo movimenti umani naturali a personaggi digitali.

Inizialmente usata per animazioni secondarie o creature realistiche, la motion capture evolse in performance capture che cattura anche espressioni facciali mediante telecamere ad alta risoluzione puntate sul viso dell'attore. Centinaia di punti di riferimento tracciano ogni minimo movimento di sopracciglia, labbra, guance, permettendo trasferimento di performance recitativa completa.

Il Signore degli Anelli utilizzò performance capture per Gollum, con Andy Serkis che recitava in tuta sensorizzata. Avatar di James Cameron spinse la tecnologia oltre, con sistema proprietario che filmava simultaneamente attore e ambiente virtuale, permettendo al regista di vedere in tempo reale come appariva la scena finale con personaggi Na'vi e paesaggi di Pandora.

Il Pianeta delle Scimmie reboot trilogy ha perfezionato performance capture per espressioni facciali simiesche ultrarealistiche, dove Andy Serkis interpretava Cesare con emotività umana tradotta in anatomia scimmiesca. Questa tecnologia sfuma confini tra live-action e animazione, creando categorie ibride difficili da classificare.

Rendering fisicamente basato e ray tracing

Il realismo visivo della computer grafica è progredito grazie a rendering fisicamente basato, che simula comportamento reale della luce. Invece di illuminazione artificiosa programmata artisticamente, algoritmi calcolano come fotoni rimbalzano tra superfici, assorbiti, riflessi o rifratti secondo proprietà fisiche dei materiali.

Il ray tracing traccia percorsi di raggi luminosi dall'occhio virtuale verso sorgenti di luce, calcolando ogni interazione. Questa tecnica, computazionalmente intensiva, produce ombre morbide realistiche, riflessi accurati in superfici metalliche o acquatiche, caustiche luminose, effetti impossibili con metodi di rendering più veloci ma approssimativi.

Film come Big Hero 6 e Frozen II utilizzano path tracing, evoluzione del ray tracing che simula diffusione globale della luce. Scene illuminate solo da luce ambiente indiretta, come interni tenuemente illuminati da finestre, acquistano realismo fotografico con illuminazione complessa calcolata automaticamente dall'algoritmo.

GPU moderne e farm di rendering cloud hanno reso accessibili tecniche precedentemente riservate a produzioni hollywoodiane. Software come Blender, gratuito e open-source, include motori di rendering ray-traced competitivi con soluzioni commerciali, democratizzando produzione di animazione di alta qualità.

L'intelligenza artificiale nell'animazione

Negli ultimi anni, machine learning e intelligenza artificiale stanno trasformando workflow produttivi. Algoritmi di inbetweening automatico generano fotogrammi intermedi tra keyframe disegnati da animatori, riducendo lavoro ripetitivo. Reti neurali analizzano stile di disegno di un artista e lo replicano coerentemente su migliaia di frame.

La sintesi di volti e voci tramite deepfake permette animazione facciale realistica partendo da audio. Un attore vocale recita dialoghi e algoritmi generano automaticamente movimenti labiali e espressioni coordinate. Questa tecnologia solleva questioni etiche su autenticità e proprietà della performance, ma accelera produzioni che richiederebbero mesi di animazione manuale.

Generative AI come Stable Diffusion e Midjourney producono immagini da descrizioni testuali. Alcuni sperimentano animazioni generate interamente da prompt testuali, sebbene la coerenza tra fotogrammi rimanga problematica. RunwayML e strumenti simili permettono trasformazioni stilistiche in tempo reale, convertendo video reale in stile cartoon o pittorico.

Queste tecnologie democratizzano creazione di contenuti animati ma generano dibattiti. Gli artisti tradizionali temono obsolescenza delle competenze artigianali. Questioni legali su copyright di opere generate da AI addestrate su dataset di opere protette restano irrisolte. L'industria sta navigando questa transizione cercando equilibri tra efficienza tecnologica e valorizzazione del talento umano.

Animazione contemporanea: diversità stilistica

L'animazione odierna presenta pluralità stilistica senza precedenti. Pixar e DreamWorks producono 3D fotorealistico con texture elaborate e fisica simulata. Sony Pictures Animation esplora stili grafici derivati dal fumetto, come in Spider-Man: Un Nuovo Universo che combina rendering 3D con effetti di stampa a mezzitoni e framerate variabili per estetica da comic book.

Netflix e piattaforme streaming investono in animazione adulta con serie come BoJack Horseman, che usa design minimalista e colori piatti servendo narrazioni psicologicamente complesse. Anime giapponesi raggiungono audience globale con produzioni che spaziano da azione shonen a drammi intimisti, mantenendo tecniche di animazione limitata evolute in linguaggio stilistico riconoscibile.

L'animazione indipendente prospera grazie a strumenti accessibili. Creators su YouTube e piattaforme social producono serie animate con team ridottissimi o individualmente, raggiungendo milioni di visualizzazioni. Hazbin Hotel e Helluva Boss, prodotti inizialmente come progetti passion, hanno ottenuto distribuzione mainstream grazie a fanbase costruite organicamente online.

La realtà virtuale introduce dimensione spaziale inedita. Animazioni VR immergono spettatori dentro scene tridimensionali navigabili. Quill di Oculus permette di disegnare direttamente in spazio 3D con headset VR, creando illustrazioni volumetriche animate. Dear Angelica, cortometraggio realizzato interamente in VR, esplora questa frontiera narrativa dove lo spettatore controlla parzialmente inquadratura e prospettiva.

Produzione sostenibile e sfide ambientali

Il rendering digitale consuma energia massiccia. Farm di server che calcolano milioni di ore di rendering per un singolo film generano impronte carbonio significative. Studi stanno adottando pratiche sostenibili: ottimizzazione algoritmica per ridurre tempi di calcolo, utilizzo di energie rinnovabili per datacenter, cloud rendering distribuito in regioni con energia pulita.

L'animazione tradizionale analogica aveva impatti ambientali diversi: carta, vernici acriliche, acetati. Sebbene fisicamente tangibili, i volumi erano gestibili con riciclo. La transizione digitale ha eliminato sprechi materiali ma ha introdotto consumi energetici nascosti e rifiuti elettronici da hardware obsoleto frequentemente sostituito.

Iniziative come Green Production Guide forniscono linee guida per produzioni eco-sostenibili. Calcolo dell'impronta carbonica diventa metrica considerata durante pianificazione. Alcuni studi compensano emissioni finanziando progetti di riforestazione o energia rinnovabile, sebbene critici considerino questi offset insufficienti senza riduzione assoluta dei consumi.

Il futuro dell'animazione: convergenze tecnologiche

Le traiettorie future suggeriscono integrazione crescente tra animazione, gaming e intelligenza artificiale. Motori grafici real-time come Unreal Engine 5, usati originariamente per videogiochi, producono grafica di qualità cinematografica renderizzata istantaneamente. The Mandalorian utilizza LED walls che mostrano sfondi virtuali generati real-time, permettendo interazione diretta tra attori e ambienti digitali senza greenscreen.

Animazione procedurale, dove algoritmi generano variazioni infinite di movimenti o ambienti da regole parametriche, permette creazione di mondi vasti con risorse limitate. Folla in scene epiche, vegetazione fotorealistica, effetti atmosferici, vengono simulati proceduralmente con dettaglio adattivo basato su distanza dalla camera.

La personalizzazione narrativa potrebbe permettere animazioni che si adattano a preferenze dello spettatore. Algoritmi potrebbero modificare dialoghi, ritmo, ending, creando esperienze uniche per ogni visione. Questo richiede produzione modulare con asset ricomponibili dinamicamente, sfidando concezioni tradizionali di opera finita e autorialità.

Dai dischi rotanti ottocenteschi alle reti neurali contemporanee, l'animazione ha attraversato rivoluzioni tecniche mantenendo costante una missione: dare vita all'inanimato, trasformare immaginazione in movimento percepibile. Ogni generazione ha ridefinito possibilità espressive ampliando linguaggio visivo disponibile. Il futuro vedrà probabilmente convergenze inimmaginabili oggi, ma il cuore dell'animazione rimarrà l'abilità umana di raccontare storie, evocare emozioni e costruire mondi attraverso sequenze di immagini che, nell'illusione del movimento, catturano verità sulla condizione umana impossibili da esprimere altrimenti.

Di Alex (pubblicato @ 13:00:00 in Tecnologia, letto 25 volte)

Internet tattile e haptics avanzati

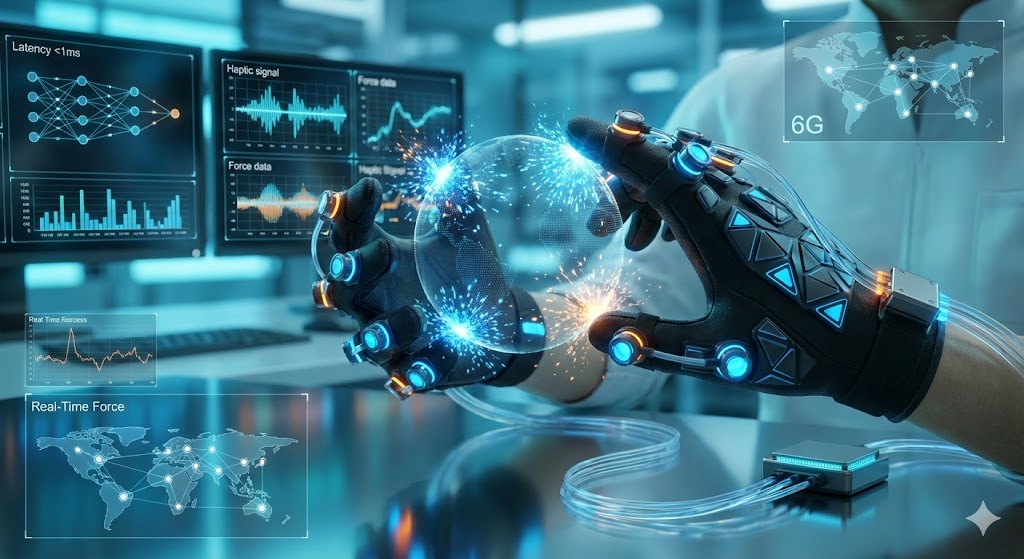

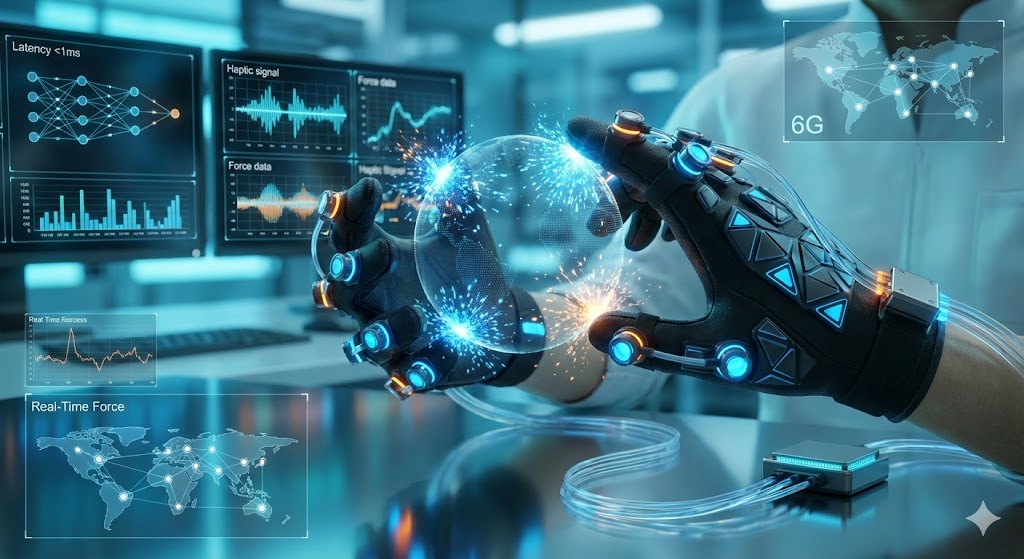

L'Internet tattile promette di trasmettere sensazioni fisiche attraverso la rete, rivoluzionando telechirurgia, robotica remota e interazioni virtuali. Richiede reti a latenza inferiore al millisecondo e attuatori aptici di nuova generazione.LEGGI TUTTO L'ARTICOLO

🎧 Ascolta questo articolo

Oltre la comunicazione audiovisiva

L'evoluzione di Internet ha progressivamente arricchito le modalità di comunicazione a distanza. Dalla sola trasmissione testuale degli albori, siamo passati a telefonia voip, videoconferenze ad alta definizione e realtà virtuale immersiva. Tuttavia, manca ancora un senso fondamentale nell'esperienza umana: il tatto.

L'Internet tattile, o Tactile Internet, rappresenta la prossima frontiera della telepresenza. L'obiettivo è trasmettere sensazioni tattili, forze, texture e temperature attraverso reti di comunicazione, permettendo interazioni fisiche remote indistinguibili da quelle locali. Le applicazioni spaziano dalla chirurgia robotica remota alla manutenzione industriale, dall'educazione esperienziale ai sistemi di sicurezza.

Questa visione richiede convergenza di tre tecnologie chiave: reti di comunicazione ultra-affidabili a latenza inferiore al millisecondo, dispositivi aptici capaci di riprodurre fedelmente sensazioni complesse, e algoritmi di controllo che garantiscano stabilità e sicurezza in presenza di ritardi variabili e possibili interruzioni di connessione.

La sfida della latenza nelle reti 5G e 6G

Il sistema nervoso umano percepisce ritardi tattili dell'ordine di 1-10 millisecondi. Quando interagiamo fisicamente con un oggetto, il feedback sensoriale raggiunge il cervello e comanda azioni correttive in tempi brevissimi. Per replicare questa immediatezza in contesto remoto, la latenza end-to-end della comunicazione deve essere comparabile.

Le reti 5G di quinta generazione promettono latenze di circa 1-4 millisecondi in condizioni ideali, grazie a architetture edge computing che processano dati vicino all'utente piuttosto che in datacenter centralizzati. Questa riduzione è fondamentale ma ancora insufficiente per applicazioni critiche come la telechirurgia, dove ritardi superiori a 10 millisecondi possono compromettere la sicurezza del paziente.

Il 6G, attualmente in fase di ricerca con deployment previsto intorno al 2030, punta a latenze sub-millisecondo attraverso frequenze terahertz, reti ottiche integrate e intelligenza artificiale distribuita per predire e compensare variazioni di latenza. Queste reti saranno caratterizzate da affidabilità estrema, con disponibilità del 99,9999 percento, requisito essenziale quando la connessione controlla azioni fisiche potenzialmente pericolose.

Dispositivi aptici: dalla vibrazione alla forza controllata

I dispositivi aptici traducono comandi digitali in sensazioni meccaniche percepibili dall'utente. La tecnologia aptica più semplice e diffusa è la vibrazione, utilizzata negli smartphone per notifiche tattili. Tuttavia, l'Internet tattile richiede feedback molto più sofisticati.

I dispositivi aptici avanzati si dividono in diverse categorie. Gli attuatori a forza di retroazione, o force feedback, oppongono resistenze variabili ai movimenti dell'utente, simulando la sensazione di toccare superfici di diversa rigidità. Guanti aptici con attuatori su ogni dito permettono di sentire la forma e la consistenza di oggetti virtuali o remoti.

Gli attuatori elettroattivi utilizzano materiali che cambiano forma quando attraversati da corrente elettrica. Polimeri elettroattivi, leghe a memoria di forma e ceramiche piezoelettriche possono contrarsi, espandersi o vibrare con precisione micrometrica, generando sensazioni tattili localizzate. Questi materiali permettono di costruire superfici aptiche flessibili che si adattano dinamicamente, simulando texture complesse.

Tecnologie emergenti includono ultrasuoni focalizzati che creano pressioni aeree percepibili sulla pelle senza contatto fisico, e stimolazione elettrotattile che attiva direttamente recettori nervosi cutanei con impulsi elettrici controllati. Quest'ultima tecnica, sebbene promettente, solleva questioni di sicurezza e richiede calibrazione personalizzata per ogni utente.

Applicazioni nella telechirurgia

La chirurgia robotica rappresenta l'applicazione più critica e trasformativa dell'Internet tattile. Sistemi come il Da Vinci Surgical System permettono già oggi a chirurghi di operare con precisione millimetrica attraverso robot controllati da console. Tuttavia, l'assenza di feedback tattile rappresenta una limitazione significativa.

Un chirurgo esperto valuta costantemente la resistenza dei tessuti durante incisioni e suture. Sentire se un tessuto è morbido o indurito aiuta a identificare anomalie patologiche. La tensione ottimale di un filo di sutura è percepita tattilmente. Senza questo feedback, i chirurghi devono affidarsi esclusivamente alla vista, aumentando il rischio di errori.

L'Internet tattile abiliterebbe telechirurgia completa, dove un chirurgo in un continente opera pazienti in un altro attraverso robot aptici bidirezionali. Il chirurgo indossa guanti sensorizzati che catturano ogni movimento e applicano forze corrispondenti a quelle che il robot remoto incontra nei tessuti. Questa capacità sarebbe rivoluzionaria per zone remote, campi di battaglia, stazioni spaziali o situazioni di emergenza sanitaria.

Progetti pilota hanno dimostrato la fattibilità tecnica. Nel 2001, l'operazione Lindbergh vide un chirurgo a New York operare una paziente a Strasburgo tramite robot, con latenza di 155 millisecondi. Sebbene riuscita, la latenza era al limite della sicurezza. Con 6G e haptics avanzati, tali operazioni diventerebbero routine, aprendo accesso a expertise chirurgica globale indipendentemente dalla geografia.

Manipolazione industriale e manutenzione remota

Oltre la medicina, l'Internet tattile trova applicazioni estensive nell'industria. Robot teleoperati apticamente permetterebbero manutenzioni in ambienti ostili: reattori nucleari, piattaforme petrolifere offshore, miniere profonde, o superficie di altri pianeti. L'operatore umano conserva capacità decisionale e adattabilità superiori ai robot autonomi, mentre è protetto fisicamente dalla distanza.

Nella manifattura di precisione, assemblaggio di componenti microelettronici o dispositivi medici richiede sensibilità tattile per applicare forze calibrate senza danneggiare parti fragili. Un operatore remoto con feedback aptico potrebbe svolgere queste mansioni da qualsiasi luogo, ottimizzando allocazione di manodopera specializzata e riducendo necessità di spostamenti fisici.

L'esplorazione spaziale beneficerebbe enormemente. Controllare rover marziani con feedback tattile permetterebbe geologi di sentire la consistenza di rocce, prelevare campioni con delicatezza appropriata, e manipolare strumenti complessi. Attualmente, i ritardi di comunicazione Terra-Marte, variabili tra 4 e 24 minuti, rendono impossibile controllo in tempo reale. Tuttavia, per Luna o satelliti terrestri, le latenze sono gestibili con tecnologie 6G.

Educazione e formazione esperienziale

L'insegnamento di abilità pratiche tradizionalmente richiede presenza fisica. Un maestro artigiano guida la mano dell'apprendista, correggendo pressione e angolazione. Un istruttore di musica mostra fisicamente la corretta postura. L'Internet tattile democratizzerebbe accesso a formazione di eccellenza indipendentemente dalla localizzazione geografica.

Studenti di medicina potrebbero esercitarsi in suture su tessuti simulati che riproducono fedelmente resistenze e texture reali, con supervisione aptica remota di chirurghi esperti che sentono le stesse forze e possono intervenire guidando i movimenti. Apprendisti meccanici potrebbero sentire la corretta coppia di serraggio di bulloni critici, sviluppando sensibilità calibrata.

Musei e istituzioni culturali potrebbero offrire esperienze tattili remote. Toccare virtualmente una scultura antica, sentirne la texture del marmo levigato, percepirebbe dettagli invisibili alla sola osservazione visiva. Per non vedenti, l'Internet tattile aprirebbe accesso a contenuti attualmente fruibili solo visivamente, riducendo barriere di accessibilità.

Sfide algoritmiche: stabilità e trasparenza

Trasmettere forze attraverso reti introduce problemi di controllo complessi. Se un operatore spinge un oggetto remoto e questo incontra resistenza, il feedback deve arrivare rapidamente per evitare che l'operatore applichi forza eccessiva. Ritardi variabili nella rete possono causare oscillazioni instabili, dove piccole forze si amplificano producendo vibrazioni pericolose.

I sistemi teleoperati aptici richiedono algoritmi di controllo bilaterale che garantiscano stabilità anche in presenza di latenze e packet loss. Tecniche come wave variables trasformano segnali di forza e velocità in onde matematiche che si propagano stabilmente attraverso ritardi. Architetture a quattro canali trasmettono ridondantemente posizione, velocità, forza e impedenza, permettendo ricostruzioni robuste.

L'obiettivo è la trasparenza: l'operatore non deve percepire la mediazione tecnologica, sentendo l'ambiente remoto come se fosse locale. Questo richiede compensazione adattativa di ritardi misurati in tempo reale, predizione del comportamento dell'ambiente remoto attraverso modelli fisici, e fusione sensoriale che integra haptics con vista e udito per coerenza multimodale.

Standardizzazione e interoperabilità

Affinché l'Internet tattile diventi realtà diffusa, sono necessari standard aperti che garantiscano interoperabilità tra dispositivi di produttori diversi. L'International Telecommunication Union ha istituito gruppi di lavoro dedicati, definendo requisiti per latenza, jitter, packet loss e sincronizzazione.

Protocolli di comunicazione specifici per dati aptici devono bilanciare throughput e latenza. A differenza del video che tollera buffering, l'haptics richiede trasmissione a bassa latenza di campioni ad alta frequenza, tipicamente 1000 Hz. Tecniche di compressione devono preservare informazioni percettivamente rilevanti eliminando ridondanze.

La sicurezza informatica assume importanza critica. Un attacco che compromette un sistema di telechirurgia potrebbe causare danni fisici al paziente. Protocolli crittografici devono proteggere integrità e autenticità dei comandi senza introdurre latenze aggiuntive. Certificazioni e validazioni rigorose saranno necessarie per applicazioni critiche in ambito medico e industriale.

Questioni etiche e sociali

L'Internet tattile solleva interrogativi etici inediti. La possibilità di toccare remotamente introduce nuove forme di interazione sociale con potenziale sia positivo che problematico. Relazioni affettive a distanza potrebbero beneficiare di abbracci aptici, riducendo isolamento di anziani o separazioni forzate. Tuttavia, emergono questioni di consenso e privacy corporea in spazi virtuali.

Nel lavoro remoto, la capacità di manipolare oggetti fisicamente espande drasticamente le professioni eseguibili da casa. Questo potrebbe ridurre disuguaglianze geografiche, ma anche accelerare delocalizzazione e precariato. Lavoratori specializzati potrebbero trovarsi in competizione globale, con pressioni salariali verso il basso.

L'accesso ineguale alle tecnologie aptiche avanzate rischia di creare nuove divisioni digitali. Se cure mediche eccellenti diventano disponibili telechirurgicamente ma solo a chi può permettersi connessioni 6G e dispositivi costosi, le disparità sanitarie potrebbero accentuarsi. Politiche di inclusione e infrastrutture pubbliche dovranno accompagnare lo sviluppo tecnologico.

L'Internet tattile rappresenta un'evoluzione comunicativa paragonabile all'introduzione del telefono o di Internet stesso. Trasmettere il tatto attraverso reti apre possibilità applicative trasformative in medicina, industria, educazione e vita quotidiana. Le sfide tecnologiche sono considerevoli ma affrontabili con convergenza di reti 6G, materiali aptici innovativi e algoritmi di controllo sofisticati. Il percorso verso questa visione richiederà ancora anni di ricContinua00:00erca, ma le fondamenta sono già in costruzione, promettendo un futuro in cui la distanza fisica non limiterà più l'interazione tattile umana.

Sistema di interfaccia aptica con guanti sensoriali per trasmissione tattile remota

L'Internet tattile promette di trasmettere sensazioni fisiche attraverso la rete, rivoluzionando telechirurgia, robotica remota e interazioni virtuali. Richiede reti a latenza inferiore al millisecondo e attuatori aptici di nuova generazione.LEGGI TUTTO L'ARTICOLO

Oltre la comunicazione audiovisiva

L'evoluzione di Internet ha progressivamente arricchito le modalità di comunicazione a distanza. Dalla sola trasmissione testuale degli albori, siamo passati a telefonia voip, videoconferenze ad alta definizione e realtà virtuale immersiva. Tuttavia, manca ancora un senso fondamentale nell'esperienza umana: il tatto.

L'Internet tattile, o Tactile Internet, rappresenta la prossima frontiera della telepresenza. L'obiettivo è trasmettere sensazioni tattili, forze, texture e temperature attraverso reti di comunicazione, permettendo interazioni fisiche remote indistinguibili da quelle locali. Le applicazioni spaziano dalla chirurgia robotica remota alla manutenzione industriale, dall'educazione esperienziale ai sistemi di sicurezza.

Questa visione richiede convergenza di tre tecnologie chiave: reti di comunicazione ultra-affidabili a latenza inferiore al millisecondo, dispositivi aptici capaci di riprodurre fedelmente sensazioni complesse, e algoritmi di controllo che garantiscano stabilità e sicurezza in presenza di ritardi variabili e possibili interruzioni di connessione.

La sfida della latenza nelle reti 5G e 6G

Il sistema nervoso umano percepisce ritardi tattili dell'ordine di 1-10 millisecondi. Quando interagiamo fisicamente con un oggetto, il feedback sensoriale raggiunge il cervello e comanda azioni correttive in tempi brevissimi. Per replicare questa immediatezza in contesto remoto, la latenza end-to-end della comunicazione deve essere comparabile.

Le reti 5G di quinta generazione promettono latenze di circa 1-4 millisecondi in condizioni ideali, grazie a architetture edge computing che processano dati vicino all'utente piuttosto che in datacenter centralizzati. Questa riduzione è fondamentale ma ancora insufficiente per applicazioni critiche come la telechirurgia, dove ritardi superiori a 10 millisecondi possono compromettere la sicurezza del paziente.

Il 6G, attualmente in fase di ricerca con deployment previsto intorno al 2030, punta a latenze sub-millisecondo attraverso frequenze terahertz, reti ottiche integrate e intelligenza artificiale distribuita per predire e compensare variazioni di latenza. Queste reti saranno caratterizzate da affidabilità estrema, con disponibilità del 99,9999 percento, requisito essenziale quando la connessione controlla azioni fisiche potenzialmente pericolose.

Dispositivi aptici: dalla vibrazione alla forza controllata

I dispositivi aptici traducono comandi digitali in sensazioni meccaniche percepibili dall'utente. La tecnologia aptica più semplice e diffusa è la vibrazione, utilizzata negli smartphone per notifiche tattili. Tuttavia, l'Internet tattile richiede feedback molto più sofisticati.

I dispositivi aptici avanzati si dividono in diverse categorie. Gli attuatori a forza di retroazione, o force feedback, oppongono resistenze variabili ai movimenti dell'utente, simulando la sensazione di toccare superfici di diversa rigidità. Guanti aptici con attuatori su ogni dito permettono di sentire la forma e la consistenza di oggetti virtuali o remoti.

Gli attuatori elettroattivi utilizzano materiali che cambiano forma quando attraversati da corrente elettrica. Polimeri elettroattivi, leghe a memoria di forma e ceramiche piezoelettriche possono contrarsi, espandersi o vibrare con precisione micrometrica, generando sensazioni tattili localizzate. Questi materiali permettono di costruire superfici aptiche flessibili che si adattano dinamicamente, simulando texture complesse.

Tecnologie emergenti includono ultrasuoni focalizzati che creano pressioni aeree percepibili sulla pelle senza contatto fisico, e stimolazione elettrotattile che attiva direttamente recettori nervosi cutanei con impulsi elettrici controllati. Quest'ultima tecnica, sebbene promettente, solleva questioni di sicurezza e richiede calibrazione personalizzata per ogni utente.

Applicazioni nella telechirurgia

La chirurgia robotica rappresenta l'applicazione più critica e trasformativa dell'Internet tattile. Sistemi come il Da Vinci Surgical System permettono già oggi a chirurghi di operare con precisione millimetrica attraverso robot controllati da console. Tuttavia, l'assenza di feedback tattile rappresenta una limitazione significativa.

Un chirurgo esperto valuta costantemente la resistenza dei tessuti durante incisioni e suture. Sentire se un tessuto è morbido o indurito aiuta a identificare anomalie patologiche. La tensione ottimale di un filo di sutura è percepita tattilmente. Senza questo feedback, i chirurghi devono affidarsi esclusivamente alla vista, aumentando il rischio di errori.

L'Internet tattile abiliterebbe telechirurgia completa, dove un chirurgo in un continente opera pazienti in un altro attraverso robot aptici bidirezionali. Il chirurgo indossa guanti sensorizzati che catturano ogni movimento e applicano forze corrispondenti a quelle che il robot remoto incontra nei tessuti. Questa capacità sarebbe rivoluzionaria per zone remote, campi di battaglia, stazioni spaziali o situazioni di emergenza sanitaria.

Progetti pilota hanno dimostrato la fattibilità tecnica. Nel 2001, l'operazione Lindbergh vide un chirurgo a New York operare una paziente a Strasburgo tramite robot, con latenza di 155 millisecondi. Sebbene riuscita, la latenza era al limite della sicurezza. Con 6G e haptics avanzati, tali operazioni diventerebbero routine, aprendo accesso a expertise chirurgica globale indipendentemente dalla geografia.

Manipolazione industriale e manutenzione remota

Oltre la medicina, l'Internet tattile trova applicazioni estensive nell'industria. Robot teleoperati apticamente permetterebbero manutenzioni in ambienti ostili: reattori nucleari, piattaforme petrolifere offshore, miniere profonde, o superficie di altri pianeti. L'operatore umano conserva capacità decisionale e adattabilità superiori ai robot autonomi, mentre è protetto fisicamente dalla distanza.

Nella manifattura di precisione, assemblaggio di componenti microelettronici o dispositivi medici richiede sensibilità tattile per applicare forze calibrate senza danneggiare parti fragili. Un operatore remoto con feedback aptico potrebbe svolgere queste mansioni da qualsiasi luogo, ottimizzando allocazione di manodopera specializzata e riducendo necessità di spostamenti fisici.

L'esplorazione spaziale beneficerebbe enormemente. Controllare rover marziani con feedback tattile permetterebbe geologi di sentire la consistenza di rocce, prelevare campioni con delicatezza appropriata, e manipolare strumenti complessi. Attualmente, i ritardi di comunicazione Terra-Marte, variabili tra 4 e 24 minuti, rendono impossibile controllo in tempo reale. Tuttavia, per Luna o satelliti terrestri, le latenze sono gestibili con tecnologie 6G.

Educazione e formazione esperienziale

L'insegnamento di abilità pratiche tradizionalmente richiede presenza fisica. Un maestro artigiano guida la mano dell'apprendista, correggendo pressione e angolazione. Un istruttore di musica mostra fisicamente la corretta postura. L'Internet tattile democratizzerebbe accesso a formazione di eccellenza indipendentemente dalla localizzazione geografica.

Studenti di medicina potrebbero esercitarsi in suture su tessuti simulati che riproducono fedelmente resistenze e texture reali, con supervisione aptica remota di chirurghi esperti che sentono le stesse forze e possono intervenire guidando i movimenti. Apprendisti meccanici potrebbero sentire la corretta coppia di serraggio di bulloni critici, sviluppando sensibilità calibrata.

Musei e istituzioni culturali potrebbero offrire esperienze tattili remote. Toccare virtualmente una scultura antica, sentirne la texture del marmo levigato, percepirebbe dettagli invisibili alla sola osservazione visiva. Per non vedenti, l'Internet tattile aprirebbe accesso a contenuti attualmente fruibili solo visivamente, riducendo barriere di accessibilità.

Sfide algoritmiche: stabilità e trasparenza

Trasmettere forze attraverso reti introduce problemi di controllo complessi. Se un operatore spinge un oggetto remoto e questo incontra resistenza, il feedback deve arrivare rapidamente per evitare che l'operatore applichi forza eccessiva. Ritardi variabili nella rete possono causare oscillazioni instabili, dove piccole forze si amplificano producendo vibrazioni pericolose.

I sistemi teleoperati aptici richiedono algoritmi di controllo bilaterale che garantiscano stabilità anche in presenza di latenze e packet loss. Tecniche come wave variables trasformano segnali di forza e velocità in onde matematiche che si propagano stabilmente attraverso ritardi. Architetture a quattro canali trasmettono ridondantemente posizione, velocità, forza e impedenza, permettendo ricostruzioni robuste.

L'obiettivo è la trasparenza: l'operatore non deve percepire la mediazione tecnologica, sentendo l'ambiente remoto come se fosse locale. Questo richiede compensazione adattativa di ritardi misurati in tempo reale, predizione del comportamento dell'ambiente remoto attraverso modelli fisici, e fusione sensoriale che integra haptics con vista e udito per coerenza multimodale.

Standardizzazione e interoperabilità

Affinché l'Internet tattile diventi realtà diffusa, sono necessari standard aperti che garantiscano interoperabilità tra dispositivi di produttori diversi. L'International Telecommunication Union ha istituito gruppi di lavoro dedicati, definendo requisiti per latenza, jitter, packet loss e sincronizzazione.

Protocolli di comunicazione specifici per dati aptici devono bilanciare throughput e latenza. A differenza del video che tollera buffering, l'haptics richiede trasmissione a bassa latenza di campioni ad alta frequenza, tipicamente 1000 Hz. Tecniche di compressione devono preservare informazioni percettivamente rilevanti eliminando ridondanze.

La sicurezza informatica assume importanza critica. Un attacco che compromette un sistema di telechirurgia potrebbe causare danni fisici al paziente. Protocolli crittografici devono proteggere integrità e autenticità dei comandi senza introdurre latenze aggiuntive. Certificazioni e validazioni rigorose saranno necessarie per applicazioni critiche in ambito medico e industriale.

Questioni etiche e sociali

L'Internet tattile solleva interrogativi etici inediti. La possibilità di toccare remotamente introduce nuove forme di interazione sociale con potenziale sia positivo che problematico. Relazioni affettive a distanza potrebbero beneficiare di abbracci aptici, riducendo isolamento di anziani o separazioni forzate. Tuttavia, emergono questioni di consenso e privacy corporea in spazi virtuali.

Nel lavoro remoto, la capacità di manipolare oggetti fisicamente espande drasticamente le professioni eseguibili da casa. Questo potrebbe ridurre disuguaglianze geografiche, ma anche accelerare delocalizzazione e precariato. Lavoratori specializzati potrebbero trovarsi in competizione globale, con pressioni salariali verso il basso.

L'accesso ineguale alle tecnologie aptiche avanzate rischia di creare nuove divisioni digitali. Se cure mediche eccellenti diventano disponibili telechirurgicamente ma solo a chi può permettersi connessioni 6G e dispositivi costosi, le disparità sanitarie potrebbero accentuarsi. Politiche di inclusione e infrastrutture pubbliche dovranno accompagnare lo sviluppo tecnologico.

L'Internet tattile rappresenta un'evoluzione comunicativa paragonabile all'introduzione del telefono o di Internet stesso. Trasmettere il tatto attraverso reti apre possibilità applicative trasformative in medicina, industria, educazione e vita quotidiana. Le sfide tecnologiche sono considerevoli ma affrontabili con convergenza di reti 6G, materiali aptici innovativi e algoritmi di controllo sofisticati. Il percorso verso questa visione richiederà ancora anni di ricContinua00:00erca, ma le fondamenta sono già in costruzione, promettendo un futuro in cui la distanza fisica non limiterà più l'interazione tattile umana.

Di Alex (pubblicato @ 11:00:00 in Hardware PC, letto 51 volte)

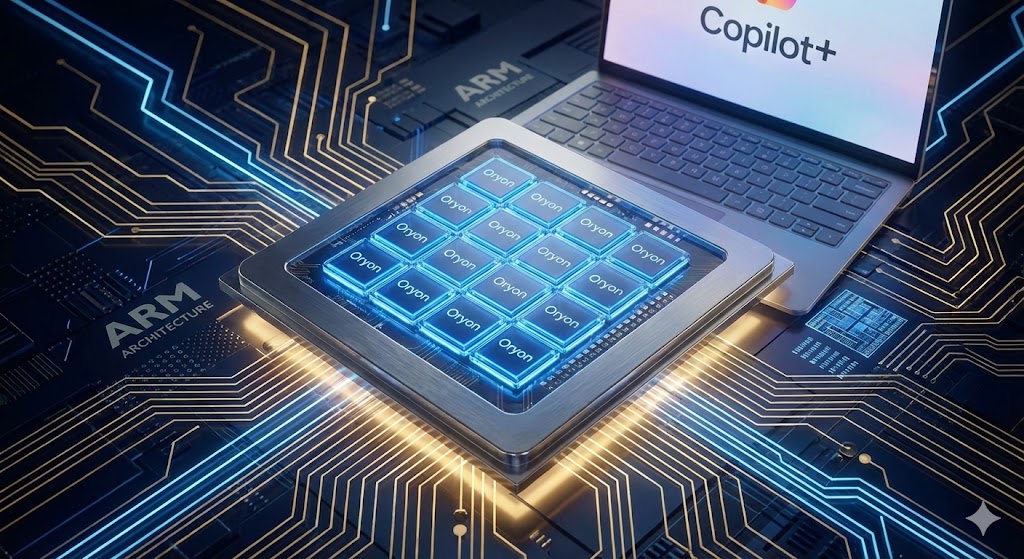

Snapdragon X Elite: la rivoluzione ARM nei PC Windows

L'arrivo dei processori Snapdragon X Elite con architettura Oryon di Qualcomm rappresenta una svolta epocale nel panorama dei PC Windows. Dopo anni di tentativi, Qualcomm è finalmente riuscita a portare l'efficienza energetica e le prestazioni dell'architettura ARM in un ecosistema dominato da Intel e AMD, creando una nuova categoria di dispositivi: i Copilot+ PC. LEGGI TUTTO L'ARTICOLO

🎧 Ascolta questo articolo

L'architettura Oryon: il cuore della rivoluzione

I processori Snapdragon X Elite utilizzano core CPU Oryon custom sviluppati internamente da Qualcomm, basati sull'architettura ARM ma completamente riprogettati. A differenza delle precedenti soluzioni Snapdragon per PC che utilizzavano core standard ARM Cortex, i core Oryon sono frutto dell'acquisizione di Nuvia nel 2021, startup fondata da ex ingegneri Apple che avevano lavorato sui chip M-series.

Tecnologia e specifiche

Le caratteristiche principali includono:

Varianti disponibili

Qualcomm ha lanciato diverse SKU dello Snapdragon X Elite:

Successivamente è stato introdotto anche lo Snapdragon X Plus, una variante più accessibile con 10 core Oryon e NPU da 45 TOPS, pensata per dispositivi di fascia media.

Dispositivi disponibili (Fine 2024 - Inizio 2025)

Tra i laptop premium troviamo:

Tra i dispositivi 2-in-1 e convertibili figurano il Microsoft Surface Pro 11, tablet/laptop ibrido con kickstand iconico, penna Surface Pen e tastiera Type Cover opzionale, e il Lenovo ThinkPad X13s Gen 2, aggiornamento del primo ThinkPad ARM con Snapdragon X Elite.

Prestazioni: il confronto con x86

Le prestazioni degli Snapdragon X Elite si sono rivelate sorprendentemente competitive. Nei benchmark single-core (Geekbench 6 intorno a 2500-2700 punti), i risultati si avvicinano o eguagliano processori Intel Core Ultra 7 e AMD Ryzen 7 della generazione attuale. Nel multi-core, i 12 core Oryon mostrano prestazioni solide (14000-15000 punti), anche se non sempre superiori ai rivali x86 con core count simile.

Le prestazioni gaming sono limitate rispetto ai chip x86 con GPU dedicate, ma l'Adreno GPU gestisce bene giochi leggeri e titoli ottimizzati. L'emulazione x86-64 introduce overhead che penalizza i giochi non nativi ARM.

L'efficienza energetica: il vero punto di forza

Dove gli Snapdragon X Elite brillano davvero è nell'efficienza energetica. Test indipendenti hanno confermato autonomie reali di 15-20 ore in utilizzo misto, con picchi superiori in scenari di produttività leggera. La capacità di mantenere prestazioni elevate senza ventole o con raffreddamento passivo apre nuove possibilità di design. Il consumo in idle è estremamente ridotto, permettendo standby prolungato senza perdita significativa di batteria.

Software: la sfida della compatibilità

Windows 11 su ARM utilizza Prism, l'emulatore successore di Windows 11 che traduce le istruzioni x86 e x86-64 in ARM64 al volo. Le applicazioni native ARM64 (Office, Chrome, Edge, Firefox, Spotify, VLC, Zoom) funzionano alla massima efficienza, mentre quelle emulate subiscono un penalty prestazionale variabile. Non tutte le applicazioni funzionano perfettamente: driver specifici e giochi con anti-cheat invasivi possono presentare problemi.

Funzionalità Copilot+ PC

La certificazione richiede almeno 40 TOPS di potenza AI e sblocca funzionalità esclusive come Recall (ricerche semantiche nell'attività passata), Cocreator in Paint (generazione immagini AI), Live Captions con traduzione in tempo reale e Studio Effects per videochiamate avanzate.

Roadmap 2025-2026

Qualcomm ha annunciato che nuove generazioni arriveranno nel 2025-2026. Ci si aspetta uno Snapdragon X Elite Gen 2 con miglioramenti prestazionali del 15-20%, efficienza superiore e NPU da 60+ TOPS. Sono attesi nuovi dispositivi come Workstation ARM, Gaming laptops e Mini PC.

Conclusioni

Gli Snapdragon X Elite rappresentano il tentativo più credibile finora di portare ARM nel mainstream dei PC Windows. Le prestazioni sono competitive, l'autonomia eccezionale, le funzionalità AI all'avanguardia. Il 2025-2026 sarà cruciale: con miglioramenti hardware della seconda generazione, espansione dell'ecosistema software e maturazione dell'emulazione, i PC ARM Windows potrebbero passare da nicchia interessante a alternativa mainstream. La rivoluzione ARM nei PC Windows è iniziata, e Snapdragon X Elite ne è il catalizzatore.

Processore Snapdragon X Elite e architettura Oryon

L'arrivo dei processori Snapdragon X Elite con architettura Oryon di Qualcomm rappresenta una svolta epocale nel panorama dei PC Windows. Dopo anni di tentativi, Qualcomm è finalmente riuscita a portare l'efficienza energetica e le prestazioni dell'architettura ARM in un ecosistema dominato da Intel e AMD, creando una nuova categoria di dispositivi: i Copilot+ PC. LEGGI TUTTO L'ARTICOLO

L'architettura Oryon: il cuore della rivoluzione

I processori Snapdragon X Elite utilizzano core CPU Oryon custom sviluppati internamente da Qualcomm, basati sull'architettura ARM ma completamente riprogettati. A differenza delle precedenti soluzioni Snapdragon per PC che utilizzavano core standard ARM Cortex, i core Oryon sono frutto dell'acquisizione di Nuvia nel 2021, startup fondata da ex ingegneri Apple che avevano lavorato sui chip M-series.

Tecnologia e specifiche

Le caratteristiche principali includono:

- CPU: Fino a 12 core Oryon ad alte prestazioni, con frequenze che raggiungono i 3.8-4.0 GHz nelle varianti top di gamma. A differenza dell'approccio big.LITTLE tradizionale, tutti i core sono ad alte prestazioni, con alcuni core che possono operare a frequenze leggermente superiori.

- GPU: Adreno integrata con supporto DirectX 12 Ultimate, ray tracing hardware e prestazioni dichiarate fino a 4.6 TFLOPS, posizionandosi competitivamente rispetto alle soluzioni integrate di Intel e AMD.

- NPU (Neural Processing Unit): Questo è forse l'elemento più distintivo. La NPU integrata offre fino a 45 TOPS (trilioni di operazioni al secondo), superando di gran lunga Intel Core Ultra (circa 10 TOPS) e AMD Ryzen AI (fino a 16 TOPS nella serie 300). Questa potenza di calcolo AI è essenziale per la certificazione Copilot+ PC di Microsoft.

- Processo produttivo: Realizzati con processo a 4nm, garantiscono efficienza energetica superiore rispetto ai chip x86 a 7nm o 5nm.

Varianti disponibili

Qualcomm ha lanciato diverse SKU dello Snapdragon X Elite:

- X1E-84-100: La versione flagship con 12 core, frequenza dual-core boost fino a 4.0 GHz, GPU a 4.6 TFLOPS

- X1E-80-100: 12 core con frequenza leggermente inferiore (3.8 GHz dual-core boost)

- X1E-78-100: Versione a 12 core ottimizzata per l'efficienza

Successivamente è stato introdotto anche lo Snapdragon X Plus, una variante più accessibile con 10 core Oryon e NPU da 45 TOPS, pensata per dispositivi di fascia media.

Dispositivi disponibili (Fine 2024 - Inizio 2025)

Tra i laptop premium troviamo:

- Microsoft Surface Laptop 7 (13.8" e 15"): Il dispositivo di riferimento Microsoft, completamente riprogettato con design sottile, display PixelSense touchscreen, autonomia dichiarata fino a 20 ore e integrazione profonda con Windows 11 e le funzionalità Copilot+.

- Dell XPS 13 (9345): La celebre linea XPS abbraccia ARM con un design ultrasottile da 1.19 kg, display InfinityEdge e fino a 27 ore di autonomia dichiarata.

- Lenovo Yoga Slim 7x: Convertibile premium da 14.5" con display OLED 3K, peso contenuto (1.28 kg) e autonomia fino a 24 ore, pensato per creativi e professionisti.

- HP OmniBook X: Disponibile nelle versioni da 14" e 16", con focus su produttività aziendale, sicurezza avanzata e connettività 5G opzionale.

- Samsung Galaxy Book4 Edge: Nelle varianti da 14" e 16", con display AMOLED Dynamic 2X e integrazione con l'ecosistema Galaxy.

- Asus Vivobook S 15: Soluzione più accessibile con display OLED 3K, certificazione Copilot+ PC e autonomia dichiarata di 18 ore.