\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 24/02/2026

Di Alex (pubblicato @ 17:00:00 in Impero Romano, letto 47 volte)

La Grande Vasca delle terme romane di Bath, Aquae Sulis, Britannia

A Bath, nel Somerset, una sorgente termale a 46°C alimentava il complesso termale più imponente della Britannia romana, dedicato alla dea Sulis Minerva. Un prodigio di ingegneria idraulica, con grandi volte a botte in mattoni e un tempio integrato nel cuore pulsante di una straordinaria città d'acqua. LEGGI TUTTO L'ARTICOLO

L'ingegneria idraulica delle sorgenti calde

Le sorgenti di Bath producono circa 1,17 milioni di litri d'acqua al giorno a una temperatura costante di 46°C, affiorando attraverso faglie geologiche profonde. I Romani sfruttarono questa risorsa con precisione straordinaria, incanalando il flusso attraverso condotte in piombo verso le vasche principali. Il sistema prevedeva chiuse e valvole per regolare pressione e livello dell'acqua, garantendo un afflusso controllato anche nelle stagioni di massima affluenza.

La gestione termica era altrettanto sofisticata: le acque venivano distribuite in bacini a temperature differenziate frigidarium, tepidarium e calidarium attraverso una rete idraulica estesa per diversi isolati urbani. Le tubature in piombo ritrovate intatte recavano iscrizioni di collaudo imperiale, testimonianza di un sistema di controllo qualità ante litteram.

Le grandi volte a botte: copertura monumentale delle piscine

La copertura della Grande Vasca rappresenta uno dei problemi ingegneristici più affascinanti del sito. Le analisi archeologiche hanno confermato che la piscina era coperta da una gigantesca volta a botte in mattoni cotti, con un'altezza stimata tra 30 e 40 metri. Questa soluzione costruttiva richiedeva la padronanza delle tecniche di centinatura in legno e della posa di conci cuneiformi in laterizio.

I mattoni romani impiegati erano prodotti localmente con dimensioni standardizzate, a conferma di una filiera produttiva organizzata su scala militare. I pilastri portanti in blocchi di pietra calcarea locale erano dimensionati per sopportare il carico laterale della volta senza contrafforti esterni, una scelta che richiedeva calcoli statici di notevole accuratezza per l'epoca.

Il tempio di Sulis Minerva e la città d'acqua

Il complesso di Aquae Sulis era molto più di un impianto balneare: era una città sacra organizzata attorno alla sorgente divina. Il tempio di Sulis Minerva, divinità sincretica nata dalla fusione della dea celtica Sulis con la romana Minerva, sorgeva su un podio a quattro colonne corinzie con frontone scolpito. Il celebre clipeo con la Gorgone, oggi al museo locale, decorava il timpano ed è un unicum dell'arte romano-britannica.

Il recinto sacro del tempio era connesso fisicamente al complesso termale tramite un cortile porticato, creando un continuum tra sfera religiosa e balneare tipicamente romano. Migliaia di monete e tavolette di maledizione in piombo gettate nella sorgente recuperate negli scavi ottocenteschi hanno rivelato informazioni preziose sulla vita sociale e religiosa di Aquae Sulis.

Aquae Sulis sopravvisse alla fine dell'occupazione romana nel quinto secolo dopo Cristo, trasformandosi lentamente nei secoli. Oggi Bath è Patrimonio dell'Umanità UNESCO e le sue terme romane rappresentano il complesso balneare meglio conservato al di fuori del Mediterraneo: un monumento perenne all'ingegno che unì la forza dell'acqua alla visione di un impero.

Di Alex (pubblicato @ 16:00:00 in Capolavori dell'Antichità, letto 48 volte)

La Vimana del tempio Brihadisvara di Thanjavur, alta 66 metri, capolavoro Chola

A Thanjavur, in India, il tempio Brihadisvara della dinastia Chola si erge con una Vimana di 66 metri. Il mistero centrale riguarda il suo coronamento: come fu sollevato il blocco di granito da 80 tonnellate sulla sommità? Un capolavoro che sfida ancora oggi la comprensione dell'ingegneria antica. LEGGI TUTTO L'ARTICOLO

La dinastia Chola e il tempio come manifesto del potere

Il tempio Brihadisvara noto anche come Peruvudaiyar Kovil fu costruito per volere del re Rajaraja I tra il 1003 e il 1010 dopo Cristo, nel momento di massima espansione della dinastia Chola nel subcontinente indiano. Il tempio era concepito non solo come luogo di culto shivaita, ma come dichiarazione architettonica del potere imperiale: la sua Vimana (torre-santuario) avrebbe dovuto essere la struttura più alta dell'India meridionale, visibile per decine di chilometri nella pianura alluvionale del Tamil Nadu.

La costruzione richiese l'organizzazione di un cantiere su scala straordinaria per l'epoca: migliaia di scalpellini, artisti, muratori e ingegneri lavorarono per oltre un decennio. Il granito utilizzato circa 130.000 tonnellate secondo le stime degli studiosi proveniva da cave situate a decine di chilometri di distanza, il che implica un sistema logistico di trasporto su strade o corsi d'acqua di enorme complessità. Le iscrizioni su pietra che decorano il basamento del tempio documentano i nomi dei donatori, i villaggi tributari e i devadasi (danzatrici sacre) assegnati al servizio cultuale, restituendoci un quadro vivido dell'organizzazione socioeconomica della corte Chola.

La Vimana cava: struttura e ingegneria della torre

La Vimana del Brihadisvara è una struttura piramidale a 13 livelli digradanti, alta 66 metri, internamente cava per ridurre il carico strutturale sulle fondamenta. L'analisi delle sezioni murarie ha rivelato che gli ingegneri Chola impiegarono un sistema di muri portanti concentrici in granito con riempimenti in laterizio nelle cavità interne, una tecnica che distribuiva il peso verticale in modo efficiente lungo l'asse della torre.

Ogni livello della Vimana è decorato con sculture di divinità, guardiani e scene mitologiche scolpite direttamente nel granito con una precisione che testimonia una tradizione artigianale di straordinaria raffinatezza. Il coronamento della torre la shikara ottagonale ospita un unico blocco monolitico di granito (la kalasha) che pesa circa 80 tonnellate, con una larghezza superiore alla sezione del livello immediatamente sottostante. Questo fatto geometrico esclude la possibilità che il blocco sia stato calato dall'alto: deve essere stato sollevato dall'esterno.

Il mistero del blocco monolitico: la rampa degli elefanti

La teoria più accreditata tra gli storici dell'ingegneria è quella della rampa di terra inclinata, che si stima avrebbe dovuto avere una lunghezza di circa 6 chilometri per permettere il trasporto del blocco da 80 tonnellate con una pendenza sufficientemente dolce da essere percorribile dagli elefanti da soma. Una rampa di queste dimensioni avrebbe richiesto una quantità di terra paragonabile al volume del tempio stesso, il che solleva domande sulla logistica della costruzione e sulla gestione del cantiere nelle ultime fasi dell'opera.

Alcune ipotesi alternative suggeriscono l'uso di sistemi di leva e contrappeso basati su travi di legno incastrate nelle scanalature laterali della torre, con team di operai coordinati che alzavano il blocco un centimetro alla volta. Non esistono documentazioni scritte del processo costruttivo specifico, e questa lacuna ha alimentato per secoli ipotesi alternative alcune delle quali fantasiose sul presunto utilizzo di tecnologie perdute. La risposta più onesta della scienza moderna è che gli ingegneri Chola erano capaci di imprese straordinarie utilizzando strumenti ordinari, e che la chiave era l'organizzazione del lavoro umano su scala che noi fatichiamo a immaginare.

Il Brihadisvara di Thanjavur iscritto tra i Grandi Templi Viventi dei Chola nel Patrimonio dell'Umanità UNESCO dal 1987 è ancora oggi un luogo di culto attivo, visitato ogni giorno da migliaia di fedeli. La sua torre millenaria, costruita senza cemento né ferro, sfida il tempo come sfidò l'ingegno dei suoi costruttori: un monumento alla capacità umana di trasformare la pietra in cielo.

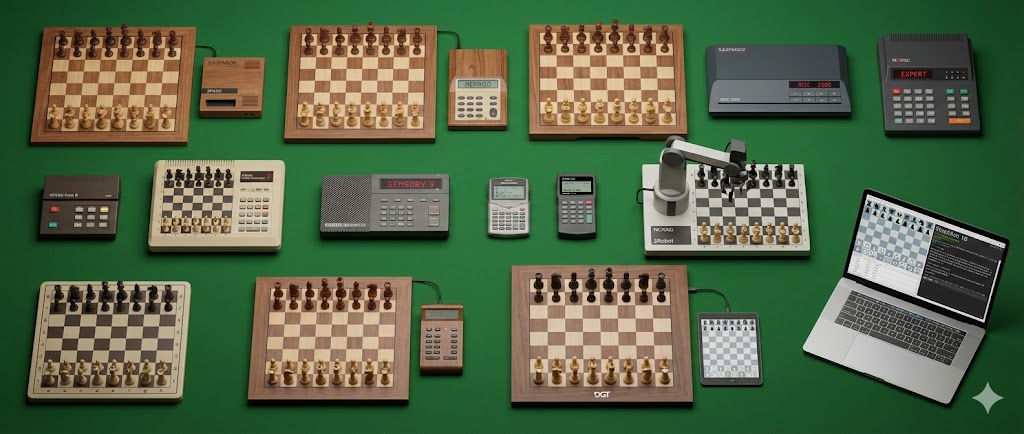

Di Alex (pubblicato @ 15:00:00 in Intelligenza Artificiale e scacchi, letto 51 volte)

Selezione storica di scacchiere elettroniche degli anni Ottanta: Mephisto, Fidelity, Novag

Dagli anni Settanta a oggi, scacchiere elettroniche e software di scacchi hanno trasformato il gioco più antico del mondo. Da Fidelity a Mephisto, da Kasparov-Saitek a Stockfish: un viaggio nella storia delle macchine pensanti che hanno prima sfidato, poi definitivamente battuto, la mente umana. LEGGI TUTTO L'ARTICOLO

Gli anni Settanta: le prime scacchiere commerciali

Il 1977 segna l'anno di nascita del mercato delle scacchiere elettroniche consumer con il lancio del Fidelity Chess Challenger da parte di Sidney Samole. Si trattava di un apparecchio con microprocessore a 8 bit capace di giocare a livello principiante, venduto nei grandi magazzini americani come giocattolo sofisticato. Nonostante la forza di gioco modesta pochi minuti di analisi e il programma perdeva contro qualunque giocatore con esperienza il successo commerciale fu enorme, aprendo un mercato che negli anni successivi avrebbe visto centinaia di modelli.

In quegli stessi anni, il gruppo di ricercatori guidato da Dan Spracklen e Kathe Spracklen sviluppò Sargon, uno dei primi programmi di scacchi completi per personal computer. Sargon vinse il primo North American Computer Chess Championship nel 1978, stabilendo un punto di riferimento per l'industria. L'architettura alpha-beta un algoritmo di potatura dell'albero di ricerca che eliminava i rami di mossa chiaramente inferiori divenne il fondamento su cui tutti i successivi programmi avrebbero costruito la propria forza.

Gli anni Ottanta: Fidelity, Mephisto e Novag

Il decennio degli anni Ottanta vide la proliferazione di brand specializzati. Fidelity Electronics dominò il mercato americano con una gamma che andava dai modelli base ai sofisticati Elite, capaci di raggiungere un rating ELO intorno ai 2000 punti. I modelli Elite A/S e Elite Avant Garde, con processori dedicati e memorie di apertura ampie, furono i preferiti dei giocatori esperti che cercavano un avversario sempre disponibile.

In Europa, Mephisto brand della tedesca Hegener & Glaser portò l'ingegneria scacchistica a un livello superiore grazie alla collaborazione con i programmatori Richard Lang (autore del motore Psion/Lang) e Johan de Koning. I modelli Mephisto Roma e Amsterdam vinsero ripetutamente il Campionato del Mondo di Computer Chess, stabilendo record di forza di gioco per hardware dedicato. Novag, con sede a Hong Kong, completava il trio dei grandi marchi con prodotti robusti e affidabili come il Constellation e il Super Expert, che introdussero la connettività per espandere le memorie di apertura tramite moduli cartuccia.

Gli anni Novanta: Kasparov-Saitek, TASC e DGT

Nei primi anni Novanta, la fusione tra marketing e tecnologia scacchistica portò alla collaborazione tra Garry Kasparov allora campione del mondo in carica e Saitek. La linea Kasparov Chessmate e i successivi modelli GK series utilizzavano il nome del campione per garantire al pubblico la qualità dei programmi. I modelli Kasparov GK 2100 e Maestro divennero oggetti di culto per i giocatori dell'epoca.

TASC introdusse una novità radicale con il sistema R30 e il successivo R40: moduli intercambiabili con motori di gioco distinti tra cui il celebre Gideon di Johan de Koning che permettevano di aggiornare la forza del gioco senza acquistare una nuova scacchiera. DGT (Digital Game Technology) rivoluzionò il mercato professionale con le scacchiere sensorizzate che permettevano la registrazione automatica delle mosse e la trasmissione in tempo reale delle partite ai siti di scacchi online, diventando lo standard ufficiale per i tornei mondiali FIDE.

L'era digitale: Stockfish, motori open source e scacchiere connesse

Con l'esplosione dei personal computer negli anni Duemila, il software di scacchi si emancipò dall'hardware dedicato. Fritz, Rybka, Houdini e poi Stockfish motore open source nato nel 2008 e continuamente sviluppato da una comunità globale raggiunsero e poi superarono la forza di qualunque giocatore umano. Stockfish è oggi considerato uno dei programmi più forti mai creati, con un rating ELO stimato superiore a 3500 punti, più di 800 punti al di sopra del miglior giocatore umano.

I derivativi di Stockfish come Leela Chess Zero (basato su reti neurali) e Komodo Dragon hanno introdotto approcci diversi al calcolo scacchistico, avvicinandosi all'intuizione umana attraverso l'apprendimento per rinforzo. Le scacchiere connesse a internet, come quelle di DGT e Millennium, permettono oggi di giocare online contro avversari umani o motori, con rilevamento automatico delle mosse e interfacce integrate con Lichess e Chess.com. Le scacchiere auto-moventi, con pezzi magnetici spostati da un braccio robotico o da magneti sotto il piano di gioco, completano la parabola tecnologica iniziata con il Fidelity Chess Challenger del 1977.

La storia delle scacchiere elettroniche e dei programmi di scacchi è la storia in miniatura di cinquant'anni di rivoluzione informatica: dalla prima logica binaria nei circuiti discreti alla rete neurale profonda che impara giocando contro sé stessa. Gli scacchi si sono rivelati il banco di prova ideale per ogni generazione di intelligenza artificiale, e la macchina ha vinto. Ma il fascino del gioco tra umani non è mai stato così vivo.

Di Alex (pubblicato @ 14:00:00 in Scienza e Tecnologia, letto 70 volte)

Interfaccia cervello-computer con stimolazione ippocampale per il ripristino della memoria

Ripristinare i ricordi perduti con impulsi elettrici mirati all'ippocampo non è fantascienza, ma una frontiera concreta della neurotecnologia. Le interfacce cervello-computer di nuova generazione aprono prospettive rivoluzionarie nella riabilitazione cognitiva e nella lotta contro le prime fasi delle malattie neurodegenerative. LEGGI TUTTO L'ARTICOLO

L'ippocampo e il consolidamento della memoria

L'ippocampo è la struttura cerebrale cruciale per la formazione di nuovi ricordi dichiarativi episodici e semantici e per la loro trasformazione in memoria a lungo termine, un processo chiamato consolidamento. Durante questo processo, le informazioni codificate nella corteccia durante la veglia vengono riattivate durante il sonno a onde lente e durante le oscillazioni theta tipiche dell'esplorazione attiva, creando connessioni sinaptiche stabili tra aree corticali distribuite.

Le patologie che colpiscono l'ippocampo precocemente come i primi stadi del morbo di Alzheimer o le conseguenze di ictus o traumi cranici interrompono questo processo con effetti devastanti sulla capacità di formare nuovi ricordi. I pazienti conservano i ricordi formatisi prima della lesione (memoria remota) ma perdono la capacità di memorizzare nuove esperienze (amnesia anterograda). È precisamente questa funzione che le protesi di memoria tentano di ripristinare.

Come funziona una protesi di memoria: il modello MIMO

Il gruppo di ricerca guidato da Theodore Berger alla University of Southern California ha sviluppato il modello computazionale fondante delle protesi di memoria: il sistema MIMO (Multiple-Input Multiple-Output). L'approccio consiste nel registrare il pattern di attività neuronale nell'ippocampo durante la codifica di un'informazione (input), calcolare in tempo reale la trasformazione che l'ippocampo sano applicherebbe a quel pattern per generare la forma finale del ricordo (output), e poi stimolare elettricamente la regione ippocampale appropriata con il pattern di output calcolato, bypassando il tessuto leso.

I risultati sperimentali su roditori e primati non umani hanno mostrato incrementi nella ritenzione di compiti mnemonici del 35-40% rispetto ai controlli senza stimolazione. In studi clinici preliminari su pazienti umani con danni ippocampali, la stimolazione basata sul modello MIMO ha migliorato la performance in test di memoria dichiarativa in modo statisticamente significativo, con effetti mantenuti per ore dopo la fine della sessione di stimolazione.

Applicazioni nelle malattie neurodegenerative precoci

Nella fase prodromica del morbo di Alzheimer il periodo che precede i sintomi clinici manifesti l'ippocampo mostra già riduzione volumetrica e alterazioni della connettività funzionale misurabili con fMRI. Intervenire in questa finestra temporale con stimolazione ippocampale coordinata potrebbe rallentare la progressione del deficit mnemonico, offrendo anni di vita cognitiva normale ai pazienti.

Le sfide tecniche rimangono considerevoli: la miniaturizzazione degli elettrodi impiantabili, la durata delle batterie nei dispositivi cronici, la biocompatibilità a lungo termine degli impianti e soprattutto la personalizzazione del modello computazionale per ogni paziente, dato che i pattern ippocampali variano significativamente tra individui. La ricerca attuale si muove anche verso approcci non invasivi, come la stimolazione transcranica con ultrasuoni focalizzati (tFUS), che permetterebbe di modulare l'attività ippocampale senza intervento chirurgico.

Le protesi di memoria rappresentano uno dei fronti più affascinanti e delicati della neurotecnologia contemporanea. Restituire a una persona la capacità di ricordare equivale a restituirle una parte essenziale della propria identità. La strada è ancora lunga, ma le basi scientifiche sono solide e i progressi degli ultimi anni suggeriscono che quella che sembrava fantascienza potrebbe diventare realtà clinica entro il prossimo decennio.

Di Alex (pubblicato @ 13:00:00 in Nuove Tecnologie, letto 74 volte)

Architettura quantistica IBM Starling con array di qubit logici a tolleranza di errore

IBM Starling segna il superamento definitivo dell'era NISQ: con 10.000 qubit logici tolleranti agli errori, l'informatica quantistica entra in una nuova fase. I surface codes garantiscono affidabilità senza precedenti, aprendo la strada alla simulazione molecolare complessa in tempo reale e al calcolo ad alta complessità. LEGGI TUTTO L'ARTICOLO

Il superamento dell'era NISQ: cosa cambia con Starling

Per oltre un decennio, l'informatica quantistica è rimasta prigioniera di un paradosso: i qubit fisici sono estremamente sensibili al rumore ambientale vibrazioni termiche, campi elettromagnetici, radiazioni cosmiche e ogni calcolo superiore a pochi nanosecondi genera errori che si accumulano fino a rendere inutile il risultato. Questo era il regno dell'era NISQ (Noisy Intermediate-Scale Quantum), in cui i processori quantistici erano abbastanza grandi da essere interessanti, ma troppo rumorosi per risolvere problemi reali che i computer classici non potessero già affrontare.

IBM Starling rompe questo limite con un'architettura fondata su qubit logici anziché fisici. Un qubit logico è un'astrazione costruita a partire da molti qubit fisici nel caso di Starling, circa 1000 fisici per ogni logico organizzati in modo tale che gli errori vengano rilevati e corretti in tempo reale, senza collassare la sovrapposizione quantistica. Il risultato è un processore con 10.000 qubit logici stabili, capaci di eseguire circuiti quantistici di profondità prima impossibile.

I surface codes: il meccanismo della correzione degli errori

La tecnologia chiave di IBM Starling è il surface code, un protocollo di correzione degli errori quantistici in cui i qubit fisici sono disposti su una griglia bidimensionale. I qubit centrali della griglia memorizzano l'informazione quantistica, mentre i qubit ai bordi eseguono misurazioni di parità continue i cosiddetti syndrome measurements che rilevano la presenza di errori senza misurare direttamente lo stato quantistico dei qubit dati, preservando così la coerenza.

Quando un syndrome measurement rivela un'anomalia, gli algoritmi di decodifica tipicamente varianti del minimum-weight perfect matching identificano la posizione e il tipo di errore e applicano correzioni software che neutralizzano l'effetto del rumore fisico. La soglia di errore del surface code (circa 1% per operazione fisica) è stata finalmente raggiunta e superata dai qubit superconduttori di IBM, rendendo la correzione attiva degli errori non solo teoricamente possibile, ma praticamente efficiente.

Implicazioni per la simulazione molecolare complessa

La prima applicazione trasformativa di un sistema come IBM Starling riguarda la simulazione di sistemi molecolari complessi: processi che coinvolgono interazioni quantistiche tra elettroni come la catalisi enzimatica, la fotosintesi o le reazioni di fissazione dell'azoto sono intrinsecamente quantistici e impossibili da simulare con precisione su hardware classico per molecole di dimensioni biologiche rilevanti.

Con 10.000 qubit logici stabili, diventa possibile simulare in tempo reale la dinamica elettronica di proteine complesse, identificare nuovi catalizzatori per la sintesi farmaceutica, ottimizzare materiali per batterie di nuova generazione e simulare meccanismi di resistenza batterica agli antibiotici. Questi scenari non sono più speculativi: IBM ha già dimostrato simulazioni preliminari di piccole molecole su sistemi precursori di Starling, con risultati paragonabili ai metodi di chimica computazionale più accurati.

IBM Starling non è semplicemente un computer più grande: è un cambio di paradigma. L'era della computazione quantistica affidabile è iniziata, e le sue conseguenze per la farmacologia, la scienza dei materiali, la crittografia e l'intelligenza artificiale si dispiegheranno nei prossimi decenni con una velocità che ancora non riusciamo a prevedere completamente. Il futuro del calcolo ha smesso di essere rumoroso.

Di Alex (pubblicato @ 12:00:00 in Patrimonio mondiale UNESCO, letto 59 volte)

Torre motore di una miniera di stagno della Cornovaglia con panorama costiero atlantico

Tra le coste aspre della Cornovaglia e del Devon occidentale, le rovine delle miniere di rame e stagno raccontano la nascita dell'industria moderna. Questo sito UNESCO celebra l'ingegno dei beam engines, macchine a vapore capaci di drenare gallerie scavate sotto il livello del mare. LEGGI TUTTO L'ARTICOLO

Un paesaggio industriale che racconta la rivoluzione

Il sito UNESCO "Paesaggio Minerario della Cornovaglia e del Devon Occidentale", iscritto nel 2006, comprende dieci zone distinte distribuite tra le due contee inglesi, che insieme documentano il ciclo completo dell'industria mineraria del rame e dello stagno dal Settecento all'Ottocento. Non si tratta soltanto di resti industriali: il sito include anche i villaggi operai, le cappelle metodiste, i porti minerari, i canali di trasporto e le strade costruite per sostenere un'industria che nel momento di massima espansione impiegava decine di migliaia di lavoratori.

La Cornovaglia estraeva stagno già in epoca preistorica le sue miniere avevano rifornito l'Età del Bronzo mediterranea ma fu la domanda di rame e stagno della Rivoluzione Industriale a trasformare radicalmente il paesaggio. Tra il 1740 e il 1850, la regione divenne la principale produttrice mondiale di rame, con miniere che scendevano a profondità mai raggiunte in precedenza, fino a 600 metri sotto il livello del suolo e parecchi metri sotto quello del mare.

I beam engines: la tecnologia che rese possibile il sottosuolo

Il problema fondamentale delle miniere profonde era l'acqua: le gallerie si riempivano continuamente di infiltrazioni che rendevano impossibile il lavoro. La soluzione arrivò con il motore a vapore a trave (beam engine), sviluppato da Thomas Newcomen all'inizio del Settecento e perfezionato da James Watt negli anni Settanta e Ottanta del Settecento stesso. Il meccanismo centrale era una grande trave basculante lunga fino a 10 metri e pesante decine di tonnellate azionata dal vapore su un lato che tirava su un pistone pompa sull'altro.

I beam engines della Cornovaglia raggiunsero un livello di efficienza superiore a quello delle versioni Watt grazie alle innovazioni di Richard Trevithick, che introdusse l'uso del vapore ad alta pressione. Le cosiddette Cornish engines operavano con pressioni di vapore più elevate e con cicli di espansione più lunghi, che permettevano di estrarre più lavoro da ogni chilogrammo di carbone bruciato. Questa efficienza era cruciale: il carbone doveva essere importato dal Galles via mare, rendendo il costo del combustibile una variabile determinante nella competitività economica delle miniere.

Le case motore: architettura di un'era industriale

Le case motore che ospitavano i beam engines sono diventate il simbolo iconico del paesaggio cornish: torri cilindriche in granito locale con una cappella superiore che ospitava il meccanismo della trave. La loro forma non era casuale: la struttura cilindrica distribuiva il carico del pesantissimo macchinario in modo uniforme sulle fondamenta, mentre lo spessore delle pareti in granito fino a un metro garantiva la resistenza alle vibrazioni continue del funzionamento.

Molte di queste torri sono oggi i soli resti visibili delle miniere, avendo resistito per secoli al clima atlantico grazie alla qualità eccezionale del granito cornish e alla cura costruttiva dei loro edificatori. Il sito UNESCO comprende esempi ben conservati come le miniere di Botallack, con le sue case motore aggrappate alle scogliere sul mare, e il distretto di Redruth-Camborne, cuore tecnologico della rivoluzione mineraria britannica.

Il paesaggio minerario della Cornovaglia e del Devon occidentale è un memoriale industriale di rara potenza evocativa. Le torri in granito che punteggiano le scogliere atlantiche raccontano l'ingegno, la fatica e la tragedia di generazioni di minatori che trasformarono l'estrazione del metallo da attività artigianale in industria globale, contribuendo in modo decisivo alla rivoluzione tecnologica che cambiò per sempre il mondo moderno.

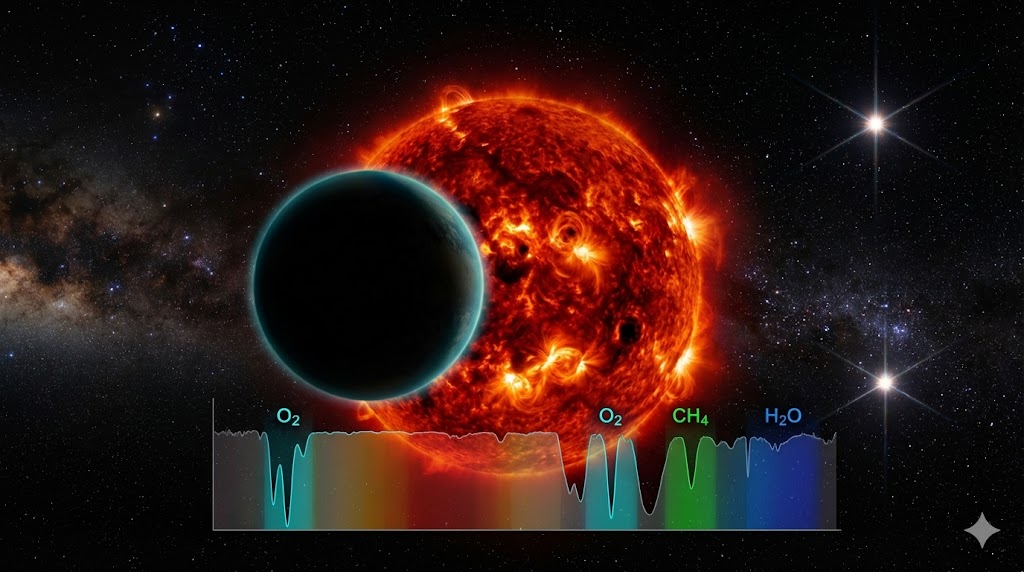

Di Alex (pubblicato @ 11:00:00 in Scienza & Spazio, letto 68 volte)

Spettro atmosferico di un esopianeta orbitante attorno a una nana rossa analizzato dal JWST

Il James Webb Space Telescope sta rivoluzionando la ricerca di vita extraterrestre: attraverso la spettroscopia di transito, analizza le atmosfere di esopianeti in orbita attorno a nane rosse cercando biosegnature chimiche come ossigeno, metano e clorofilla in atmosfere lontane anni luce dalla Terra. LEGGI TUTTO L'ARTICOLO

La spettroscopia di transito: leggere l'atmosfera di un mondo lontano

Quando un esopianeta transita davanti alla propria stella passando tra essa e il telescopio la luce stellare filtra attraverso l'atmosfera planetaria. Ogni molecola atmosferica assorbe lunghezze d'onda specifiche della luce infrarossa, producendo un pattern di assorbimento caratteristico che si traduce in una "impronta digitale" chimica rilevabile dallo spettrografo del James Webb Space Telescope (JWST). Questo metodo, chiamato spettroscopia di trasmissione, permette di identificare la composizione chimica dell'atmosfera senza visitare fisicamente il pianeta.

Il JWST ha rivoluzionato questa tecnica grazie alla sua posizione nel punto di Lagrange L2 (1,5 milioni di km dalla Terra), alla sua superficie specchiante di 6,5 metri di diametro e agli strumenti NIRSpec e MIRI ottimizzati per l'infrarosso medio e vicino la regione dello spettro in cui le molecole biologicamente rilevanti producono le loro segnature più forti. Con decine di ore di osservazione su un singolo sistema, il JWST può accumulare segnali atmosferici sufficienti per rilevare concentrazioni molecolari di parti per milione.

Le biosegnature chimiche: cosa cerchiamo e perché

Le biosegnature atmosferiche sono composti chimici la cui presenza in concentrazioni significative è difficilmente spiegabile con soli processi geologici, suggerendo quindi un'origine biologica. L'ossigeno molecolare (O2) è la biosegnatura più intuitiva: la fotosintesi ossigenica è il principale processo che ne produce in quantità significative su scala planetaria. Tuttavia, meccanismi abiotici come la fotolisi dell'acqua possono generare ossigeno anche senza vita, rendendo necessario considerare l'ossigeno sempre in combinazione con altri marcatori.

Il metano (CH4) in presenza di ossigeno costituisce una biosegnatura di grande rilevanza: le due molecole reagiscono chimicamente in tempi geologicamente brevi, quindi la loro coesistenza richiede una sorgente continua e biologicamente plausibile. La presenza di vapore acqueo, biossido di carbonio e ozono completa il quadro delle atmosfere potenzialmente abitabili. Il cosiddetto red-edge un brusco aumento della riflettanza intorno a 700 nanometri causato dalla clorofilla è considerato la biosegnatura vegetale per eccellenza, rilevabile in linea di principio anche su pianeti distanti.

Le sfide delle nane rosse: attività stellare e erosione atmosferica

Le nane rosse (stelle di tipo M) sono i bersagli preferiti per la ricerca di biosegnature perché la loro zona abitabile è molto vicina alla stella rendendo i transiti frequenti e il segnale atmosferico più forte e perché le nane rosse sono le stelle più comuni della galassia. Tuttavia, presentano sfide specifiche che complicano l'interpretazione dei dati spettroscopici.

Le nane rosse giovani sono molto attive e producono potenti brillamenti ultravioletti e raggi X che possono erodere le atmosfere dei pianeti in orbita ravvicinata, soprattutto se questi pianeti sono privi di un campo magnetico protettivo. Inoltre, i pianeti nella zona abitabile delle nane rosse sono probabilmente in rotazione sincrona (la stessa faccia sempre rivolta alla stella), creando gradienti termici estremi tra il lato diurno e notturno che complicano la modellistica climatica. Il JWST deve quindi interpretare ogni segnale atmosferico tenendo conto di questa complessità prima di trarre conclusioni sulla possibilità di vita.

La ricerca di biosegnature atmosferiche è ancora agli inizi, ma il JWST ha già dimostrato capacità tecniche superiori alle previsioni più ottimistiche. Nei prossimi anni, l'analisi sistematica di decine di pianeti in zona abitabile attorno a nane rosse vicine come TRAPPIST-1e e Proxima Centauri b ci darà la prima risposta statistica alla domanda più antica dell'umanità: siamo soli nell'universo?

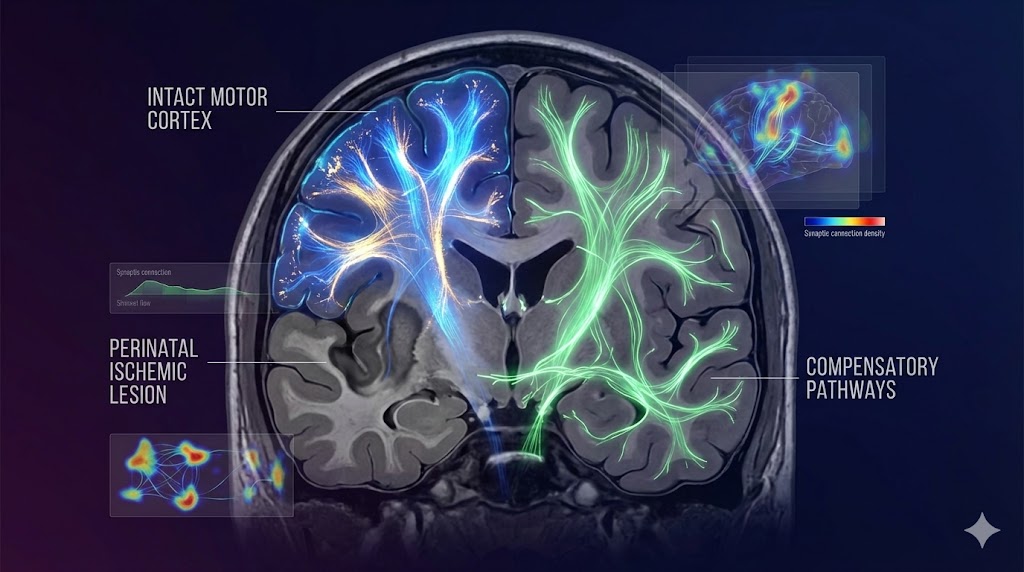

Di Alex (pubblicato @ 10:00:00 in Scienza e Tecnologia, letto 66 volte)

Mappa corticale della riorganizzazione neuronale in adulti con lesione cerebrale perinatale

Quando una lesione ischemica colpisce il cervello nelle prime settimane di vita, si attivano meccanismi di riorganizzazione corticale straordinari. Ma cosa accade a questi circuiti compensatori quando il paziente raggiunge la sesta decade? La neuroscienza indaga le sfide crescenti del cervello perinatale leso che invecchia. LEGGI TUTTO L'ARTICOLO

Riorganizzazione corticale precoce: i meccanismi della plasticità

Il cervello neonatale possiede una capacità plastica senza eguali nel corso della vita. In seguito a una lesione ischemica perinatale come la leucomalacia periventricolare o l'infarto arterioso le aree corticali adiacenti alla zona lesa attivano processi di sprouting assonale e potenziamento sinaptico che permettono la riallocazione funzionale. Nei soggetti con lesioni emisferiche unilaterali, studi di neuroimaging funzionale hanno documentato il trasferimento parziale o totale delle funzioni motorie e linguistiche verso l'emisfero controlaterale integro.

Questi meccanismi si fondano su tre processi principali: la sinaptogenesi compensatoria nei circuiti vicini alla lesione, la mielinizzazione accelerata dei tratti corticospinali residui e la riduzione della competizione interemisferica grazie alla diminuita inibizione transcallosa. Il risultato clinico è spesso sorprendente: bambini con infarti emisferici estesi sviluppano capacità motorie e cognitive apparentemente integrate, grazie all'eccezionale finestra plastica dei primi anni di vita.

I circuiti motori compensatori e il loro funzionamento adulto

Nei soggetti adulti con paralisi cerebrale di origine perinatale, le tecniche di stimolazione magnetica transcranica (TMS) e la risonanza magnetica funzionale (fMRI) hanno permesso di cartografare i circuiti motori ristrutturati. In molti casi, l'area motoria primaria ipsilesionale risulta ipertrofica, con una rappresentazione somatotopica espansa degli arti controlaterali. I fasci corticospinali ipsilaterali normalmente soppressi dopo i primi mesi di vita mostrano in questi soggetti una persistenza anomala e funzionalmente attiva.

Tuttavia, questi circuiti compensatori hanno caratteristiche biomeccaniche diverse da quelli tipicamente sviluppati: la velocità di conduzione è inferiore, la sincronizzazione neurale è meno precisa e il reclutamento muscolare risulta meno selettivo. Queste differenze, clinicamente marginali in età giovane-adulta, diventano significative quando il sistema nervoso entra nella fase di invecchiamento fisiologico, con la progressiva riduzione della densità sinaptica e della velocità di conduzione nervosa.

Le sfide della sesta decade: deterioramento neuro-muscolare

Quando i soggetti con lesione cerebrale perinatale raggiungono i 50-60 anni, si osserva frequentemente un fenomeno definito deterioramento funzionale tardivo: la comparsa o l'aggravamento di deficit motori, spasticità, dolore cronico e affaticamento che erano assenti o stabili nei decenni precedenti. Questo fenomeno non è causato da una nuova lesione, ma dall'esaurimento progressivo dei circuiti compensatori, che erano stati mantenuti attivi a costo di un maggiore dispendio energetico neuronale.

La ricerca attuale si concentra su tre fronti: la caratterizzazione longitudinale del profilo di deterioramento attraverso bio-marcatori di neuroimmagine, l'identificazione di finestre terapeutiche per interventi riabilitativi intensivi prima del declino, e lo sviluppo di protocolli di neurostimolazione non invasiva per rallentare la perdita sinaptica nei circuiti compensatori. Il ruolo dell'infiammazione cronica di basso grado amplificata dall'invecchiamento emerge come fattore critico nel determinare la velocità del deterioramento.

La comprensione delle basi neurofisiologiche del cervello perinatale leso che invecchia rappresenta una delle sfide più urgenti della neuroriabilitazione contemporanea. Migliaia di adulti con paralisi cerebrale raggiungono oggi decenni di vita prima impossibili, rendendo indispensabile una medicina neurologica capace di accompagnarli attraverso l'invecchiamento con strumenti diagnostici e terapeutici finalmente adeguati alla complessità del loro sistema nervoso.

Di Alex (pubblicato @ 09:00:00 in Sci-Fi e Rigore Scientifico, letto 70 volte)

Simulazione di assenza di gravità a bordo della capsula Apollo 13 nel film di Ron Howard

Apollo 13 di Ron Howard (1995) è considerato un caso unico di rigore tecnico nel cinema hollywoodiano. Procedure NASA ricostruite con precisione millimetrica e gravità zero simulata con voli parabolici reali hanno ridefinito il concetto di fantascienza della realtà nell'immaginario collettivo sull'esplorazione spaziale. LEGGI TUTTO L'ARTICOLO

La produzione e la collaborazione con la NASA

Ron Howard ottenne dalla NASA un accesso senza precedenti agli archivi tecnici, alle trascrizioni delle comunicazioni terra-bordo e alle registrazioni audiovisive originali della missione dell'aprile 1970. Il team di sceneggiatori lavorò per mesi con ex ingegneri del Mission Control di Houston e con i tre astronauti sopravvissuti Jim Lovell, Jack Swigert e Fred Haise per ricostruire ogni singola procedura con fedeltà documentaria.

Gli strumenti di controllo della capsula Odyssey e del modulo lunare Aquarius presenti sul set erano repliche fisiche costruite con le specifiche tecniche originali, non semplici scenografie. Gli attori Tom Hanks, Kevin Bacon e Bill Paxton seguirono settimane di addestramento tecnico per maneggiare i pannelli di controllo con la stessa competenza procedurale degli astronauti. La NASA certificò pubblicamente la fedeltà tecnica del film, cosa estremamente rara nella storia del cinema spaziale hollywoodiano.

I voli parabolici: simulare la microgravità senza effetti speciali digitali

La scelta più radicale e costosa di tutta la produzione fu quella di simulare l'assenza di gravità non attraverso effetti digitali o fili di sospensione, ma con voli parabolici reali a bordo del KC-135 della NASA il cosiddetto "Vomit Comet". L'aereo eseguiva parabole ripide che permettevano circa 25 secondi di microgravità autentica per ogni manovra. Con oltre 600 parabole effettuate durante le riprese, il team di produzione accumulò circa quattro ore totali di vera assenza di gravità, sufficiente per girare tutte le sequenze ambientate nella capsula spaziale.

Questa scelta tecnica aveva conseguenze pratiche complesse: ogni take durava 25 secondi al massimo, richiedendo una coreografia millimetrica degli attori, del direttore della fotografia Dean Semler e dell'intera troupe stipata nell'aereo. Il regista dirigeva in condizioni di microgravità autentica, galleggiando insieme agli attori mentre impartiva istruzioni. Il risultato sullo schermo è inconfondibile: il movimento dei liquidi, la caduta degli oggetti e la postura degli attori hanno una naturalezza che nessuna tecnica di post-produzione dell'epoca avrebbe potuto replicare.

La fantascienza della realtà e il suo impatto culturale

Il termine "fantascienza della realtà" identifica un filone cinematografico in cui la tensione drammatica non proviene da elementi inventati ma dalla ricostruzione fedele di eventi storici straordinari. Apollo 13 ne è il caso paradigmatico: la storia è nota (l'equipaggio torna a casa), eppure il film mantiene un'intensità drammatica eccezionale grazie alla ricostruzione tecnica meticolosa e alla performance degli attori.

L'impatto culturale del film sulla percezione pubblica dell'esplorazione spaziale fu significativo e documentato. Sondaggi condotti dopo l'uscita nelle sale rilevarono un aumento sostanziale dell'interesse per il programma Apollo tra le generazioni che non l'avevano vissuto in diretta. Il film contribuì a riportare l'attenzione pubblica sulle missioni lunari proprio mentre la NASA stava sviluppando i piani per un eventuale ritorno alla Luna. La frase pronunciata da Lovell erroneamente attribuita alla realtà storica ma inventata dalla sceneggiatura divenne una citazione culturale permanente nell'immaginario anglosassone.

Apollo 13 rimane, a trent'anni dalla sua uscita, il termine di paragone assoluto per il cinema scientifico rigoroso. La sua lezione principale è che la fedeltà tecnica non è un ostacolo alla narrazione drammatica, ma il suo fondamento più solido: quando il pubblico percepisce che quello che vede è reale, l'emozione si moltiplica. Howard lo capì prima di chiunque altro, e il risultato è un film che resiste al tempo come resisté la capsula Odyssey al vuoto dello spazio.

Di Alex (pubblicato @ 08:00:00 in Mitologia e Cinema, letto 80 volte)

Scena stilizzata del film 300 (2007) con guerrieri spartani in ambiente digitale

Nel 2007, Zack Snyder trasformò la graphic novel di Frank Miller in un'opera visiva senza precedenti. La tecnica del crush cromatico, l'ambiente totalmente green screen e l'iconografia quasi sacrale di Leonida come Cristo guerriero ridefinirono l'estetica del cinema epico, con Persiani trasfigurati in mostri digitali per espliciti fini propagandistici. LEGGI TUTTO L'ARTICOLO

Dal fumetto alla pellicola: la fedeltà espressionista

La graphic novel 300 di Frank Miller (1998) non si proponeva come ricostruzione storica della battaglia delle Termopili, ma come mito visivo puro: chiaroscuri esasperati, figure monumentali, sangue rosso su sfondi quasi monocromatici. Snyder ne comprese la natura e scelse di non tradurre il fumetto in cinema realistico, ma di tradurre il cinema nella grammatica del fumetto stesso. Ogni inquadratura del film fu composta come una tavola da disegnare: corpi in posa scultorea, cieli innaturali, ombre geometriche.

La produzione si svolse quasi interamente in studio, con attori che recitavano davanti a fondali grigi o blu destinati alla sostituzione digitale. Il background visivo di ogni scena fu costruito ex novo dai team di effetti speciali, che riprodussero le asperità rocciose delle Termopili in forma di paesaggio onirico piuttosto che geografico. Il risultato fu un mondo chiuso, autoreferenziale, con una logica interna coerente che rifiutava esplicitamente il realismo storico.

La tecnica del crush e i rossi saturi: estetica della violenza

Il look cromatico di 300 si basava su una post-produzione estrema nota come color crush: le luci venivano compresse sulle alte luci, le ombre spinte verso il nero puro, e il rosso del sangue e dei mantelli spartani lasciato deliberatamente saturo come unico colore caldo in un mondo desaturato. Questo contrasto cromatico aveva una funzione narrativa precisa: orientare immediatamente lo sguardo dello spettatore verso gli elementi di violenza e identità visiva.

La fotografia di Larry Fong lavorò in sintonia con la post-produzione, usando luci quasi teatrali per scolpire i corpi degli attori in maniera frontale. I guerrieri spartani tutti con addomi definiti da mesi di training fisico intensivo erano ripresi dal basso per esaltarne la monumentalità. La luce dura eliminava le mezzetinte, creando figure che sembravano uscire direttamente da un affresco o da un bassorilievo classico.

Leonida come Cristo guerriero: iconografia e propaganda

La rappresentazione di Leonida (Gerard Butler) segue con precisione una iconografia cristologica: il re spartano è spesso inquadrato con le braccia aperte in posizione cruciforme, circondato da una luce che sembra emanare dal suo corpo. I suoi discorsi ai guerrieri prima della battaglia richiamano la struttura omiletica del sermone, non il pragmatismo militare greco. Questa sacralizzazione del guerriero-re serviva a costruire un modello di sacrificio eroico riconoscibile per un pubblico occidentale contemporaneo.

Sul versante opposto, i Persiani vengono sistematicamente deformati in mostri digitali: Serse è un essere androgino e sovrumano coperto di piercing, i suoi generali sono freak fisici, i suoi soldati sono creature ibride. Questa deformazione deliberata ha fatto molto discutere: numerosi studiosi hanno letto il film come una metafora post-11 settembre della contrapposizione Occidente-Oriente, con connotazioni propagandistiche esplicite che la narrazione non cerca di nascondere.

300 rimane un caso studio fondamentale nell'analisi del cinema come strumento mitopoietico. Al di là del dibattito sulla sua correttezza storica che non era mai negli intenti di Miller né di Snyder il film ha ridefinito i confini tra fumetto e cinema live-action, dimostrando che l'estetica espressionista può diventare un linguaggio cinematografico autonomo e globalmente riconoscibile.

Fotografie del 24/02/2026

Nessuna fotografia trovata.

Think different!

Think different!

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3

(p)Link

(p)Link Commenti

Commenti Storico

Storico Stampa

Stampa