\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 16/05/2026

Di Alex (pubblicato @ 17:00:00 in Software e Sicurezza, letto 34 volte)

Interfaccia di Wireshark che mostra pacchetti malevoli evidenziati in rosso, con un occhio che si rifrange in pixel di codice.

Nel dominio delle reti telematiche, la visibilità assoluta è l'illusione prediletta dai sistemisti. Wireshark, lo sniffer open-source per l'analisi dei protocolli, opera commutando le interfacce di rete in "promiscuous mode", catturando l'intero traffico di transito. Ma lo strumento di analisi nasconde una contraddizione fatale: per dissezionare un pacchetto ostile, deve prima eseguirlo parzialmente. LEGGI TUTTO L'ARTICOLO

Bonus Video

L'architettura tecnica di Wireshark

Wireshark rappresenta lo strumento principe per l'analisi dei protocolli di rete, uno sniffer open-source che ha rivoluzionato il modo in cui gli amministratori di rete e i professionisti della sicurezza informatica diagnosticano problemi, analizzano il traffico e conducono indagini forensi. Il suo funzionamento si basa sulla capacità di commutare le interfacce di rete in una modalità operativa speciale chiamata "promiscuous mode", una configurazione che obbliga il sistema operativo a catturare e consegnare all'applicazione non solo i pacchetti destinati alla specifica macchina, ma l'intero traffico di transito visibile sul segmento di rete. In una rete Ethernet tradizionale basata su hub, questa modalità permette di intercettare tutte le comunicazioni tra tutti i dispositivi collegati, mentre in reti switched più moderne richiede tecniche aggiuntive come il port mirroring o gli ARP spoofing per reindirizzare il traffico verso l'interfaccia di analisi. Una volta catturato il flusso crudo di dati, Wireshark procede alla sua dissezione, decodificando i pacchetti binari strato dopo strato attraverso centinaia di parser specializzati chiamati "dissectors". Ogni dissector è un modulo software dedicato a un protocollo specifico, dall'HTTP/2 al SMBv3, dal TLS al DNS, fino ai codec audio-video come iLBC e le famiglie dei protocolli VoIP. Il dissector analizza la struttura binaria del pacchetto, estrae i campi significativi, li converte in rappresentazioni leggibili dall'uomo e costruisce una struttura gerarchica che riflette l'incapsulamento dei protocolli, dallo strato fisico fino al livello applicativo. L'approccio a dissectors modulari ha permesso a Wireshark di supportare centinaia di protocolli diversi, rendendolo lo strumento più completo e versatile per l'analisi di rete, utilizzato da milioni di professionisti in tutto il mondo. La capacità di Wireshark di decodificare in tempo reale il traffico di rete, di filtrare i pacchetti in base a criteri complessi, di ricostruire flussi TCP, di estrarre file trasferiti e di visualizzare statistiche dettagliate lo ha reso indispensabile per l'analisi forense di malware, per l'identificazione di pacchetti malformati potenzialmente pericolosi, e per la rilevazione di comunicazioni Command and Control tra malware e server di comando remoto. Nelle mani di un analista esperto, Wireshark offre una finestra senza precedenti sul traffico di rete, permettendo di vedere nel dettaglio quali dati stanno transitando, da dove provengono, dove sono diretti, e quali protocolli vengono utilizzati.

Le vulnerabilità intrinseche del linguaggio C

L'ispezione spassionata dell'architettura di Wireshark rivela però una contraddizione fatale alla base della sua stessa esistenza, una vulnerabilità sistemica che deriva dalle scelte di implementazione effettuate per garantire le prestazioni necessarie all'analisi di grandi volumi di traffico. Per garantire prestazioni eccellenti nel processare gigabit di traffico al secondo, Wireshark è scritto massicciamente in ANSI C, un linguaggio di programmazione scelto per la sua efficienza e il suo basso overhead, che permette un controllo fine della memoria e delle risorse di sistema. Questo linguaggio, a differenza di Java o C, è intrinsecamente privo di protezioni automatiche contro la corruzione della memoria, come il garbage collection automatico che libera la memoria non più utilizzata, o i controlli automatici sui limiti degli array che impediscono l'accesso a posizioni di memoria non autorizzate. La gestione della memoria in ANSI C è interamente demandata al programmatore, che deve allocare esplicitamente la memoria necessaria, verificare che le operazioni di copia non superino i limiti degli array, e liberare la memoria quando non è più necessaria. Questo controllo granulare permette prestazioni eccellenti, ma espone il software a una classe di vulnerabilità ben note e particolarmente insidiose: i buffer overflow, in cui un attaccante può scrivere dati oltre i limiti di un array sovrascrivendo aree di memoria adiacenti; i double free, in cui la stessa area di memoria viene liberata due volte causando corruzione delle strutture di gestione della memoria; i use-after-free, in cui si accede a memoria già liberata; e i dangling pointers, in cui un puntatore continua a fare riferimento a un'area di memoria non più valida. Queste vulnerabilità, note collettivamente come "memory corruption bugs", sono la causa principale delle falle di sicurezza nei software scritti in linguaggi senza gestione automatica della memoria. Nel caso di Wireshark, il problema è ulteriormente aggravato dalla modalità di esecuzione in promiscuous mode, che espone il software all'intero traffico di rete, compresi pacchetti potenzialmente malevoli costruiti appositamente per sfruttare vulnerabilità nei dissectors. Un attaccante con sufficiente conoscenza della struttura interna di Wireshark può confezionare pacchetti malformati che, quando processati dal dissector corrispondente, innescano una delle vulnerabilità di corruzione della memoria, causando un crash dell'applicazione o, nei casi più gravi, consentendo l'esecuzione di codice arbitrario sulla macchina dell'analista.

Il paradosso dell'osservatore nelle vulnerabilità CVE

Il paradosso fondamentale di Wireshark si palesa in tutta la sua drammatica evidenza quando il dissector è costretto ad assorbire l'oggetto ostile che dovrebbe esaminare, in una versione digitale del problema dell'osservatore in meccanica quantistica applicato alla sicurezza informatica. Per decodificare un pacchetto potenzialmente malevolo, per analizzarne la struttura, per determinarne la pericolosità, Wireshark deve inevitabilmente processarlo, eseguendo parzialmente il codice del dissector sull'input fornito dall'attaccante. Questo requisito funzionale trasforma lo strumento di analisi da scudo protettivo a vettore d'attacco principale, poiché la stessa operazione di ispezione può attivare la vulnerabilità che si sta cercando di identificare. L'analista che utilizza Wireshark per studiare un traffico sospetto si trova nella paradossale situazione di dover aprire il vaso di Pandora per vedere cosa c'è dentro, con il rischio che l'apertura stessa liberi il male che intendeva combattere. Un esempio emblematico e ben documentato di questa fragilità strutturale è la vulnerabilità identificata con il codice CVE-2026-5657, un difetto di tipo "Double Free" situato nel dissector del codec iLBC, utilizzato per la compressione audio nelle comunicazioni Voice over IP e in applicazioni di messaggistica istantanea. La vulnerabilità affligge tutte le versioni di Wireshark dalla 4.4.0 alla 4.6.4, un arco temporale di diversi anni durante i quali milioni di analisti hanno potenzialmente esposto i propri sistemi a questa falla. Un avversario esperto, dotato di conoscenze tecniche adeguate, può confezionare deliberatamente un pacchetto iLBC corrotto, costruito con cura per sfruttare la specifica vulnerabilità del double free, e iniettarlo nella rete che l'analista sta monitorando. Quando l'analista, inconsapevole della minaccia, apre il file di cattura che contiene il pacchetto malevolo o semplicemente monitora il traffico live sulla propria interfaccia di rete, Wireshark tenta la dissezione del pacchetto, incontrando la struttura corrotta e innescando un collasso dell'allocazione di memoria. Il risultato è un fatale arresto anomalo dell'applicazione, un Denial of Service che interrompe l'analisi e può causare la perdita di dati non salvati. In scenari più gravi, vulnerabilità di questo tipo possono consentire l'esecuzione di codice arbitrario, permettendo all'attaccante di prendere il controllo della macchina dell'analista, installare backdoor, rubare dati sensibili o utilizzare il sistema come trampolino per attacchi successivi. L'inganno è totale: il meccanismo di allerta viene sfruttato per assassinare l'osservatore, e lo strumento progettato per proteggere la rete diventa il cavallo di Troia che la compromette. I professionisti della sicurezza informatica tendono a considerare lo sniffer come un pannello di vetro trasparente dietro cui osservare i leoni della rete, dimenticando che in informatica l'atto stesso dell'osservazione esige l'esecuzione parziale del predatore, con tutti i rischi che questa esposizione comporta.

Mantenere permessi di root o esecutivi mentre un software intrinsecamente fragile mastica dati malevoli equivale a spalancare la porta della cittadella per ispezionare le lame del nemico, confidando che l'ispezione non trasformi la lama in una freccia avvelenata. Il paradosso di Wireshark è il paradosso di ogni strumento di analisi che deve eseguire per comprendere: un limite epistemologico della sicurezza informatica, destinato a rimanere irrisolto finché i linguaggi di programmazione sicuri non raggiungeranno le prestazioni dei loro antenati insicuri.

Di Alex (pubblicato @ 16:00:00 in Storia degli scienziati, letto 49 volte)

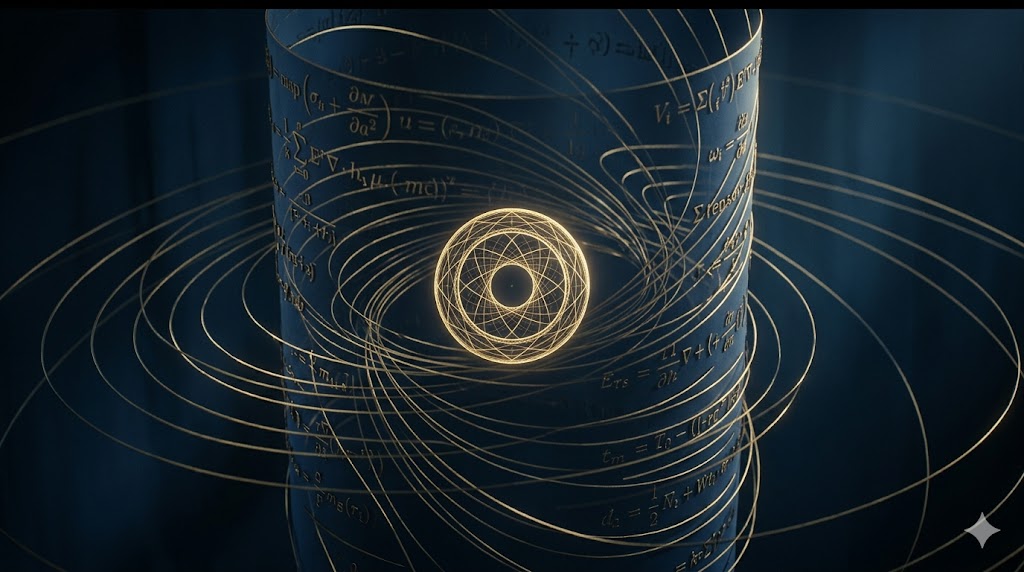

Rappresentazione astratta della quinta dimensione arrotolata su se stessa, con tensori geometrici e linee di campo elettromagnetico che si avvolgono attorno a un cilindro matematico.

Osservando l'architettura dell'universo con la necessaria freddezza geometrica, si nota come il desiderio umano di simmetria spesso conduca a forzature strutturali invisibili. Nel 1919, il matematico tedesco Theodor Kaluza propose ad Albert Einstein un'ipotesi che appariva come un trionfo dell'intelletto puro: l'estensione della relatività generale da quattro a cinque dimensioni spaziotemporali. Un'illusione di unificazione perfetta destinata a scontrarsi con la realtà matematica. LEGGI TUTTO L'ARTICOLO

Bonus Video

L'architettura formale della quinta dimensione

Il risultato formale della proposta di Kaluza era ineccepibile dal punto di vista puramente matematico. Inserendo un tensore metrico a cinque dimensioni, le equazioni di campo si scomponevano chirurgicamente in tre componenti distinte: le familiari equazioni gravitazionali di Einstein, le equazioni elettromagnetiche di Maxwell e una terza equazione per un campo scalare. L'unificazione perfetta tra gravità ed elettromagnetismo sembrava finalmente raggiunta, offrendo una visione sintetica delle forze fondamentali che per secoli erano state considerate separate e incomunicabili. Questa struttura matematica, di straordinaria eleganza teorica, catturò immediatamente l'immaginazione di fisici e matematici di tutta Europa, i quali videro nella proposta di Kaluza la possibile chiave di volta per una teoria del campo unificato che persino Einstein aveva cercato senza successo. La decomposizione del tensore metrico pentadimensionale rivelava una gerarchia di interazioni perfettamente annidate l'una nell'altra, come scatole cinesi matematiche che si aprivano rivelando strati sempre più profondi di significato fisico. Il tensore metrico a cinque dimensioni conteneva al suo interno la metrica quadridimensionale di Einstein, il potenziale vettore di Maxwell e un campo scalare aggiuntivo, creando una struttura gerarchica di grande fascino speculativo. La comunità scientifica dell'epoca, ancora scossa dalle rivoluzioni concettuali della relatività generale e della meccanica quantistica nascente, accolse con entusiasmo questa possibilità di ricondurre a unità le forze della natura. I matematici apprezzarono particolarmente la pulizia formale della costruzione, nella quale ogni elemento trovava il suo posto naturale in un disegno complessivo di straordinaria coerenza interna. Le equazioni di campo di Einstein in cinque dimensioni, una volta proiettate sul nostro spaziotempo quadridimensionale, generavano automaticamente le equazioni di Maxwell per l'elettromagnetismo, senza bisogno di postulare ulteriori termini o costanti di accoppiamento. Questa emergenza spontanea delle leggi dell'elettrodinamica dalla geometria pura rappresentava un trionfo dell'approccio geometrico alla fisica, suggerendo che le forze della natura non fossero altro che manifestazioni diverse della curvatura di uno spaziotempo a più dimensioni. La terza equazione, relativa al campo scalare, apparve inizialmente come una curiosità matematica priva di corrispettivo fisico immediato, ma successivamente venne reinterpretata in termini di nuove particelle o interazioni ancora sconosciute. La costruzione di Kaluza si presentava come un edificio teorico di straordinaria bellezza formale, capace di unificare due pilastri della fisica classica in un quadro geometrico coerente e matematicamente rigoroso. I fisici teorici riconobbero immediatamente il potenziale rivoluzionario di questa idea, che prometteva di ridurre il numero delle ipotesi indipendenti necessarie a descrivere la realtà fisica. Tuttavia, proprio questa apparente perfezione formale nascondeva crepe logiche latenti che le menti normali, accecate dal fascino estetico della teoria, tendevano a trascurare o a minimizzare. La struttura matematica era così elegante che pochi osavano metterne in discussione i fondamenti, preferendo concentrarsi sulle sue potenzialità piuttosto che sulle sue debolezze strutturali. Il sogno dell'unificazione sembrava a portata di mano, e molti fisici si lanciarono a capofitto nello sviluppo di questa nuova prospettiva teorica, convinti di essere sul punto di svelare il segreto ultimo della natura. La comunità scientifica, affascinata dalla possibilità di descrivere tutte le forze conosciute in termini di pura geometria, trascurò di esaminare criticamente i presupposti su cui la costruzione di Kaluza si reggeva, un atteggiamento che si sarebbe rivelato fatale per le sorti della teoria.

La castrazione matematica della condizione del cilindro

Per giustificare l'invisibilità empirica di questa quinta dimensione, Kaluza dovette postulare la cosiddetta "condizione del cilindro", un artifizio matematico che impone che nessuna derivata di alcuna quantità fisica possa variare lungo la quinta coordinata spaziale. Analiticamente, questa condizione rappresenta una castrazione del modello: si introduce una dimensione aggiuntiva per poi paralizzarla matematicamente, impedendole di partecipare attivamente alle dinamiche dell'universo osservabile. Questa restrizione, per quanto tecnicamente necessaria, solleva immediatamente sospetti di artificialità e di adattamento post-hoc ai dati osservativi, caratteristiche tipiche di quelle teorie che privilegiano l'eleganza formale a scapito della consistenza fisica. Nel 1926, il fisico svedese Oskar Klein cercò di sanare questa frattura concettuale proponendo un'interpretazione radicalmente diversa della quinta dimensione. Klein suggerì che la quinta dimensione non fosse cilindricamente statica, ma compattata, cioè arrotolata su se stessa in un cerchio di dimensioni incredibilmente piccole, all'incirca pari alla lunghezza di Planck. Questa ipotesi di compatificazione permetteva di giustificare l'inosservabilità diretta della quinta dimensione, poiché nessun esperimento condotto alle energie attualmente accessibili potrebbe mai risolvere una struttura così minuscola. La geniale intuizione di Klein trasformava la condizione del cilindro da una forzatura matematica in una proprietà geometrica naturale dello spaziotempo alle scale più piccole. Inoltre, la compatificazione su un cerchio introduceva automaticamente una simmetria di gauge U(1), esattamente quella che descrive l'elettromagnetismo, rafforzando ulteriormente l'eleganza della costruzione teorica. Il momento angolare lungo questa dimensione compattata risultava quantizzato, fornendo una possibile spiegazione geometrica della quantizzazione della carica elettrica, uno dei misteri più profondi della fisica delle particelle. Questa proprietà affascinò immediatamente i teorici, i quali videro nella compatificazione di Kaluza-Klein un possibile prototipo per la descrizione di tutte le interazioni fondamentali attraverso dimensioni aggiuntive arrotolate. La struttura matematica della compatificazione su un cerchio rivelava una connessione profonda tra geometria e teoria dei gruppi, suggerendo che le simmetrie interne delle particelle elementari potessero essere comprese come manifestazioni della geometria di dimensioni spaziali aggiuntive. I fisici teorici svilupparono estensioni di questa idea a gruppi di gauge più complessi, come SU(2) e SU(3), utilizzando compatificazioni su sfere o su varietà più complicate come gli spazi di Calabi-Yau. La teoria di Kaluza-Klein divenne così il precursore concettuale delle teorie di superstringa e della teoria M, nelle quali le dimensioni aggiuntive compattate giocano un ruolo centrale nella determinazione delle proprietà osservate delle particelle elementari. Nonostante l'indubbio fascino intellettuale di questa prospettiva, rimaneva aperta la questione fondamentale del perché la natura dovrebbe scegliere proprio questo meccanismo di compatificazione piuttosto che altri, e quali siano i principi dinamici che determinano la geometria delle dimensioni nascoste. Le dimensioni aggiuntive compattate rappresentano una delle idee più audaci e controverse della fisica teorica contemporanea, capaci di generare previsioni spettacolari ma estremamente difficili da verificare sperimentalmente. La comunità scientifica si divise tra entusiasti sostenitori di questa visione geometrica dell'unificazione e critici scettici, i quali sottolineavano la crescente distanza tra la raffinatezza delle costruzioni teoriche e la possibilità di una loro validazione empirica. Il dibattito tra queste due posizioni ha caratterizzato gran parte della fisica teorica del Novecento e continua ancora oggi, con implicazioni profonde per la nostra comprensione della struttura ultima della realtà.

Il disastroso calcolo del rapporto carica-massa

Il rischio fatale di questa architettura si rivela in modo inesorabile quando la teoria tenta di interfacciarsi con i parametri misurabili del mondo materiale. Se applichiamo il modello di Kaluza-Klein alla materia, eguagliando il momento lungo la quinta dimensione alla carica elettrica secondo le relazioni di de Broglie e l'accoppiamento minimo quantistico, otteniamo un'equazione predittiva per il rapporto massa-carica delle particelle elementari. Il risultato di questo calcolo è disastroso: la velocità nella dimensione compattata definisce il rapporto carica-massa della particella, e per possedere la carica osservata sperimentalmente, un elettrone dovrebbe avere una massa miliardi di volte superiore a quella effettivamente misurata nei laboratori di fisica delle alte energie. Questa discrepanza non è un piccolo scarto riconducibile a errori di misura o a approssimazioni trascurabili, ma una catastrofe numerica che invalida completamente la capacità predittiva della teoria. L'asimmetria tra l'eleganza tensoriale della costruzione geometrica e l'incompatibilità con i dati barionici espone una verità scomoda che molti teorici preferiscono ignorare: la teoria di Kaluza descrive magistralmente un universo matematico possibile, ma non l'universo in cui effettivamente esistiamo, con le sue specifiche costanti fisiche e le sue particelle dalle masse ben determinate. I tentativi di salvare la teoria modificando la geometria della compatificazione, introducendo campi aggiuntivi o ricorrendo a meccanismi di rottura di simmetria più complessi, hanno prodotto una proliferazione di varianti teoriche sempre più articolate e difficilmente falsificabili. La comunità dei teorici delle stringhe ha ereditato questo problema, cercando di determinare la forma delle dimensioni compattate in modo da riprodurre il corretto spettro di masse e cariche delle particelle osservate. Tuttavia, l'enorme numero di possibili compatificazioni, stimato in circa 10 seguito da cinquecento zeri, rende praticamente impossibile selezionare quella corretta senza fare ricorso a principi esterni alla teoria stessa. Questa situazione, nota come "problema del paesaggio" nella teoria delle stringhe, rappresenta una seria sfida per il programma di unificazione basato sulle dimensioni aggiuntive. La discrepanza tra le masse previste e quelle osservate suggerisce che forse l'intera impalcatura concettuale di Kaluza-Klein sia fondata su una premessa erronea: l'idea che le dimensioni spaziali debbano essere necessariamente quattro, e che le dimensioni aggiuntive debbano essere nascoste alla nostra osservazione diretta. Esiste una profonda ironia nel fatto che la teoria nata per unificare gravità ed elettromagnetismo generi previsioni inaccettabili per le proprietà più elementari della materia, quelle stesse proprietà che dovrebbe invece spiegare a partire da principi primi. I fisici sperimentali hanno verificato con precisione estrema i valori delle masse e delle cariche delle particelle elementari, e nessuna deviazione dalla fisica standard è mai stata osservata che potesse suggerire la presenza di dimensioni aggiuntive alle scale di energia attualmente accessibili. La teoria di Kaluza-Klein, per quanto matematicamente affascinante, rimane confinata nel regno delle speculazioni teoriche senza riscontro empirico, un monumento all'audacia speculativa umana ma anche un monito sui limiti dell'astrazione quando si perde di contatto con la realtà sperimentale.

Trattasi di un'illusione ottico-matematica: una mappa perfetta per un territorio inesistente, un monito su come l'astrazione assoluta possa accecare persino i più acuti osservatori, spingendoli a confondere l'eleganza formale con la verità fisica, dimenticando che la natura non ha alcun obbligo di conformarsi alle nostre più raffinate costruzioni intellettuali.

Di Alex (pubblicato @ 15:00:00 in Nuove Tecnologie, letto 105 volte)

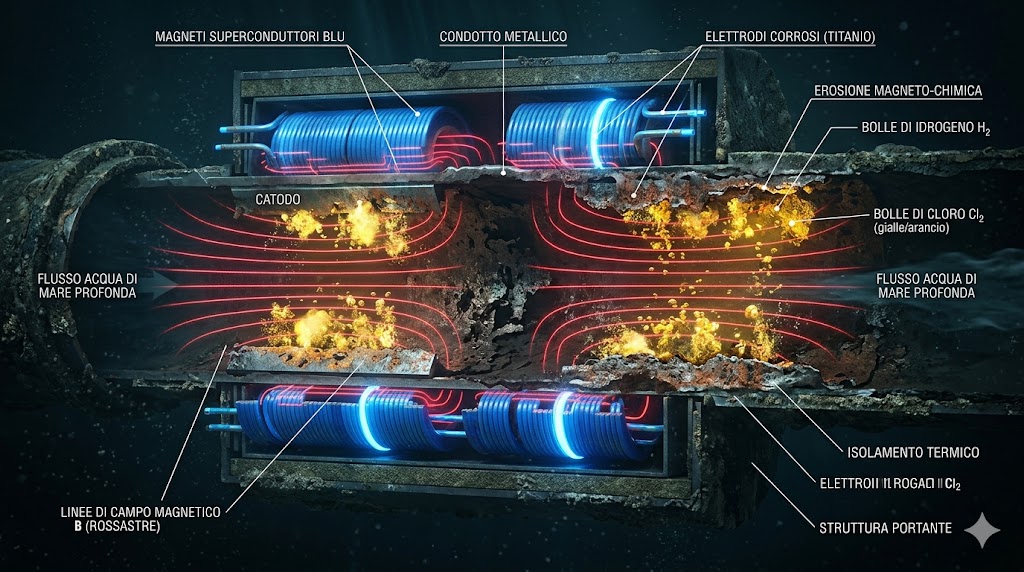

Sezione trasversale di un condotto MHD con campo magnetico, elettrodi corrosi e bolle di idrogeno, in un ambiente sottomarino futuristico.

Il dominio del mare ha da sempre preteso lo scotto dell'attrito e del rumore meccanico. La propulsione magnetoidrodinamica si propone come un balzo evolutivo paragonabile al passaggio dalla vela al vapore, obliterando albero, elica e timone e rimpiazzandoli con un condotto dove correnti elettriche e campi magnetici spingono l'acqua di mare. Ma l'acqua salata si oppone ferocemente all'estrazione di forza magnetica tramite la sua stessa chimica degradativa. LEGGI TUTTO L'ARTICOLO

Bonus Video

I principi fisici della propulsione MHD

La propulsione magnetoidrodinamica, nota anche con l'acronimo MHD, si fonda su principi fisici ben consolidati che risalgono ai lavori fondamentali del fisico svedese Hannes Alfvén, premio Nobel per la fisica nel 1970 per i suoi studi sui magnetoidrodinamica. Questa tecnologia innovativa oblitera completamente gli organi di propulsione tradizionali come albero, elica e timone, rimpiazzandoli con un condotto nel quale l'interazione tra correnti elettriche di intensità industriale e possenti campi magnetici, generati da elettromagneti superconduttori, spinge l'acqua salata in base alla rigida matematica della Forza di Lorentz. La Forza di Lorentz, descritta dall'equazione F = q(E + v×B) in cui F è la forza agente sulla particella carica, q è la carica elettrica della particella, E è il campo elettrico, v è la velocità della particella e B è il campo magnetico, agisce sugli ioni presenti nell'acqua di mare, principalmente ioni sodio a carica positiva e ioni cloro a carica negativa, accelerandoli lungo la direzione del condotto. Il movimento degli ioni trascina per attrito viscoso l'intera massa d'acqua circostante, generando un getto propulsivo che spinge l'imbarcazione nella direzione opposta, in perfetta analogia con il principio di azione e reazione della terza legge di Newton. Il fascino del silenzio operativo e del movimento stealth, privi delle vibrazioni e del rumore caratteristico delle eliche tradizionali, ha spinto esperimenti decennali in diverse nazioni, con particolare intensità in Giappone, Stati Uniti, Russia e Cina. Il picco storico di questo programma di ricerca è rappresentato dalla Yamato-1, un'imbarcazione sperimentale giapponese di trenta metri di lunghezza, varata nel 1992 e sviluppata dal Ship & Ocean Foundation con la collaborazione di Mitsubishi Heavy Industries. La Yamato-1 era equipaggiata con due magneti superconduttori raffreddati da elio liquido, capaci di generare campi magnetici di intensità pari a quattro Tesla, sufficienti per accelerare l'acqua di mare nel condotto e sviluppare una velocità massima di circa sei virgola sei nodi. Tuttavia, l'efficienza propulsiva complessiva del sistema si arenò a un misero trenta per cento, un valore troppo basso per rendere la tecnologia competitiva con i sistemi di propulsione tradizionali, che raggiungono facilmente efficienze dell'ottanta per cento o superiori. Nonostante gli sforzi notevoli e i consistenti investimenti finanziari, il progetto Yamato-1 fu accantonato dopo alcuni anni di test, dimostrando le difficoltà pratiche di tradurre un principio fisico elegante in una tecnologia marinara affidabile ed efficiente.

Le nuove frontiere dei superconduttori ad alta temperatura

Oggi, il progetto PUMP, acronimo di Principles of Undersea Magnetohydrodynamic Pumps, supervisionato dalla prestigiosa agenzia governativa statunitense DARPA, sta rivitalizzando l'interesse per la propulsione MHD sfruttando le recenti scoperte e i progressi tecnologici nei materiali superconduttori ad alta temperatura critica. I nuovi magneti sono realizzati con nastri superconduttori basati su REBCO, acronimo di Rare-Earth Barium Copper Oxide, una famiglia di materiali ceramici che diventano superconduttori a temperature molto più alte rispetto ai precedenti superconduttori a bassa temperatura come il niobio-titanio o il niobio-stagno. I nastri REBCO, composti da strati alternati di ossido di rame, bario, terre rare come l'ittrio o il gadolinio, e materiali di buffer, possono trasportare correnti elettriche di densità enormi senza dissipazione energetica per effetto Joule, anche in presenza di campi magnetici molto intensi. La capacità di operare a temperature accessibili con criogenia più semplice, tipicamente intorno ai settantasette gradi Kelvin, temperatura dell'azoto liquido, anziché ai quattro gradi Kelvin richiesti dall'elio liquido, semplifica drasticamente l'ingegneria criogenica necessaria per mantenere lo stato superconduttore. I magneti REBCO sono in grado di generare impressionanti barriere magnetiche da venti Tesla, cinque volte più intense di quelle utilizzate sulla Yamato-1, e di sostenere densità di corrente superiori a mille ampere per millimetro quadrato di sezione trasversale. A queste potenze magnetiche, l'efficienza teorica del getto propulsivo potrebbe sfiorare il settanta-novanta per cento, valori finalmente competitivi con i sistemi di propulsione tradizionali e tali da giustificare un rinnovato interesse industriale e militare per la tecnologia MHD. I possibili vantaggi della propulsione MHD includono l'assenza di parti mobili soggette a usura meccanica, l'eliminazione del rumore di cavitazione prodotto dalle eliche tradizionali, la riduzione della firma acustica del sottomarino con conseguente miglioramento della stealthness, e la possibilità di manovrare senza timone variando l'intensità e la direzione dei campi magnetici nei diversi condotti. Tuttavia, proprio mentre i fisici e gli ingegneri sembrano aver risolto il problema delle prestazioni energetiche e criogeniche, un nuovo e insidioso ostacolo emerge dalla chimica dell'acqua di mare, un problema che i materiali superconduttori da soli non possono risolvere.

Il conflitto elettrochimico e l'erosione catastrofica

Ciononostante, se si oltrepassa la verniciatura avveniristica e accattivante dei rendering computerizzati e si indaga l'elettrochimica del canale di spinta a livello molecolare, si scorge un conflitto insormontabile tra la fisica della propulsione MHD e la chimica dell'acqua di mare, un problema fondamentale che nessun miglioramento dei materiali superconduttori potrà mai eliminare completamente. Quando correnti elettriche di magnitudo industriale, dell'ordine di migliaia o decine di migliaia di ampere, attraversano una soluzione elettrolitica come l'acqua di mare, ricca di ioni sodio, cloro, magnesio, calcio, solfati e bicarbonati, innescano in modo inevitabile e inarrestabile reazioni di elettrolisi che degradano sia gli elettrodi sia la composizione chimica del fluido propulsivo. Il processo di idrolisi, il nome tecnico con cui si indica la decomposizione elettrolitica dell'acqua, produce sugli elettrodi densi strati di micro-bolle gassose che si accumulano sulla superficie delle piastre metalliche. Sull'elettrodo negativo, il catodo, la reazione predominante è la riduzione dell'acqua a idrogeno molecolare e ioni ossidrile, secondo l'equazione 2H₂O + 2e⁻ → H₂ + 2OH⁻. Sull'elettrodo positivo, l'anodo, la reazione è più complessa e pericolosa: in presenza di ioni cloro, che sono abbondanti nell'acqua di mare con una concentrazione di circa diciannove grammi per litro, si verifica l'ossidazione dello ione cloruro a cloro gassoso molecolare secondo l'equazione 2Cl⁻ → Cl₂ + 2e⁻, in competizione con l'ossidazione dell'acqua a ossigeno gassoso secondo l'equazione 2H₂O → O₂ + 4H⁺ + 4e⁻. Le micro-bolle di idrogeno, ossigeno e cloro aderiscono alla superficie degli elettrodi, formando uno strato isolante che aumenta drasticamente la resistenza elettrica della cella e riduce l'efficienza del trasferimento di carica dall'elettrodo al fluido. Le bolle fungono da isolante elettrico transitorio, innalzando drammaticamente l'impedenza della cella e assorbendo parte della potenza elettrica fornita al sistema, che invece di essere convertita in spinta meccanica viene sprecata nella produzione di gas. Peggio ancora, l'idrodinamica estrema del condotto MHD, con velocità del fluido potenzialmente molto elevate e turbolenza intensa, strappa queste bolle dalle piastre elettrodiche trascinandole nel flusso, dove subiscono espansioni e compressioni rapide che ne provocano il successivo e violento collasso micro-cavitazionale. Questo martellamento idraulico, costituito da onde d'urto microscopiche generate dall'improvvisa scomparsa della bolla, unito all'ossidazione acida generata dai gas clorurati disciolti che formano acido cloridrico e acido ipocloroso a contatto con l'acqua, scortica e consuma letteralmente le pareti dei condotti e le superfici degli elettrodi. Recentemente, i laboratori HRL Laboratories hanno introdotto prototipi di celle a idrogeno ricircolante che aspirano le bolle dalla superficie degli elettrodi e le riconducono in un circuito secondario dove vengono ricombinate ad acqua, abbattendo fino al novantacinque per cento l'emissione di queste bolle e dei vapori ossidativi, ma il postulato fondamentale rimane ineluttabile e irrisolvibile dalla fisica stessa: l'acqua di mare, con la sua ricca chimica ionica e la sua capacità di dissolvere gas corrosivi, si oppone ferocemente all'estrazione di forza magnetica tramite la sua stessa natura chimica degradativa. L'avanzamento tecnologico deve, paradossalmente, investire più risorse per impedire alla nave di consumare se stessa di quante ne spenda per muoverla, un bilancio energetico e materiale che rischia di rendere la propulsione MHD perennemente confinata nei laboratori di ricerca, senza mai raggiungere una maturità commerciale o operativa.

Il conflitto tra l'acqua di mare e la propulsione MHD è un conflitto irrisolvibile, una manifestazione della tendenza della natura a resistere alle forzature tecnologiche attraverso reazioni chimiche elementari quanto inarrestabili. Ogni ampere di corrente che scorre nel condotto produce inevitabilmente la sua controparte in bolle corrosive, e ogni bolla che si forma e collassa lascia dietro di sé un minuscolo cratere di erosione sulla superficie degli elettrodi, un processo lento ma inesorabile che condanna questi sistemi a una vita operativa drammaticamente breve rispetto ai motori tradizionali.

Di Alex (pubblicato @ 14:00:00 in Amici animali, letto 64 volte)

Rinoceronte di Giava in silhouette sulla spiaggia di Ujung Kulon con il vulcano Anak Krakatau fumante all'orizzonte, cielo crepuscolare.

Esiste un limite oltre il quale i calcoli di biologia della conservazione perdono significato, sostituendosi con l'escatologia della geografia fisica. Il rinoceronte di Giava, ridotto a una singola popolazione di circa sessanta-ottanta individui, vegeta interamente confinato nella penisola di Ujung Kulon, all'estremità occidentale dell'Isola di Giava. L'intera dotazione allelica mondiale della specie giace alla mercé di faglie tettoniche prive di memoria. LEGGI TUTTO L'ARTICOLO

Bonus Video

Il collasso demografico del rinoceronte di Giava

Il rinoceronte di Giava, noto alla comunità scientifica con il nome binomiale Rhinoceros sondaicus, rappresenta una delle specie più minacciate del pianeta e costituisce un caso di studio esemplare della fragilità estrema a cui possono giungere le popolazioni animali quando fattori antropici e naturali convergono in un collasso demografico apparentemente inarrestabile. Attualmente ridotto a una singola e isolata popolazione di circa sessanta-ottanta individui sopravvissuti, il rinoceronte di Giava è la rappresentazione vivente del crollo sistemico, un taxon un tempo diffuso in vaste aree del Sud-est asiatico, dalle pendici dell'Himalaya in Bhutan e India orientale, attraverso il Myanmar, la Thailandia, la Cambogia, il Laos, il Vietnam, la Malaysia peninsulare, fino alle isole di Sumatra, Giava e probabilmente Borneo. La drastica riduzione dell'areale e dell'abbondanza della specie è iniziata con l'intensificazione della caccia durante l'epoca coloniale, quando i rinoceronti venivano abbattuti per il commercio dei loro corni, utilizzati nella medicina tradizionale cinese e in altre pratiche culturali asiatiche, e si è accelerata nel ventesimo secolo con l'espansione agricola, la deforestazione e i conflitti armati che hanno frammentato e distrutto l'habitat della specie. Oggi, questa esigua aliquota globale di esemplari vegeta interamente confinata all'interno di una penisola paludosa relativamente piccola: il Parco Nazionale di Ujung Kulon, situato all'estremità occidentale estrema dell'Isola di Giava, in Indonesia, un'area di circa mille duecento chilometri quadrati che rappresenta l'ultimo rifugio della specie dopo l'estinzione dell'ultimo individuo in Vietnam nel 2010, evento che ha cancellato la sottospecie Rhinoceros sondaicus annamiticus precedentemente presente nel Sud-est asiatico continentale. La popolazione di Ujung Kulon, sebbene apparentemente stabile o leggermente crescente negli ultimi decenni grazie agli sforzi di protezione che hanno ridotto drasticamente il bracconaggio, presenta tutti i segni di una popolazione che ha superato un collo di bottiglia genetico estremo, con una diversità genetica drammaticamente ridotta rispetto alla popolazione ancestrale, una situazione che la rende particolarmente vulnerabile a malattie infettive, a mutazioni genetiche recessive dannose, e a una ridotta capacità di adattamento a cambiamenti ambientali improvvisi o a nuove pressioni selettive. Gli studi genetici condotti su campioni di tessuto e feci dei rinoceronti di Ujung Kulon hanno rivelato livelli di eterozigosi, una misura della variabilità genetica di una popolazione, estremamente bassi, indicativi di una storia recente di consanguineità e di deriva genetica che ha eliminato gran parte della variazione allelica originariamente presente nella specie. Questa uniformità genetica significa che la popolazione attuale è essenzialmente un clone espanso di pochi individui fondatori, con tutti gli individui che condividono un'alta percentuale del loro genoma, un fattore di rischio significativo per la comparsa di malattie genetiche recessive che in una popolazione più varia rimarrebbero nascoste dall'eterozigosi.

Le minacce biologiche e ambientali nella penisola di Ujung Kulon

Gli accademici, i biologi della conservazione e le commissioni internazionali che monitorano lo stato di conservazione del rinoceronte di Giava misurano assiduamente e con crescente preoccupazione il progresso dell'erosione genetica endogama, l'invasività crescente di alcune specie vegetali che alterano la composizione della foresta, e l'agghiacciante minaccia epidemiologica rappresentata dalla setticemia emorragica, una patologia batterica che transita agevolmente dai bufali d'acqua limitrofi, appartenenti alla specie Bubalus bubalis, agli immunodepressi rinoceronti, con tassi di mortalità che possono superare il novanta per cento negli animali infetti. La pianta invasiva più pericolosa per l'ecosistema di Ujung Kulon è la palma Arenga obtusifolia, una specie che si sta espandendo rapidamente nelle aree disturbate della foresta, formando fitti popolamenti che soffocano le essenze foraggiere preferite dal rinoceronte, riducendo la disponibilità di cibo di qualità e costringendo gli animali a spostamenti più ampi per trovare nutrimento sufficiente, con conseguente aumento dello stress energetico e riduzione del successo riproduttivo. Le palme Arenga producono inoltre frutti che, seppur commestibili per i rinoceronti, hanno un valore nutrizionale inferiore rispetto alle piante che stanno sostituendo, creando un potenziale deficit calorico che, sommato ad altri fattori di stress, potrebbe compromettere la salute e la fertilità della popolazione. La setticemia emorragica, causata dal batterio Pasteurella multocida, è endemica nella popolazione di bufali d'acqua selvatici che vive nei pressi del parco, e occasionalmente si verificano episodi di spillover in cui il batterio salta la barriera di specie e infetta i rinoceronti, con conseguenze spesso letali per gli animali colpiti. Dal momento che la popolazione di rinoceronti è così piccola e geneticamente uniforme, la comparsa di un focolaio epidemico di setticemia emorragica potrebbe decimare una frazione significativa degli individui sopravvissuti, potenzialmente spingendo la specie oltre il punto di non ritorno verso l'estinzione definitiva. Questo stillicidio quotidiano di minacce, misurate e monitorate con sempre maggiore precisione dai biologi della conservazione, maschera tuttavia, come un palliativo cognitivo che distoglie l'attenzione dalla vera natura del pericolo, la spada di Damocle sismica e vulcanica che oscilla inesorabile sulla testa dell'ultima popolazione di rinoceronte di Giava, una minaccia di natura così diversa da quelle biologiche da richiedere un cambio di paradigma nel modo di pensare la conservazione della specie. Ujung Kulon si protende direttamente nello Stretto della Sonda, il braccio di mare che separa le isole di Giava e Sumatra, una regione geologicamente tra le più attive e pericolose del pianeta, situata lungo la celebre Cintura di Fuoco del Pacifico, dove placche tettoniche si scontrano, si subducono e generano terremoti, tsunami ed eruzioni vulcaniche con frequenza e intensità superiori alla media globale.

La spada di Damocle vulcanica dell'Anak Krakatau

E in quelle acque agitate dello Stretto della Sonda, a pochissima distanza dalla costa occidentale di Ujung Kulon, sorge l'Anak Krakatau, ovvero il "Figlio del Krakatoa", un cono vulcanico emergente che è cresciuto dal fondo del mare dopo la catastrofica eruzione del 1883 che distrusse l'isola madre del Krakatoa. L'Anak Krakatau è un vulcano attivo, giovane, imprevedibile e in continua crescita, che riposa sull'esatta faglia geologica che nel lontano 1883 liberò un'energia stimata pari a diecimila bombe nucleari della potenza di quella sganciata su Hiroshima, una delle più grandi esplosioni mai registrate nella storia umana, il cui fragore fu udito a quasi cinquemila chilometri di distanza. La gigantesca esplosione del 1883 generò onde tsunamiche decametriche, alte fino a trenta metri o più, che si abbatterono sulle coste di Giava e Sumatra, spazzando via centinaia di villaggi, uccidendo più di trentaseimila persone e sommergendo vaste aree costiere, comprese quelle stesse foreste di Ujung Kulon oggi calpestate dagli ultimi rinoceronti di Giava. La ricostruzione della geologia della regione indica che eruzioni di scala simile a quella del 1883, o anche più violente, si verificano nell'area dello Stretto della Sonda con una frequenza stimata di circa una ogni mille-duemila anni, un intervallo di tempo relativamente breve in termini geologici ma sufficientemente lungo da far perdere la memoria del pericolo alle popolazioni umane e agli stessi biologi della conservazione, che tendono a concentrarsi su minacce più frequenti e visibili come il bracconaggio, la perdita di habitat e le malattie. I modelli di estinzione simulati al computer per la popolazione del rinoceronte di Giava, che incorporano la probabilità di eventi catastrofici naturali come eruzioni vulcaniche di grande scala e i conseguenti tsunami, attribuiscono un tasso di mortalità totale causata da catastrofi naturali ogni secolo con altissime percentuali, indicando che la probabilità che la specie venga spazzata via da un evento vulcanico o sismico nei prossimi cento-duecento anni è tutt'altro che remota e anzi superiore alla probabilità di estinzione per cause biologiche come la consanguineità o le malattie. I biologi della conservazione sono ben consapevoli di questa minaccia e cercano ostinatamente da decenni un habitat di dislocamento secondario dove trasferire una parte della popolazione di Ujung Kulon, creando una popolazione separata geograficamente che possa sopravvivere indipendentemente in caso di disastro catastrofico nel sito originale. Sono stati esplorati potenziali siti idonei nell'isola di Sumatra, in particolare nel Parco Nazionale di Way Kambas e in altre aree protette che in passato ospitavano rinoceronti di Sumatra, una specie diversa ma con esigenze ecologiche simili. Lo spostamento di alcuni individri da Giava a Sumatra è però bloccato da barriere giurisdizionali complesse, che richiedono accordi tra governi centrali e locali, da tempistiche logistiche esasperanti dovute alla necessità di costruire recinti di acclimatamento, trasportare gli animali in condizioni di massima sicurezza e monitorarli per anni dopo il rilascio, e dalla preoccupazione di non competere con l'ultima popolazione di rinoceronte di Sumatra, anch'essa gravemente minacciata e bisognosa di ogni risorsa di conservazione disponibile. Nel frattempo, mentre i funzionari e i biologi discutono, pianificano, ritardano, l'intera dotazione allelica mondiale di Rhinoceros sondaicus, l'intero patrimonio genetico di una specie che ha impiegato milioni di anni di evoluzione per perfezionarsi, giace alla mercé di faglie tettoniche prive di memoria, di coscienza e di pietà, indifferenti ai valori estetici, ecologici e culturali che gli esseri umani attribuiscono alla biodiversità. L'umanità sta operando un gigantesco e irresponsabile gioco d'azzardo planetario, stipando l'intera argenteria della biodiversità, rappresentata dall'unica popolazione superstite del rinoceronte di Giava, al centro di uno stadio riempito di cariche esplosive attive pronte a detonare in qualsiasi momento, con un innesco costituito non dalla volontà umana ma dalle inesorabili e imprevedibili leggi della termodinamica del magma sotterraneo.

Qui, per il rinoceronte di Giava, l'estinzione non sarà probabilmente causata dal logoramento lento del bracconaggio, che gli sforzi di protezione hanno ormai ridotto a livelli molto bassi, né dalla consanguineità che si accumula gradualmente di generazione in generazione, né dalla competizione con le piante invasive che riducono lentamente la capacità portante dell'habitat. L'estinzione, se e quando arriverà, sarà improvvisa, violenta, totale, causata dall'inesorabile e imprevedibile equazione termodinamica del magma sotterraneo, che in un singolo istante di faglia aperta, in un'ora o in un giorno di eruzione pliniana e di tsunami successivi, abbatterà a zero il numeratore dell'esistenza della specie, cancellando per sempre dalla faccia della Terra un animale che aveva imparato a sopravvivere alla giungla, ai predatori, ai cacciatori, ma non al fuoco della terra che lo aveva generato.

Baia bioluminescente notturna con acqua illuminata da luce verde-azzurra e mangrovie in primo piano sotto un cielo stellato.

Esiste una precisa asimmetria tra la resilienza percepita di un ecosistema e la sua reale architettura portante. A Vieques, isola di Porto Rico, Mosquito Bay è il corpo d'acqua bioluminescente più luminoso del pianeta, con densità di due milioni e quattrocentomila dinoflagellati per gallone. Ma la stessa morfologia che concentra il miracolo sigilla il suo destino tossicologico. LEGGI TUTTO L'ARTICOLO

Bonus Video

La fenomenologia della bioluminescenza a Mosquito Bay

La fenomenologia luminosa di questo bacino straordinario è demandata a una popolazione colossale di Pyrodinium bahamense, dinoflagellati microscopici appartenenti al gruppo dei fitoplancton marini, che raggiungono densità aberranti per un ambiente costiero: fino a due milioni e quattrocentomila organismi per gallone di acqua di mare. Questa concentrazione è di gran lunga superiore a quella osservabile in qualsiasi altra baia bioluminescente del mondo, rendendo Mosquito Bay un unicum ecologico di valore scientifico inestimabile, insignita del Guinness World Records nel 2006 come corpo d'acqua bioluminescente più luminoso del pianeta. I dinoflagellati Pyrodinium bahamense possiedono al loro interno organelli specializzati chiamati scintilloni, strutture subcellulari che contengono gli enzimi luciferina e luciferasi in compartimenti separati. Quando l'organismo viene disturbato fisicamente, da un movimento nell'acqua, da un'onda o dall'impatto di una goccia di pioggia, viene innescata una rapida variazione del pH all'interno dello scintillone, che passa da acido a basico. Questa variazione di pH permette alla luciferasi di agire sulla luciferina, catalizzando una reazione di ossidazione che produce luce visibile con un'efficienza straordinariamente alta per un processo biologico. Il fulgore emesso ha una durata di circa un decimo di secondo e presenta una caratteristica colorazione verde-azzurra, dovuta alla specifica struttura molecolare della luciferina del Pyrodinium. La strategia evolutiva alla base di questa produzione luminosa è chiara e ben documentata in biologia marina: si tratta di un meccanismo noto come "allarme da furto", nel quale l'emissione di luce serve ad attirare l'attenzione di predatori più grandi sull'organismo che sta attaccando il dinoflagellato. Quando un piccolo crostaceo planctonico cerca di nutrirsi di Pyrodinium, la luce emessa dall'organismo attaccato rende il crostaceo stesso un bersaglio visibile per i pesci predatori, che vengono così attratti nella zona e contribuiscono a ridurre la pressione di pascolo sulla popolazione di dinoflagellati. Questo sofisticato meccanismo di difesa, perfezionato in milioni di anni di coevoluzione tra predatori e prede, funziona efficacemente solo in ambienti sufficientemente scuri, dove il contrasto tra la luce emessa e l'oscurità circostante è sufficiente a rendere visibile il predatore. L'ecosistema di Mosquito Bay rappresenta quindi un delicato equilibrio tra la produttività biologica che sostiene l'enorme biomassa di dinoflagellati, la morfologia idrodinamica che ne concentra la popolazione, e le condizioni di oscurità che rendono efficace il meccanismo difensivo della bioluminescenza.

La prigione morfologica e l'accumulo di nutrienti

L'analisi idrodinamica del bacino di Mosquito Bay smantella completamente l'illusione della stabilità naturale di questo ecosistema apparentemente miracoloso. Mosquito Bay è, nei fatti, una prigione morfologica che costringe questi dinoflagellati in uno stato di stasi perpetua, impedendo sia la loro dispersione verso il mare aperto sia il deflusso delle sostanze potenzialmente tossiche che si accumulano nel bacino. La baia è circondata da fitte foreste di mangrovie rosse, le cui foglie, cadendo e decomponendosi nelle acque sottostanti, creano un brodo nutritivo ricco di vitamina B12 e di altri nutrienti critici per la crescita dei dinoflagellati. Il processo di decomposizione della lettiera di mangrovie rilascia nell'acqua composti organici complessi che vengono metabolizzati da batteri e altri microrganismi, producendo a loro volta le vitamine e i fattori di crescita necessari per sostenere le altissime densità di Pyrodinium osservate nella baia. L'ingranaggio chiave del sistema, tuttavia, non è solo l'apporto di nutrienti, ma la struttura morfologica che impedisce a questi nutrienti e agli organismi stessi di disperdersi. Il canale di ingresso della baia è straordinariamente stretto, lungo e poco profondo, caratteristiche che inibiscono drasticamente lo scambio mareale con il Mar dei Caraibi, impedendo fisicamente agli organismi di uscire dalla baia e alla baia di eliminare i prodotti di scambio attraverso la circolazione idrica. La batimetria della baia è caratterizzata da fondali generalmente poco profondi, con una profondità media di pochi metri, che limita ulteriormente il volume d'acqua disponibile per diluire eventuali sostanze inquinanti o tossiche che dovessero accumularsi nel sistema. Questa configurazione morfologica crea un effetto a "bottiglia" di straordinaria efficacia nel trattenere le masse d'acqua e gli organismi al suo interno, ma rende anche il bacino estremamente vulnerabile all'accumulo di sostanze potenzialmente dannose. La stessa immobilità idraulica che concentra il miracolo della bioluminescenza è il cappio che stringe il destino tossicologico della baia, impedendole di liberarsi dai sedimenti, dai contaminanti e dalle sostanze eutrofizzanti che vi affluiscono dai bacini idrografici circostanti. L'equilibrio idrodinamico è così precario che anche piccole variazioni nelle condizioni morfologiche, come quelle che potrebbero essere indotte da un uragano dal percorso anomalo o da un minimo dragaggio incauto del canale, potrebbero alterare irreversibilmente la circolazione idrica e i gradienti osmotici che sostengono la popolazione di dinoflagellati. La baia vive su un equilibrio miracoloso ma estremamente fragile, in cui la perfezione del meccanismo di accumulo è anche la sua più grave vulnerabilità sistemica.

I rischi sistemici e la minaccia dell'eutrofizzazione

La medesima topologia sigillata che permette la concentrazione dei dinoflagellati rappresenta il tallone d'Achille strutturale del sistema quando esposta ai processi di antropizzazione e ai cambiamenti nell'uso del territorio circostante. Una valutazione accurata dei bacini idrografici limitrofi rivela che il settantacinque per cento dei corsi d'acqua che sfociano nella baia interseca terreni a destinazione agricola, con coltivazioni che spesso utilizzano fertilizzanti a base di azoto e fosforo, nonché pesticidi e altri prodotti chimici. La morfologia a "bottiglia" di Mosquito Bay fa sì che essa assorba passivamente ogni particella di sedimento e ogni molecola di runoff chimico che i corsi d'acqua tributari trasportano a valle, senza avere la capacità idrodinamica di espellere i contaminanti verso il mare aperto. L'accumulo di nutrienti in eccesso, in particolare azoto e fosforo, può innescare processi di eutrofizzazione in cui l'eccessiva disponibilità di elementi nutritivi stimola una crescita esplosiva di alghe e cianobatteri, spesso a scapito dei dinoflagellati che richiedono condizioni più specifiche per prosperare. L'eutrofizzazione può alterare radicalmente l'equilibrio ecologico della baia, riducendo la dominanza del Pyrodinium e favorendo specie algali meno desiderabili dal punto di vista estetico ed ecologico. Parallelamente, l'antropizzazione incalzante delle coste di Vieques, con l'aumento delle costruzioni, delle strade e dell'illuminazione notturna, minaccia il buio stesso della baia, condizione essenziale per il funzionamento del meccanismo difensivo della bioluminescenza. La luce artificiale proveniente dagli insediamenti umani abbassa il contrasto percettivo tra l'emissione luminosa dei dinoflagellati e l'oscurità circostante, disinnescando l'utilità evolutiva della bioluminescenza e destrutturando le reti trofiche che dipendono da questo meccanismo di difesa. La riduzione dell'efficacia della bioluminescenza come deterrente contro i predatori di dinoflagellati può portare a una pressione di pascolo aumentata sui Pyrodinium, riducendone ulteriormente la popolazione e indebolendo la resilienza dell'intero ecosistema. Il rischio più grave, tuttavia, rimane quello di un evento catastrofico di origine naturale o antropica che alteri permanentemente la morfologia del canale di ingresso o l'equilibrio dei gradienti osmotici. Un uragano sufficientemente intenso da modificare la batimetria della baia, o un intervento umano di dragaggio finalizzato a migliorare la navigazione o il ricambio idrico, potrebbe distruggere l'equilibrio miracoloso che sostiene la popolazione di Pyrodinium, spegnendo la bioluminescenza della baia in modo irrevocabile e cancellando per sempre uno dei fenomeni naturali più spettacolari del pianeta.

Mosquito Bay resiste sul filo del rasoio, sospesa tra la meraviglia della sua bioluminescenza e la vulnerabilità intrinseca della sua architettura idrodinamica. Lo stesso meccanismo di accumulo che concentra il suo miracolo ecologico è anche la sua più grave debolezza sistemica, esponendola a rischi di eutrofizzazione, contaminazione e alterazione morfologica che potrebbero spegnerla per sempre, cancellando un patrimonio naturale di valore inestimabile sotto i colpi combinati dell'agricoltura intensiva, dell'espansione urbana e dell'incuria.

Di Alex (pubblicato @ 12:00:00 in Amici animali, letto 92 volte)

Squalo bentonico con muso allungato e dentelli dermici tricuspidati, illuminato da luce blu profonda in ambiente abissale.

Negli abissi, dove l'energia solare non penetra, l'evoluzione non tollera sprechi. Il Deania calcea, noto come squalo Brier, è un cacciatore bentonico che pattuglia le scarpate continentali a profondità comprese tra i 60 e i 1490 metri. La sua biologia raffinata da milioni di anni di selezione naturale si sta ora scontrando con le tecnologie umane in un conflitto asimmetrico e silenzioso. LEGGI TUTTO L'ARTICOLO

Bonus Video

L'architettura sensoriale di un predatore abissale

La biologia di questa creatura rappresenta una masterclass di economia metabolica e acume predatorio, affinata in milioni di anni di evoluzione in uno degli ambienti più estremi e meno esplorati del pianeta. Il Deania calcea, privo della vista a quelle profondità dove la luce solare non riesce a penetrare, ha compensato questa limitazione sviluppando un muso depresso e marcatamente allungato, che ospita una fitta rete di elettrorecettori specializzati noti come Ampolle di Lorenzini. In specie affini di squali e razze, queste ampolle formano complessi sistemi sensoriali composti da centinaia di pori distribuiti sulla superficie cefalica, fino a settecento pori organizzati in cluster anatomici specifici che coprono diverse regioni del muso e della testa. Ciascuna ampolla consiste in un canale pieno di una sostanza gelatinosa ad alta conduttività elettrica, che termina in un rigonfiamento interno rivestito da cellule sensoriali specializzate. La struttura delle Ampolle di Lorenzini è ottimizzata per percepire le infinitesimali variazioni nel gradiente di potenziale elettrico generate dalle contrazioni cardiache e muscolari delle prede nascoste nel fango o nella sabbia del fondale marino. La sensibilità di questi organi è straordinaria: gli squali possono rilevare campi elettrici dell'ordine di pochi nanovolt per centimetro, una sensibilità che permette loro di individuare prede sepolte a diversi centimetri di profondità nel sedimento. La fisiologia esterna del Deania calcea è altrettanto specializzata per la vita bentonica a grandi profondità. La sua pelle è corazzata da denticoli dermici, noti anche come scaglie placoidi, che presentano una morfologia tricuspidata unica per questa specie. Ogni denticolo è costituito da uno strato esterno di smalto, estremamente duro e resistente all'abrasione, e da uno strato interno di dentina, che circonda una cavità pulpare contenente tessuto connettivo e terminazioni nervose. Queste microstrutture non solo proteggono l'animale dalle asperità del fondale roccioso, ma svolgono anche una funzione idrodinamica cruciale: incanalano i fluidi lungo la superficie del corpo riducendo drasticamente la resistenza idrodinamica durante il nuoto. La configurazione tricuspidata crea microscopici vortici controllati che diminuiscono l'attrito tra la pelle dell'animale e l'acqua circostante, permettendo al Deania calcea di muoversi con efficienza energetica anche a basse velocità, un adattamento essenziale per un predatore che deve conservare energia in un ambiente dove il cibo è scarso e distribuito in modo irregolare. La combinazione di questi adattamenti, sensoriali e idrodinamici, rende lo squalo Brier un cacciatore straordinariamente efficace nel suo ambiente naturale, capace di localizzare e catturare prede che altri predatori non riuscirebbero nemmeno a rilevare.

L'inquinamento elettromagnetico e l'accecamento sensoriale

Esaminando questo complesso apparato sensoriale attraverso un'ottica sistemica contemporanea, emergono i vettori spietati del suo imminente declino, causato non da cambiamenti ambientali naturali, ma dall'impatto della tecnologia umana sugli ecosistemi profondi. L'elettrorecezione dello squalo si è affinata in un habitat storicamente privo di inquinamento elettromagnetico, un ambiente elettricamente "silenzioso" in cui anche i più deboli segnali generati dalle prede potevano essere rilevati senza interferenze di fondo. Negli ultimi decenni, tuttavia, la rapida proliferazione di cavi sottomarini per le telecomunicazioni globali e la trasmissione di energia elettrica ha invaso la scarpata continentale e le pianure abissali, esattamente gli habitat preferiti dal Deania calcea e da molte altre specie di squali di profondità. Si stima che nel mondo siano posati oltre un milione di chilometri di cavi sottomarini, che costituiscono l'infrastruttura fisica su cui si basa l'intera rete internet globale. I cavi di alimentazione, inoltre, trasportano correnti elettriche di intensità significativa, spesso dell'ordine di migliaia di ampere, per alimentare ripetitori e amplificatori disposti lungo il percorso. Il campo magnetico ed elettrico irradiato da queste infrastrutture, anche se debole a distanza, satura il fragile apparato di Lorenzini dello squalo, creando un "rumore" elettromagnetico di fondo che interferisce direttamente con la sua capacità di localizzare le prede. Il fenomeno è analogo a quello che accadrebbe a un essere umano esposto a un rumore acustico così intenso da mascherare completamente qualsiasi altro suono: il sistema sensoriale viene sopraffatto da uno stimolo continuo che impedisce la discriminazione dei segnali di interesse. Il Deania calcea viene letteralmente assordato sensorialmente a casa propria, privato dello strumento evolutivo che per milioni di anni gli ha garantito la sopravvivenza in un ambiente ostile. Gli studi di laboratorio condotti su specie affini hanno dimostrato che l'esposizione a campi elettromagnetici di intensità paragonabile a quelli generati dai cavi sottomarini altera significativamente il comportamento alimentare degli squali, riducendo la loro capacità di localizzare e catturare le prede. Inoltre, il campo magnetico terrestre, che molti squali utilizzano per orientarsi durante le migrazioni, viene distorto localmente dalla presenza di cavi e infrastrutture, potenzialmente disorientando gli animali e interferendo con i loro spostamenti tra aree di alimentazione e riproduzione. Le conseguenze ecologiche di questo accecamento sensoriale indotto sono potenzialmente devastanti per una specie già vulnerabile come il Deania calcea, che dipende criticamente dalla sua capacità di localizzare cibo in un ambiente dove le occasioni di alimentazione sono rare e preziose.

La cattura accessoria e la matematica dell'estinzione

A questa menomazione sensoriale invisibile, che agisce silenziosamente sulle popolazioni di squali di profondità senza che nessun osservatore umano possa rilevarla direttamente, si unisce una condanna meccanica altrettanto spietata ma molto più visibile e documentata. Le flotte da pesca a strascico industriali, spinte dalla crescente domanda di prodotti ittici anche da grandi profondità, operano ora regolarmente a quelle stesse profondità comprese tra i 600 e i 1500 metri dove il Deania calcea concentra la sua attività. Lo squalo Brier, pur non essendo il bersaglio commerciale principale di queste operazioni di pesca, viene sistematicamente decimato come "bycatch", cioè come cattura accessoria accidentale, intrappolato nelle maglie delle reti a strascico progettate per catturare gamberi di profondità, merluzzi e altre specie di interesse commerciale. Il fenomeno del bycatch rappresenta una delle minacce più gravi e sottovalutate per la biodiversità marina globale, con stime che indicano che circa il quaranta per cento di tutto il pescato mondiale sia costituito da specie non target, rigettate in mare spesso già morte o morenti. Per il Deania calcea, le conseguenze di questa cattura accessoria sono particolarmente devastanti a causa delle sue caratteristiche demografiche e del suo ciclo vitale estremamente lento. Avendo una longevità stimata di trentacinque anni e raggiungendo una lunghezza massima di circa centoventidue centimetri, lo squalo Brier appartiene alla categoria delle specie K-selettive, caratterizzate da una crescita lenta, una maturità sessuale tardiva e un tasso riproduttivo molto basso. Le femmine di Deania calcea producono un numero limitato di piccoli per ogni ciclo riproduttivo, e gli intervalli tra una gravidanza e l'altra possono essere di diversi anni, un adattamento tipico degli squali di profondità che vivono in ambienti a bassa produttività e non possono permettersi l'investimento energetico richiesto da una riproduzione rapida e abbondante. La matematica della sua popolazione non permette alcun margine di recupero di fronte a un prelievo anche moderato ma continuo: ogni individuo adulto rimosso dall'ecosistema rappresenta una perdita che richiederà decenni per essere compensata, se mai lo sarà. I modelli di dinamica di popolazione applicati a specie simili di squali di profondità indicano che tassi di mortalità aggiuntiva anche solo del cinque per cento sopra i livelli naturali possono portare all'estinzione della popolazione in poche decine di anni, un tempo irrisorio su scale evolutive ma sufficiente per cancellare definitivamente una specie perfezionatasi in milioni di anni di selezione naturale. Stiamo condannando all'estinzione un predatore abissale senza nemmeno accorgercene, sfruttando due cecità parallele: quella dello squalo verso le reti che lo intrappolano, reso ancora più vulnerabile dall'accecamento elettromagnetico, e quella della società umana verso il fondale oceanico e le sue creature, la cui agonia si consuma lontano dagli occhi e dall'attenzione dei media.

Il Deania calcea rappresenta un caso emblematico dell'impatto umano sugli ecosistemi profondi, un impatto fatto di interferenze sensoriali invisibili e distruzione fisica diretta, che si sommano in un effetto sinergico devastante per una specie già resa vulnerabile dalla sua stessa lenta strategia riproduttiva, in un silenzioso massacro che avviene a chilometri di profondità, lontano dalla nostra vista e dalla nostra coscienza.

Di Alex (pubblicato @ 11:00:00 in Capolavori e Patrimonio UNESCO, letto 83 volte)

Vista aerea del castello di Conwy con le otto torri cilindriche e le mura concentriche, su uno sperone roccioso sul mare.

Tra il 1283 e il 1289, Re Edoardo I finanziò l'erezione del Castello di Conwy nel Galles settentrionale, riversando l'immane somma di quindicimila sterline nelle casse dei costruttori guidati dal savoiardo Master James of St. George. La fortezza rappresenta l'apice dell'ingegneria militare altomedievale, ma l'amara derisione dell'algebra militare avvenne nel 1401, quando cadde non per un'innovazione balistica, ma per un inganno imbarazzante. LEGGI TUTTO L'ARTICOLO

Bonus Video

L'apoteosi dell'ingegneria militare medievale

Analizzando la topografia e il disegno geometrico del Castello di Conwy con gli occhi di un ingegnere militare dell'epoca, si comprende immediatamente la calcolata soppressione di tutti i vettori d'attacco tradizionali che aveva reso vulnerabili le fortezze precedenti. Il castello, di forma rettangolare allungata, si erge sopra uno sperone di nuda roccia costiera che si protende verso l'estuario del fiume Conwy, una scelta deliberata di posizionamento che rendeva scientificamente impossibile per i minatori avversari scavare cunicoli di sottominamento sotto le fondamenta, una tecnica standard per il crollo delle mura dell'epoca, che consisteva nello scavare gallerie sotto le fortificazioni per poi incendiarne i puntelli di legno, causando il cedimento dell'intera struttura. La roccia viva su cui poggia il castello, granitica e compatta, avrebbe richiesto mesi o anni di lavoro per essere scalfita con gli strumenti rudimentali del tredicesimo secolo, rendendo l'assedio minerario una prospettiva del tutto impraticabile per qualsiasi esercito medievale, per quanto ben equipaggiato e determinato. Otto torri cilindriche, tre sul lato nord rivolto verso il mare, tre sul lato sud verso la città, e due torri gemelle a protezione dell'ingresso principale, spezzano il perimetro esterno del castello, annullando completamente gli angoli ciechi che caratterizzavano i vecchi mastii quadrangolari, nei quali un attaccante poteva avvicinarsi alle mura rimanendo coperto dal tiro dei difensori. La forma cilindrica delle torri offriva inoltre una resistenza superiore agli attacchi di artiglieria primitiva, come i trabucci e i mangani che lanciavano pietre di grandi dimensioni, poiché la superficie curva tendeva a deviare i proiettili piuttosto che assorbirne l'impatto frontalmente come avrebbe fatto una superficie piana. Le torri erano posizionate a distanze calcolate per offrire campi di tiro perfettamente sovrapposti, permettendo agli arcieri e ai balestrieri di sventagliare l'artiglieria e i dardi trasversalmente sui fianchi degli attaccanti, colpendo i soldati nemici da due direzioni contemporaneamente nel momento in cui tentavano di avvicinarsi alle mura o di attraversare il fossato. Il castello era inoltre dotato di un sistema di porte multiple e barbacani, strutture fortificate esterne che creavano un percorso a gomito obbligato per chiunque volesse accedere all'interno, costringendo gli attaccanti a rallentare, a esporre il fianco non protetto dello scudo e a subire il tiro da più direzioni contemporaneamente. Dal punto di vista della statica pura e della metrica di assedio, la fortezza concentrica del Maestro James era la traslazione matematica dell'inespugnabilità, un'opera d'arte ingegneristica che sembrava aver anticipato e neutralizzato ogni possibile strategia offensiva conosciuta all'epoca. Le mura concentriche, due cinte murarie separate da un cortile intermedio, creavano una difesa a strati in cui la caduta della cinta esterna non comprometteva l'integrità della cinta interna, permettendo ai difensori di ritirarsi ordinatamente e continuare a resistere anche dopo aver perso la prima linea di difesa. La complessità e il costo della costruzione furono enormi, con quindicimila sterline del tredicesimo secolo che corrisponderebbero a molti milioni di sterline attuali, una somma che testimonia l'importanza strategica che Edoardo I attribuiva alla sottomissione del Galles e al controllo del territorio gallese.

L'illusione della resistenza assoluta

La dissezione storica degli eventi che hanno segnato la vita operativa del Castello di Conwy denuncia però spietatamente l'asimmetria letale della guerra medievale e, più in generale, di ogni conflitto umano: l'involucro di pietra, per quanto spesso e ben progettato, protegge efficacemente dalle minacce che provengono dall'esterno, ma è completamente impotente di fronte alla putrefazione che inizia all'interno, al lento ma inesorabile deterioramento della disciplina, del morale e della razionalità della guarnigione che lo presidia. La rigidità del sito su base rocciosa, che rendeva impossibile l'assedio minerario, ne compromise tuttavia l'indipendenza logistica prolungata in caso di blocco terrestre e navale, poiché la mancanza di un ampio spazio pianeggiante intorno al castello limitava la possibilità di immagazzinare grandi quantità di cibo, acqua e foraggio per gli animali all'interno delle mura. I pozzi interni al castello, per quanto profondi, non garantivano una riserva idrica sufficiente per sostenere una guarnigione numerosa per mesi, e le scorte alimentari erano limitate dalla capacità degli scantinati e dei magazzini. Quando nel gelido inverno del 1294, durante la rivolta gallese guidata da Madog ap Llywelyn, le forze ribelli cinsero d'assedio la roccaforte, tagliando le vie di rifornimento terrestri e impedendo l'arrivo di navi di soccorso via mare, la formidabile guarnigione e le spesse pareti di pietra dovettero sottomettersi al freddo calcolo della fame, il nemico più spietato e implacabile di tutti, che non si può respingere con frecce o pietre e che colpisce difensori e aggressori con la stessa indifferenza. Conwy non cedette formalmente, non venne presa d'assalto e le sue mura rimasero intatte, ma la sua tenuta si ridusse alla tenacia disperata dello stesso re Edoardo I, che si trovava personalmente all'interno del castello con la sua corte, e che dovette umiliarsi distribuendo il suo pregiato e limitato vino personale per calmare il collasso psicologico delle guardie, assetate, affamate e sfinite dal lungo assedio invernale, un episodio che rivela quanto la resistenza umana sia limitata da bisogni primari che nessuna architettura, per quanto avanzata, può eliminare. La fortezza, progettata per resistere ai colpi dei trabucci e agli attacchi della cavalleria, si rivelò paradossalmente vulnerabile alla logistica, alla catena di approvvigionamento e alla psicologia della fame, elementi che gli ingegneri militari tendevano a sottovalutare o a considerare problemi di competenza dei comandanti piuttosto che dei costruttori. L'illusione della resistenza assoluta, della fortezza inespugnabile che può resistere indefinitamente a qualsiasi assedio, si infranse non contro una nuova arma o una tattica innovativa, ma contro la realtà materiale che anche il più potente dei re ha bisogno di mangiare e bere ogni giorno, e che le scorte, per quanto abbondanti, sono sempre limitate e destinate a esaurirsi.

La caduta per inganno e la fallibilità del protocollo umano

Tuttavia, l'amara derisione dell'algebra militare del Maestro James of St. George, la dimostrazione più eclatante dei limiti di ogni difesa puramente fisica di fronte all'ingegno e all'inganno umani, avvenne più di un secolo dopo, il primo aprile del 1401, una data che gli storici hanno tramandato con un misto di stupore e ironia. La più avanzata, costosa e apparentemente inossidabile macchina da guerra che l'Inghilterra avesse mai costruito cadde non per un'innovazione balistica, non per un nuovo tipo di cannone o di ariete, non per la superiorità numerica degli attaccanti, non per la fame o per la malattia, ma per un inganno tanto audace quanto imbarazzante nella sua semplicità. Due cugini del leader ribelle gallese Owain Glyndŵr, i fratelli Rhys ap Twdwr e Gwilym ap Twdwr, escogitarono un piano di infiltrazione che aggirava completamente l'imponente apparato difensivo del castello senza bisogno di abbattere una sola pietra o di scavalcare un solo merlo. I due, travestiti da falegnami impiegati per le riparazioni ordinarie del castello, si presentarono alla porta principale nell'orario consueto di ingresso degli artigiani e dei lavoratori, con gli attrezzi del mestiere in spalla e un atteggiamento naturale e disinvolto. La guardia alla porta, ingannata dai travestimenti e probabilmente anche un po' distratta o disattenta, aprì il cancello senza sospettare nulla, permettendo ai due ribelli di entrare nel perimetro interno del castello. Una volta all'interno, Rhys e Gwilym sguainarono le spade nascoste sotto gli abiti da lavoro e scannarono le sentinelle ignare che presidiavano il cortile e le scale della torre principale, in un massacro silenzioso e fulmineo che non diede il tempo ai difensori di organizzare una reazione. Dopo aver eliminato le sentinelle, i due aprirono le porte principali dall'interno, abbassarono i ponti levatoi e fecero segnale alle forze gallesi nascoste nelle vicinanze, che irruppero nel castello prendendone il controllo in pochi minuti, con perdite minime e senza alcuna battaglia degna di questo nome. La conquista del Castello di Conwy da parte di due soli uomini travestiti da falegnami dimostra matematicamente come la fortificazione geometrica più avanzata sia del tutto irrilevante quando i vettori d'attacco operano non attraverso la forza bruta o la tecnologia, ma attraverso le falle del protocollo comportamentale umano, le debolezze della percezione, dell'attenzione e della fiducia. Migliaia di tonnellate di calcare accuratamente tagliato e assemblato, decine di migliaia di sterline spese in anni di costruzione, il genio ingegneristico del più grande costruttore di castelli dell'epoca, furono bypassate dall'ingenuità, dalla distrazione o dalla semplice routine di un singolo organismo carbonioso, la guardia alla porta, incaricato di sorvegliare la serratura ma tradito dalla sua stessa natura umana, fatta di stanchezza, abitudine, desiderio di completare il turno e tornare a casa. La lezione del Castello di Conwy trascende la storia militare medievale e parla alla condizione umana universale: ogni sistema di difesa, per quanto sofisticato, ha un punto debole che non è fatto di metallo o di pietra, ma di carne, sangue e neuroni, e quel punto debole può essere sfruttato non solo dalla violenza, ma dall'astuzia, dall'inganno, dalla paziente osservazione delle abitudini altrui. Il castello che nessuna armata avrebbe potuto conquistare cadde per un trucco da teatranti, due uomini con una buona storia e un po' di sangue freddo, e il suo destino è un monito per tutte le epoche: la sicurezza perfetta è un'illusione, perché dipende sempre, in ultima analisi, dalla perfezione degli esseri umani che la gestiscono, e nessun essere umano è perfetto.

Il Castello di Conwy sopravvive ancora oggi, imponente e austero sulle sue rocce, meta di turisti e appassionati di storia militare. Ma il suo insegnamento più profondo non riguarda le pietre, le torri o le mura, ma i due uomini travestiti da falegnami che bussarono alla porta un primo aprile del 1401, dimostrando che la più grande vulnerabilità di ogni fortezza è, e sarà sempre, la fallibilità della mente umana incaricata di custodirne le chiavi.

Di Alex (pubblicato @ 10:00:00 in Medicina e Tecnologia, letto 97 volte)

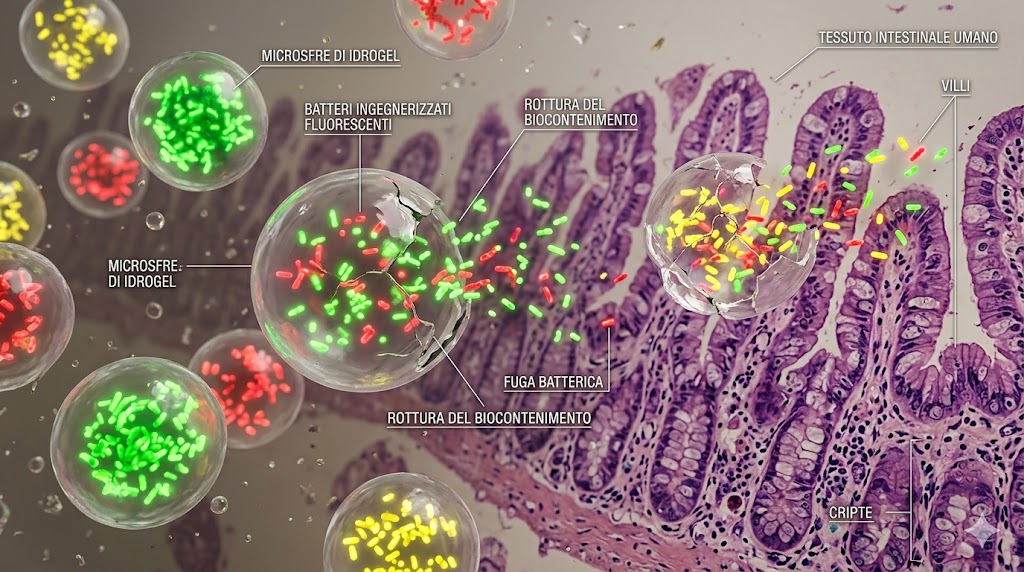

Sferoidi di idrogel traslucido contenenti colonie batteriche fluorescenti, su sfondo di tessuto intestinale umano in sezione.

La medicina contemporanea sta transitando dalla somministrazione di molecole inerti alla semina di macchine biologiche reattive. L'ingegneria del microbioma umano mira a curare malattie metaboliche tramite l'innesto di consorzi batterici geneticamente modificati nel lume intestinale. Ma l'incapsulamento di batteri programmati in idrogel polimerici nasconde una trappola biomeccanica: l'equilibrio di trazione tra la forza di turgore della colonia e la tenacia del contenitore. LEGGI TUTTO L'ARTICOLO

Bonus Video

L'architettura dei consorzi batterici ingegnerizzati

L'ingegneria del microbioma umano rappresenta una delle frontiere più promettenti e allo stesso tempo più rischiose della medicina contemporanea, un campo di ricerca che mira a curare malattie metaboliche, obesità, diabete, scompensi cardiovascolari, malattie infiammatorie intestinali e persino disturbi neurologici tramite l'innesto di "consorzi batterici" geneticamente modificati nel lume intestinale o in altri distretti dell'organismo. A differenza dei probiotici tradizionali, che somministrano batteri non modificati o selezionati per proprietà benefiche generiche, i consorzi batterici ingegnerizzati sono progettati con precisione molecolare per svolgere funzioni metaboliche specifiche, come la degradazione di composti tossici, la produzione di molecole terapeutiche, o la modulazione del sistema immunitario. I ceppi batterici più comunemente utilizzati come piattaforme per queste modifiche genetiche includono l'Escherichia coli Nissle 1917, un ceppo probiotico di E. coli con una lunga storia di uso sicuro in ambito clinico, caratterizzato da proprietà anti-infiammatorie e da una ridotta virulenza rispetto ai ceppi patogeni della stessa specie. Un altro ceppo molto utilizzato è il Lactococcus lactis, un batterio lattico Gram-positivo considerato generalmente riconosciuto come sicuro dall'ente regolatorio statunitense FDA e ampiamente impiegato nell'industria alimentare per la produzione di formaggi e latticini fermentati. I ricercatori hanno inoltre sviluppato varianti di Bacteroides, un genere batterico che domina il microbioma intestinale umano rappresentando fino al trenta per cento di tutti i batteri presenti nel colon, capaci di metabolizzare e convertire il colesterolo sistemico in coprostanolo o colesterolo solfato, due forme non assorbibili dall'intestino che vengono eliminate con le feci, riducendo così i livelli di colesterolo nel sangue e il rischio di malattie cardiovascolari. I consorzi batterici ingegnerizzati non sono costituiti da un singolo ceppo, ma da più ceppi diversi che collaborano in una rete metabolica di precisione chirurgica, in cui il prodotto di scarto di un ceppo diventa la materia prima per il ceppo successivo, creando una catena di trasformazioni biochimiche che sarebbe impossibile realizzare con un singolo organismo. Questa architettura modulare permette di distribuire il carico metabolico tra più ceppi specializzati, riducendo lo stress su ciascuna popolazione e aumentando la robustezza complessiva del sistema, poiché il fallimento di un ceppo può essere compensato dagli altri, almeno in parte.

Le capsule di idrogel come materiali viventi impiantabili