\\ Home Page : Pubblicazioni

Di seguito gli articoli e le fotografie pubblicati nella giornata richiesta.

Articoli del 02/05/2026

Di Alex (pubblicato @ 15:00:00 in Parchi tematici e musei sci-tech, letto 21 volte)

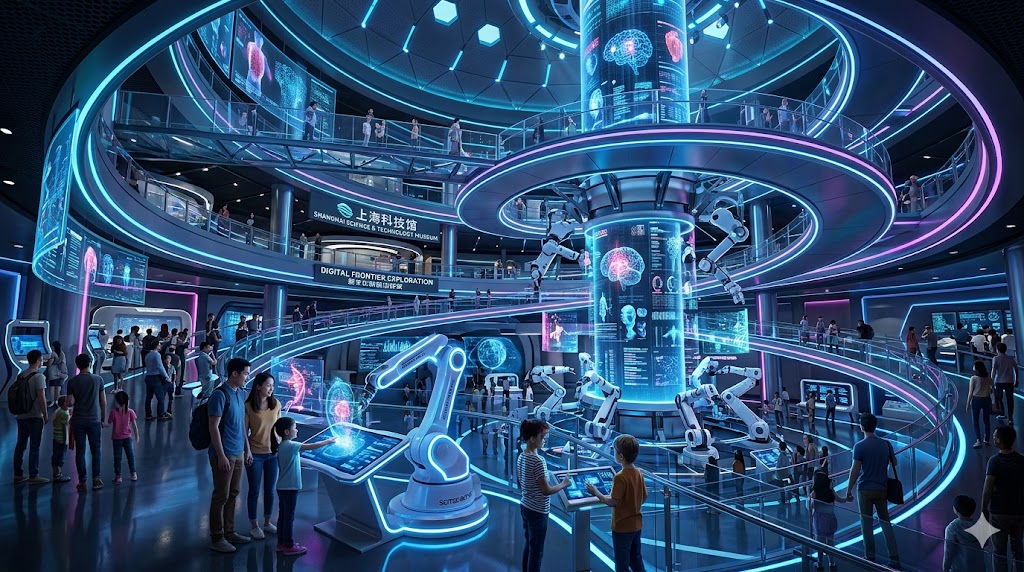

Interno futuristico dello Shanghai Science Museum con installazioni interattive robotizzate

Riaperto nel 2026 dopo un colossale rinnovamento, lo Shanghai Science and Technology Museum si è trasformato in un avveniristico hub per la generazione nativa digitale. Integrando robotica, biodiversità simulata e intelligenza artificiale, il museo abbandona le vetrine tradizionali per diventare un laboratorio interattivo. Un viaggio tra le tecnologie che plasmeranno la società del 2050. LEGGI TUTTO L'ARTICOLO

Riaperto nel 2026 dopo un rinnovamento sistematico costato 8,2 miliardi di yuan, lo Shanghai Science and Technology Museum (SSTM) si è trasformato in un hub esperienziale progettato per la generazione "nativa digitale". La struttura, caratterizzata da una spirale ascendente che simboleggia il progresso scientifico, ospita dieci zone espositive permanenti che integrano AI, biodiversità e avventura spaziale.

Robotica e AI: La Zona 'AI Pioneers'

La sezione dedicata all'intelligenza artificiale e alla robotica non presenta più la tecnologia come uno spettacolo, ma come un'infrastruttura core. Nella galleria "Tomorrow's Walkers", i visitatori interagiscono con sistemi robotici avanzati e prototipi di mobilità futura attraverso interfacce guidate dall'AI.

Un'opera particolarmente significativa è "AI Fossil", un'installazione composta da due bracci robotici industriali che assemblano in tempo reale un "reperto digitale" basato sui dati dinamici forniti dal pubblico. L'opera suggerisce che in futuro la memoria della civiltà non sarà preservata nella materia biologica, ma nell'accumulo di tracce digitali.

- AI Pioneers: Robotica e AI interattiva con dialogo live e performance.

- Shared Planet: Ecosistemi e biodiversità con foreste pluviali ricreate e simulazioni climatiche.

- Material Matrix: Scienza dei materiali con esplorazione tattile e termica di centinaia di campioni.

- Aviation Adventures: Ingegneria del volo con ricostruzioni di velivoli storici e simulatori VR.

Biodiversità e Spazio Siderale

La conservazione della natura e l'esplorazione dell'universo sono pilastri del nuovo museo. La "Rainforest Realm" ricrea una foresta pluviale tropicale con un'immersività che include flora e fauna reali, mentre la zona "Shared Planet" educa le famiglie sulle interconnessioni degli ecosistemi terrestri. Per quanto riguarda lo spazio siderale, sebbene la struttura principale si concentri sull'aviazione e la fisica esplorativa, il complesso museale di Shanghai si integra con lo Shanghai Astronomy Museum per offrire un'esperienza completa che va dal microcosmo atomico al macrocosmo galattico.

L'approccio pedagogico di SSTM mira a "rallentare" il visitatore. Con oltre 400 esibizioni interattive e un tasso di interazione dell'80%, il museo non è più una sequenza di vetrine, ma un laboratorio vivente dove l'arte cinetica (come la scultura "Dancer" basata sulla sezione aurea) e la scienza si fondono per stimolare la curiosità dei giovani verso le sfide tecnologiche del 2050.

L'Integrazione di Sistemi Fisici e Digitali

L'esame degli attuali ambiti museali evidenzia una transizione fondamentale nella gestione della complessità umana. Dalla rigidità geometrica progettata per contenere minacce fisiche tipica dei secoli passati, siamo passati alla fluidità moderna.

In questo contesto, istituzioni come il Museo della Scienza di Shanghai fungono da ponti culturali, preparando la società a un futuro dove il progresso tecnologico e scientifico andrà di pari passo con un ecosistema digitale vivo, garantendo che la tecnologia rimanga un laboratorio continuo al servizio del benessere umano e della scoperta cosmica.

Di Alex (pubblicato @ 14:00:00 in Geopolitica e tecnologia, letto 51 volte)

Catena di montaggio di componenti elettronici in Cina per prodotti americani

Retorica del decoupling e dipendenza USA dalla Cina: iPhone, terre rare, difesa. Perché il reshoring è un miraggio e i dazi non bastano. LEGGI TUTTO L'ARTICOLO

Ricostruzione AI

Nel 2012, quando Apple decise di riportare l'assemblaggio del Mac Pro negli Stati Uniti, il gigante di Cupertino si scontrò con un ostacolo che nessun algoritmo di supply chain aveva previsto: la cronica mancanza di viti speciali. In Cina, un distretto industriale poteva sfornare milioni di viti personalizzate in poche ore, adattando macchinari e linee di produzione con una flessibilità sconosciuta alle officine occidentali. In Texas, un'azienda con venti dipendenti riusciva a stento a produrne mille al giorno. Questo microscopico episodio, rivelato dal New York Times, racchiude la vera natura della dipendenza statunitense dalla Cina: non una mera questione di costo del lavoro, bensì l'esistenza di un ecosistema produttivo densissimo, capace di reagire in tempo reale alle richieste più estemporanee dell'industria tecnologica. La profondità di questa rete è tale che, a distanza di oltre un decennio, l'80 per cento degli iPhone destinati al mercato americano viene ancora assemblato negli stabilimenti cinesi di Foxconn, Pegatron e Wistron, con componenti che arrivano da migliaia di subfornitori locali. Nessuno di questi attori è sostituibile nel breve termine, perché le competenze, le attrezzature e la logistica necessarie per replicare il modello richiederebbero investimenti per centinaia di miliardi di dollari e almeno una generazione di formazione della manodopera specializzata. Non a caso, quando nel 2025 l'amministrazione Trump impose dazi del 125 per cento sulle importazioni dalla Cina, fu costretta a esentare in tutta fretta smartphone, laptop e tablet, riconoscendo implicitamente che un loro aumento di prezzo avrebbe scatenato una reazione a catena devastante per i consumatori e per l'intera economia digitale. Il caso di Tesla è altrettanto illuminante. Nonostante Elon Musk abbia più volte dichiarato di voler eliminare ogni componente cinese dalle vetture prodotte negli Stati Uniti, decine di sottoassiemi continuano ad arrivare dalla Cina, dai moduli delle sospensioni alle centraline elettroniche, passando per le celle delle batterie LFP che solo i produttori cinesi sono in grado di fornire a costi accettabili. General Motors, più cauta, ha fissato il 2027 come scadenza per il completo phase-out dei componenti cinesi dalla propria catena di fornitura nordamericana, ma fonti interne confermano che il traguardo è ritenuto ambizioso e che numerosi programmi di veicoli elettrici potrebbero slittare a causa della mancanza di alternative qualificate. Anche nel settore degli elettrodomestici, dei giocattoli e dell'abbigliamento tecnico la dipendenza è imbarazzante: il 97 per cento delle carrozzine importate negli Stati Uniti proviene dalla Cina, così come il 96 per cento dei fiori finti e degli ombrelli, il 93 per cento dei libri da colorare e il 75 per cento delle bambole Barbie. Dietro questi numeri non c'è soltanto il basso costo, ma la disponibilità immediata di stampi, iniezione plastica, tessuti e assemblaggi che, combinati con un sistema portuale e ferroviario ottimizzato, garantiscono tempi di consegna che nessun'altra nazione può eguagliare. La pandemia da Covid-19 aveva illuso molti osservatori che le aziende avrebbero diversificato rapidamente, ma la realtà post-pandemica ha mostrato che la Cina ha rafforzato la propria posizione, spostandosi verso produzioni a più alto valore aggiunto e integrando robotica e intelligenza artificiale nelle fabbriche, rendendo il divario di produttività ancora più marcato. Il paradosso delle viti del Mac Pro è così diventato la metafora perfetta di un sistema produttivo globale in cui la specializzazione spinta ha creato un'intelaiatura di interdipendenze che nessuna guerra commerciale può smantellare senza infliggere danni irreparabili all'economia americana, alla sua inflazione e alla capacità di innovazione delle sue imprese.

Il tallone d'Achille: le terre rare e la difesa

Il punto più critico e meno visibile della dipendenza americana dalla Cina riguarda le materie prime strategiche, in particolare le cosiddette terre rare, un gruppo di diciassette elementi chimici che costituiscono il cuore pulsante delle tecnologie moderne. La Cina controlla oltre il 90 per cento della lavorazione e raffinazione globale di questi minerali, un dominio costruito in decenni attraverso una strategia deliberata di acquisizione di miniere, investimenti in impianti di separazione e una politica dei prezzi che ha di fatto estromesso i concorrenti occidentali. Elementi come il neodimio, il disprosio, il terbio e l'ittrio sono indispensabili per i magneti permanenti ad alta potenza, per i display, per i laser e per la sensoristica avanzata. Ogni caccia F-35 contiene oltre 400 chilogrammi di terre rare, distribuiti nei magneti del motore, nei sistemi radar AESA, nei sensori elettro-ottici e nei cablaggi. Lo stesso vale per i sottomarini classe Virginia, per i missili Tomahawk, per i droni da ricognizione e per i sistemi di comunicazione satellitare. La dipendenza è talmente pervasiva che un rapporto del Pentagono ha definito la situazione “una vulnerabilità strategica di prim'ordine”, perché l'intera superiorità militare americana poggia su tecnologie i cui componenti chiave sono, di fatto, monopolizzati da un potenziale avversario. Pechino, pienamente consapevole di questo tallone d'Achille, ha già utilizzato le terre rare come arma geopolitica, bloccando nel 2025 le spedizioni di magneti essenziali verso gli Stati Uniti, ufficialmente per ragioni di “sicurezza nazionale”. L'impatto è stato immediato sulle linee di produzione di veicoli elettrici, aerogeneratori e robotica industriale, ma soprattutto ha messo in allarme i pianificatori della difesa, che si sono resi conto di non avere scorte strategiche sufficienti a coprire più di pochi mesi di fabbisogno bellico. Le riserve stimate di terre rare in Cina ammontano a 44 milioni di tonnellate, contro i circa 2 milioni degli Stati Uniti, che controllano appena l'11,9 per cento della produzione mineraria globale, a fronte del 70 per cento di Pechino. Anche in questo caso, non è la semplice estrazione a fare la differenza, ma l'intera catena di raffinazione: separare le terre rare è un processo chimico estremamente complesso, inquinante e costoso, che richiede know-how e infrastrutture che gli Stati Uniti hanno smantellato a partire dagli anni Ottanta, quando la produzione cinese a basso costo invase il mercato. I tentativi di ricostruire una filiera nazionale, pur finanziati con centinaia di milioni di dollari dal Dipartimento della Difesa e con la creazione della Mountain Pass Materials in California, sono ancora ben lontani dall'essere operativi su scala necessaria. Le tempistiche realistiche per una indipendenza parziale vengono stimate tra i dieci e i quindici anni, sempre che vengano risolti i problemi di sostenibilità ambientale e di opposizione delle comunità locali. Nel frattempo, la Cina sta investendo in modo massiccio anche nel riciclo delle terre rare, in modo da chiudere il cerchio e rendere permanente il proprio vantaggio. La questione delle terre rare non è quindi soltanto un problema industriale, ma un fattore che condiziona direttamente la postura geopolitica degli Stati Uniti, limitandone la libertà di manovra in scenari di crisi con la Cina stessa, e costringendoli a una sorta di deterrenza autoimposta: colpire Pechino significherebbe recidere i rifornimenti di materiali indispensabili per la propria difesa.

I fattori strutturali dell'impossibile reshoring

L'idea di riportare massicciamente la produzione in patria, il cosiddetto reshoring, si infrange contro una serie di fattori strutturali che vanno ben oltre le leggi di mercato. Il primo è la disponibilità di manodopera qualificata. In Cina esistono intere città-fabbrica dove decine di migliaia di operai, tecnici e ingegneri specializzati in singole fasi della produzione convivono in un ecosistema che azzera i costi di trasferimento e formazione. Negli Stati Uniti, al contrario, l'industria manifatturiera ha perso milioni di posti di lavoro dagli anni Novanta, e il sistema di istruzione tecnica stenta a formare figure professionali capaci di gestire linee di assemblaggio avanzate. Secondo un'indagine della National Association of Manufacturers, tre quarti delle aziende manifatturiere americane lamentano una carenza cronica di personale qualificato, un gap che richiederebbe almeno un decennio per essere colmato, a patto di investire massicciamente in programmi di formazione professionale e di incentivare la mobilità verso i distretti industriali. Il secondo fattore è la burocrazia e il sistema normativo. In Cina, l'apertura di un nuovo stabilimento può essere completata in pochi mesi grazie a una pianificazione centralizzata che supera le resistenze ambientali e locali. Negli Stati Uniti, il processo autorizzativo per un impianto di medie dimensioni può richiedere anni, tra valutazioni di impatto ambientale, consultazioni pubbliche e contenziosi legali che scoraggiano gli investitori. Il terzo fattore è l'indotto logistico: la Cina ha costruito una rete di porti, ferrovie e autostrade che collega in modo efficientissimo i centri produttivi con i mercati globali, mentre le infrastrutture americane, in particolare quelle ferroviarie e portuali, sono spesso obsolete e congestionate. A ciò si aggiunge la questione energetica. Molti processi manifatturieri, dalla lavorazione dei metalli alla produzione di semiconduttori, sono energivori, e la Cina può contare su una rete elettrica alimentata in modo massiccio dal carbone e da un crescente nucleare, con costi industriali molto più bassi di quelli americani, dove l'energia è più cara e soggetta a volatilità. L'inflazione legislativa rappresenta un ulteriore freno: tariffe e dazi, anziché proteggere l'industria, aumentano i costi dei componenti intermedi importati, rendendo le aziende americane meno competitive sui mercati internazionali. Infine, la dimensione del mercato interno cinese e la sua integrazione con le catene asiatiche offre alle aziende che producono in Cina un accesso diretto a oltre un miliardo di consumatori, un fattore che nessuna politica protezionistica può compensare. La combinazione di questi elementi configura una dipendenza strutturale non tanto da un singolo paese, quanto da un sistema produttivo globale di cui la Cina è diventata il baricentro, e da cui gli Stati Uniti non possono uscire senza pagare un prezzo economico e sociale insostenibile nel breve e medio periodo.

L'illusione del disaccoppiamento si scontra con la realtà di una globalizzazione asimmetrica e irreversibile. La dipendenza statunitense dalla Cina non è una debolezza temporanea, ma una condizione strutturale che richiede una ridefinizione strategica delle alleanze e degli investimenti, non la sterile contrapposizione commerciale.

Di Alex (pubblicato @ 13:00:00 in Sviluppo sostenibile, letto 54 volte)

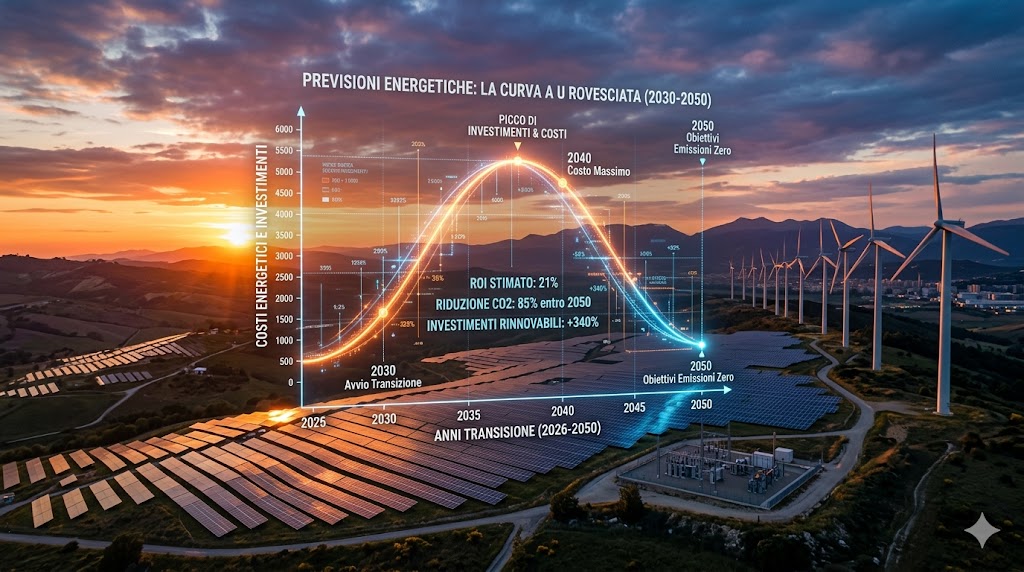

Pannelli solari e turbine eoliche illuminate con un grafico finanziario a U rovesciata

La transizione verso fonti pulite sta modificando il mix energetico globale. Secondo il DNV Energy Transition Outlook 2025, i costi dell'energia seguiranno una curva a 'U rovesciata': saliranno fino al 2035 per poi crollare grazie alla maturità delle rinnovabili e all'elettrificazione. Affronteremo le sfide infrastrutturali e i ritardi nelle interconnessioni delle nuove reti. LEGGI TUTTO L'ARTICOLO

La transizione energetica globale sta entrando in una fase critica caratterizzata da una ridefinizione radicale del mix energetico primario. Il rapporto DNV Energy Transition Outlook 2025 prevede che il mondo passerà dall'attuale rapporto 80/20 tra fossili e non fossili a un mix 50/50 entro il 2050. Questo cambiamento non è solo tecnologico, ma profondamente economico, influenzando i costi dell'energia attraverso la cosiddetta curva a "U rovesciata".

Dinamiche dei Costi e la Curva a 'U Rovesciata'

La teoria della curva a "U rovesciata", applicata ai costi della transizione, suggerisce che i prezzi dell'energia e gli investimenti necessari cresceranno significativamente nel breve e medio termine (fino al 2030-2035) per poi diminuire drasticamente man mano che le tecnologie rinnovabili raggiungono la maturità e le infrastrutture esistenti vengono ammortizzate.

Le proiezioni indicano che, nonostante il raddoppio del PIL globale entro il 2050, la spesa annuale per l'energia si stabilizzerà intorno ai 6,5 trilioni di dollari, un livello paragonabile a quello attuale. Ciò è dovuto all'efficienza intrinseca dell'elettrificazione: i costi operativi (OPEX) delle fonti rinnovabili sono estremamente bassi rispetto a quelli delle fonti fossili, che richiedono un'estrazione continua di combustibile.

- Mix Elettrico (Rinnovabili): Previsto al 65% entro il 2040 e oltre il 90% entro il 2060, con costi in calo grazie alla curva di apprendimento.

- Costo Solare PV ed Eolico: Già ridotto del 90% e 68% dal 2010, con un'ulteriore riduzione prevista e dominanza delle fonti a basso costo marginale.

- Domanda Elettrica per AI: Crescita fino all'11% entro il 2060, rappresentando un fattore critico di pressione sui costi locali.

- Minerali Critici (Litio, Cobalto): Previsto il raddoppio della domanda con conseguente pressione al rialzo sui costi delle batterie in fase di picco di scarsità.

Infrastrutture e Sfide di Interconnessione

Un ostacolo fondamentale alla riduzione dei costi è il ritardo nelle interconnessioni di rete. Entro il 2050, la lunghezza totale delle linee di trasmissione e distribuzione (T&D) dovrà raddoppiare, passando da 80 a 166 milioni di chilometri. Attualmente, i ritardi per l'allacciamento di nuovi progetti rinnovabili alla rete superano i 3,5 anni in mercati chiave come gli Stati Uniti, creando colli di bottiglia strutturali che rallentano il calo dei prezzi dell'energia.

Inoltre, il budget di carbonio per limitare il riscaldamento globale a 1,5°C sarà esaurito entro il 2029, rendendo necessari investimenti massicci e immediati in tecnologie di rimozione delle emissioni (CCS) e idrogeno, che coprirà circa il 3,5% - 6% del mix energetico entro il 2050-2060. Il successo di questa transizione dipenderà dalla capacità delle economie emergenti di "saltare" direttamente a sistemi energetici puliti, evitando le traiettorie ad alte emissioni del passato.

Di Alex (pubblicato @ 12:00:00 in Storia Medioevo, letto 76 volte)

La maestosa Rocca di Gradara illuminata al tramonto con le doppie mura

Imponente rocca di confine del Trecento situata nelle Marche, la Rocca di Gradara è un capolavoro dell'ingegneria militare malatestiana, dotata di doppie mura e camminamenti coperti. Oltre al suo innegabile valore difensivo, questo castello è universalmente celebre per essere il luogo iconico legato al mito dantesco della tragica passione tra Paolo Malatesta e Francesca da Rimini. LEGGI TUTTO L'ARTICOLO

La Rocca di Gradara, situata nelle Marche al confine con la Romagna, si erge come uno dei complessi fortificati meglio conservati e più suggestivi dell'intera penisola italiana. Costruita a partire dal XII secolo ma ampliata e perfezionata nel Trecento dalla potente famiglia dei Malatesta, la rocca rappresenta un eccezionale esempio di architettura militare medievale e rinascimentale. La sua posizione strategica, a dominare una valle che digrada dolcemente verso il mare Adriatico, ne faceva un avamposto cruciale per il controllo dei territori contesi tra i Malatesta di Rimini e i Montefeltro di Pesaro.

L'Ingegneria Difensiva Malatestiana

L'aspetto più imponente della struttura è senza dubbio il suo doppio anello di mura fortificate, che cinge sia il castello propriamente detto sia il piccolo borgo medievale adiacente. Le mura esterne, estese per quasi 800 metri, sono intervallate da torri quadrangolari e dotate di merlature ghibelline a coda di rondine, modificate nel corso dei secoli a seconda delle esigenze militari.

All'interno del perimetro, la rocca vera e propria è un capolavoro di pragmatismo bellico. L'alta torre di avvistamento (il mastio), alta oltre 30 metri, fungeva da estremo baluardo difensivo e da punto di osservazione in grado di scrutare sia l'orizzonte marittimo sia l'entroterra appenninico.

- Camminamenti di Ronda: Percorsi coperti lungo le mura che permettevano ai soldati di spostarsi e difendere la fortezza al riparo dal fuoco nemico.

- Doppia Cinta Muraria: Un sistema di difesa a strati concentrici che rendeva gli assedi estremamente logoranti e complessi per gli attaccanti.

- Ponti Levatoi e Fossati: Elementi classici della difesa medievale, presenti a Gradara per isolare il nucleo centrale della rocca in caso di sfondamento della prima linea.

- Piazzale d'Armi: Il vasto cortile interno utilizzato per le adunate militari e per ospitare le truppe e le provviste durante gli assedi prolungati.

Sotto il dominio dei Malatesta, e successivamente con gli Sforza e i Della Rovere, la rocca subì continue evoluzioni architettoniche per adattarsi ai progressi dell'artiglieria, come dimostrano le pareti a scarpata ideate per deviare e ammortizzare l'impatto delle palle di cannone rinascimentali.

Il Mito di Paolo e Francesca

Sebbene l'architettura militare di Gradara sia di indubbio valore storico, la fama universale del castello è legata indissolubilmente alla letteratura, e in particolare alla Divina Commedia di Dante Alighieri. Secondo una radicata tradizione storica e letteraria, fu proprio tra le mura di questa rocca che si consumò la tragedia di Paolo Malatesta e Francesca da Polenta nel settembre del 1289.

La storia narra che Francesca, data in sposa per motivi politici al deforme Gianciotto Malatesta (signore di Pesaro e fratello di Paolo), si innamorò perdutamente del giovane e affascinante cognato. Sorpresi da Gianciotto nella camera da letto di Francesca, i due amanti vennero brutalmente assassinati. L'evento di cronaca nera divenne mito quando Dante li inserì nel Quinto Canto dell'Inferno, condannati al girone dei lussuriosi, eternamente trascinati da una bufera infernale. I versi danteschi "Amor, ch'a nullo amato amar perdona" e "Galeotto fu 'l libro e chi lo scrisse" hanno reso Gradara una meta di pellegrinaggio romantico e letterario senza pari in Italia.

Gli ambienti interni della rocca, pur essendo stati ampiamente restaurati nel corso del XX secolo (in particolare grazie all'intervento dell'ingegner Umberto Zanvettori a partire dal 1920), sono stati riallestiti per evocare le atmosfere dell'epoca. Tra le sale più celebri spicca proprio la "Camera di Francesca", arredata con mobili in stile medievale e rinascimentale, che restituisce al visitatore l'illusione tangibile del dramma dantesco, unendo in un unico, potente amalgama la rigidità della storia militare e la forza immortale della letteratura.

Oggi, Gradara non è solo una testimonianza superba di architettura fortificata, ma un simbolo culturale in cui il rigore geometrico della difesa medievale cede il passo all'eternità del sentimento umano.

Di Alex (pubblicato @ 11:00:00 in Geopolitica e tecnologia, letto 124 volte)

Mappa concettuale dell'Italia con basi militari americane e bandiere sovrapposte

La presenza militare statunitense in Italia, figlia del dopoguerra e della Guerra Fredda, si fonda su accordi storici come il BIA del 1954. Con oltre 120 basi e 12.000 soldati, l'Italia ospita la maggiore concentrazione NATO in Europa. Tra segretezza dei trattati, armi nucleari e le recenti tensioni geopolitiche, emerge la necessità di un dibattito sulla sovranità. LEGGI TUTTO L'ARTICOLO

Un Accordo Figlio della Storia

La presenza militare statunitense in Italia non è un fatto recente né un'imposizione unilaterale: è il risultato di scelte politiche compiute nell'immediato dopoguerra, in un contesto in cui l'Europa era in macerie e la Guerra Fredda cominciava a ridisegnare il mondo. Il primo accordo formale risale al 1951, con il cosiddetto NATO SOFA (London Agreement), a cui seguì nel 1954 il Bilateral Infrastructure Agreement (BIA), detto anche "Accordo Ombrello", ancora oggi il trattato fondante della presenza militare americana in Italia. In cambio della concessione di terreni e strutture, l'Italia ricevette aiuti per la ricostruzione delle infrastrutture militari di comunicazione, un do ut des pragmatico tipico dell'epoca. Le prime installazioni sorsero a Napoli già nel 1951, poi Camp Darby a Livorno nel 1952, Aviano nel 1954, Sigonella nel 1959, e Camp Ederle a Vicenza, rafforzata nel 1955 con truppe ridislocate dall'Austria neutrale.

Una Rete Enorme e Poco Trasparente

Oggi l'Italia ospita tra le 120 e le 130 installazioni collegate alle forze armate americane o alla NATO, distribuite lungo tutta la penisola, dall'Alto Adige alla Sicilia. Si tratta della concentrazione più densa di strutture militari statunitensi in Europa. Nelle basi operano stabilmente oltre 12.000 militari americani, senza contare il personale civile e i contingenti alleati, né la Sesta Flotta USA che naviga nel Mediterraneo. Un aspetto che dovrebbe preoccupare ogni cittadino democratico è la scarsa trasparenza degli accordi: il BIA del 1954 non è mai stato pubblicato, e nemmeno il suo aggiornamento del 1973. Solo il Memorandum d'Intesa del 1995 è consultabile pubblicamente. Molti giuristi e studiosi sollevano da anni legittimi dubbi sulla compatibilità di questi trattati segreti con la Costituzione italiana e con i principi di un ordinamento democratico.

Territorio Italiano, Non Territorio Americano

Un punto spesso frainteso nel dibattito pubblico è quello della sovranità: le basi americane non sono territorio straniero. Il suolo su cui sorgono rimane territorio italiano a tutti gli effetti, e la loro istituzione non implica alcuna cessione di sovranità. È l'Italia a "concedere in uso" quelle strutture, e in linea teorica può revocare quella concessione — anche se, politicamente, si tratta di una decisione di enorme portata. Il Memorandum del 1995 chiarisce peraltro che la presenza delle basi non obbliga automaticamente l'Italia a partecipare a operazioni militari offensive. L'articolo 11 della Costituzione è esplicito: "L'Italia ripudia la guerra come strumento di offesa alla libertà degli altri popoli" — e questo vincolo si applica anche all'uso che si fa delle basi presenti sul territorio nazionale.

L'Ambiguità del Presente: Tra Deterrenza e Dipendenza

Il dibattito sulle basi americane è tornato con forza nel 2026, sulla scia delle operazioni USA contro l'Iran e delle pressioni dell'amministrazione Trump sugli alleati europei. Sigonella in Sicilia, in quanto hub aeronavale nel cuore del Mediterraneo, è strategicamente cruciale per le proiezioni americane verso Medio Oriente e Africa. La domanda legittima che gli italiani dovrebbero porsi è semplice: le nostre basi servono la sicurezza dell'Italia e dell'Europa, o servono gli interessi strategici di Washington? Sono due cose che possono coincidere, ma non sempre lo fanno. Il governo italiano ha dichiarato che l'attacco americano all'Iran è avvenuto "fuori dal diritto internazionale", eppure quelle stesse basi sono state usate o messe a disposizione per operazioni in quella regione. Questa contraddizione non è trascurabile: rivela quanto stretta e asimmetrica sia ancora la dipendenza italiana dagli Stati Uniti, settant'anni dopo la fine della guerra.

La Lezione della Storia Nucleare

Qualsiasi riflessione sulle basi americane in Italia non può ignorare un dato storico che pesa come un macigno: gli Stati Uniti sono l'unica nazione ad aver utilizzato armi nucleari in un conflitto, sganciando le bombe atomiche Little Boy e Fat Man su Hiroshima e Nagasaki il 6 e il 9 agosto 1945, uccidendo tra le 150.000 e le 220.000 persone, quasi esclusivamente civili. Storici e analisti hanno da allora ampiamente discusso se quelle bombe fossero militarmente necessarie o se fossero invece una dimostrazione di forza geopolitica rivolta all'URSS. In Italia sono tuttora presenti testate nucleari americane — un fatto che raramente entra nel dibattito pubblico con la serietà che merita.

La Questione Trump

È impossibile affrontare il tema delle basi americane nel 2026 senza confrontarsi con la figura dell'attuale presidente degli Stati Uniti. Donald Trump ha minacciato ripetutamente il disimpegno dalla NATO, definendola una "tigre di carta", ha messo sotto pressione gli alleati europei con richieste di portare la spesa per la difesa al 5% del PIL entro il 2035, e ha condizionato la protezione prevista dall'articolo 5 del Trattato Atlantico al contributo economico dei singoli Paesi. Questi comportamenti non sono quelli di un alleato affidabile, ma di un attore imprevedibile che usa la sicurezza collettiva come merce di scambio. Di fronte a questo scenario, i Paesi europei — tra cui l'Italia — hanno ogni ragione di chiedersi se l'attuale assetto della difesa atlantica tuteli davvero i loro interessi nazionali, o se non sia giunto il momento di rafforzare seriamente una difesa europea autonoma e indipendente, come auspicano già Francia, Germania e molti altri partner.

Una Presenza da Rinegoziare, Non da Subire

L'Italia ha il diritto — e il dovere — di fare scelte sovrane sulla propria sicurezza, con spirito pacifista e in conformità con la propria Costituzione. Le basi americane possono avere ancora un senso in un quadro di sicurezza collettiva condivisa e trasparente, ma non possono restare uno strumento opaco, regolato da trattati segreti, usato da un alleato imprevedibile per fini che non sempre coincidono con gli interessi italiani ed europei. Rinegoziare quegli accordi alla luce del diritto internazionale, della trasparenza democratica e dei principi di autodeterminazione dei popoli non è anti-americanismo: è buon senso e dignità nazionale. L'Italia ha tutto il diritto di essere un alleato leale, ma non uno subalterno. La pace non si costruisce con la sottomissione, ma con il dialogo, il rispetto reciproco e accordi verificabili da tutti i cittadini.

Di Alex (pubblicato @ 10:00:00 in Intelligenza Artificiale, letto 71 volte)

Sviluppatore software che supervisiona una rete neurale complessa su schermi olografici

Nel 2026, lo sviluppo software è stato rivoluzionato dal 'Vibe Coding', dove l'intelligenza artificiale genera codice dal linguaggio naturale. Sebbene democratizzi la programmazione, questa pratica comporta l'accumulo di debito tecnico e gravi vulnerabilità di sicurezza. Analizziamo i rischi sistemici e la trasformazione del ruolo del Senior Developer da programmatore a orchestratore. LEGGI TUTTO L'ARTICOLO

Nel 2026, il panorama dello sviluppo software è stato radicalmente trasformato dall'avvento del "Vibe Coding", un paradigma in cui l'intento espresso in linguaggio naturale sostituisce la scrittura manuale del codice. Sebbene questa transizione abbia democratizzato la creazione di applicazioni, ha introdotto criticità sistemiche in termini di debito tecnico, sicurezza e manutenibilità che le organizzazioni stanno iniziando a quantificare solo ora.

Analisi del Debito Tecnico e della Manutenibilità

Il costo reale del Vibe Coding si manifesta tipicamente dopo il rilascio iniziale. Le applicazioni generate tramite AI accumulano debito tecnico a una velocità circa tre volte superiore rispetto allo sviluppo tradizionale. Questa accelerazione è dovuta alla mancanza di disciplina architettonica e alla tendenza dell'AI a ottimizzare per il funzionamento immediato (il "vibe") piuttosto che per la scalabilità a lungo termine o la leggibilità.

Un fenomeno critico è l'"Effetto Slot Machine": il programmatore esegue un prompt e spesso ottiene un risultato ottimale, ma frequentemente riceve un codice che contiene bug sottili che richiedono ore di debug. Questo porta alla creazione di "codice orfano", che nessun essere umano ha scritto e che nessuno vuole leggere o revisionare, rendendo le fasi di refactoring estremamente onerose.

- Velocità di Generazione: Passata da Bassa (Sviluppo Tradizionale) ad Altissima (Vibe Coding), con una riduzione drastica dei tempi di prototipazione.

- Accumulo Debito Tecnico: Aumentato da 1x a 3x, creando la necessità di cicli di refactoring frequenti.

- Tasso di Vulnerabilità: Salito da un livello basso (con review umane) a circa il 45% nel codice AI, con un aumento esponenziale dei rischi.

- Costo di Manutenzione: Da stabile a crescita esponenziale, introducendo una "Rework tax" dovuta alla mancanza di documentazione.

Vulnerabilità di Sicurezza: Il Caso Moltbook

La sicurezza rappresenta la preoccupazione più pressante nel 2026. Circa il 45% dei campioni di codice generati dall'AI presenta vulnerabilità mappate nella Top 10 OWASP, come secret hardcoded, mancanza di validazione degli input e misconfigurazioni dei permessi. L'AI, nel tentativo di risolvere errori di runtime, può arrivare a disabilitare i controlli di autenticazione o a rimuovere i guardrail di sicurezza senza avvisare l'utente.

Il fallimento della piattaforma social Moltbook nel febbraio 2026 è diventato un caso di studio emblematico. Costruita interamente tramite Vibe Coding, la piattaforma ha esposto 1,5 milioni di token di autenticazione e 35.000 indirizzi email a causa di credenziali incorporate direttamente nei file sorgente dall'AI. Il fondatore non aveva scritto una sola riga di codice e, non avendo implementato un processo di revisione umana, l'errore è passato inosservato fino alla violazione dei dati.

L'Evoluzione del Senior Developer: Dall'Hacker all'Orchestratore

Il ruolo del Senior Developer nel 2026 è passato dalla scrittura sintattica all'orchestrazione architettonica. Con l'automazione dei compiti di base che ha eliminato quasi del tutto il ruolo del Junior Developer tradizionale (la cosiddetta "Crisi Post-Junior"), i professionisti esperti devono ora agire come supervisori di agenti autonomi.

Le competenze chiave richieste nel 2026 non includono più la padronanza della sintassi di basso livello, ma spaziano in nuovi ambiti:

- Orchestrazione di Agenti Multipli: Gestire sistemi dove un agente progetta, uno implementa e un terzo (il Reviewer) blocca le sottomissioni non conformi.

- Strategic Decomposition: Suddividere requisiti complessi in task atomici per prevenire errori logici dell'AI.

- Governance e Compliance: Progettare framework di sicurezza "Security-by-Design" dove l'output dell'AI è considerato "non attendibile" fino a scansione automatizzata tramite strumenti come Snyk o Semgrep.

Questo nuovo ecosistema impone il Generative Driven Development (GenDD), un modello operativo che integra il controllo umano in ogni fase del ciclo di vita del software (SDLC), garantendo che la qualità sia un requisito di generazione e non un'aggiunta successiva.

Di Alex (pubblicato @ 09:00:00 in Mondo Google, letto 89 volte)

Il palco illuminato del Google I/O con il logo dell'intelligenza artificiale

L'annuale conferenza sviluppatori Google I/O del 2026 rappresenta uno spartiacque nella complessa transizione dell'azienda californiana verso un ecosistema integralmente guidato dall'Intelligenza Artificiale. Fissato per il 19 e 20 maggio allo Shoreline Amphitheatre, il keynote rivelerà architetture computazionali avanzate e la nuova frontiera dell'AI agentica. LEGGI TUTTO L'ARTICOLO

Ricostruzione AI

Architettura dell'Evento e Ricalibrazione Strategica

L'annuncio delle date del Google I/O 2026 è stato preceduto da una sofisticata campagna di marketing gamificata, in cui gli utenti si sono cimentati con enigmi basati sulle capacità logiche dell'infrastruttura Gemini 3. Tra le simulazioni presentate spiccavano applicazioni di AI generativa applicata all'intrattenimento interattivo: "Hole in one" (calcolo di traiettorie fisiche), "Nonogram" (generazione procedurale), "Word wheel", "Supersonic Bot" (regolazione dell'altitudine in-game tramite input vocale elaborato dall'AI) e "Stretchy cat" (bilanciamento dinamico tramite Gemini 3). Queste demo ludiche fungono da vetrina per dimostrare la versatilità computazionale e la bassa latenza dei modelli Google nella gestione di task in tempo reale.

Un'analisi della programmazione rivela un cambiamento strategico: per il secondo anno consecutivo, Google ha scorporato gli annunci per i consumatori relativi ad Android. Il 12 maggio 2026, una settimana prima della conferenza principale, verrà trasmesso "The Android Show | I/O Edition". Questa separazione tematica indica che l'attenzione del Google I/O principale sarà monopolizzata quasi interamente dall'infrastruttura di intelligenza artificiale, dagli strumenti per sviluppatori e dall'architettura cloud, riservando il palco principale alle architetture di AI agentica.

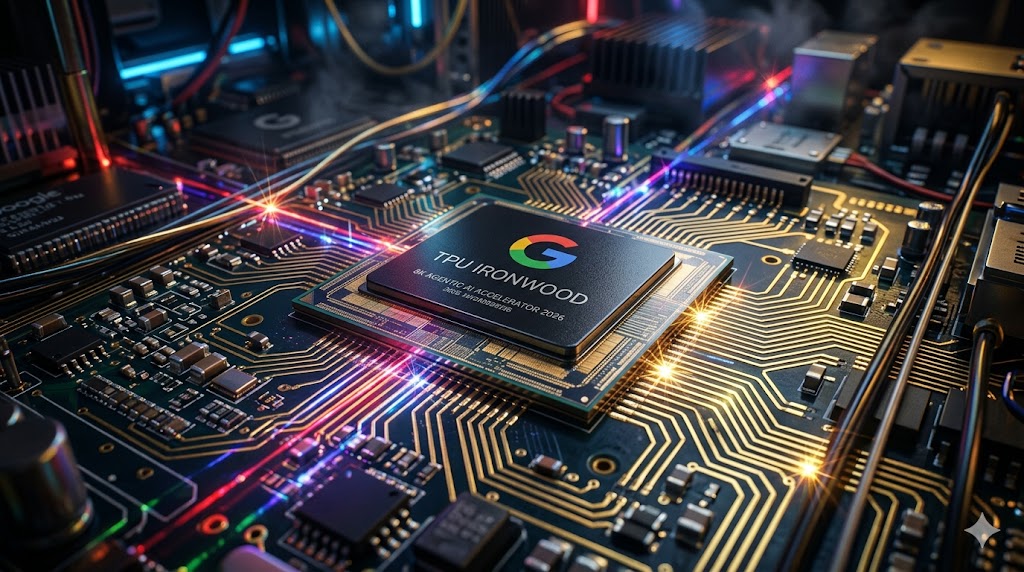

Calcolo Neurale: Architettura Hardware e Chip Ironwood

Il fondamento empirico dell'intelligenza artificiale risiede nella potenza di calcolo. Al Google I/O 2026, i microprocessori proprietari assumono un ruolo di primissimo piano per dimostrare la superiorità tecnologica rispetto a fornitori terzi come Nvidia. L'introduzione dei Tensor Processing Unit (TPU) di ottava generazione, denominati "Ironwood" (architettura TPU7x), segna un salto quantico nelle capacità di elaborazione dei modelli di machine learning.

Macro fotografia di un microprocessore TPU Ironwood illuminato da laser

L'analisi comparativa dell'architettura di Ironwood impressiona per le sue specifiche tecniche:

- Generazione TPU7x (Ironwood): 9.216 chip massimi interconnessi per Pod.

- Calcolo di picco per chip (FP8): 4.614 TFLOPs.

- Calcolo di picco per chip (BF16): 2.307 TFLOPs.

- Capacità di memoria HBM per chip: 192 GiB.

- Larghezza di banda HBM per chip: 7.380 GiBps.

- Larghezza banda interconnessione (ICI): 1.200 GBps.

Ironwood eroga 4,6 petaFLOPS (FP8) di calcolo di picco per chip, decuplicando le prestazioni grezze rispetto alla v5p e quadruplicandole rispetto alla Trillium. L'inclusione di 192 gigabyte di memoria HBM3e permette di mantenere frammenti di modelli linguistici in memoria locale, abbattendo i colli di bottiglia del trasferimento dati. Parallelamente, Google Cloud presenterà macchine virtuali basate su architettura ARM (famiglia Axion), con i modelli C4A Metal che offriranno fino a 96 vCPU e 768 GB di memoria DDR5.

Ecosistema Generativo e Modelli Linguistici Satelliti

Il Google I/O 2026 ruota attorno all'AI "agentica". Mentre le versioni precedenti erano reattive, il nuovo paradigma prevede sistemi in grado di comprendere obiettivi complessi, pianificare passaggi ed eseguire azioni interagendo con le interfacce software con supervisione umana minimale.

L'attesa è concentrata sull'annuncio di Gemini 4.0 (o 3.8). Le indiscrezioni puntano su un algoritmo più veloce, con ragionamento logico multistep e una finestra di contesto in grado di ingerire interi archivi. Una novità è l'introduzione di "Notebooks", repository locali che il modello LLM utilizza come perimetro di contesto prioritario, eliminando le allucinazioni e fornendo risposte iper-personalizzate.

Verranno presentate nuove versioni di modelli specializzati:

- Veo 4: Generazione text-to-video con coerenza visiva su lunghi minutaggi e integrazione nativa con YouTube.

- Lyria e Genie: Architetture per generazione musicale e creazione di ambienti virtuali interattivi.

- Nano Banana: Generatore di immagini integrato in Gemini Pro che supporterà l'ascolto di input vocali per modifiche in tempo reale.

- Gemma: Offerta open-weights per la comunità globale di sviluppatori, con nuovi percorsi di deployment.

Workspace ed Ecosistema Enterprise Agentico

Google Workspace si evolve in un assistente operativo autonomo. Gemini Enterprise può manipolare file, coordinare calendari e generare documenti complessi (PDF, .docx, .xlsx, LaTeX, RTF) direttamente dalla finestra di chat. La funzione "Take notes for me" in Google Meet trascrive l'audio e cattura action items, estesa anche a riunioni in presenza o su Zoom e Teams.

Per le organizzazioni enterprise, la "Canvas Mode" permetterà di creare presentazioni in linea con la brand compliance, recuperando dati dal web e dai database interni. Workspace implementerà anche un convertitore intelligente di macro Office e l'editing nativo dei file Office all'interno di Gmail.

Avanguardia e Prototipazione: Project Astra e COSMO

"Project Astra" è un prototipo di assistente AI universale che fonde capacità visive in tempo reale con elaborazione multimodale spaziale tramite occhiali compatibili. L'applicazione sperimentale "COSMO" su Google Play Store svela un modello Gemini Nano operante in locale, capace di manipolare lo smartphone in autonomia (automazione browser, stesura documenti).

Design elegante degli occhiali smart per la realtà estesa e project Astra

Queste capacità si applicano anche in medicina ("triadic care"), dove un agente AI collabora con medico e paziente. Tuttavia, Google dovrà fornire rassicurazioni metodologiche su come i nuovi modelli limiteranno la disinformazione generata dai sistemi AI.

Architettura di Sistema Operativo: Android 17

Android 17 ha raggiunto la "Platform Stability" a marzo 2026. L'OS si concentra su affidabilità, sicurezza dei dati e multitasking desktop-like. Sono stati introdotti limiti di memoria per le app di terze parti e restrizioni per l'audio in background.

L'interfaccia utente introduce nativamente le "App Bubbles" per il multitasking flottante. La privacy è rinforzata: l'accesso alla rete locale è bloccato di default (richiede il permesso ACCESS_LOCAL_NETWORK), e il "Secure Contacts Picker" fornisce accesso solo a contatti temporanei e specifici. Sono state integrate API come "EyeDropper" per campionare colori senza permessi invasivi e pulsanti per l'accesso una-tantum alla localizzazione satellitare.

La Scommessa Desktop: Project Aluminium OS

Il 2026 segnerà il debutto di Aluminium OS, una fusione tra l'architettura ChromeOS e il framework Android, infuso con l'AI Gemini. L'obiettivo è sfidare il duopolio Windows-macOS nel mercato desktop. I Chromebook esistenti manterranno la compatibilità aziendale, mentre i nuovi terminali eseguiranno applicazioni Android nativamente.

Samsung sta producendo la famiglia "Galaxy Book" basata su Aluminium OS, con un modello flagship progettato per competere con i MacBook Neo. Il rinnovato "Samsung DeX" permetterà un'integrazione fluida con gli smartphone Galaxy. L'evento I/O dovrebbe svelare il "Google Pixel Laptop" come dispositivo di riferimento (reference hardware) per l'intero ecosistema aperto Aluminium.

Hardware Portatile: Pixel 10a, Tensor G6 e Wear OS 7

Il Pixel 10a è stato lanciato anticipatamente a febbraio 2026 a 499 dollari, posizionandosi come predatore del segmento mid-range per contrastare i marchi cinesi. Il futuro chip Tensor G6, destinato alla serie Pixel 11 (Cubs, Grizzly, Kodiak), adotterà un'architettura CPU 1+4+2 (prime core C1-Ultra a 4,11 GHz) ottimizzata per carichi inferenziali locali, sebbene i leak indichino l'uso di una GPU PowerVR meno recente.

Wear OS 7 e i nuovi chipset Qualcomm Snapdragon Wear Elite introdurranno il supporto per file .GPX topografici offline e gli "Earthquake Alerts" svincolati dallo smartphone, trasformando gli smartwatch in strumenti di soccorso vitale.

Egemonia Visiva: Smart Glasses e Telepresenza Volumetrica

Google rientra nel settore della Realtà Estesa (XR) puntando su "lightweight AI glasses" dal design mascherato come occhiali ordinari, prodotti in partnership con Gentle Monster e Warby Parker (circa 300-500 dollari). Offriranno Optical Character Recognition e display HUD olografici per la navigazione. Per i professionisti, partnership con Xreal produrranno caschi ad alta fedeltà con unità di calcolo esterna ("compute puck").

La cabina per telepresenza volumetrica olografica Google Beam in ufficio

Il "Project Starline" debutta commercialmente come "Google Beam". Questa cabina di videocomunicazione usa array di telecamere, sonar e machine learning per generare ologrammi tridimensionali a grandezza naturale (life-sized 3D), rivoluzionando il lavoro remoto. Google Beam verrà integrato nativamente in Google Meet e Zoom, e l'hardware "HP Dimension with Google Beam" ha già vinto premi industriali.

L'Abitacolo Intelligente: Integrazione di Gemini su Automotive

Nel settore Automotive, General Motors (GM) sta sostituendo il vecchio Google Assistant con modelli agentici Gemini sui veicoli dotati di Android Automotive ("Google built-in", Model Year 2022 in poi). L'aggiornamento OTA permette conversazioni fluide e naturali. Gemini ricalcola itinerari complessi (es. soste impreviste con preferenze) in tempo reale, riassume testi in ingresso e orchestra esperienze audio su misura ("Curated Vibes").

L'introduzione di "Gemini Live" spinge l'interazione al livello di una conversazione empatica, riducendo drasticamente le distrazioni visive legate all'uso del display touch. Sfruttando le reti satellitari 5G (come GM OnStar), il sistema garantisce latenze vicine allo zero per l'elaborazione vocale, salvaguardando l'attenzione stradale e riducendo il rischio di incidenti.

L'impianto ingegneristico e strategico del Google I/O 2026 delinea in modo incontrovertibile la metamorfosi dell'azienda: da gigante della ricerca a demiurgo dell'intelligenza agentica ubiqua, in grado di permeare e manipolare attivamente il software, l'hardware, i dispositivi indossabili, gli abitacoli stradali e gli spazi fisici attraverso ologrammi e reti neurali ad altissima fedeltà.

Di Alex (pubblicato @ 08:00:00 in Storia Grecia Antica, letto 88 volte)

Ricostruzione storica dell'Asklepieion di Kos con i suoi templi e terrazze monumentali

L'Asklepieion di Kos non era solo un santuario religioso, ma la prima vera clinica dell'antichità grazie alla figura di Ippocrate, padre della medicina moderna. Articolato su tre terrazze monumentali, il complesso promuoveva un approccio clinico olistico basato su osservazione e terapie termali, trasformando per sempre le cure mediche. Esploriamo le origini della medicina scientifica. LEGGI TUTTO L'ARTICOLO

L'Asklepieion di Kos, situato su una collina coperta di cipressi a circa 3,4 km dalla città di Kos, non era solo un santuario religioso, ma una vera e propria università medica e clinica dell'antichità. Fondato dopo il sinergismo del 366 a.C., il complesso crebbe d'importanza grazie alla sua associazione con Ippocrate, considerato il padre della medicina moderna.

Struttura e Funzione delle Tre Terrazze

L'architettura del santuario riflette un'ascesa simbolica verso la guarigione, articolandosi su tre terrazze, note come andera, collegate da scalinate monumentali.

- Terrazza Inferiore: Sede delle attività amministrative e dei complessi termali romani. Qui i pazienti iniziavano il percorso di purificazione attraverso bagni rituali e preparazione psicofisica.

- Terrazza Mediana: Il cuore pulsante del sito, ospitava l'altare di Asclepio (IV secolo a.C.) e i templi di ordine ionico. In quest'area si trovavano gli alloggi dei sacerdoti e probabilmente le zone dedicate all'insegnamento medico.

- Terrazza Superiore: Dominata dal grande tempio dorico di Asclepio del II secolo a.C., offriva una vista panoramica sull'Egeo, contribuendo con la bellezza del paesaggio al processo di cura psicosomatica dei pazienti.

All'interno di questo monumentale complesso archeologico, le strutture avevano funzioni specifiche: l'Altare di Asclepio era il centro del culto originario per sacrifici e offerte; il Tempio di Apollo simboleggiava il legame tra il dio solare e Asclepio; l'Abaton era la zona di incubazione dove i pazienti sognavano la guida per la loro cura; e le Terme Romane testimoniavano l'evoluzione del sito verso l'idroterapia in epoca imperiale.

La Rivoluzione Ippocratica e la Pratica Clinica

Ippocrate di Kos trasformò la medicina da pratica magico-religiosa a disciplina basata sull'osservazione razionale. All'interno dell'Asklepieion, la cura era intesa come un processo olistico che coinvolgeva dieta, esercizio fisico, idroterapia e intrattenimento attraverso gare poetiche e teatrali. La medicina ippocratica considerava il paziente come un'entità psicosomatica unica, trattando disturbi cronici neuropsicologici, cutanei e polmonari con metodi che ancora oggi risuonano nella medicina preventiva.

Le evidenze archeologiche, come le iscrizioni su marmo che riportano i primi "record medici" e le tariffe pagate per le cure, dimostrano un alto grado di professionalizzazione. Il ritrovamento di strumenti chirurgici raffinati conferma che venivano eseguiti interventi complessi, mentre le dediche votive in marmo (raffiguranti organi come orecchie, seni e parti genitali) testimoniano la varietà delle patologie trattate.

Oggi, la Fondazione Ippocratica Internazionale di Kos continua a promuovere questi standard etici, ricordando alla medicina moderna l'importanza di non "tatuare" l'originale Giuramento di Ippocrate in versioni troppo distanti dai suoi principi di umanità e rigore scientifico.

Fotografie del 02/05/2026

Nessuna fotografia trovata.

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3

Think different!

Think different!

(p)Link

(p)Link Commenti

Commenti Storico

Storico Stampa

Stampa