\\ Home Page : Articolo

HANNO SUPPORTATO DIGITAL WORLDS INVIANDO PRODOTTI DA RECENSIRE

|

|

|

|

|

Le macchine che hanno imparato a leggere: i segreti dell'architettura Transformer

Di Alex (del 08/05/2026 @ 10:00:00, in Intelligenza Artificiale, letto 52 volte)

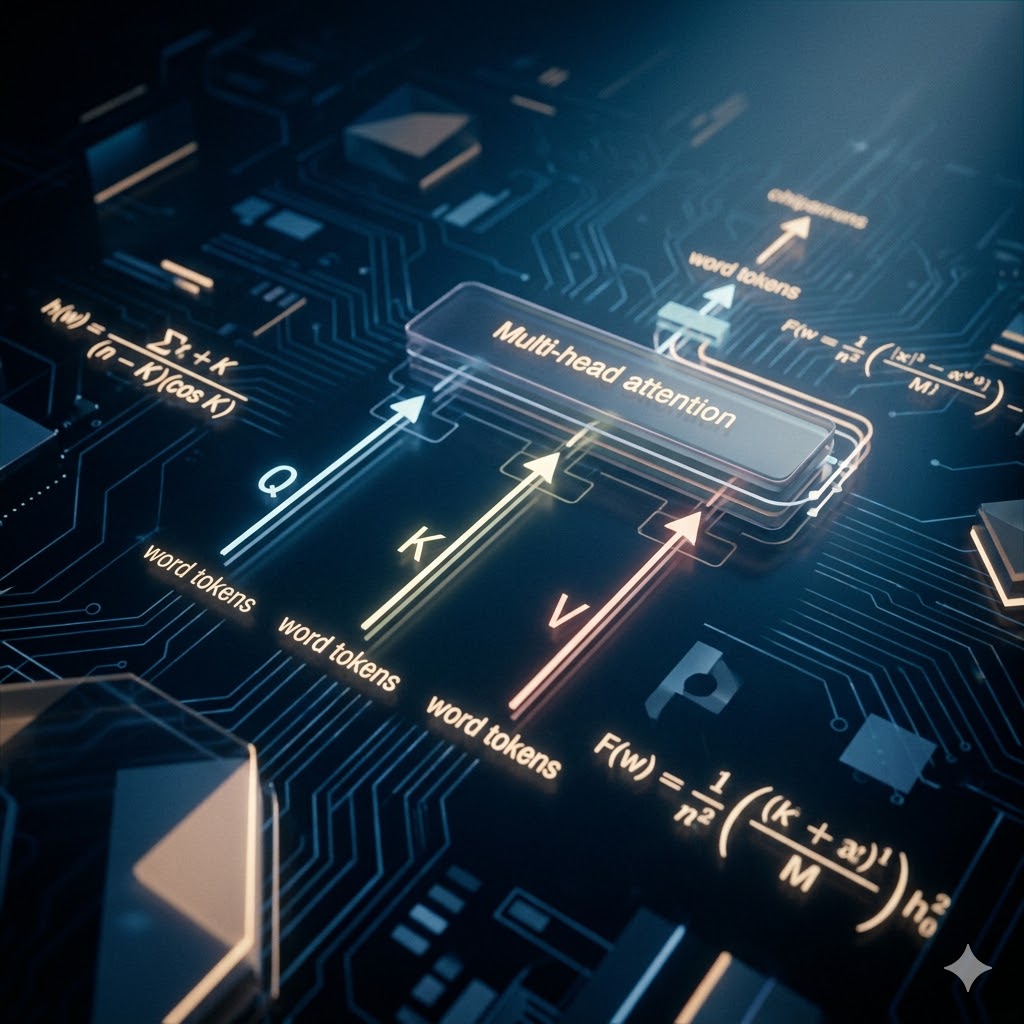

Schema multi‑testa dell'attenzione e flusso dei vettori Q,K,V

La comprensione del linguaggio naturale da parte dei sistemi informatici ha subito una metamorfosi radicale, abbandonando gli approcci di decifrazione puramente statistica a favore di un paradigma di elaborazione contestuale avanzata. Il fondamento filosofico di questa rivoluzione può essere rintracciato nel pensiero di Ludwig Wittgenstein: il significato di una parola coincide con il suo uso all'interno del linguaggio. LEGGI TUTTO L'ARTICOLO

Ricostruzione AI

Il tramonto delle reti ricorrenti e la nascita dell'attenzione

Sino alla fine del secondo decennio del Duemila, l'elaborazione automatica del linguaggio naturale, nota con l'acronimo NLP, era dominata da architetture di rete neurale che tentavano di mimare, seppur grossolanamente, la lettura sequenziale umana. Le Reti Neurali Ricorrenti, nelle loro varianti Long Short‑Term Memory e Gated Recurrent Unit, processavano il testo parola dopo parola, mantenendo uno stato interno che fungeva da memoria a breve termine. Questo approccio, benché rivoluzionario rispetto ai semplici modelli a n‑grammi, mostrava crepe sempre più evidenti non appena la lunghezza delle frasi superava qualche decina di token. Il fenomeno del gradiente evanescente, già descritto da Sepp Hochreiter nel 1991, impediva di fatto alle RNN di propagare efficacemente l'errore all'indietro su sequenze molto estese, cosicché le dipendenze sintattiche a lunga distanza – come l'accordo di un verbo con un soggetto posto all'inizio di un lungo periodo o il riferimento di un pronome a un'entità nominata molti capoversi prima – venivano regolarmente smarrite. A ciò si aggiungeva un collo di bottiglia computazionale intrinseco: la natura sequenziale impediva la parallelizzazione, rendendo l'addestramento su corpora di miliardi di parole proibitivamente lento anche disponendo di cluster di GPU. Le Reti Convoluzionali applicate al testo, pur introducendo un embrione di elaborazione in parallelo tramite kernel che scandivano n‑grammi locali, non riuscivano a superare il problema del contesto globale, poiché il loro campo recettivo rimaneva limitato alla finestra del filtro. Fu in questo scenario che nel 2017 un gruppo di ricercatori di Google Brain, guidati da Ashish Vaswani, pubblicò il lavoro destinato a ridisegnare il panorama: “Attention Is All You Need”. Il titolo, quasi programmatico, annunciava l'abolizione di ogni forma di ricorrenza a favore di un unico meccanismo, l'attenzione, capace di modellare relazioni tra qualsiasi coppia di parole in una frase con un costo computazionale costante. L'architettura Transformer si regge su due pilastri: la codifica posizionale e la self‑attention multi‑testa. La prima serve a iniettare nel modello l'informazione sull'ordine delle parole, poiché l'elaborazione parallela, rimuovendo la scansione uno dopo l’altro, cancella la nozione di sequenza. I vettori di embedding, che proiettano ciascun token in uno spazio semantico a dimensionalità elevata (tipicamente 512 o 768), vengono sommati a segnali sinusoidali di frequenze diverse, i quali permettono al modello di distinguere la posizione relativa e assoluta di ogni elemento. La seconda, la self‑attention, è ciò che consente al Transformer di guardare contemporaneamente a tutte le altre parole per costruire una rappresentazione contestualizzata di ciascuna. Ogni token viene proiettato in tre vettori distinti – Query (Q), Key (K) e Value (V) – attraverso matrici di pesi addestrabili. La similarità tra una Query e tutte le Key viene misurata tramite un prodotto scalare scalato per la radice quadrata della dimensionalità del modello, un accorgimento che previene valori di softmax troppo estremi. I pesi di attenzione risultanti vengono quindi utilizzati per ponderare i vettori Value, cosicché ogni parola possa “prestare attenzione” in modo differenziato alle altre. L'aspetto più elegante è che tutte queste operazioni sono implementabili mediante moltiplicazioni matriciali, quindi eseguibili in parallelo su GPU o TPU senza attese per l'elaborazione sequenziale.

Multi‑Head Attention: specializzazione e parallelismo semantico

Se la self‑attention semplice fosse impiegata da sola, esisterebbe il rischio di produrre rappresentazioni medie che appiattiscono le diverse funzioni linguistiche. Per questo i ricercatori hanno introdotto il concetto di “teste” multiple: il modello proietta Q, K e V in h sottospazi di dimensionalità ridotta (tipicamente 8 o 16 teste) e calcola l'attenzione indipendentemente in ciascuno di essi. Questa frammentazione permette a ogni testa di specializzarsi su un aspetto diverso della frase. Alcune teste imparano a catturare le dipendenze sintattiche a breve raggio, come l'accordo nome‑aggettivo o la reggenza verbale; altre si focalizzano sulle relazioni a lunga distanza, come il legame tra un pronome anaforico e il suo antecedente situato all'inizio di un lungo paragrafo; altre ancora codificano relazioni semantiche più sottili, quali l'appartenenza a un medesimo campo lessicale o la vicinanza in uno spazio di embedding pre‑addestrato. I vettori di output di ciascuna testa vengono poi concatenati e riportati alla dimensionalità originale attraverso una ulteriore matrice di peso, producendo una rappresentazione finale ricca, densa di informazione e multi‑sfaccettata. La vera forza delle teste multiple risiede nella loro capacità di operare simultaneamente senza richiedere supervisione esplicita su quale relazione debbano codificare; è il processo di retropropagazione dell'errore, guidato dal compito di previsione del token successivo (nel pre‑addestramento) o dalla classificazione (nel fine‑tuning), a far emergere spontaneamente tale specializzazione. Esperimenti di analisi dei pesi hanno mostrato che in modelli addestrati su corpus multilingue, alcune teste diventano addirittura specifiche per una lingua o per un fenomeno grammaticale, mentre in modelli come BERT si osservano teste dedicate alla risoluzione di coreferenze e altre all'estrazione di entità. L'architettura Transformer ha così rotto il compromesso che affliggeva le RNN: non si deve più scegliere tra memoria a breve e a lungo termine, perché ogni token ha accesso diretto all'intera sequenza. Inoltre, il costo computazionale di un layer di self‑attention scala quadraticamente con la lunghezza della sequenza (O(n²)), ma in pratica la costante moltiplicativa è molto favorevole e consente di addestrare modelli con miliardi di parametri su dataset grandi quanto l'intero Common Crawl. La nascita dei Large Language Models – GPT, BERT, T5 e i loro successori – è diretta conseguenza di questa scalabilità: senza Transformer non avremmo assistito all'esplosione di capacità generative e di comprensione che oggi caratterizza modelli come GPT‑4 o Claude. E il meccanismo di attenzione, oltre a essere implementabile in modo efficiente su hardware parallelo, si è rivelato eccezionalmente versatile, trovando applicazione non solo nel testo ma anche nella visione artificiale (Vision Transformer, ViT) e nella biologia computazionale (AlphaFold2 utilizza un'evoluzione del concetto di attenzione per predire le distanze tra residui amminoacidici). L'addestramento di questi modelli ha beneficiato di un ulteriore affinamento: l'uso del layer normalization applicato prima del meccanismo di attenzione (pre‑LN) e l'introduzione della connessione residua attorno a ciascun sottolivello hanno stabilizzato l'addestramento di reti molto profonde, consentendo di impilare decine di decoder Transformer senza incorrere in problemi di divergenza. La flessibilità dell'architettura originale ha poi dato origine a innumerevoli varianti: l'attenzione sparsa (sparse attention), che riduce il costo quadratico concentrandosi solo su alcuni token; l'uso di rotary positional embeddings (RoPE), che migliora la codifica posizionale per sequenze di lunghezza variabile; e meccanismi di retrieval augmentati, nei quali il modello impara a interrogare una memoria esterna durante l'inferenza. L'eredità del Transformer, insomma, è quella di aver fornito un mattoncino computazionale universale per modellare relazioni tra elementi di un insieme, senza assunzioni di struttura sequenziale, aprendo un'era in cui la comprensione del linguaggio da parte delle macchine non è più simulacro statistico ma autentica competenza funzionale.

Dalle limitazioni computazionali all'impatto sociale e scientifico

L'ascesa dei Transformer ha dischiuso orizzonti che fino a pochi anni prima apparivano confinati alla fantascienza. I sistemi di traduzione automatica neurale, come quelli sviluppati da Google e DeepL, hanno interiorizzato l'architettura Transformer nei loro encoder‑decoder, raggiungendo una fluidità e una precisione lessicale tali da risultare spesso indistinguibili dalla produzione umana. Nel campo dell'assistenza sanitaria, modelli basati su Transformer vengono oggi utilizzati per analizzare cartelle cliniche elettroniche, estrarre automaticamente sintomi e segni da referti non strutturati, e persino suggerire diagnosi differenziali sulla base della letteratura medica più aggiornata. Nella ricerca giuridica, interi database di sentenze e leggi vengono interrogati attraverso interfacce conversazionali rese possibili da LLM addestrati con Transformer, permettendo ad avvocati e giudici di reperire precedenti in tempi ridottissimi. Tuttavia, l'ubiquità di questa tecnologia solleva anche interrogativi etici e filosofici non trascurabili. Il riferimento a Wittgenstein, con cui l'articolo si è aperto, ritorna con forza: se il significato di una parola è determinato unicamente dal suo uso all'interno di un sistema, allora un modello addestrato su un corpus sufficientemente vasto e variegato potrebbe effettivamente “comprendere” il linguaggio nello stesso senso funzionale in cui lo comprende un parlante umano? La risposta non è unanime. I critici sottolineano che i Transformer, pur maneggiando abilmente sintassi e semantica distribuzionale, non possiedono un'anima intenzionale: non hanno esperienza diretta del mondo, non provano emozioni, non afferrano il nesso tra il simbolo e l'oggetto. Tuttavia, difensori del connessionismo più spinto ribattono che la cognizione umana stessa potrebbe essere, in ultima analisi, un'architettura predittiva basata su pattern statistici, e che attribuire uno statuto speciale alla coscienza biologica potrebbe rivelarsi un pregiudizio infondato. Al di là del dibattito filosofico, l'impatto pratico dei Transformer si misura anche nella loro impronta ambientale: addestrare un modello con centinaia di miliardi di parametri può consumare quantità di energia elettrica pari al fabbisogno annuo di centinaia di famiglie, e solleva la necessità di progettare hardware più efficienti, come i tensor processing unit dedicati, e di adottare strategie di compressione (distillazione, quantizzazione) per ridurre il costo inferenziale. La comunità scientifica è al lavoro anche per mitigare un altro effetto collaterale: i modelli Transformer possono assorbire e amplificare i bias presenti nei dati di addestramento, perpetuando stereotipi di genere, razza o orientamento. Tecniche di fine‑tuning controllato, apprendimento per rinforzo con feedback umano (RLHF) e filtraggio dei dati di pre‑addestramento stanno progressivamente riducendo queste storture. Nel frattempo, la ricerca prosegue verso architetture ancora più efficienti, come quelle a stato di spazio strutturato (S4, Mamba) che potrebbero un giorno scalzare la self‑attention offrendo complessità sub‑quadratica. Ma per ora, il Transformer rimane il cuore pulsante dell'intelligenza artificiale moderna, il motore che ha permesso alle macchine di imparare a leggere e, in un senso molto pragmatico, a comprendere.

La strada aperta da “Attention Is All You Need” ha ridefinito radicalmente non solo l'ingegneria dell'NLP, ma anche la nostra percezione di ciò che un algoritmo può realizzare. Resta da vedere se la prossima rivoluzione manterrà l'attenzione al centro o la sostituirà con meccanismi ancora più prossimi al funzionamento del cervello biologico.

Nessun commento trovato.

Disclaimer

L'indirizzo IP del mittente viene registrato, in ogni caso si raccomanda la buona educazione.

L'indirizzo IP del mittente viene registrato, in ogni caso si raccomanda la buona educazione.

Microsmeta Podcast

Microsmeta Podcast Feed Atom 0.3

Feed Atom 0.3

Think different!

Think different!

Articolo

Articolo  Storico

Storico Stampa

Stampa